一、RNN中为什么会出现梯度消失?

在RNN(循环神经网络)中出现梯度消失问题是由于RNN的结构和激活函数的特性所引起的。具体来说,以下几个因素可能导致梯度消失问题:

-

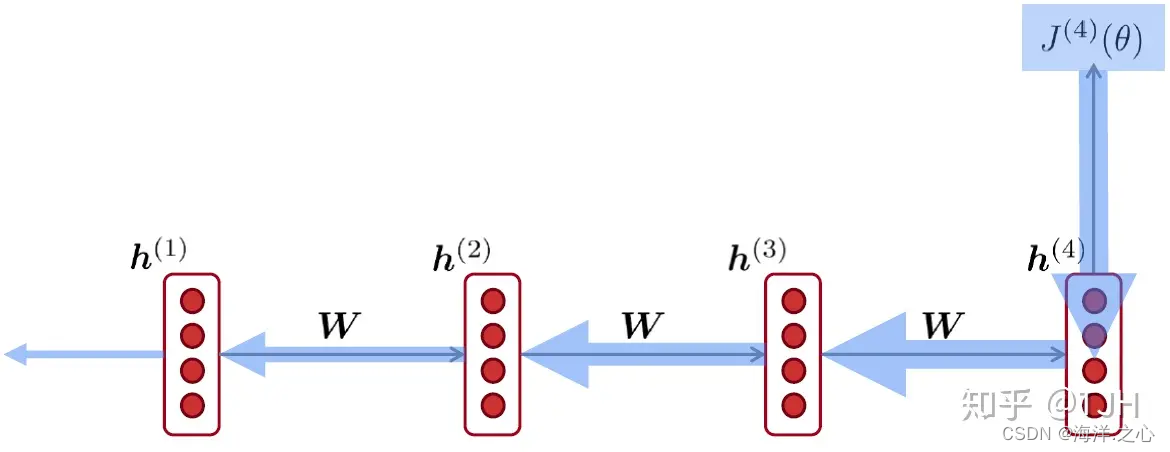

链式法则: RNN在进行反向传播时需要计算关于权重的梯度,这涉及到多次应用链式法则。每个时间步的梯度计算都需要将之前时间步的梯度乘以一个权重矩阵(循环权重),这会导致梯度值在反复相乘时逐渐减小,从而可能消失到接近零。

-

Sigmoid激活函数: 传统的RNN中常使用Sigmoid激活函数,其输出范围在0到1之间。当激活函数的输出接近0或1时,其导数会趋近于0,这意味着在反向传播过程中,梯度会趋向于消失。

-

长序列依赖: RNN的一个主要用途是捕捉序列数据中的长期依赖关系。然而,当序列较长时,由于梯度反复相乘,梯度值可能逐渐变小并消失,导致无法捕捉到长期依赖。

-

权重初始化: 如果RNN的权重初始化较小,或者Sigmoid激活函数的初始参数接近0或1,那么网络在初始阶段就可能遇到梯度消失问题。

</

订阅专栏 解锁全文

订阅专栏 解锁全文

2842

2842

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?