前向传播(Forward Propagation)和后向传播(Backpropagation)在神经网络训练过程中各自用于不同的阶段,具体如下:

前向传播(Forward Propagation)

用途

前向传播用于计算神经网络的输出。在训练和推理(即预测)阶段都会用到前向传播。

阶段

-

训练阶段:

- 目的: 计算当前模型参数下的预测结果。

- 过程: 将输入数据通过神经网络的各层进行传递,计算每层的输出,最终得到模型的预测输出。

- 计算损失: 预测输出与真实标签之间的差异通过损失函数进行计算,得到损失值。

-

推理阶段(预测阶段):

- 目的: 使用训练好的模型对新数据进行预测。

- 过程: 与训练阶段相同,将新数据输入神经网络,通过前向传播计算得到预测结果。

后向传播(Backpropagation)

用途

后向传播用于计算损失函数关于模型参数的梯度,并更新模型参数。主要在训练阶段使用。

阶段

- 训练阶段:

- 目的: 通过反向传播误差调整模型参数,使损失函数最小化。

- 过程:

- 计算梯度: 从输出层开始,逐层向后计算每层的误差,并根据误差计算每层参数的梯度。

- 更新参数: 使用梯度下降等优化算法,根据计算得到的梯度更新模型参数。

训练过程的总结

在整个训练过程中,前向传播和后向传播是交替进行的,具体步骤如下:

-

前向传播:

- 将输入数据传递到神经网络,计算每一层的输出,直到输出层,得到预测结果。

- 根据预测结果和真实标签计算损失值。

-

后向传播:

- 计算损失函数关于每一层参数的梯度。

- 使用优化算法(如梯度下降)更新模型参数。

-

重复步骤1和步骤2:

- 对整个训练集或小批量数据进行多次前向传播和后向传播,不断调整模型参数,直到损失函数收敛或达到预定的训练轮数。

举例说明

以下是一个详细的前向传播和后向传播的示例,假设我们在训练一个简单的神经网络用于二分类任务。

示例背景

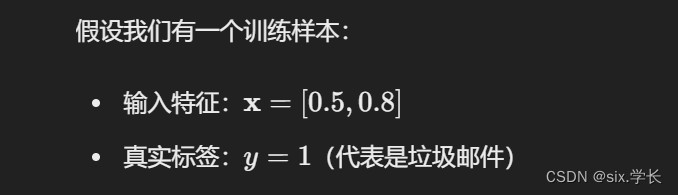

- 任务:二分类(例如,判断一封邮件是否为垃圾邮件)

- 输入特征:2个(例如,邮件长度和关键词数量)

- 网络结构:

- 输入层:2个神经元

- 隐藏层:3个神经元,使用 ReLU 激活函数

- 输出层:1个神经元,使用 Sigmoid 激活函数

输入数据

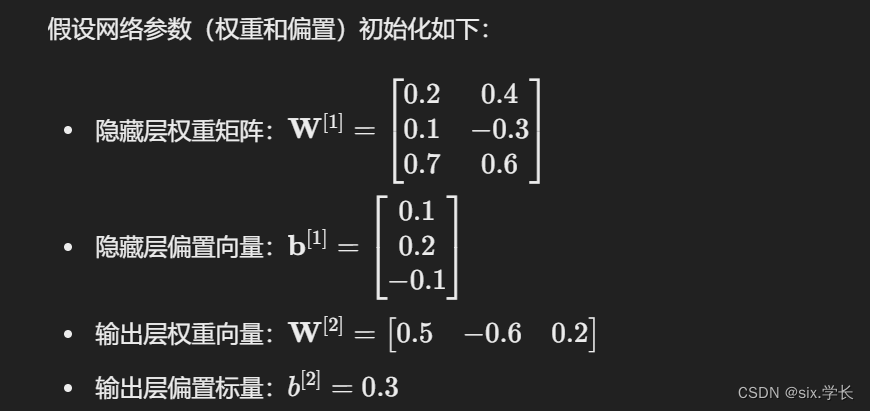

网络参数初始化

前向传播(Forward Propagation)

-

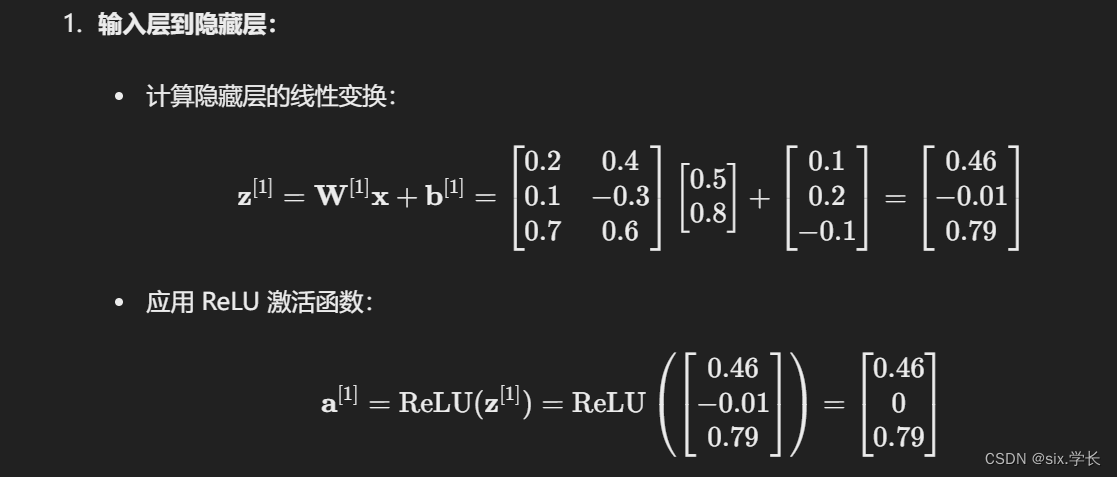

输入层到隐藏层:

-

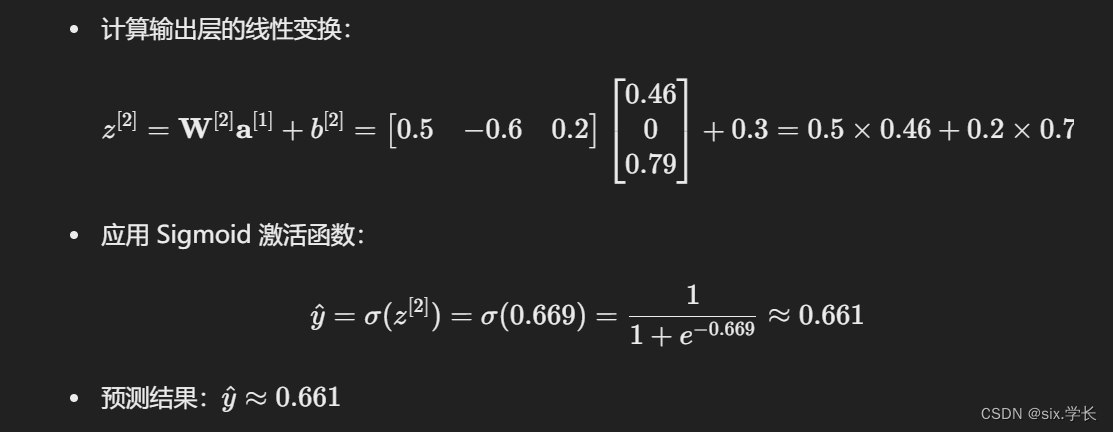

隐藏层到输出层:

-

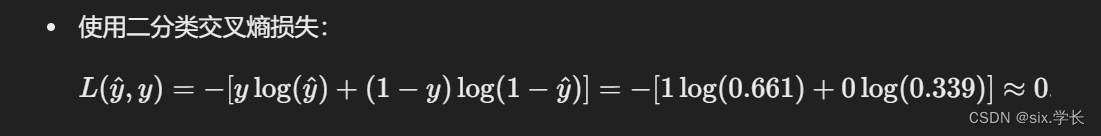

计算损失:

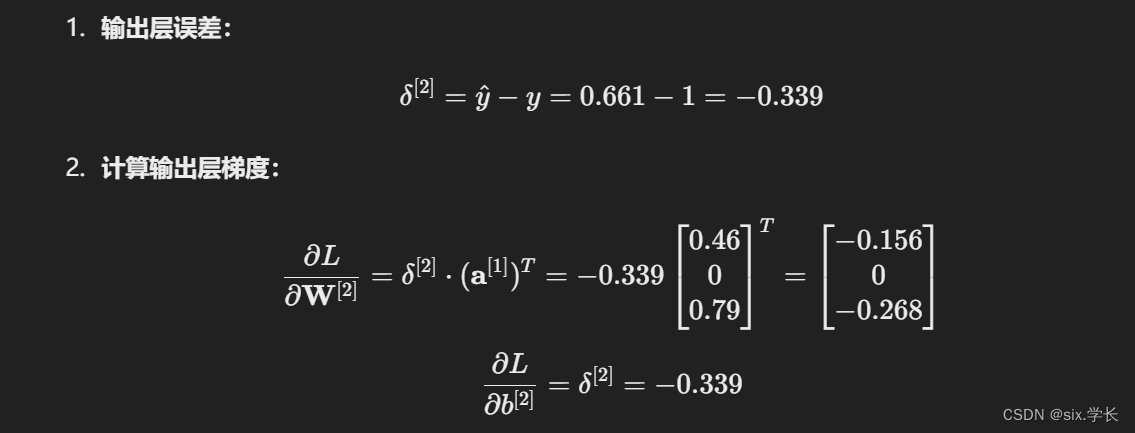

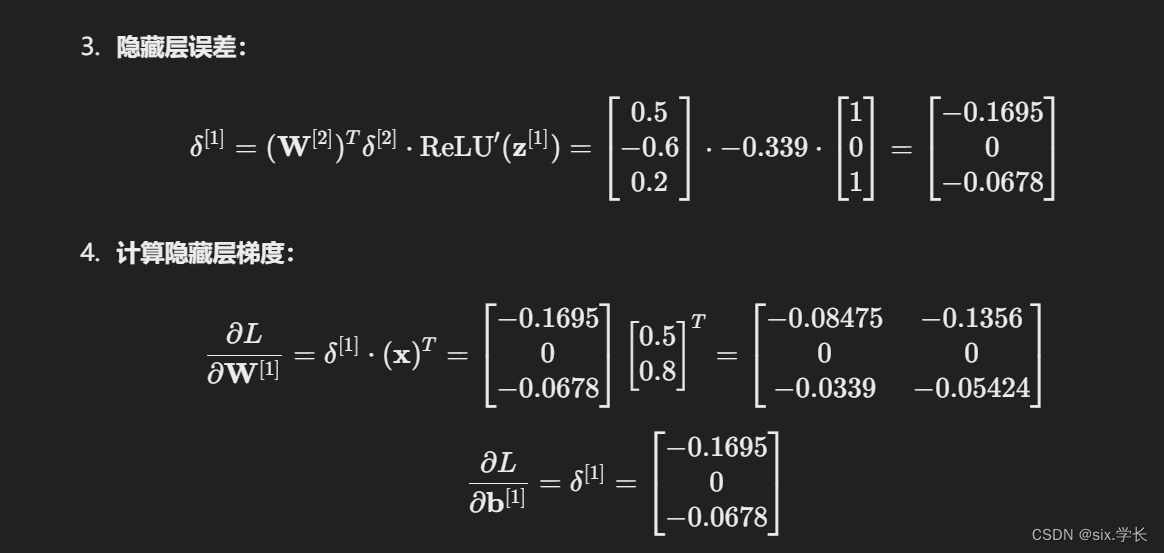

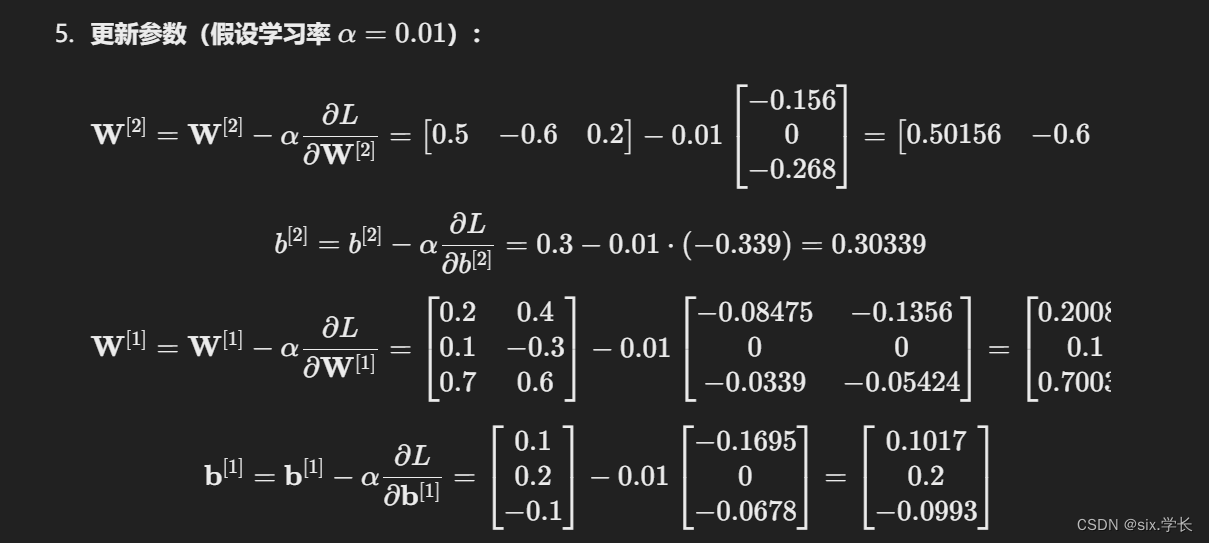

后向传播(Backpropagation)

2783

2783

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?