如何对CNN网络的卷积层进行反向传播

在多分类中,CNN的输出层一般都是Softmax。RBF在我的接触中如果没有特殊情况的话应该是“径向基函数”(RadialBasisFunction)。

在DNN兴起之前,RBF由于出色的局部近似能力,被广泛应用在SVM的核函数中,当然也有我们熟悉的RBF神经网络(也就是以RBF函数为激活函数的单隐含层神经网络)。

如果说把RBF作为卷积神经网络的输出,我觉得如果不是有特殊的应用背景的话,它并不是一个很好的选择。至少从概率角度上讲,RBF没有Softmax那样拥有良好的概率特性。

如果题主是在什么地方看到它的源代码并且感到困惑的话,可以贴上源链接一起讨论一下。

的定义和计算公式参考:/link?url=7LE6KImv5IveCM90JcnctlgVY7OgCd7E_G0Yv0vyTfV3P8S3Q_rZU3CM6f0udS-b6ux2w-hejkOrGMkmj8Nqba。

谷歌人工智能写作项目:小发猫

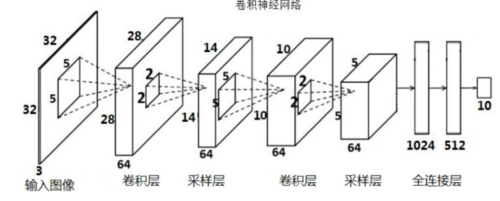

如何理解CNN神经网络里的反向传播backpropagation,bp算法

类比来说类似于几个人站成一排第一个人看一幅画(输入数据),描述给第二个人(隐层)……依此类推,到最后一个人(输出)的时候,画出来的画肯定不能看了(误差较大)AI爱发猫。

反向传播就是,把画拿给最后一个人看(求取误差),然后最后一个人就会告诉前面的人下次描述时需要注意哪里(权值修正)。

图片裁剪等操作对于cnn网络梯度反向传播有什么影响吗? 100

我的理解如下:首先,第一个CNN只能包含Conv和Pooling层,否则输出的格式是不能当做下一个CNN的输入的。

其次,如果第一个CNN每层的Convfilter数量大于1的话(假设最后一层的filter数为N),第一个CNN的输出shape为(N,W',H'),那么下一个CNN的Convfilter的通道数量必须也是N。

所以,这两个CNN从结构原理上其实是同一个CNN,其反向传播的机制跟正常的CNN相同。但是,这里“第一个”CNN是不能用于图像裁剪的,只能做常用的卷积操作来提取特征。

如果要做裁剪的话建议用RPN(RegionProposalNetwork)+CNN的结构。

RPN部分实际上是个回归模型,其目的是裁剪图片提取有效物体(训练目的是使该网络选取和物体大小、实际所在区域无线接近的区域)再输入到CNN进行识别。

而RPN和CNN是可以放在一起训练的,具体的可以参考FasterRCNN文献。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2591

2591

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?