Chinese-CLIP:基于大规模中文数据的跨模态预训练模型

近年来,跨模态预训练模型在计算机视觉和自然语言处理领域取得了巨大进展。其中,OpenAI提出的CLIP(Contrastive Language-Image Pre-training)模型通过大规模对比学习,实现了强大的零样本迁移能力,在各种下游任务中展现出惊人的效果。然而,原始CLIP模型主要针对英文进行训练,难以直接应用于中文场景。为了填补这一空白,阿里巴巴达摩院推出了Chinese-CLIP项目,旨在构建一个适用于中文领域的CLIP模型。

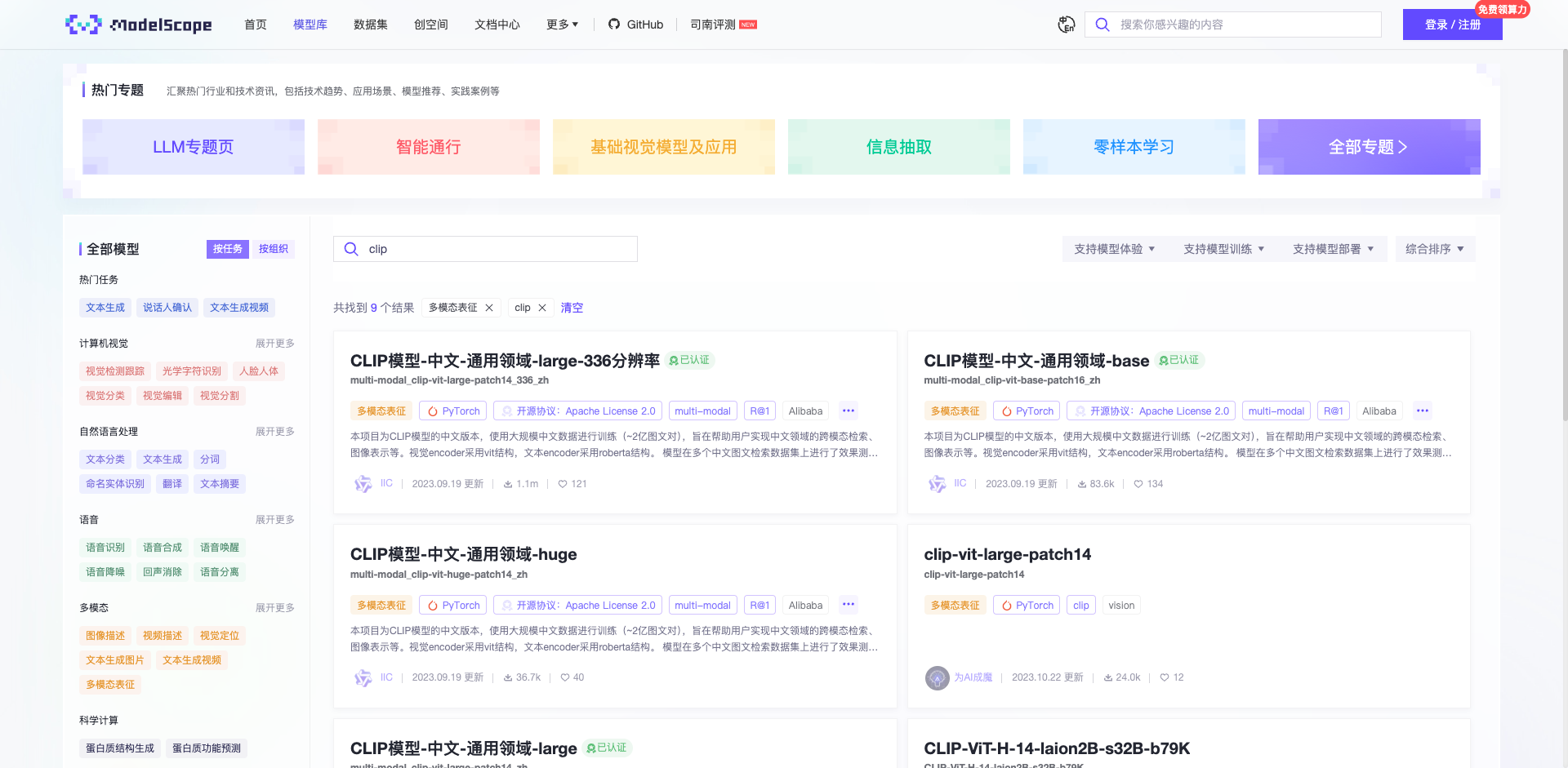

模型简介

Chinese-CLIP是CLIP模型的中文版本,采用了与原始CLIP相似的对比学习框架,但在以下几个方面进行了针对性优化:

-

训练数据:使用了约2亿规模的中文图文对数据进行预训练,涵盖了丰富的中文语义信息。

-

模型架构:视觉编码器采用了ViT(Vision Transformer)和ResNet两种backbone,文本编码器则使用了RoBERTa等预训练中文语言模型。

-

训练策略:针对中文特点,优化了文本tokenization、数据增强等训练细节。

-

模型规模:提供了从77M到958M参数的多个规模版本,满足不同应用场景的需求。

通过在大规模中文数据上的预训练,Chinese-CLIP实现了强大的跨模态表示学习能力,可以直接应用于图文检索、零样本图像分类等下

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2884

2884

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?