全连接层参数过多,考虑有没有办法减少参数量

(以图像处理为例)

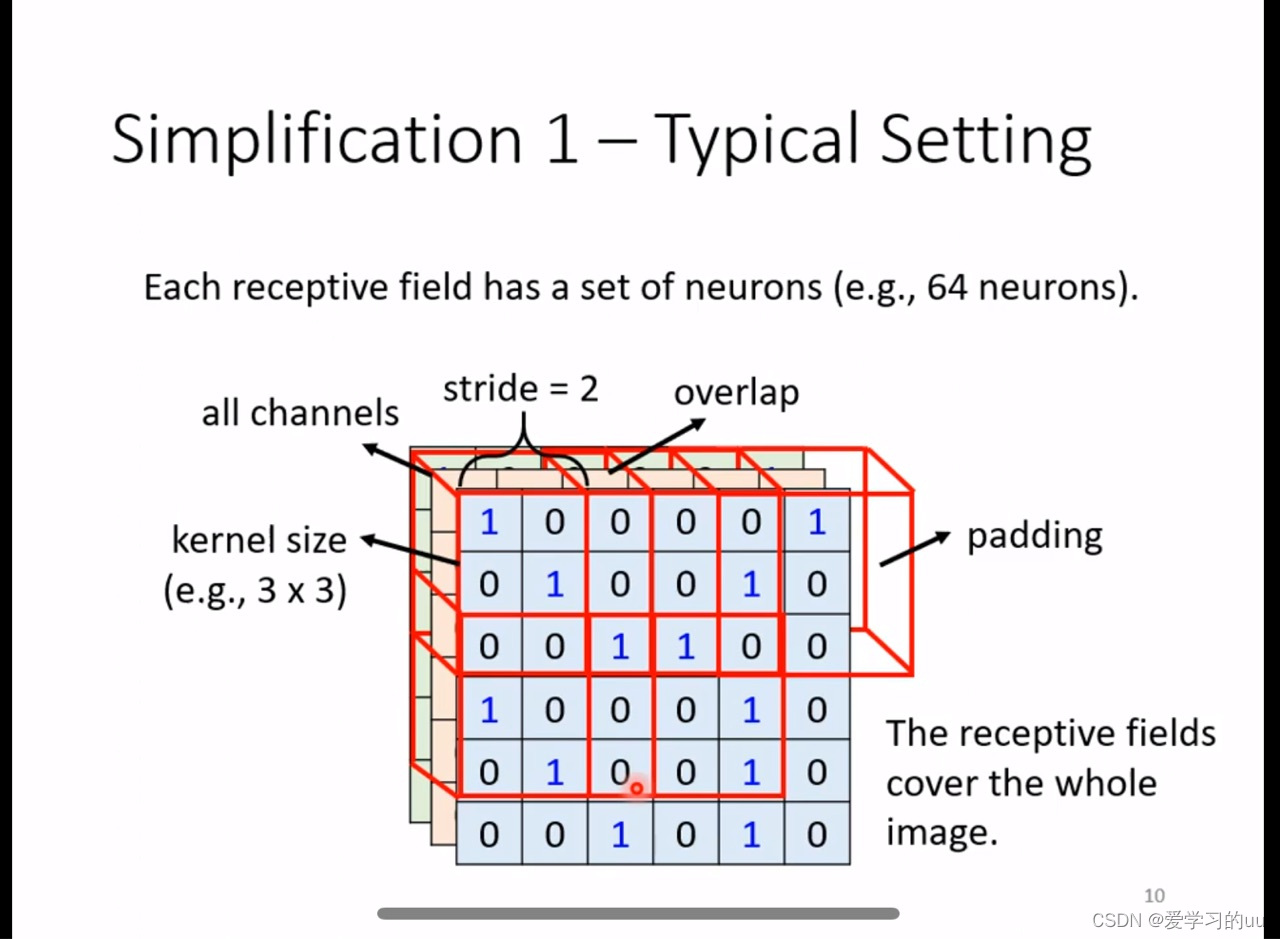

1.局部性:每层神经网络作用是学习图像的一部分特征,因此不需要看整张图片,由此得感受野(比较常用的是3*3的),在计算过程中给每格一个学习的权重,对应相乘后相加得特征值

关于步幅和边缘轮廓设定:在实际操作中,一般设定平移的步幅为1或2(以保证每次的感受野有一定重合,不会错过某些信息)。同时,为了保证边缘信息不会被错过,因此一般会在图像外围补上一圈,保证感受野能走遍所有的格子

2.平移不变性:

同一个特征可能出现在图片的不同位置,因此可以做参数共享(也就是让这个感受野扫过图片进行计算)

3.图片采样之后属性不会变化—引出了池化层(常用的是最大池化层,即在每格里取最大值),近年来运算能力越来越强,因此不太用池化了

4.这么做会不会只能提取到局部的信息—不会,因为每一层都能提取到上一层的特征,越上面的层就越能提取到全局的特征

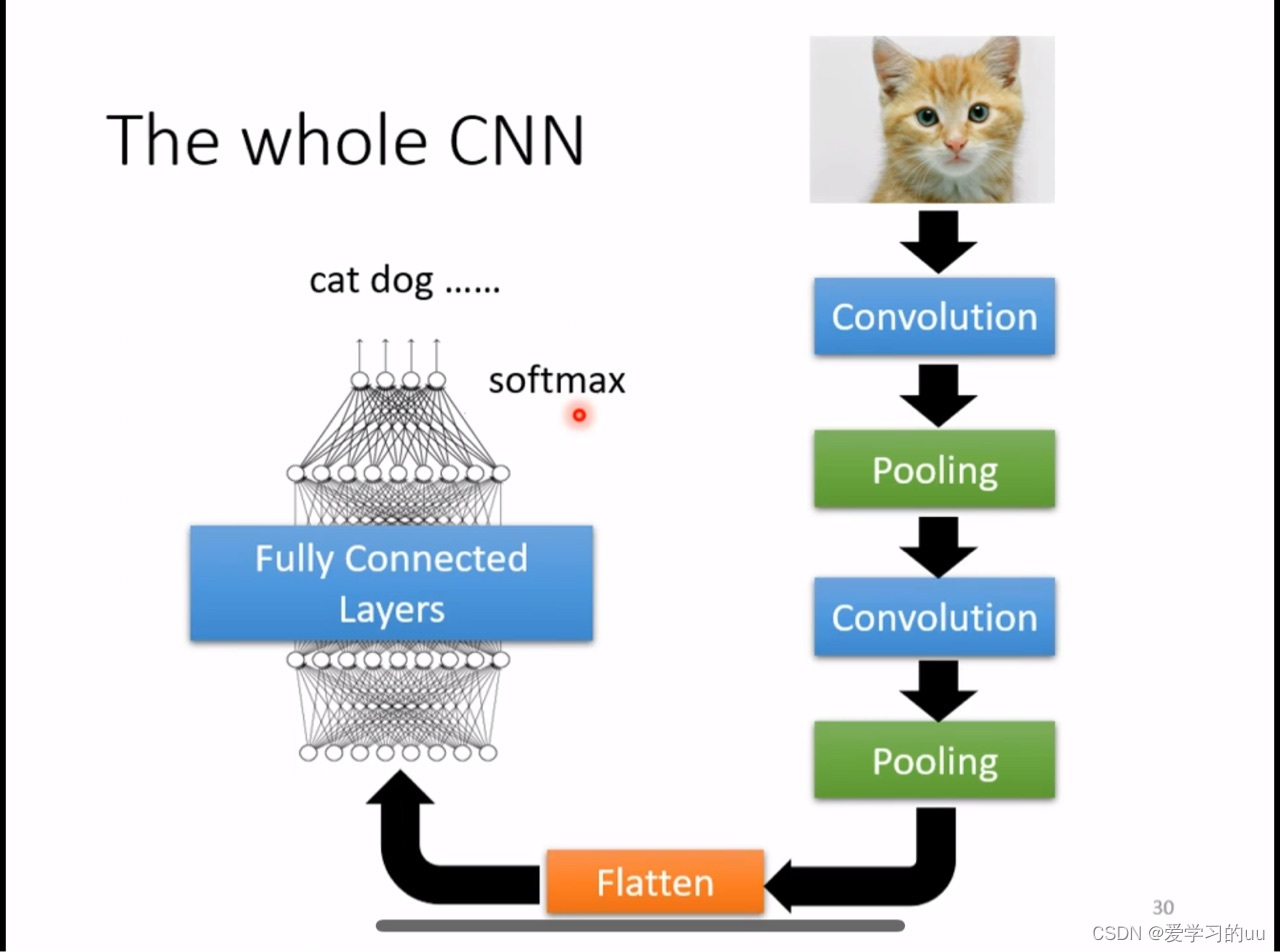

5.最终整体的卷积神经网络架构如图:

在经历若干卷积、池化层后,最终还要经过flatten层,把图片拍扁成一个一行的向量,再经过softmax层把它分类

卷积神经网络的应用:下围棋

把棋盘看成19*19的向量,黑白空分别表示为-1、1、 0,算出下在哪个地方是最好的(概率最大的)

适用性:1.下围棋常常只要看落子处周围小范围内的情况即可

2.同一个落子的模式可能会同时出现在棋盘的不同地方

3.29日补充知识点:关于多输入通道以及多输出通道的卷积:

多输入通道:输入经过的卷积核只有一个,但卷积核有很多通道(层),每层和输入对应做卷积,最终的输出只有一层

多输出通道:有多个卷积核,每个卷积核输出一个通道层,每个输出通道可以识别特定模式

1136

1136

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?