情况说明:工作日只能地铁上手机码字,因此无法更新相关代码,工作日会统一更新,感兴趣的可以先点个关注喔

这篇补充前面提到的权重衰退、丢弃法、数据增广、微调的理论知识

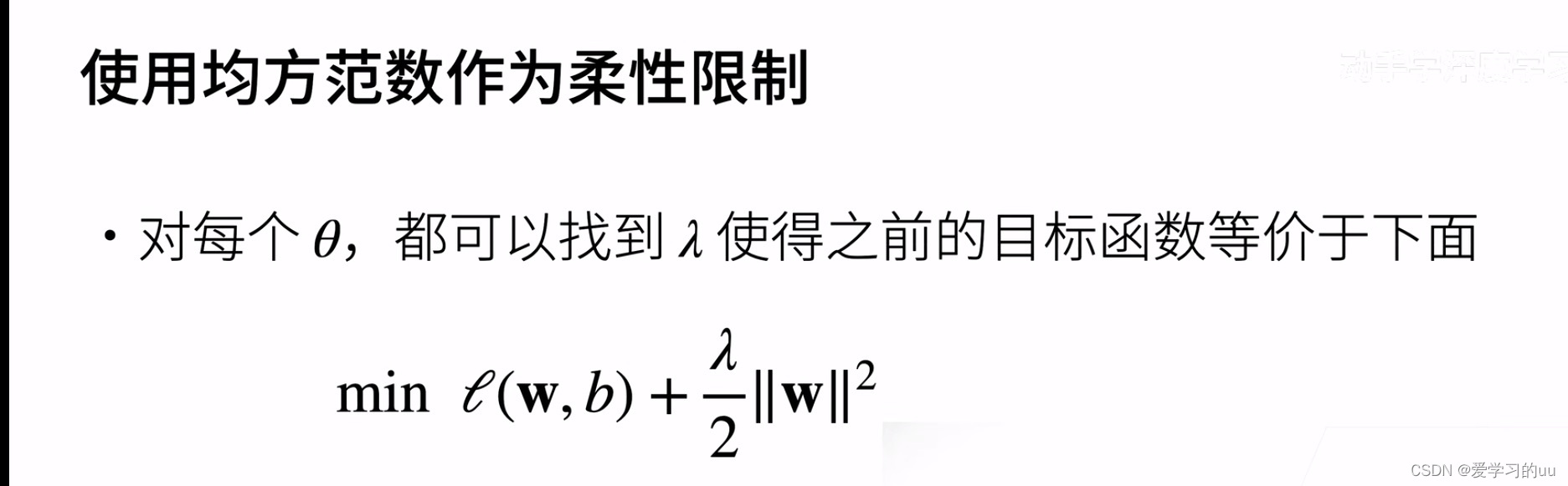

1、权重衰退(即加惩罚函数)

目的:控制模型的容量,一般思路是给目标函数加惩罚函数,使得w的值不会过大

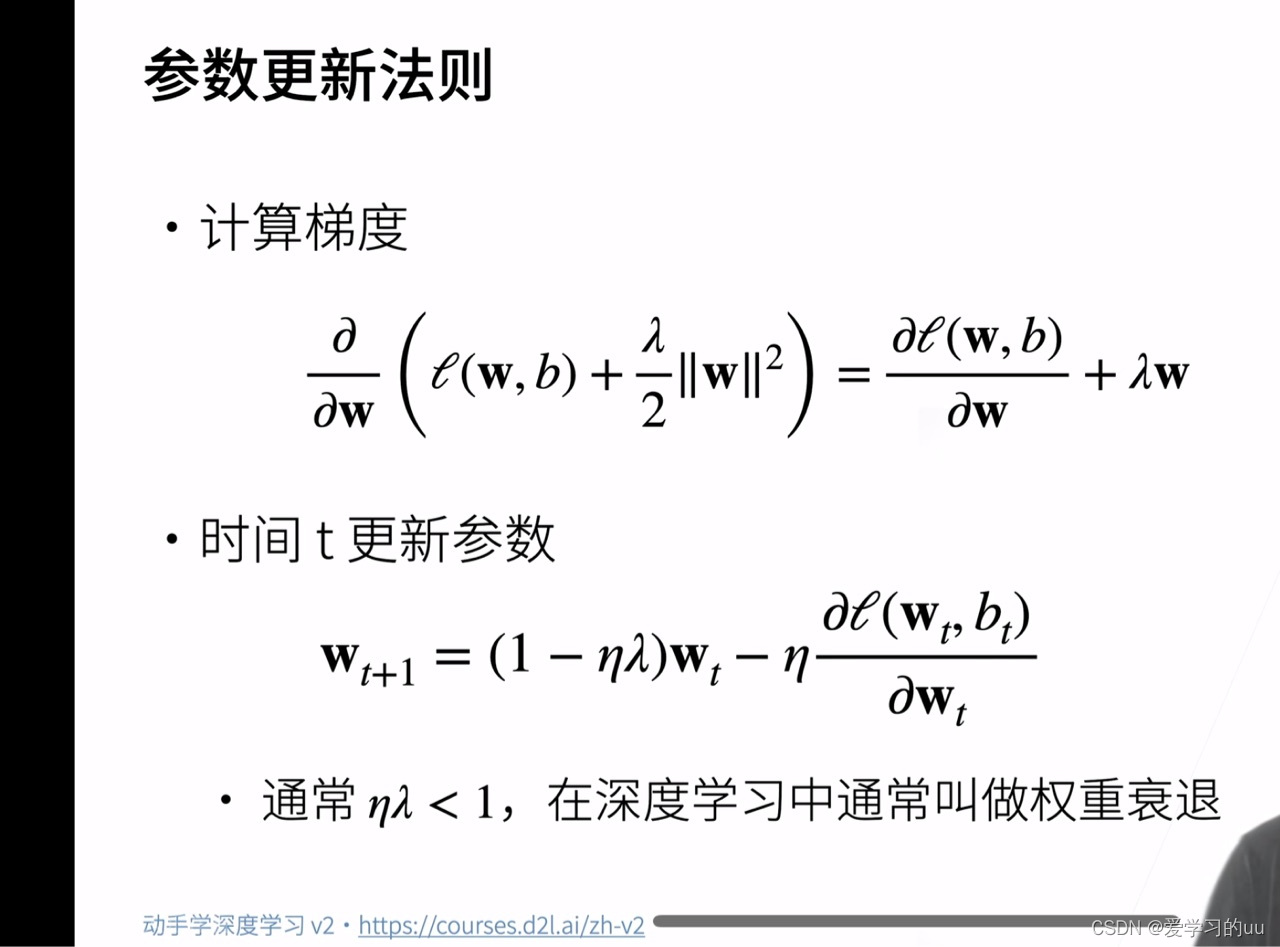

则可得参数的更新公式为

wt+1=wt-n*损失函数对w的偏导

把第一个式子带入上面的式子可得第二个式子,因此可知权重是不断变小的,称为权重衰减

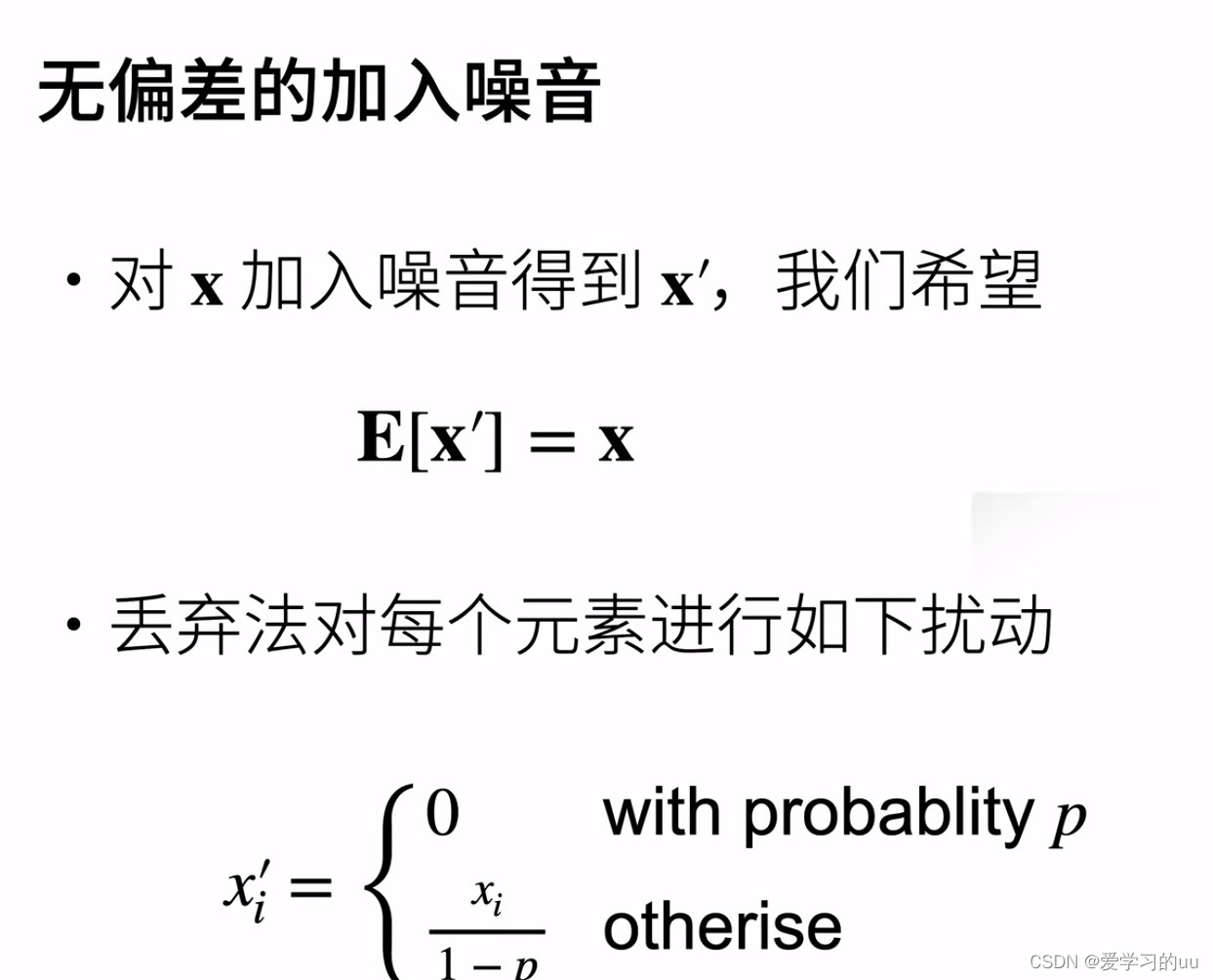

2.丢弃法

思路:好的模型应该要抗干扰噪音,因此考虑在层之间加上噪音的同时保持每层的输出不变,数学算法如下

通常把丢弃法用在多层神经网络最后一个隐藏层的输出上

注意:只在训练集时做丢弃,测试集上用效果最好的那个丢弃结果

3.数据增广:产生更多样本

数据增强:加噪音或改变图片的颜色和形状

翻转:(上下或左右翻转,注意不要乱翻,比如你把一个猫上下倒过来就不适合当样本了)

切割:切一小块然后变换到原大小

2775

2775

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?