一、模型评估概述

1.什么是模型评估

模型评估是机器学习中的一个重要环节,它指的是对训练好的模型进行性能评估,以了解模型在未见过的新数据上的表现。这通常包括使用一系列指标来量化模型的预测能力、泛化能力、稳定性等。模型评估方法不针对模型本身,只针对问题和数据,因此可以用来评价来自不同方法的模型和泛化能力,进行用于部署的最终模型的选择。

2.模型评估的类型

机器学习的任务有回归,分类和聚类,针对不同的任务有不同的评价指标。按照数据集的目标值不同,可以把模型评估分为回归模型评估和分类模型评估。

3.过拟合、欠拟合

(1)过拟合

我们希望得到在新样本上能表现得很好的学习器,为了达到这个目的,应该从训练样本中尽可能学出适用于所有潜在样本的“普遍规律”,这样才能在遇到新样本时做出正确的判别。然而,当学习器把训练样本学得“太好”了的时候,很可能已经把训练样本自身的一些特点当作了所有潜在样本都会具有的一般性质,这样就会导致泛化能力下降,这种现象在机器学习中称为“过拟合”。

(2)欠拟合

欠拟合与过拟合相对,这是指对训练样本的一般性质尚未学好。欠拟合是机器学习中的一种情况,当模型在训练数据上表现的很差,无法捕捉到数据中的复杂模式,导致模型的泛化能力弱,这通常表现为模型在训练集和验证集上的误差都很高。

有多种因素可能导致过拟合,其中最常见的情况是由于学习能力过于强大,以至于把训练样本所包含的不太一样的特性都学到了,而欠拟合则通常是由于学习能力低下而造成的。欠拟合比较容易克服,例如在决策树学习中扩展分支、在神经网络学习中增加训练轮数等,而过拟合则很麻烦,过拟合是机器学习面临的关键障碍,各类学习算法都必然带有一些针对过拟合的措施;然而必须认识到,过拟合是无法避免的,我们所能做的只是缓解,或者说减小其风险。

4.模型泛化能力

模型的泛化能力是指模型在未见过的新数据上的预测能力。在机器学习中,我们训练模型是基于一部分已知的数据(训练集),但我们的目标是希望模型能够对未见过的数据也能做出准确的预测。泛化能力衡量的就是模型在新的、随机的、独立的测试数据上的表现,而不是仅仅在训练数据上的表现。

在训练过程中,模型可能会因为试图过于紧密地拟合训练数据(过拟合)而失去泛化能力,或者因为未能充分学习到数据中的模式(欠拟合)而导致泛化能力不足。理想的模型应该在训练数据上表现良好,同时在未见过的数据上也能保持一致的预测性能。

提高模型泛化能力的方法包括:

(1)使用足够的训练数据:更多的数据可以帮助模型学习到更普遍的规律。

(2)交叉验证:通过数据划分和多次训练验证,更准确地评估模型性能。

(3)特征选择和降维:去除冗余或无关特征,减少噪声,提高模型的解释性。

(4)集成学习:通过结合多个模型的预测来提高整体的泛化性能。

二、性能度量

在对学习器的泛化能力进行评估时,不仅需要有效可行的实验估计方法,还需要有衡量模型泛化能力的评价标准,这就是性能度量。性能度量通常在回归任务和分类任务中体现。

1.回归性能指标

在预测任务中,给定样例集D={(x1,y1),(x2,y2),...,(xm,ym)},其中yi是示例xi的真实标记。要评估学习器f的性能,就要把学习器预测结果f(x)与真实标记y进行比较。

回归任务最常用的性能度量是均方误差:

更一般的,对于数据分布D和概率密度函数p(.),均方误差可描述为:

2.分类性能指标

(1)错误率与精度

错误率是分类错误的样本数占样本总数的比例,精度则是分类正确的样本数占样本总数的比例。

对于样例集D,分类错误率定义为

精度则定义为

更一般的,对于数据分布D和概率密度函数p(.),错误率与精度可分别描述为

(2)查准率、查全率

混淆矩阵:也被称为误差矩阵或可能性表格,是机器学习领域中一种常见的可视化工具,特别是在监督学习中。它的主要作用是用来评价算法或分类器的结果分析表。混淆矩阵是一个n行n列的矩阵,其中每一列代表预测值,每一行代表实际值。

在二分类问题中,混淆矩阵的四个主要元素通常被标记为:

TP:真正例,实际是正例,识别为正例。

FN:真反例,实际是正例,却识别成了负例。

FP:假正例,实际是负例,却识别成了正例。

TN:真反例,实际是负例,识别为负例。

分类结果混淆矩阵如下:

| 真实情况 | 预测结果 | |

| 正例 | 反例 | |

| 正例 | TP(真正例) | FN(真反例) |

| 反例 | FP(假正例) | TN(真反例) |

有了混淆矩阵,我们可以构造出多种指标来从不同角度反映分类器的分类准确程度,如:

准确率:(TP+TN)/(TP+TN+FN+FP),即不管是哪种类别,预测结果与实际结果一致的比例。

召回率:TP/(TP+FN),即有多少正样本被准确识别。

错检率:FP/(FP+TN),即有多少负样本被错误识别。

查准率:模型预测为正类别的样本中,真正为正类别的样本所占的比例。

查全率:真正为正类别的样本中,模型成功预测为正类别的样本所占的比例。

查准率P与查全率R可分别定义为

查准率与查全率是一对矛盾的度量,一般来说,查全率往往偏低;而查全率高时,查准率往往偏低。

(3)P-R曲线

在很多情形下,我们可根据学习器的预测结果对样例进行排序,排在前面的是学习器认为"最可能"是正例的样本,排在最后的则是学习器认为“最不可能”是正例的样本.按此顺序逐个把样本作为正例进行预测,则每次可以计算出当前的查全率、查准率。以查准率为纵轴、查全率为横轴作图,就得到了查准率-查全率曲线,简称“P-R 曲线”,显示该曲线的图称为“P-R 图”。

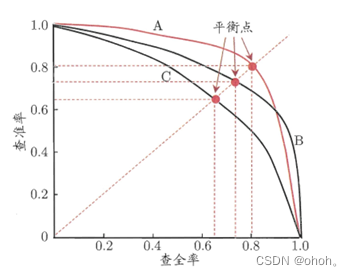

P-R图直观地显示出学习器在样本总体上的查全率、查准率。在进行比较时,若一个学习器的P-R曲线被另一个学习器的曲线完全包住,则可断言后者的性能优于前者。例如下图中学习器A的性能优于学习器C,若两个学习器的P-R曲线发生了交叉,如下图中的A与B,则一般难以判断优劣。这种情况下可以使用平衡点进行度量。平衡点(简称BEP)是查准率等于查全率时的取值,例如下图中学习器C的BEP是0.64,而基于BEP的比较,可认为学习器A优于B。

P-R曲线与平衡点示意图如下:

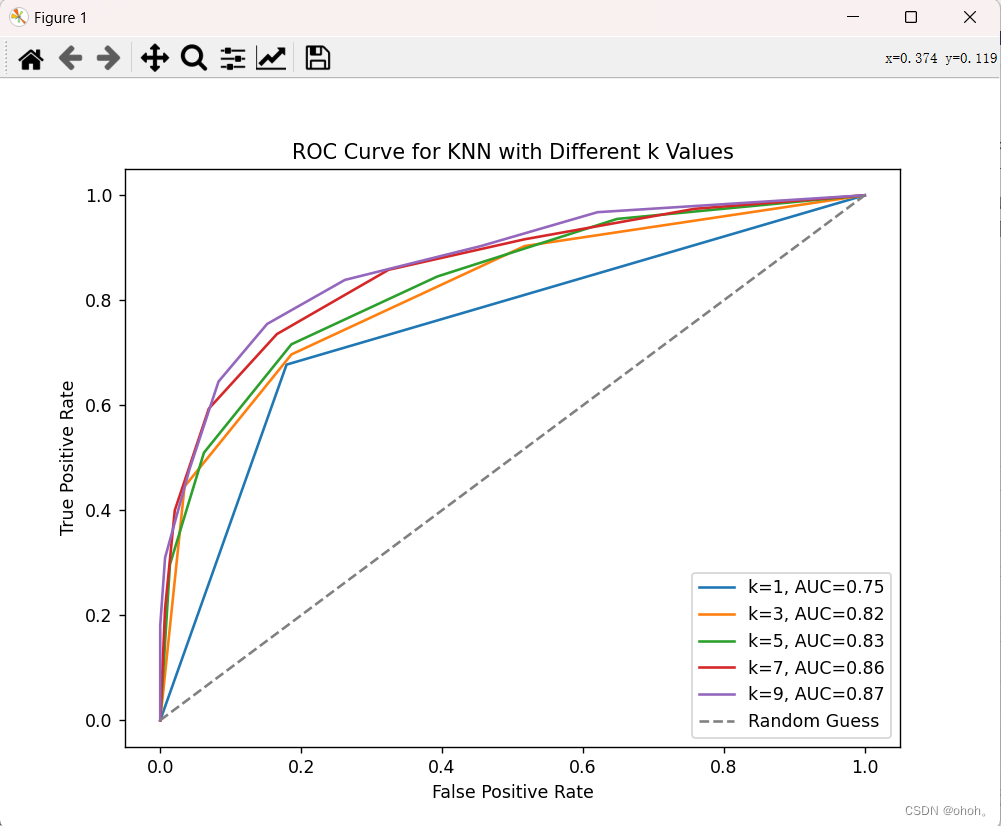

(4)ROC与AUC

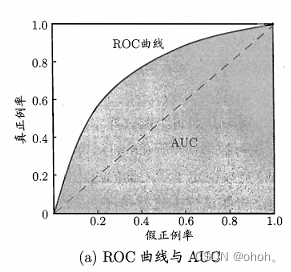

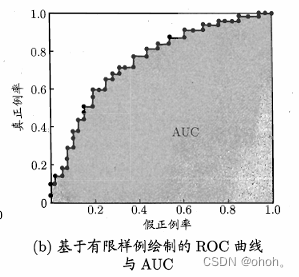

ROC全称是“受试者工作特征”,与P-R曲线相似,根据学习器的预测结果对样例进行排序,按此顺序逐个把样本作为正例进行预测,每次计算出两个重要量的值,分别以它们为横、纵坐标作图,就得到了ROC曲线。ROC曲线是一种用于评估二分类模型性能的图形化工具,它展示了在不同分类阈值下真阳性率(True Positive Rate,TPR)与假阳性率(False Positive Rate,FPR)之间的关系。ROC曲线的横轴是FPR,纵轴是TPR,曲线越靠近左上角,表示模型性能越好。

在ROC曲线上,我们可以通过计算曲线下面积(AUC)来量化模型的性能。AUC的取值范围在0.5到1之间,值越接近1表示模型性能越好,值为0.5表示模型性能等同于随机猜测。AUC曲线是ROC曲线下的面积,代表了分类模型在所有可能阈值下的平均性能。AUC值越大,说明模型在不同阈值下的性能越好。通常情况下,AUC值越接近1,表示模型的分类能力越强。AUC曲线常用于比较不同模型的性能,或者在不同阈值下对同一模型的性能进行评估。在实际应用中,AUC曲线可以帮助我们选择最佳的分类模型,并优化模型的性能。

三、ROC曲线与P-R曲线的差异

1.差异

(1)横纵坐标不同

ROC曲线的横坐标是假正例率(FPR),纵坐标是真正例率(TPR)。P-R曲线的横坐标是查全率,纵坐标是查准率。

(2)样本不平衡下的表现不同

ROC曲线对于样本不平衡的问题不敏感,因为它主要关注真正例率和假正例率的比例。P-R曲线在样本不平衡情况下更能反映模型在正例预测方面的性能,因为查全率和查准率更适合评估正例的预测情况。

(3)评估重点不同

ROC曲线更适合评估模型在不同阈值下的整体分类性能,主要关注模型的分类能力。P-R曲线更适合评估模型在不同阈值下的查全率和查准率的平衡情况,主要关注模型在正例预测方面的表现。

(4)曲线形状不同

ROC曲线通常是凸曲线,对角线表示随机分类器的表现。P-R曲线的形状取决于正例在数据集中的比例,不一定是凸曲线。

2.如何选择曲线

(1)数据分布:根据数据分布选择合适的曲线,ROC曲线适用于不平衡数据,P-R曲线适用于平衡数据。

(2)评估重点:如果关注整体分类性能,可以使用ROC曲线;如果关注正类别的预测准确性,可以使用P-R曲线。

(3)综合考虑:有时候可以结合使用ROC曲线和P-R曲线,综合评估模型的性能。

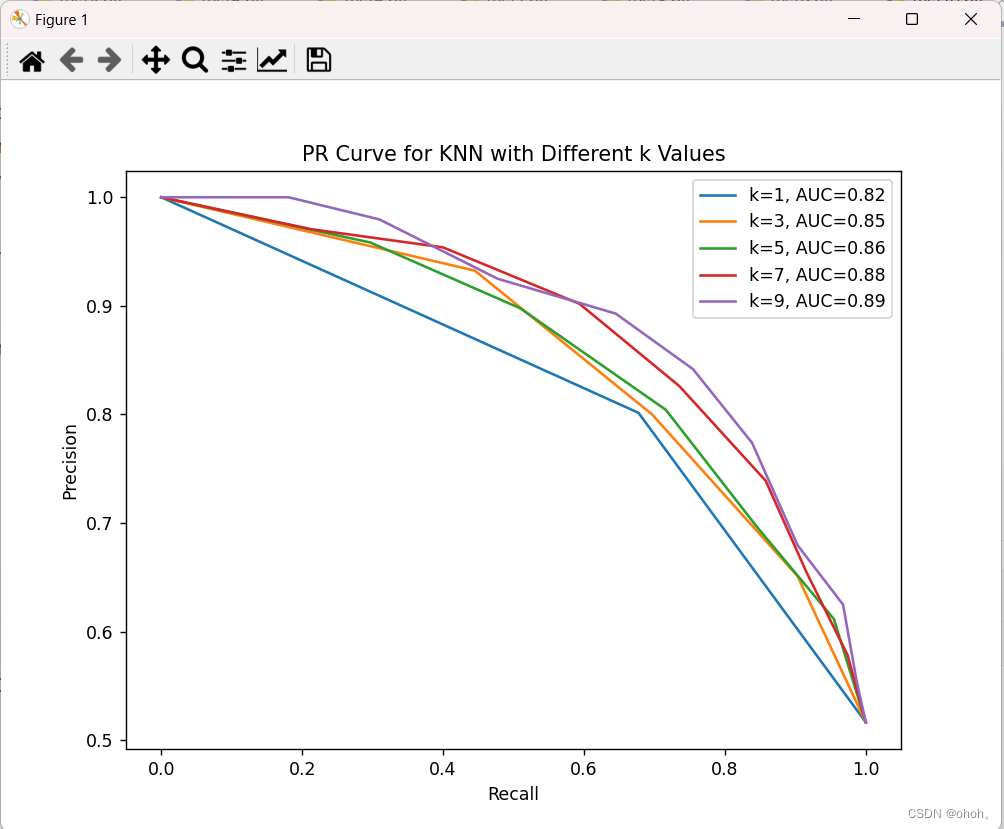

3.具体示例实现

以k-NN算法为例,当k取不同值时,分别绘制P-R曲线和ROC曲线,观察曲线变化,以下是具体的代码和结果实现:

(1)P-R曲线

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.metrics import precision_recall_curve, auc

from sklearn.preprocessing import StandardScaler

# 生成一些样本数据

X, y = make_classification(n_samples=1000, n_features=20, n_classes=2, random_state=42)

# 数据标准化

scaler = StandardScaler()

X = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 不同k值下的PR曲线

k_values = [1, 3, 5, 7, 9]

plt.figure(figsize=(8, 6))

for k in k_values:

knn = KNeighborsClassifier(n_neighbors=k)

knn.fit(X_train, y_train)

y_score = knn.predict_proba(X_test)[:, 1]

precision, recall, _ = precision_recall_curve(y_test, y_score)

pr_auc = auc(recall, precision)

plt.plot(recall, precision, label=f'k={k}, AUC={pr_auc:.2f}')

plt.xlabel('Recall')

plt.ylabel('Precision')

plt.title('PR Curve for KNN with Different k Values')

plt.legend()

plt.show()

(2)ROC曲线

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.metrics import roc_curve, auc

from sklearn.preprocessing import StandardScaler

# 生成一些样本数据

X, y = make_classification(n_samples=1000, n_features=20, n_classes=2, random_state=42)

# 数据标准化

scaler = StandardScaler()

X = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 不同k值下的ROC曲线

k_values = [1, 3, 5, 7, 9]

plt.figure(figsize=(8, 6))

for k in k_values:

knn = KNeighborsClassifier(n_neighbors=k)

knn.fit(X_train, y_train)

y_score = knn.predict_proba(X_test)[:, 1]

fpr, tpr, _ = roc_curve(y_test, y_score)

roc_auc = auc(fpr, tpr)

plt.plot(fpr, tpr, label=f'k={k}, AUC={roc_auc:.2f}')

plt.plot([0, 1], [0, 1], linestyle='--', color='grey', label='Random Guess')

plt.xlabel('False Positive Rate')

plt.ylabel('True Positive Rate')

plt.title('ROC Curve for KNN with Different k Values')

plt.legend()

plt.show()

在上述代码中,使用了不同的k值(1, 3, 5, 7, 9)来训练KNN模型,并绘制了它们对应的P-R曲线和ROC曲线。通过观察曲线,可以得出以下分析:

①k=1

当k=1时,模型过于复杂,容易受到噪声的影响,导致过拟合。因此,在测试集上的性能可能不够稳定,P-R曲线和ROC曲线可能出现较大的波动。

②k=3和k=5

随着k值的增加,模型变得相对简单,容易泛化到新数据。因此,当k=3和k=5时,模型可能在测试集上表现较为稳定,P-R曲线和ROC曲线的AUC值可能会有所提升。

③k=7和k=9

当k值进一步增加到7和9时,模型变得更加简单,可能会出现欠拟合的情况。在测试集上的性能可能有所下降,P-R曲线和ROC曲线的AUC值可能会略微降低。

综合考虑,我们需要在模型的偏差和方差之间取得平衡,选择一个合适的k值以获得最佳的分类性能。在实际应用中,我们可以通过交叉验证等方法来选择最优的k值,以确保模型具有良好的泛化能力和预测性能。ROC曲线和PR曲线在评估分类模型性能时有着不同的特点和应用场景,我们可以根据具体问题的需求和数据分布选择合适的曲线进行评估,更全面地了解模型的性能表现。

四、实验总结

模型评估在机器学习中至关重要。模型评估可以帮助我们了解模型的性能如何,指导我们对模型进行改进和优化。通过模型评估,我们可以确定模型的准确性、泛化能力和稳定性,以及是否存在过拟合或欠拟合等问题,常用的评估指标包括准确率、精确率、召回率等。另外,对于不同类型的问题,还可以采用不同的评估方法,如P-R曲线、ROC曲线、混淆矩阵等。综上所述,模型评估在机器学习中是至关重要的,可以帮助我们提高模型的性能和效果。

570

570

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?