RAG

LLM存在一些问题,如知识的时效性,专业性以及定制化成本很高。

对此存在两种解决方案:

对于前者相当于建立一个额外的知识库,在使用时将我们的额外知识库和用户的提问一起输入给大模型,好处是成本低,不用额外的训练,并且知识库可以进行实时更新,但是问题是受模型能力受限,而后者可以提升模型的能力,但是成本要高。并且无法实时更新。

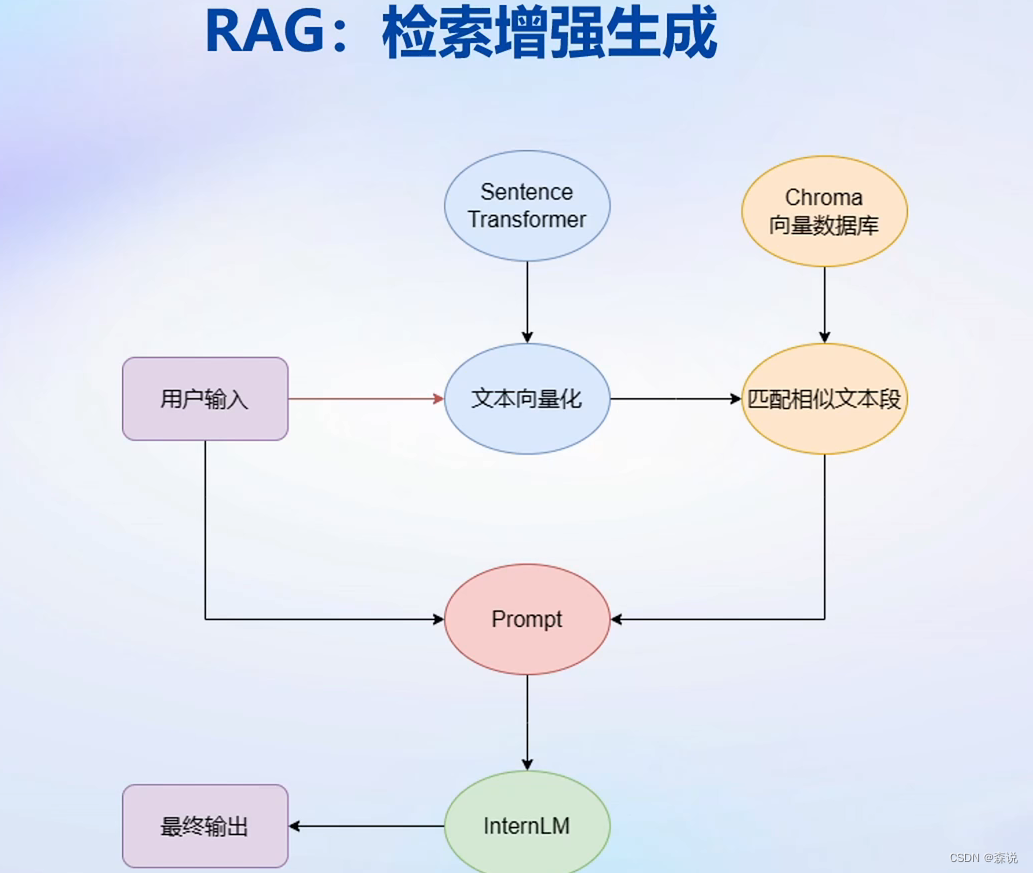

从上面这个图也可以看出RAG的工作流程,首先使用词向量模型sentence transformer将用户输入进行文本向量化,之后与向量数据库进行匹配得到相似的文本段,之后和用户输入一起输入到大模型中。

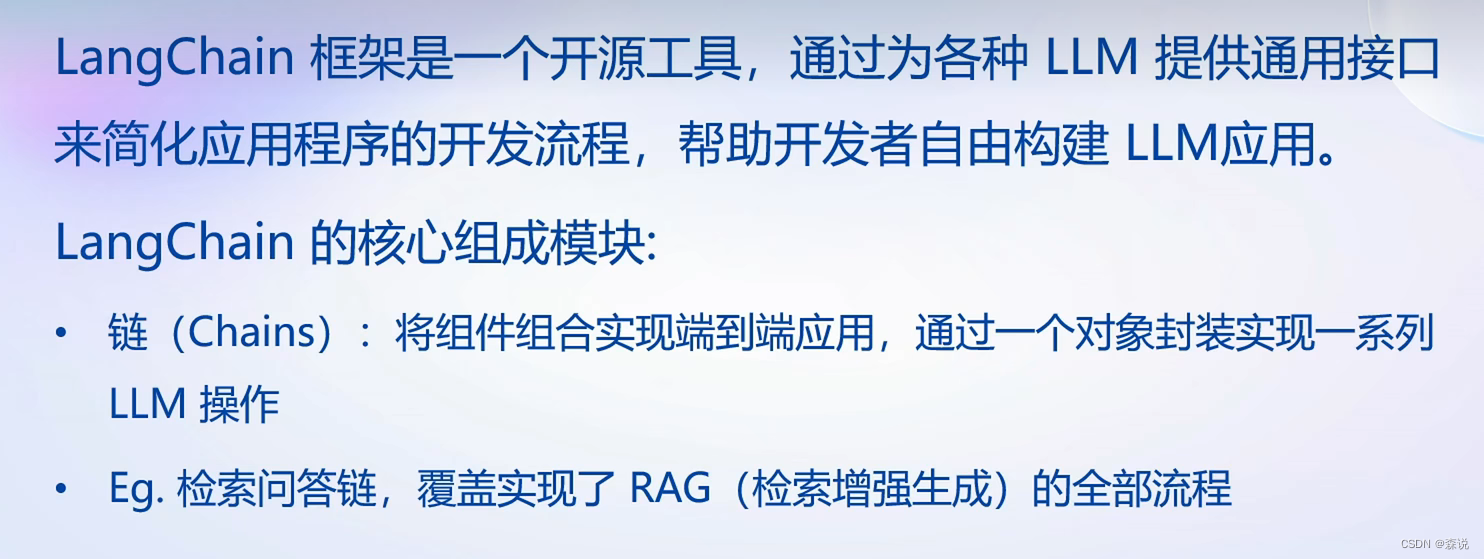

LangChain

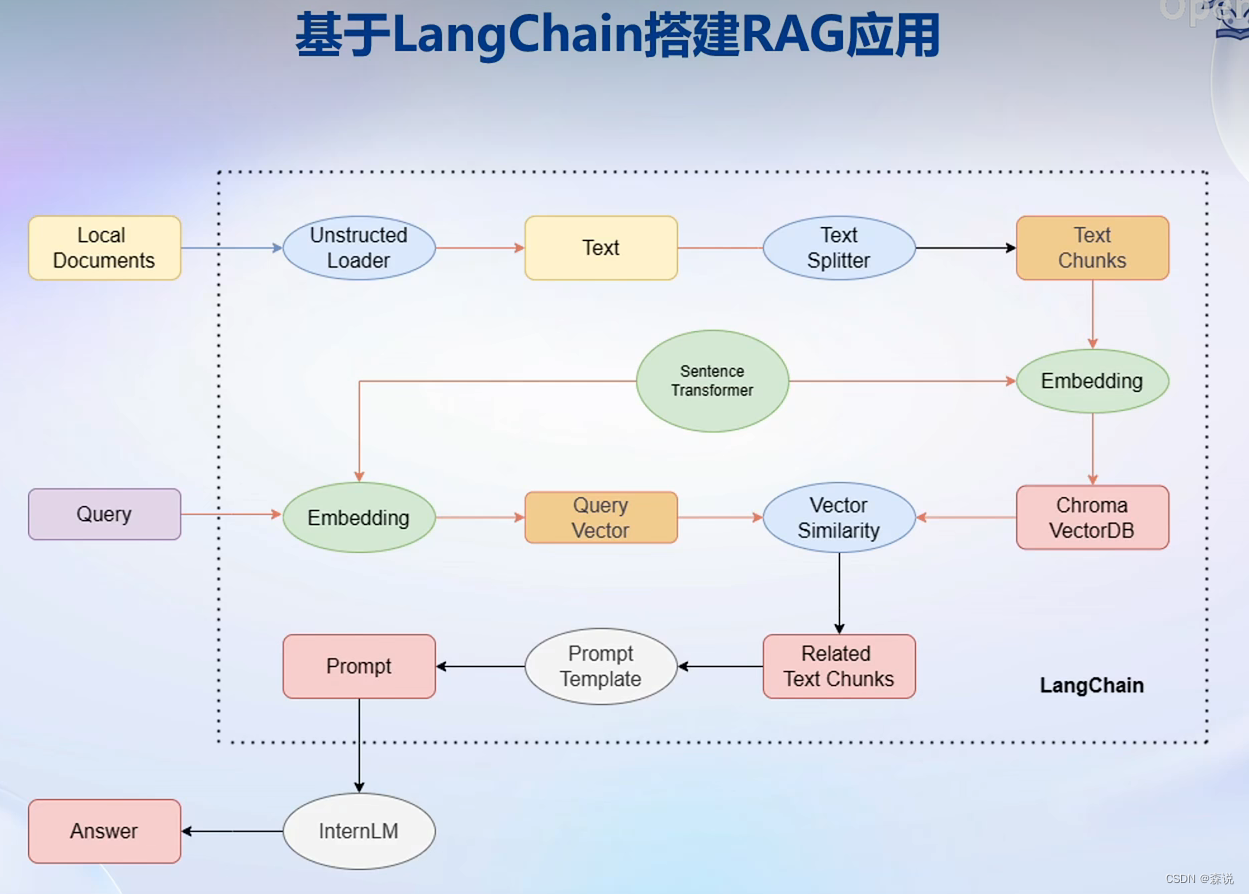

在上图中我们首先要对不同类型的文档进行字符串提取,之后因为大模型的上下文是有限制的,所以要对要对这些提取到的字符串进行分块,再之后就是将其进行向量化,就和上面的差不多了。

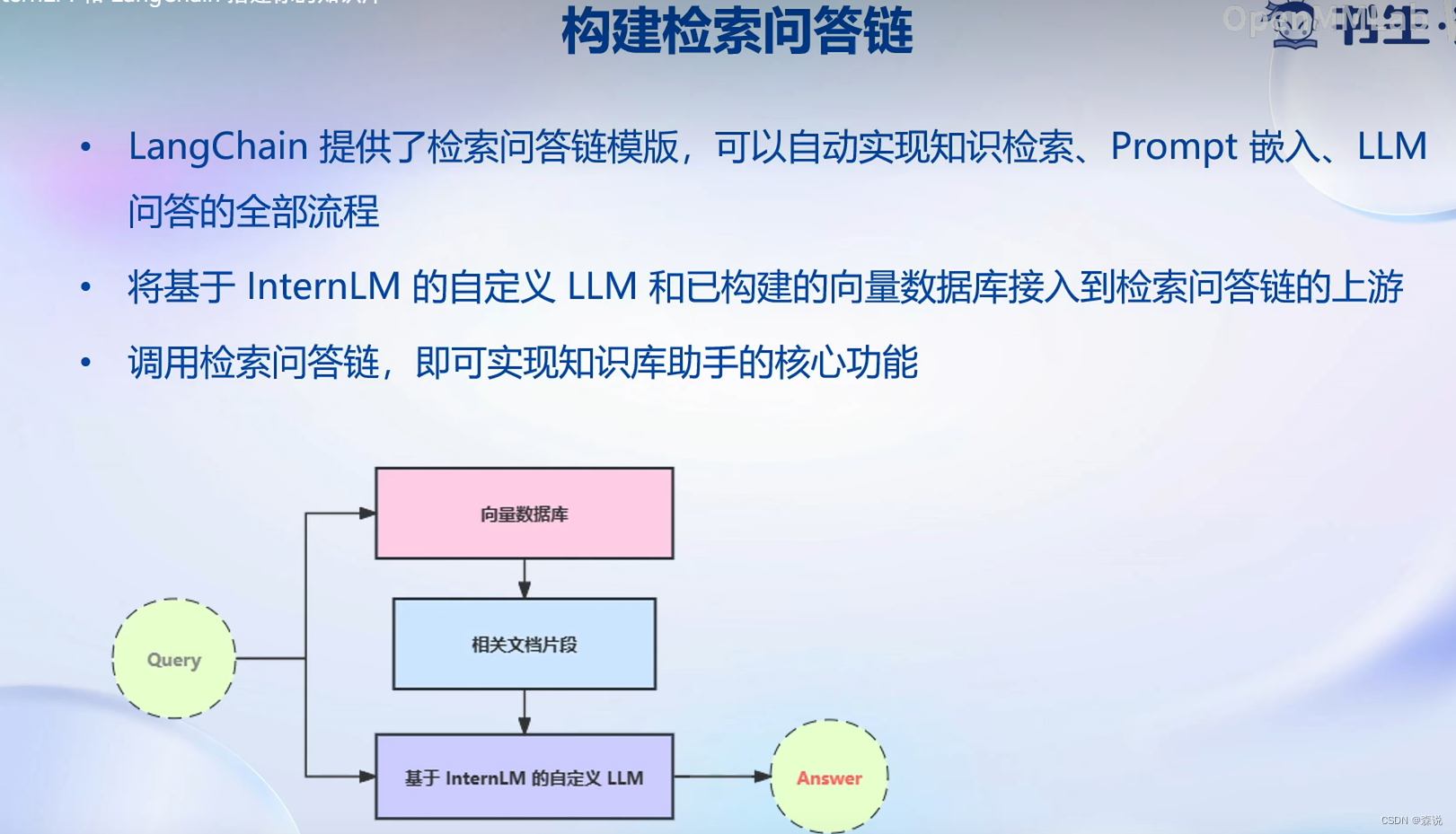

构建检索向量问答链

检索向量问答链是这个库的核心使用,使用这个功能我们可以很快的进行应用的开发。

86

86

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?