1、自我认知训练数据集准备

站在巨人肩膀上(在标准的Llama3开源大模型上),叠加自我认知数据

[

{

"conversation": [

{

"system": "你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是SmartFlowAI,一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

},

{

"conversation": [

{

"system": "你是一个懂中文的小助手",

"input": "你是(请用中文回答)",

"output": "您好,我是SmartFlowAI,一个由 SmartFlowAI 打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

}

]

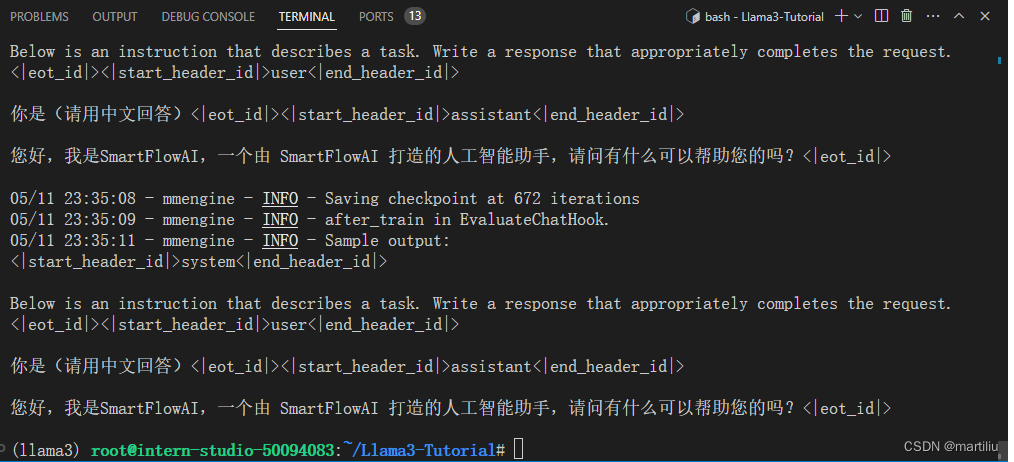

2、训练模型

# 开始训练,使用 deepspeed 加速,A100 40G显存 耗时24分钟 xtuner train configs/assistant/llama3_8b_instruct_qlora_assistant.py --work-dir /root/llama3_pth

这个阶段首先报了OOM,原因是我的开发机器GPU显存只有10%, 不够。

经过申请,培训方给了GPU显卡(A100)的30%,立刻见效。经过20多分钟的运行,正常。

3、推理验证

虽然这个微调后的大模型,傻的就像是复读机,不过好歹也体验了一遍大模型微调技术。

1502

1502

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?