先明确数据指标出现异常:上升或下跌,通常有以下情况

1.一次性波动:只在某个时间节点发生波动。原因一般是短期或突发事件。

2.周期性波动:周期性发生上升/下跌,比如双十一,周末,季节性因素等。

3.持续性波动:从某个时间开始,一直出现上升/下降趋势。持续性上升/下跌背后原因往往都是深层次的,比如用户需求转移,渠道投放长期暂停,大环境等因素,导致出现持续性的。

如果是数据指标下跌的话,周期性下跌一般都不需要做特殊处理;一次性下跌往往比较突然,要关注事件的持续性;持续性下跌的,特别是不见好转,持续的时间越长问题越严重

注:不要只看日周月报表中的趋势图走势,要结合波动的幅度去看-幅度越大,异常问题越严重

在一定时间内引起数据指标异常可能存在多种原因,主要关注数据指标的起点、拐点、终点。

起点:数据指标刚下跌时,发生了什么事件

拐点:在指标持续下跌过程中,是否某个事件的出现,让问题变得更严重,或者开始转暖。拐点意味着,这是可以通过运营手段改善指标的

终点:当某个事件结束后,指标恢复正常(等问题自己过去)。或当开始某个事件后,指标下跌结束(主动出击解决问题)

处理异常数据前,要明确

1.业务理解

2.指标口径

3.当前数据产生过程

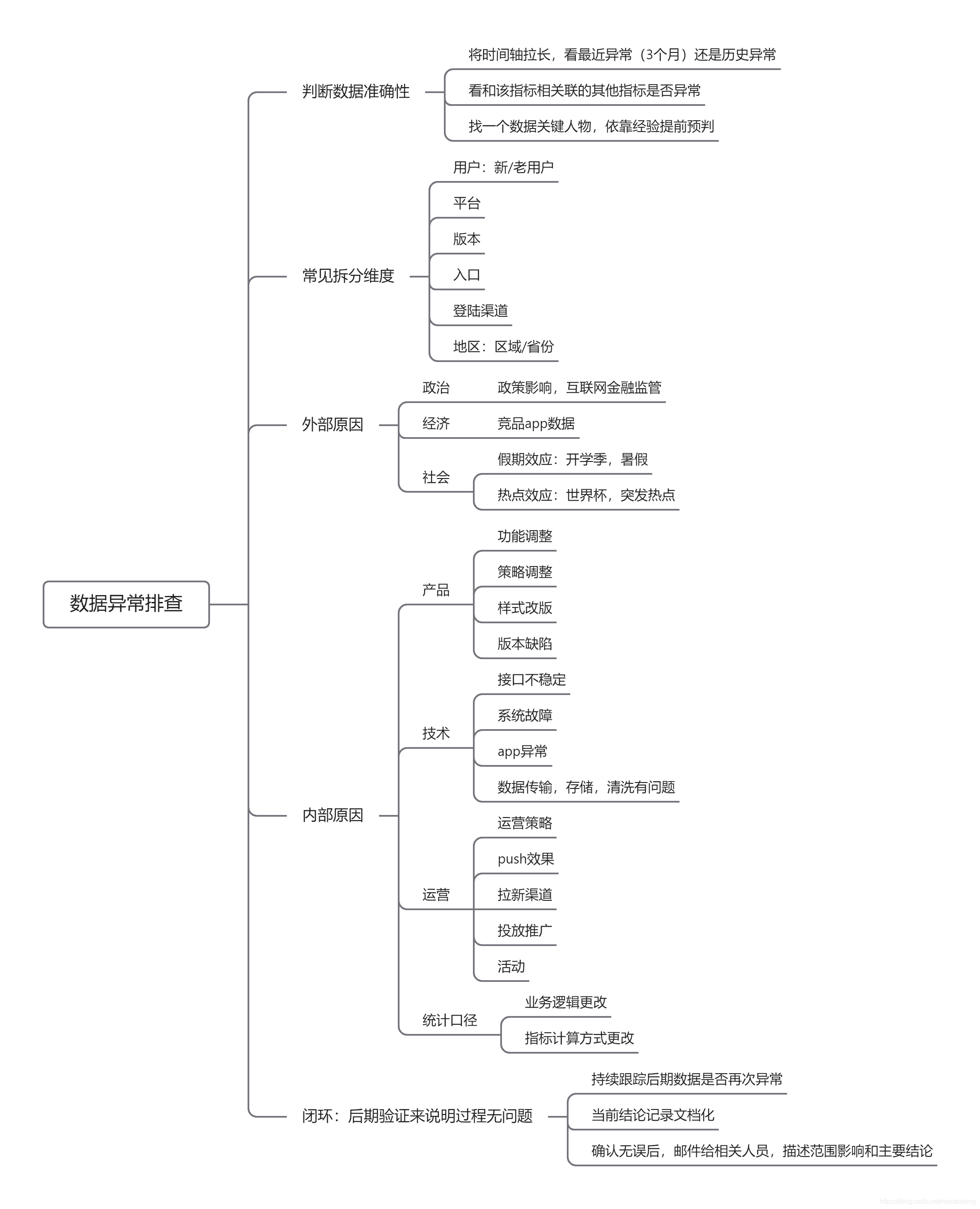

排查数据异常的步骤

1.判断数据是否异常:看数据指标是否是周期性异常,异常情况的严重性,数据是否准确

(1.亲自看数据数据准确性;2.将时间轴拉长,看最近异常(3个月)还是历史异常;3.看和该指标相关联的其他指标是否异常;4.找一个数据关键人物,依靠经验提前预判)

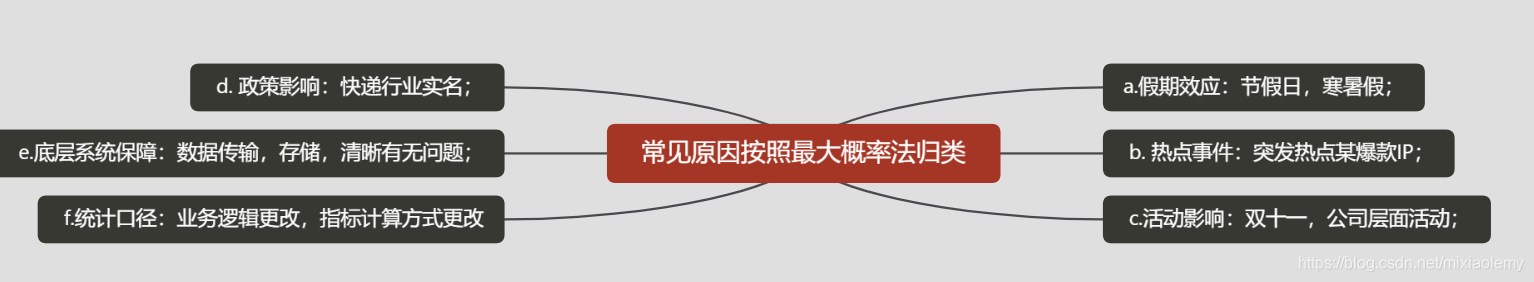

2.最大概率法则归类:造成数据异常的原因有多个,按照概率大小依次排查

(a.假期效应:节假日,寒暑假; b. 热点事件:突发热点某爆款IP; c.活动影响:双十一,公司层面活动; d. 政策影响:快递行业实名; e.底层系统保障:数据传输,存储,清晰有无问题; f.统计口径:业务逻辑更改,指标计算方式更改)

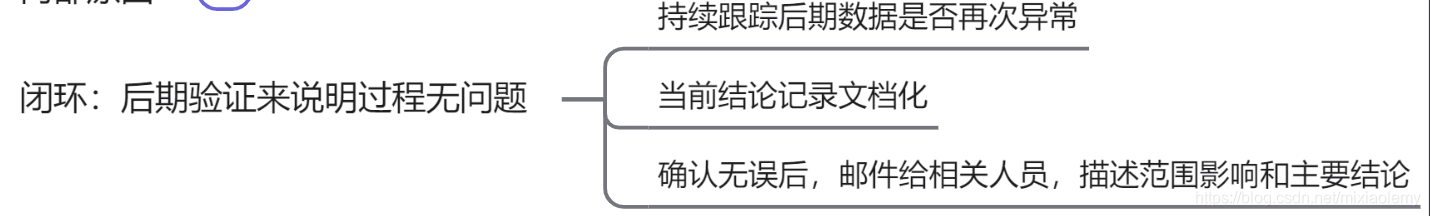

3.闭环:只有通过后期验证,才能说明整个过程没有问题

(a.持续跟踪后期数据是否再次异常 b.记录沉淀,文档化 c.邮件告知,描述原因和主要结论)

例子:DAU指标异常波动(下降)

针对数据异常类问题,可参考如下分析框架:

1.确认数据真实性

2.利用数据验证对数据异常作出假设

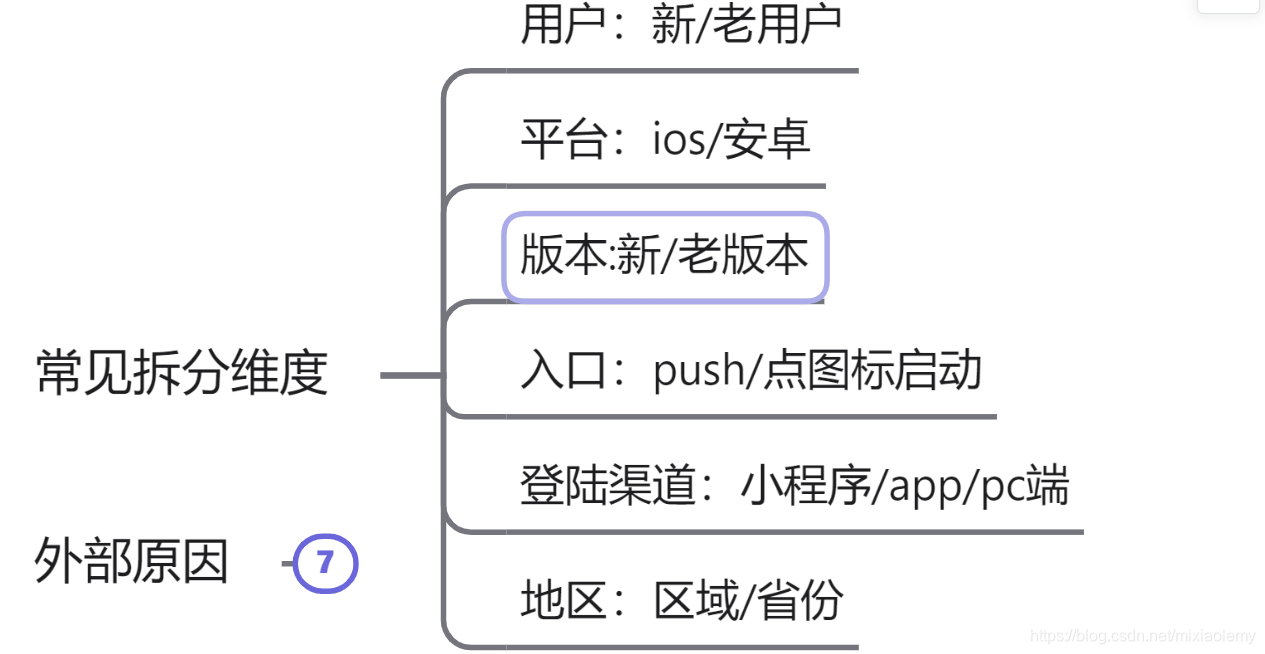

3.常见拆分维度

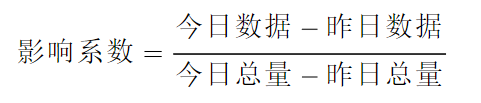

根据以上维度拆分之后,每项数据都需要和历史数据做对比,计算影响系数

影响系数越大,说明此处为主要原因所在。

4.后期验证

整个的分析流程是先确认数据的准确性-----然后对数据异常作出假设----从不同维度进行拆解,找到异常范围----最后验证说明过程无问题

3158

3158

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?