上周,我在Connected Data London上就Octavian开发的方法发表了演讲,使用神经网络在知识图上执行任务。

这是来自Connected Data London的演讲录音:

在这篇文章中,我将总结那篇演讲(包括大部分幻灯片)并提供对我们影响最大的论文的链接。

要了解有关构建下一代数据库查询引擎的新方法的更多信息, 请参阅我们最近的文章 。

什么是图表?

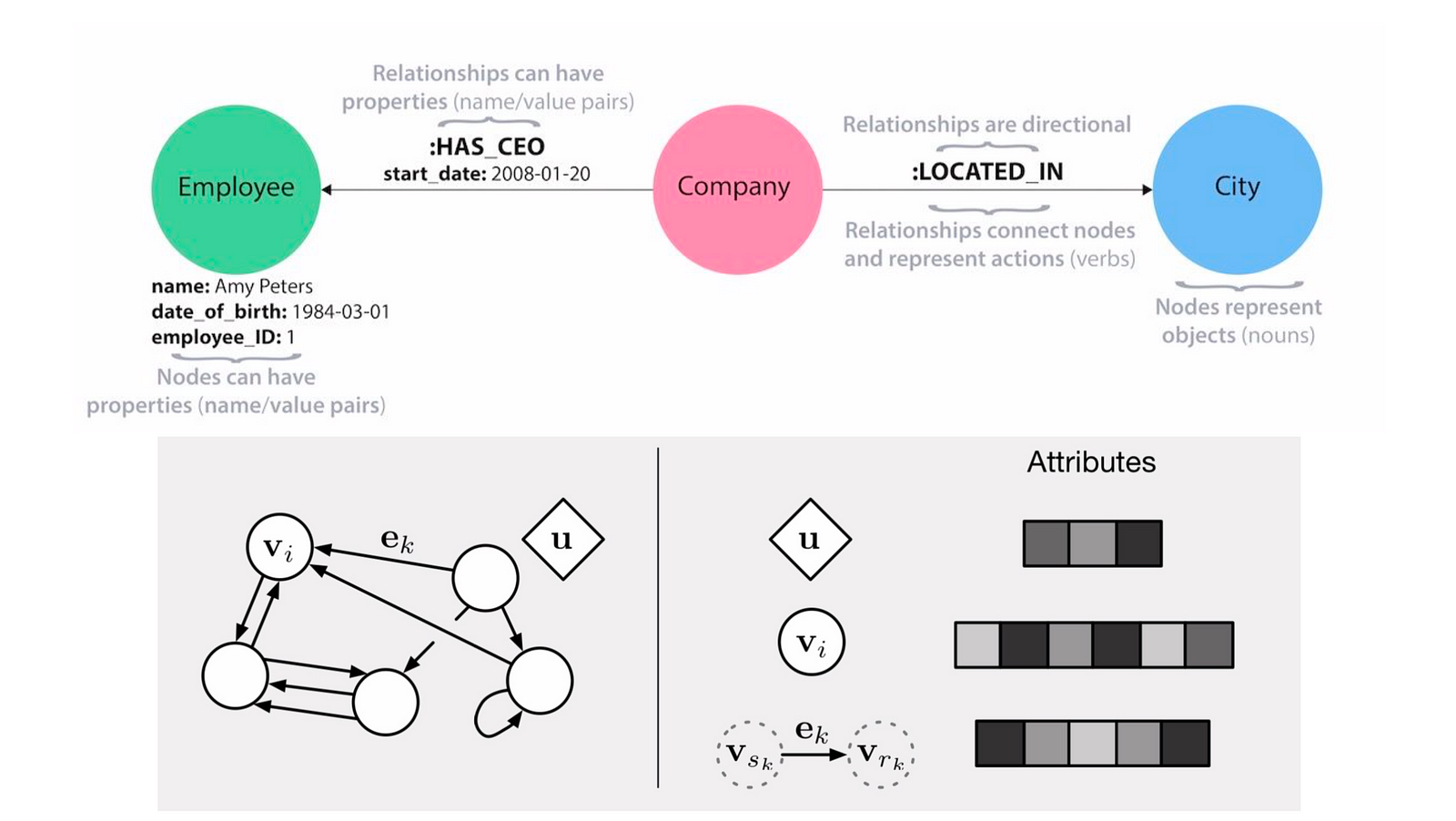

两个功能相同的图形模型

我们正在使用属性图或属性图模型。 节点(顶点)和关系(边)可以具有属性。 此外,我们的神经网络具有图表外部的全局状态。 幻灯片显示了这个模型的两个表示,一个来自Neo4j,另一个来自DeepMind(这些实际上是相同的)。

为什么我们对图表感兴趣?

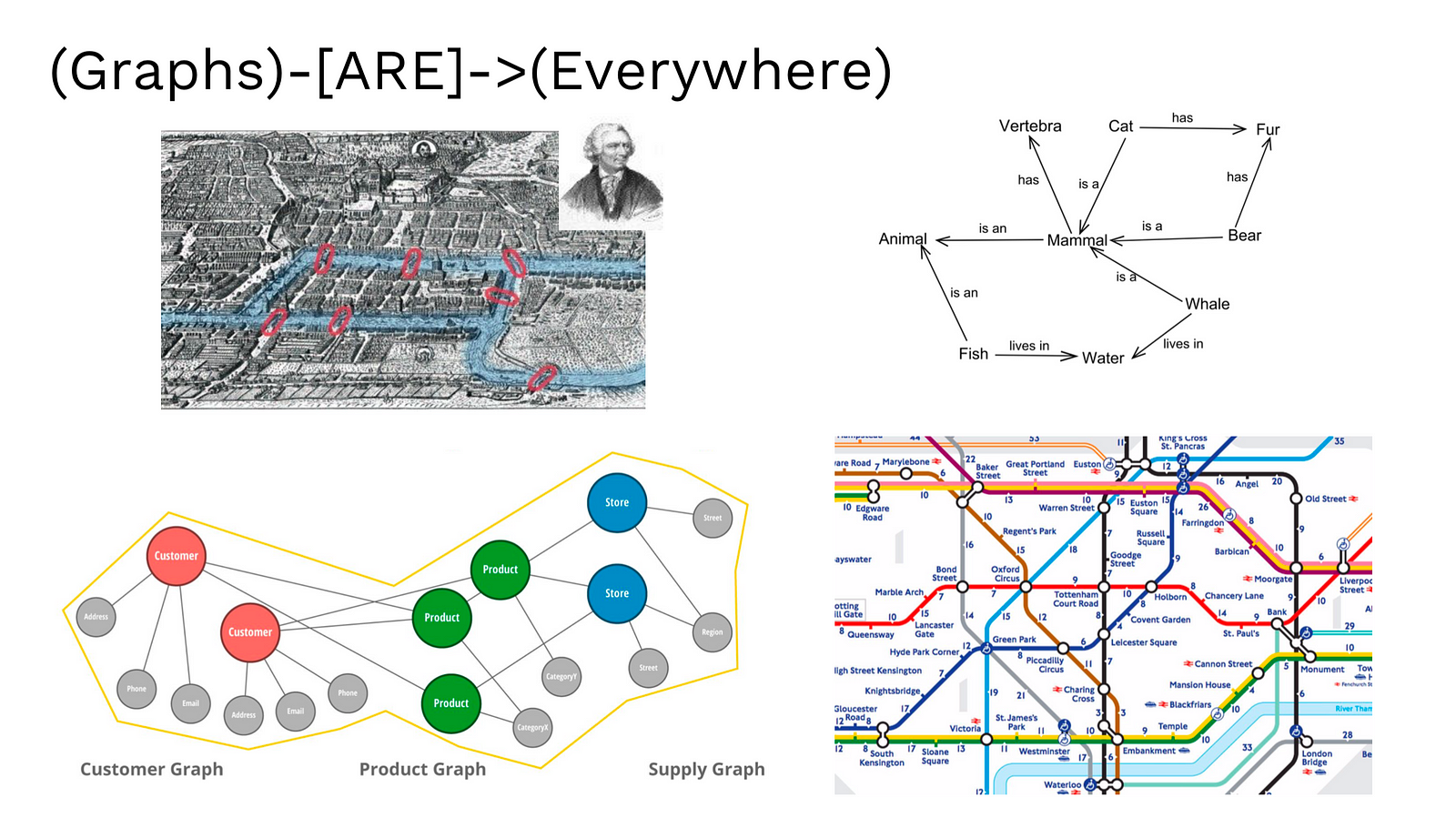

所有的图表!

图表具有丰富的历史,从18世纪的Leohnard Euler开始到今天的各种图表。 在计算机科学领域,有许多图形应用:图形数据库,知识图形,语义图形,计算图形,社交网络,传输图形等等。

图表在谷歌的崛起中发挥了关键作用(他们的第一个突破是使用PageRank为搜索提供动力,今天他们的知识图谱已经变得越来越重要)和Facebook。 从政治到低成本的国际航空旅行,图算法对我们的世界产生了重大影响。

什么是深度学习?

我不确定AI让我们谈论深度学习......

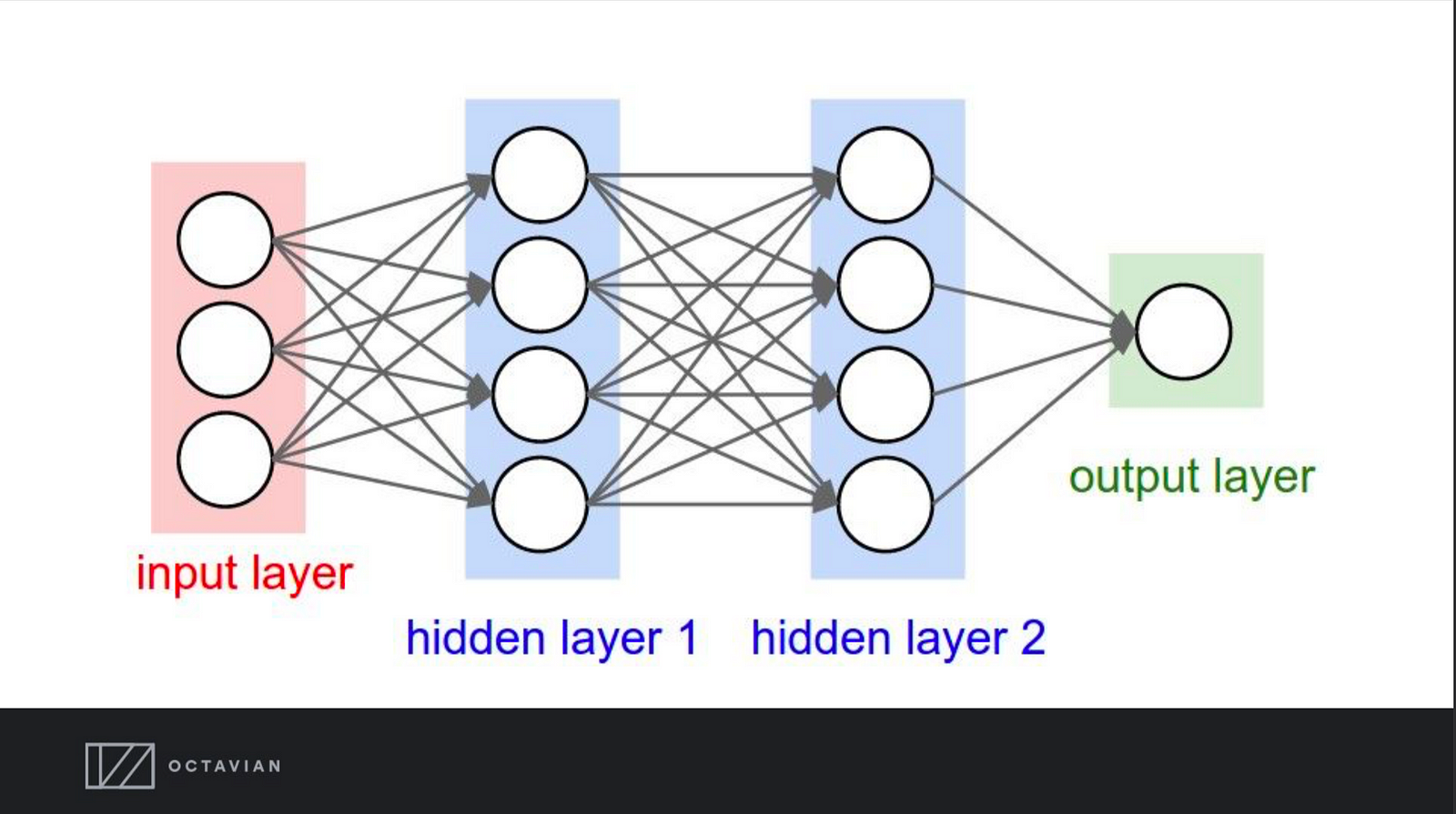

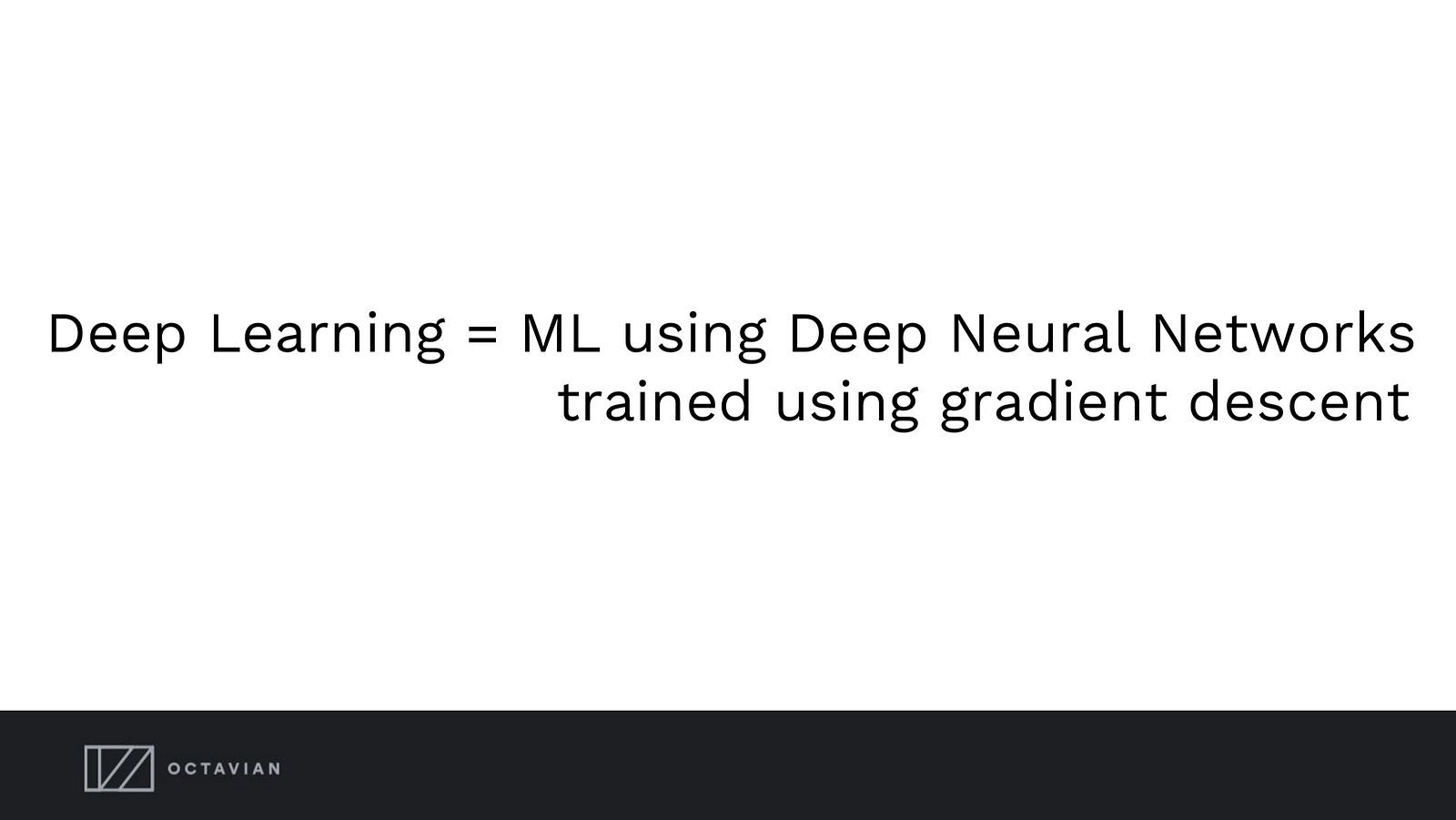

深度学习是以使用梯度下降训练多层(“深层”)神经网络为中心的机器学习的一个分支。 这些神经网络的基本构建块是密集(或完全连接)的网络。

使用密集层的深度神经网络

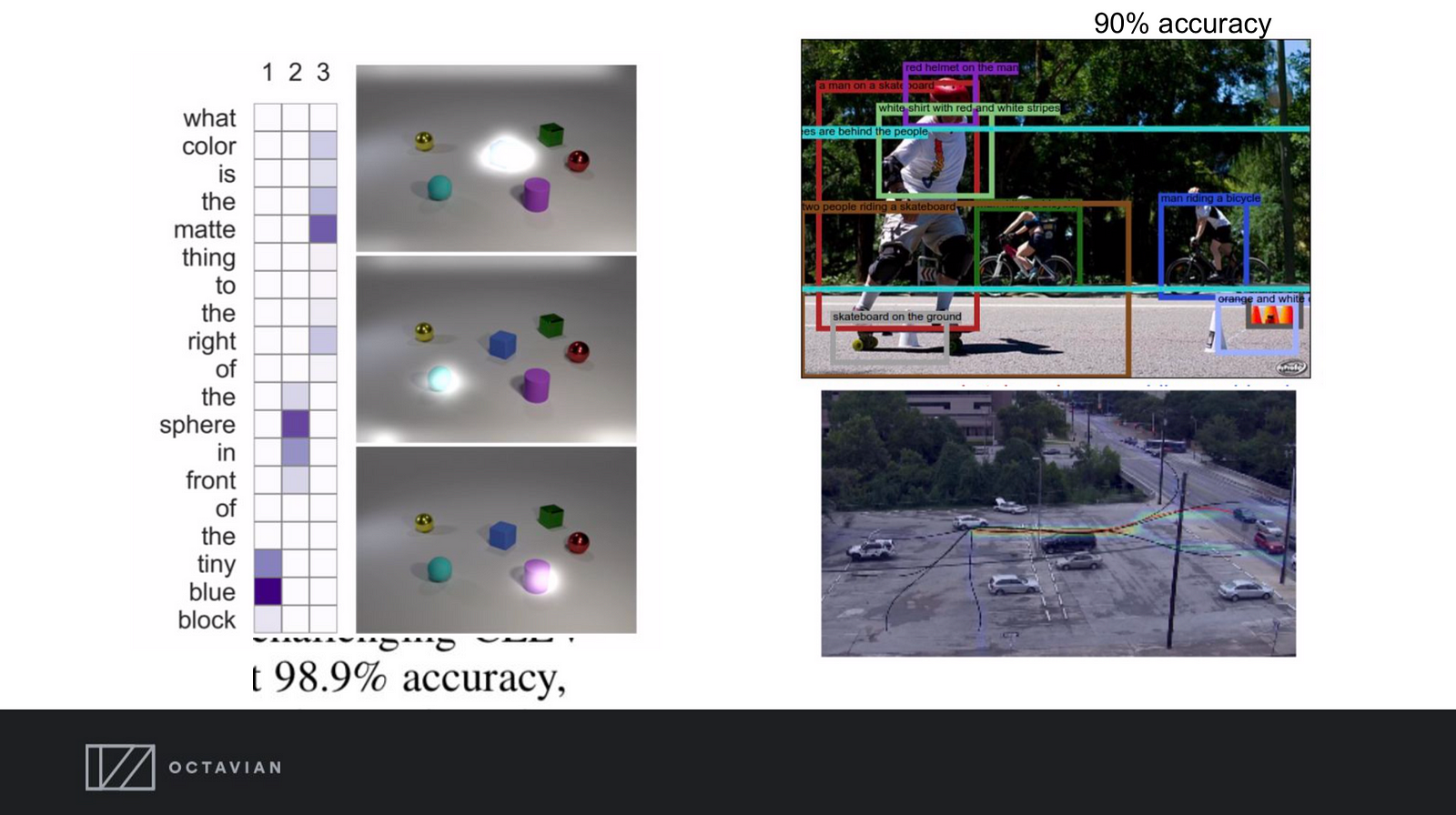

使用深度学习使我们能够训练计算机来解决一系列先前具有挑战性的任务,从玩Go到具有超人表现的图像识别。

MacNets和其他超人图像处理神经网络的例子

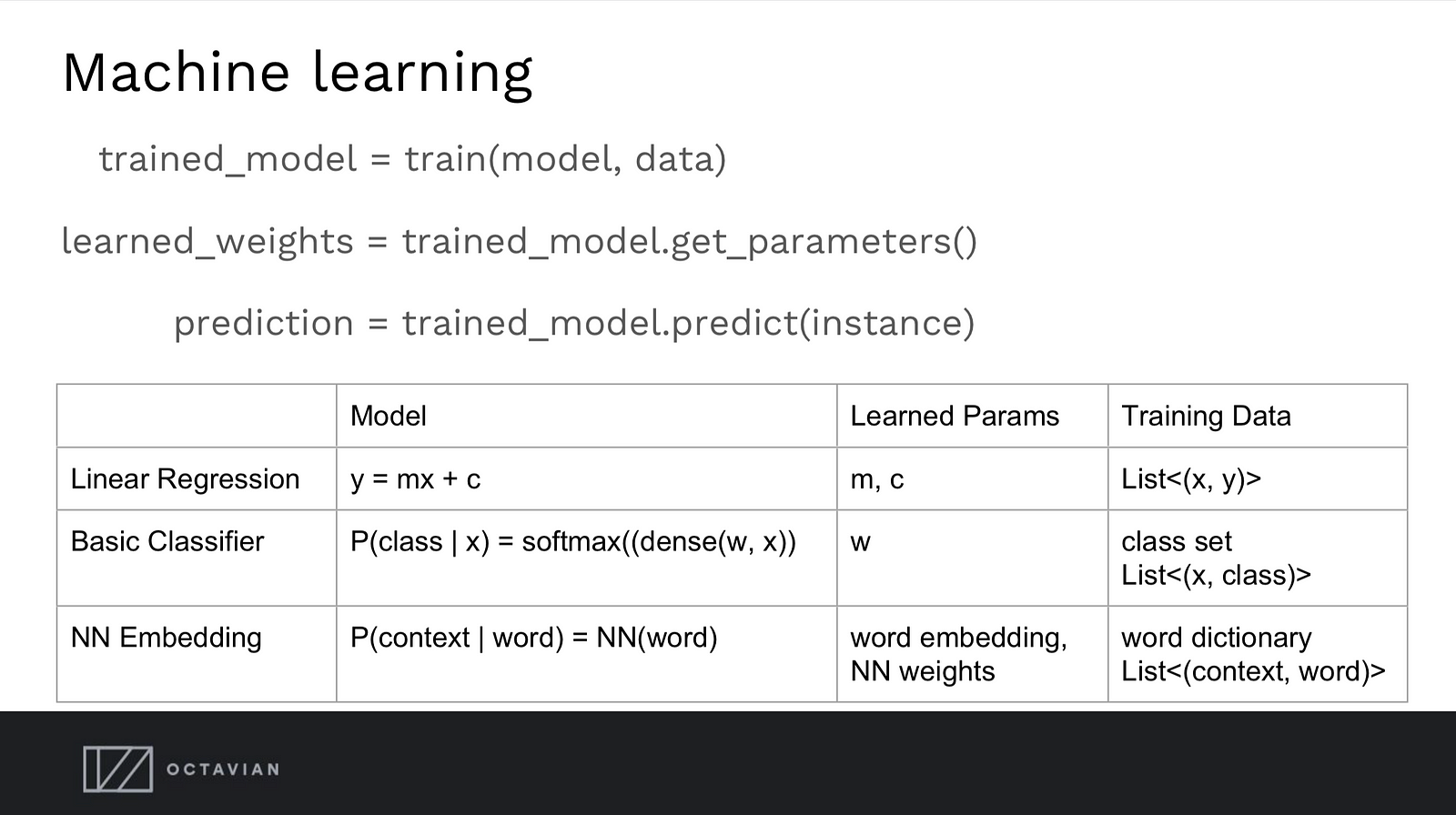

机器学习

通常,机器学习是一个简单的概念。 我们创建了一个我们认为事物如何运作的模型,例如y = mx + c这可能是:

house_price = m•number_of_bedrooms + c

机器学习,从20,000英尺的视图

我们使用我们拥有的数据训练(拟合)模型的参数(示例中的m和c )。 一旦我们的训练完成,我们就有一些学习的参数值,我们有一个模型可以用来做出预测。

有时参数本身是有用的(例如,当我们使用神经网络训练单词嵌入时,例如word2vec)。

深度学习图表

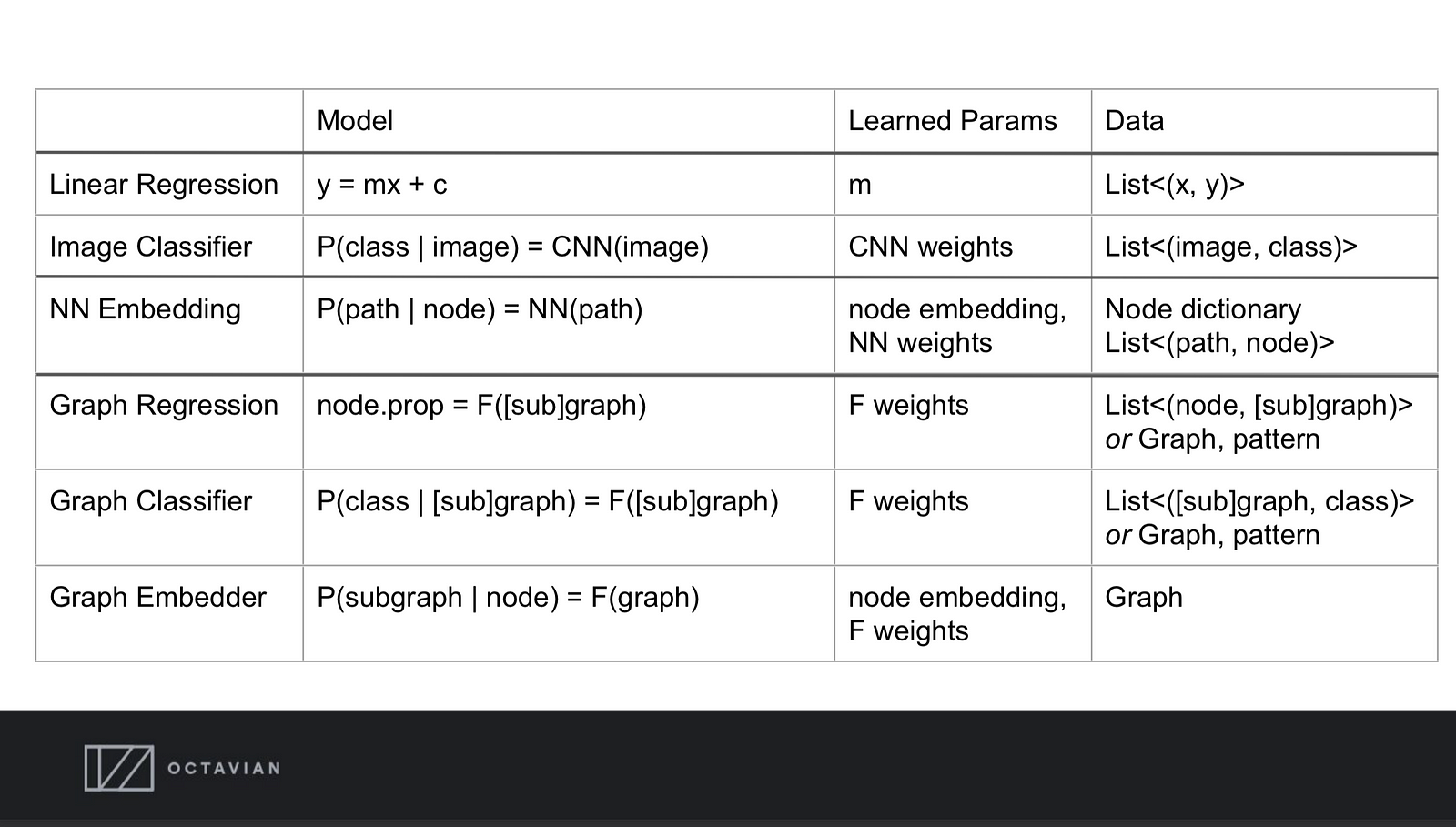

在Octavian,我们问自己的一个问题是:我们如何从20,000英尺的高度看图表上的机器学习?

为了帮助回答这个问题,我们将传统形式的深度学习与图形学习的世界进行了比较:

比较图形机器学习与其他设置

我们确定了三个图形数据任务,我们认为这些任务需要图形原生实现: 回归 , 分类和嵌入 。

除此之外:还有其他特定于图表的任务,例如链接预测,这些任务不容易适合上述三个任务。

我们观察到许多用于图形上的机器学习的现有技术具有一些基本限制:

- 有些不适用于看不见的图形(因为它们需要首先训练图形嵌入)

- 有些人需要将图表转换为表格并丢弃其结构(例如,使用随机漫步从图表中采样)

现有工作

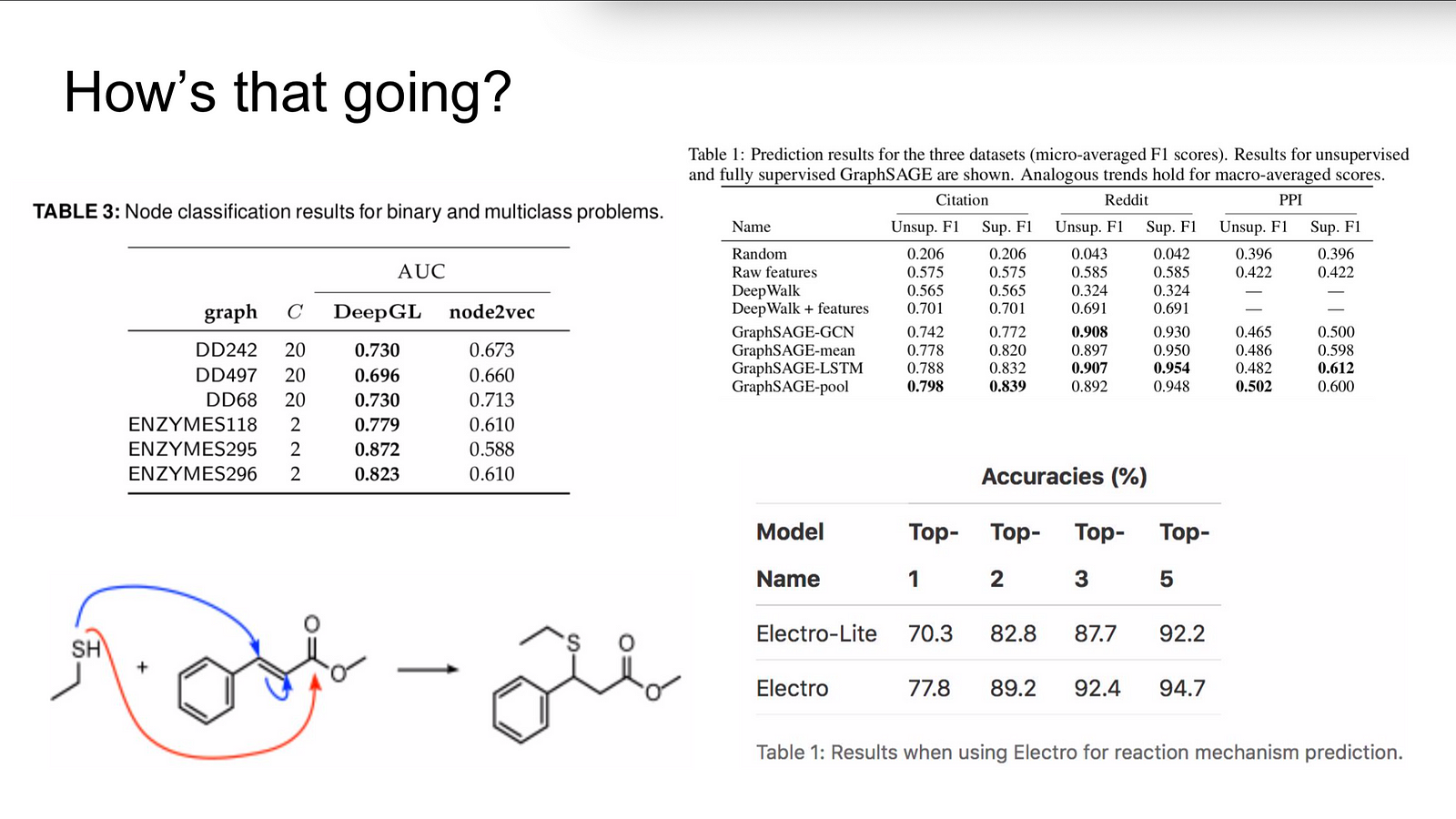

DL模型在图形问题上的表现并不是超人

在图表上使用深度学习的大部分现有工作集中在两个方面。

- 预测分子(包括蛋白质),它们的性质和反应。

- 大型静态图中的节点分类/分类。

图形,神经网络和结构原理

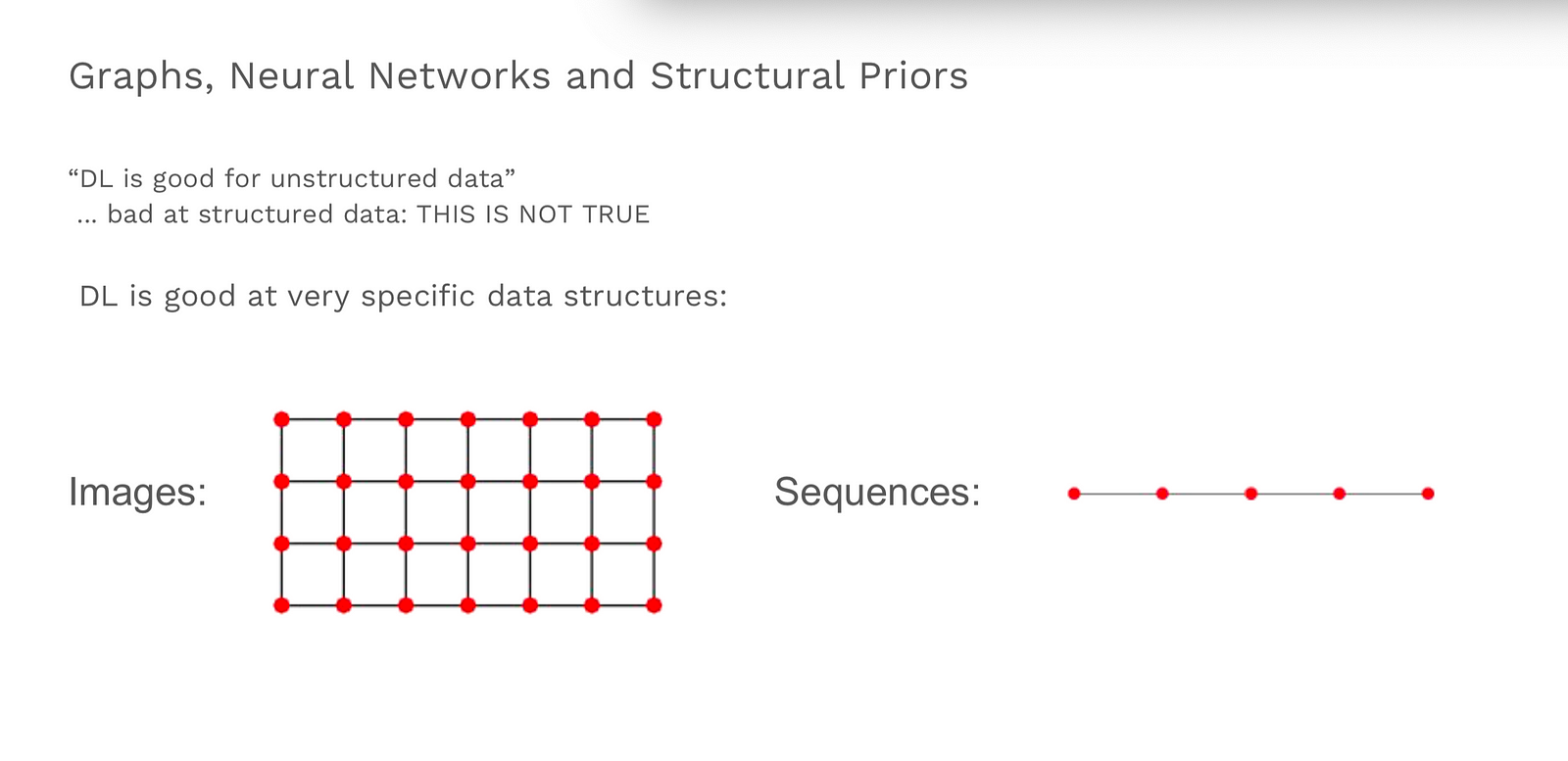

人们常说深度学习适用于非结构化数据 - 图像,自由文本,强化学习等。

但是我们的超人神经网络实际上处理的是非常具体的结构化信息,而神经网络架构的设计与其工作良好的信息结构相匹配。

与神经网络一起使用的数据结构

图像在某种意义上是结构化的:它们具有刚性的2D(或3D)结构,其中彼此接近的像素彼此更相关,而不是相距很远的像素。 序列(例如,随着时间的推移)具有一维结构,其中相邻的项目彼此之间的相关性比相距较远的项目更相关。

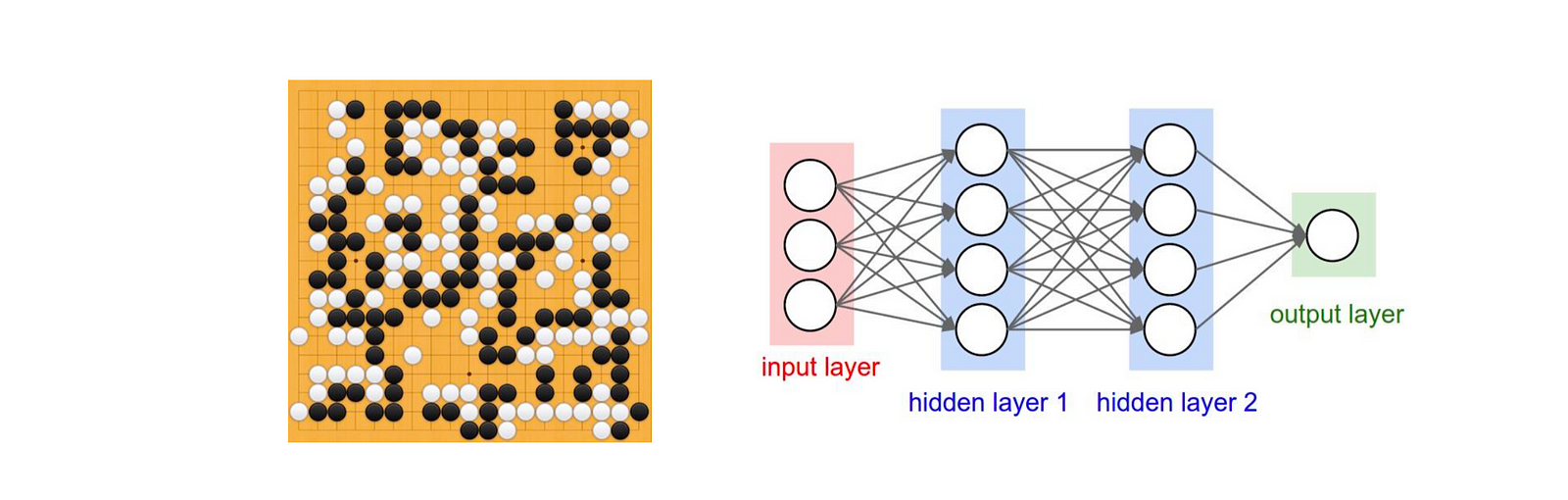

对于Go而言,密集层是有意义的,其中板上相隔很远的位置可以彼此具有相同的影响

处理图像和序列时,密集层(例如,每个输入连接到每个输出的位置)都不能很好地工作。 反映和利用输入介质结构的神经网络层可以获得最佳结果。

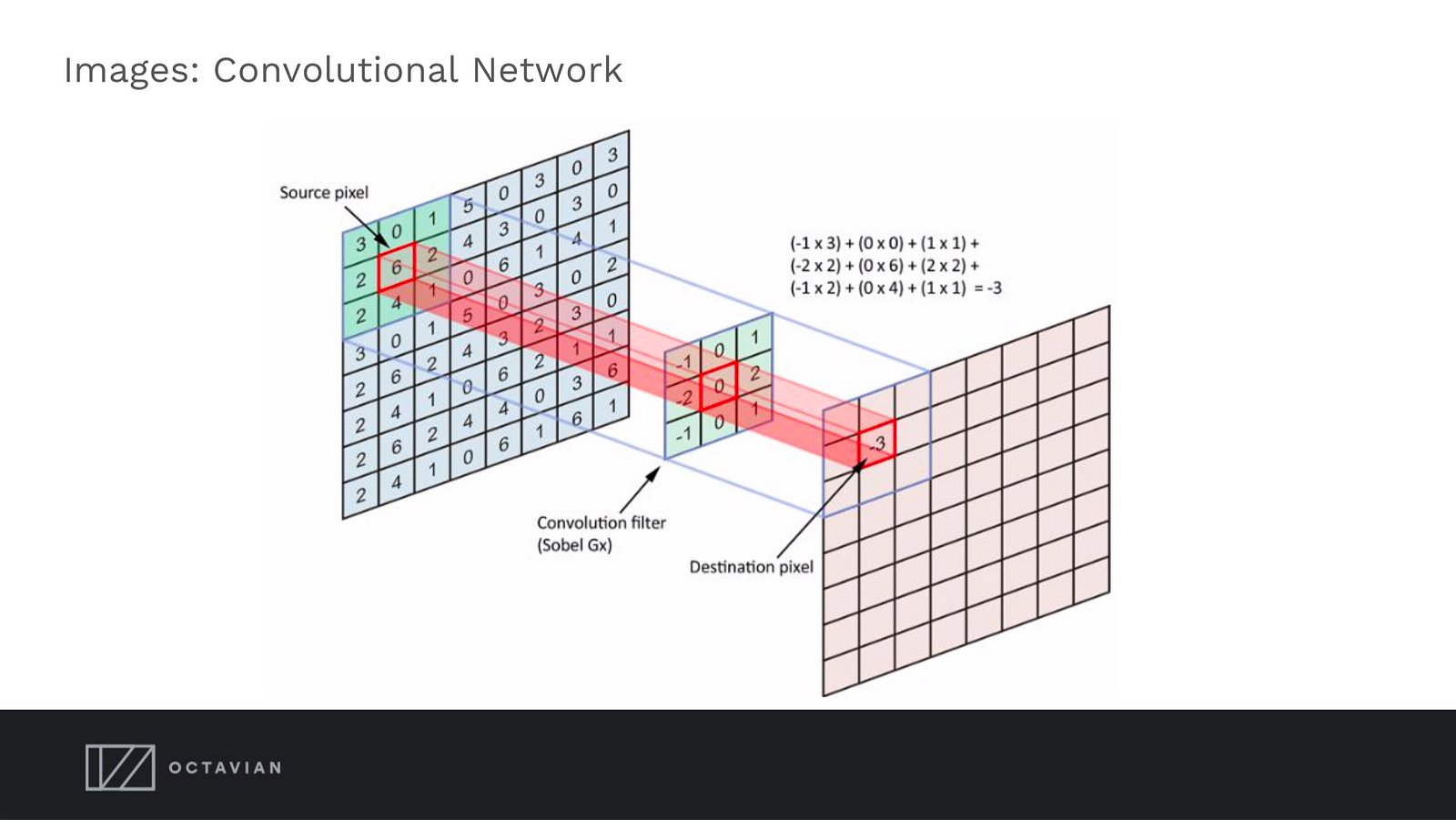

对于序列,使用递归神经网络(RNN)并且对于图像使用卷积神经网络(CNN)。

卷积网络在结构上编码彼此接近的像素比相距很远的像素更重要

在卷积神经网络中,隐藏层中的每个像素仅取决于输入中的一组邻近像素(将其与密集层相比较,其中每个隐藏层像素取决于每个输入像素)。

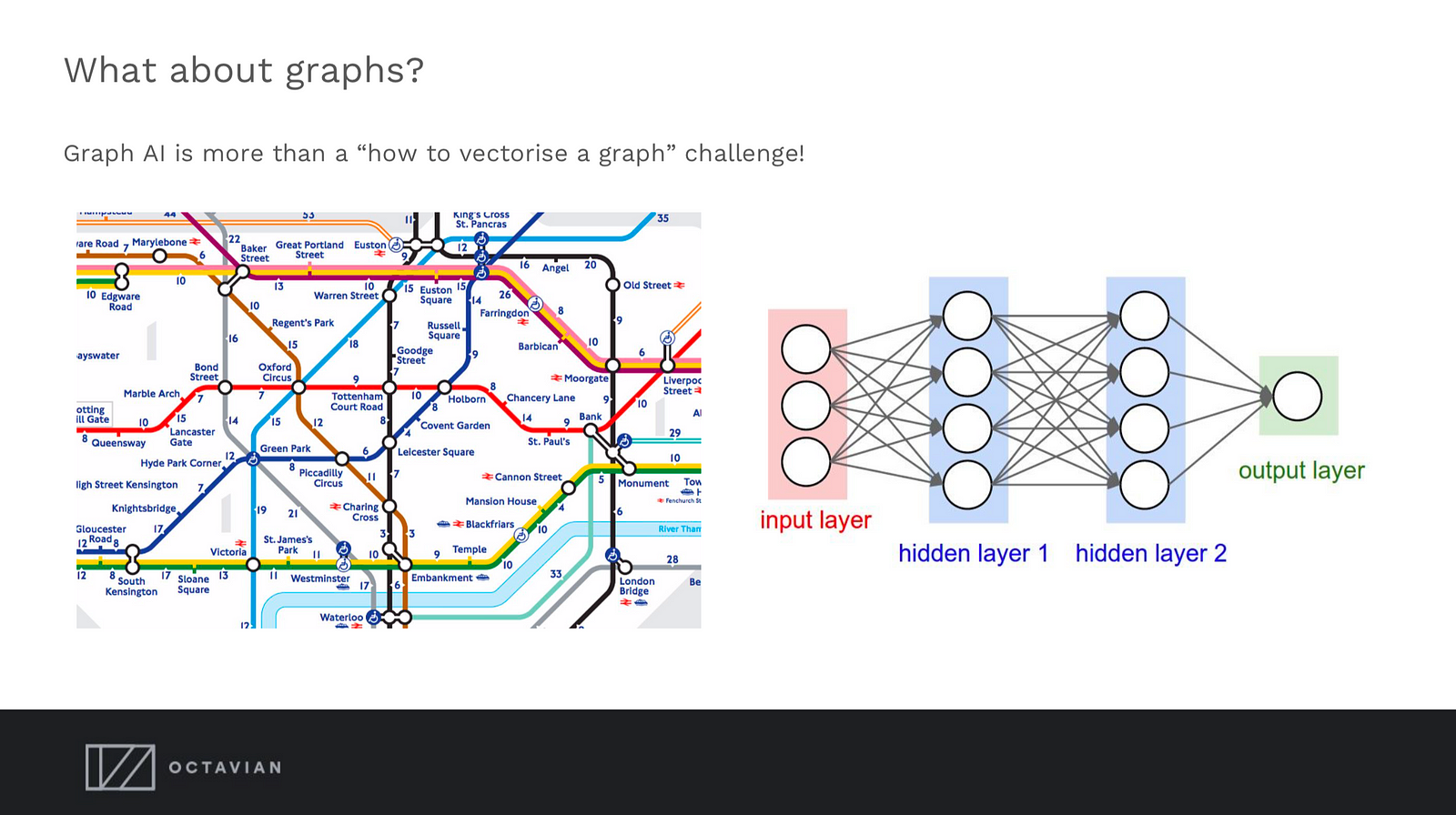

密集和卷积网络都不适用于传输图

图中的节点不具有固定关系,如图像中的附近像素或序列中的相邻项。 为了使图形深度学习成功,将图形转换为矩阵表示并将该输入放入现有的神经网络模型是不够的。 我们必须弄清楚如何创建适用于图形的神经网络模型。

本文比我更有效地提出相同的论点 - 检查出来 !

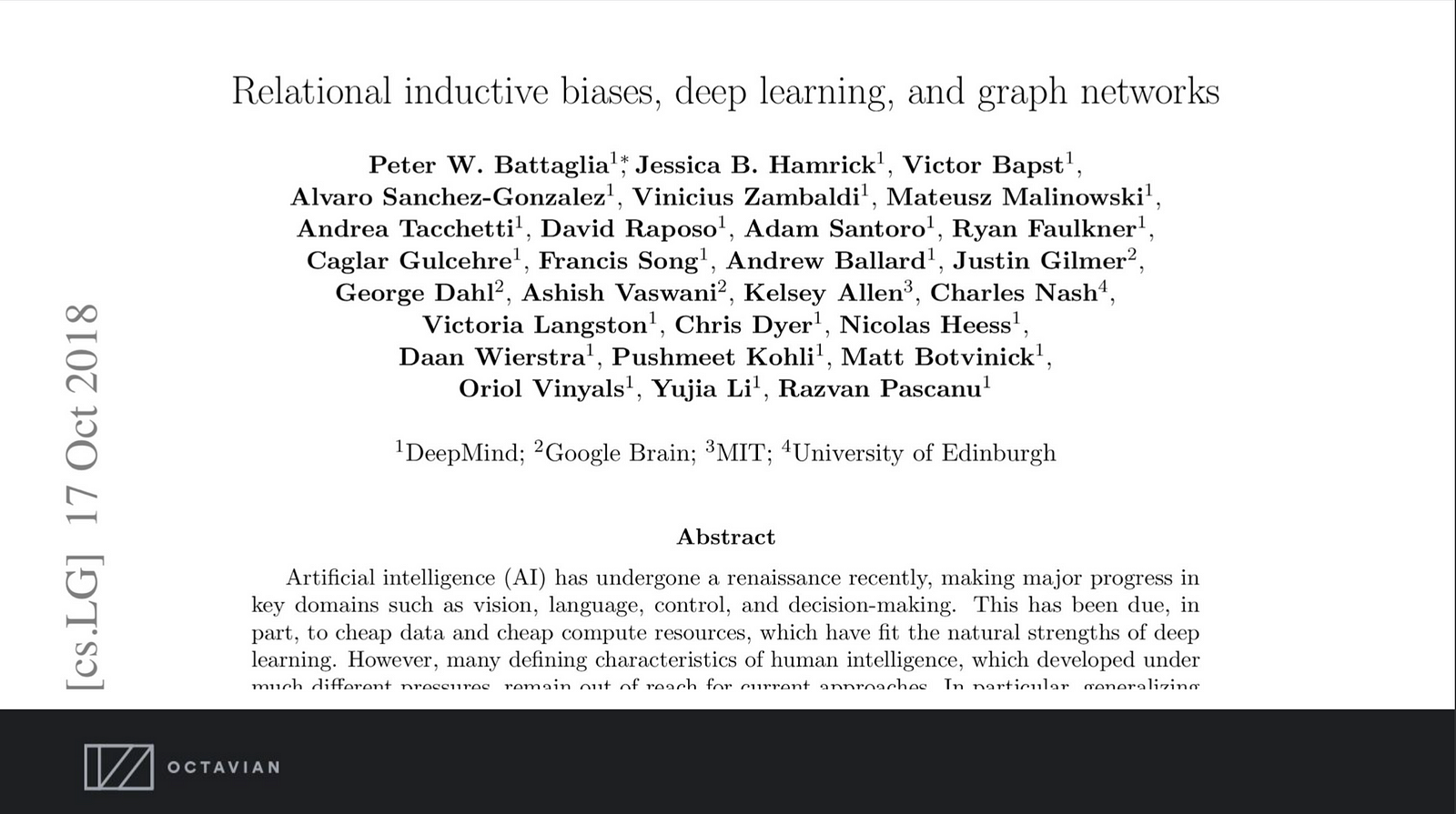

我们不是唯一想到这一点的人。 DeepMind,Google Brain,麻省理工学院和爱丁堡大学的一些非常聪明的人在关于关系归纳偏差的论文中提出了类似的立场。 我向有兴趣深入学习图表的人推荐这篇论文。

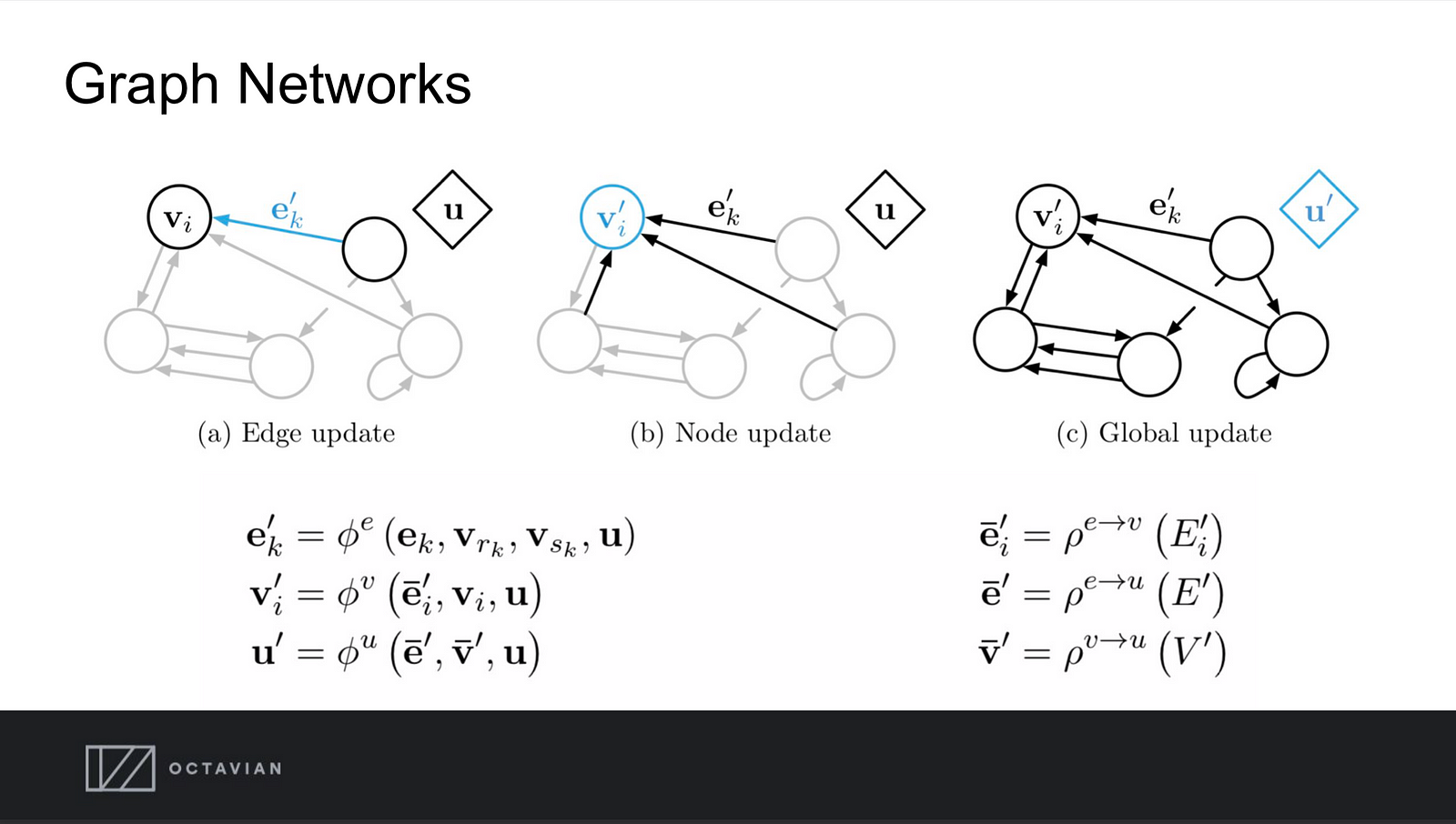

本文介绍了一种通过图形传播信息的通用算法,并认为通过使用神经网络学习六种函数来在图形结构内执行聚合和变换,它们可以在选择的图形任务上实现最先进的性能。

一种算法来统治它们吗?

通过主要使用图形边缘在节点之间传播信息,作者认为它们维持了图形结构中存在的关系归纳偏差。

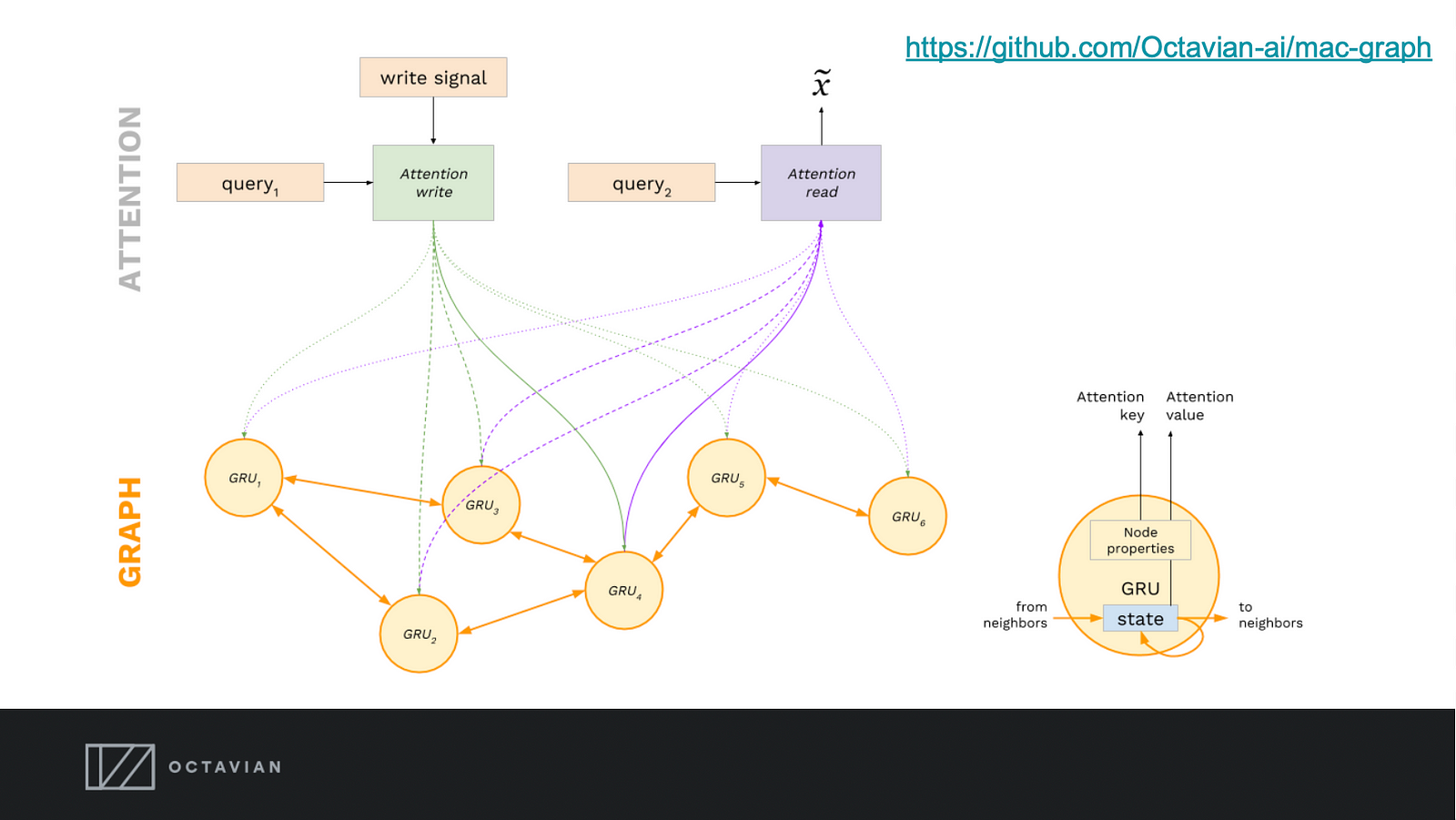

我们在Octavian开发的MacGraph神经网络架构与关系归纳偏差方法有相似之处。 它使用存在于图外部的全局状态,并在图节点之间传播信息

屋大维的实验结果

在我告诉你Octavian的结果之前,我必须提到我们用来测试神经图架构的任务。

我们的综合基准数据集

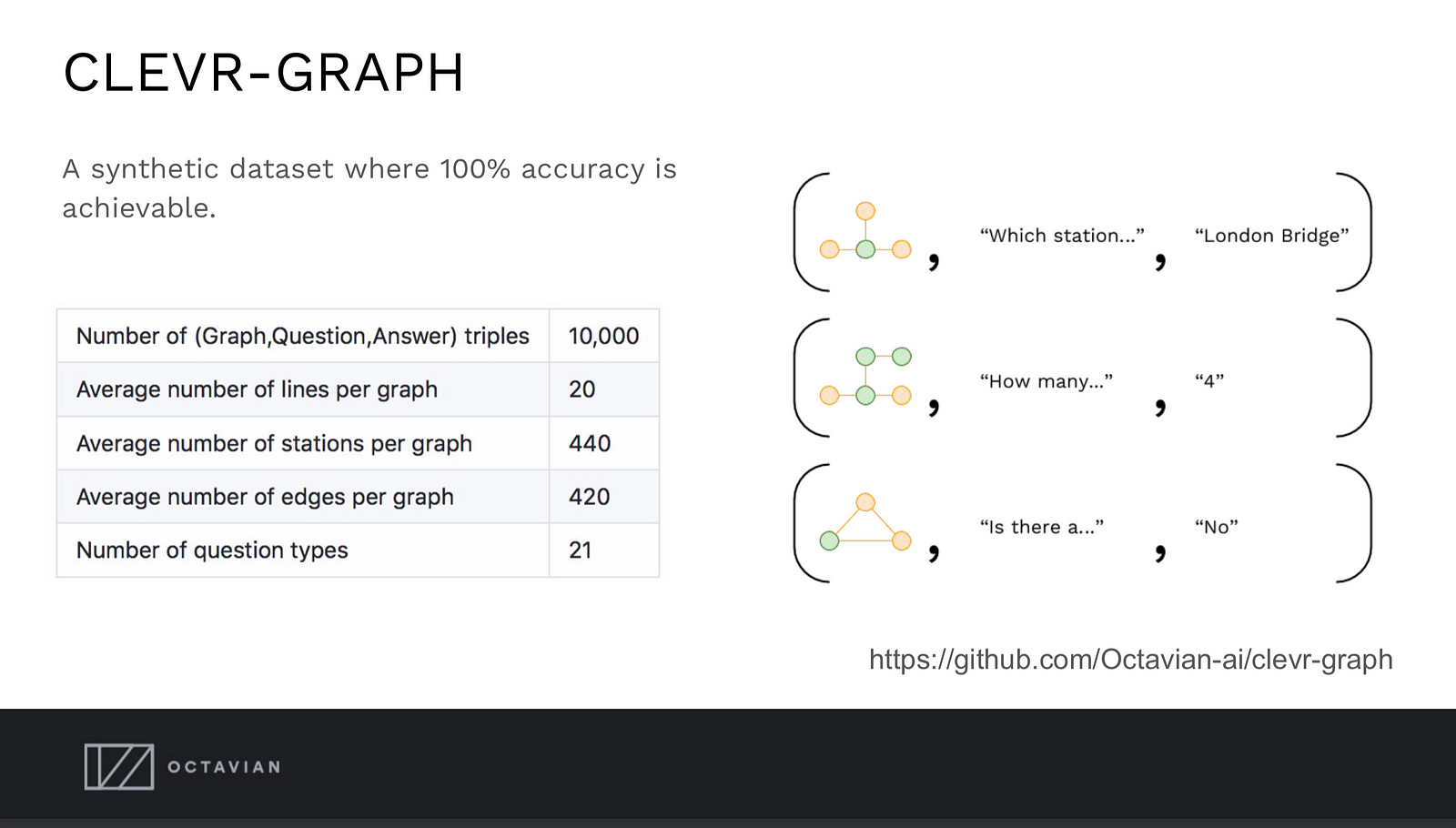

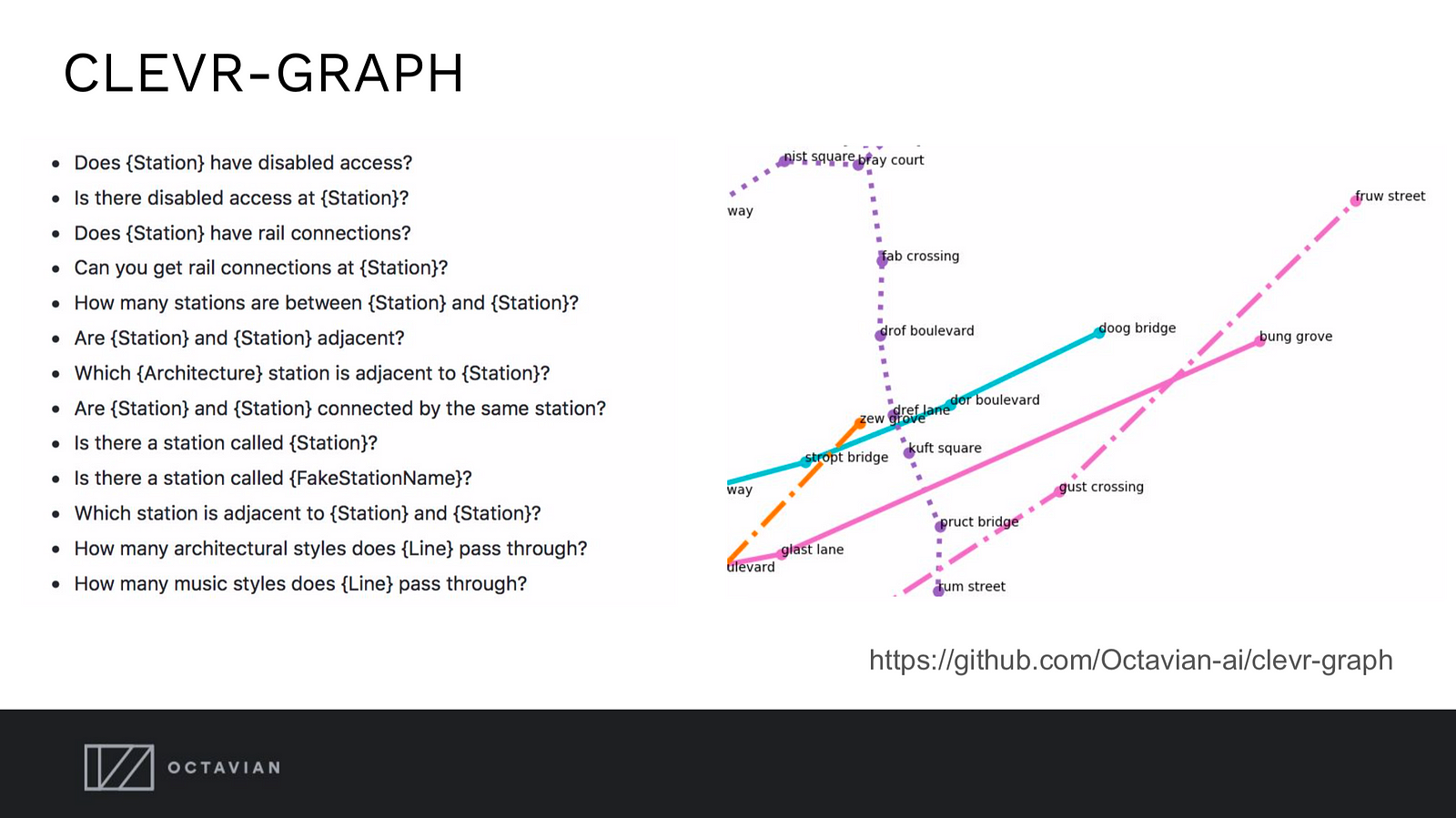

您可以在此处阅读有关CLEVR-Graph的更多信息 。 它是一个合成的(程序生成的)数据集,由在伦敦地下松散建模的10,000个虚构的运输网络组成。 对于每个随机生成的传输网络图,我们只有一个问题和正确的答案。

来自CLEVR-Ggraph问题库的一些示例问题和示例图

这项任务的关键是用于测试网络的每个图形是网络从未见过的图形。 因此,它无法记住问题的答案,但必须学习如何从新图表中提取答案。

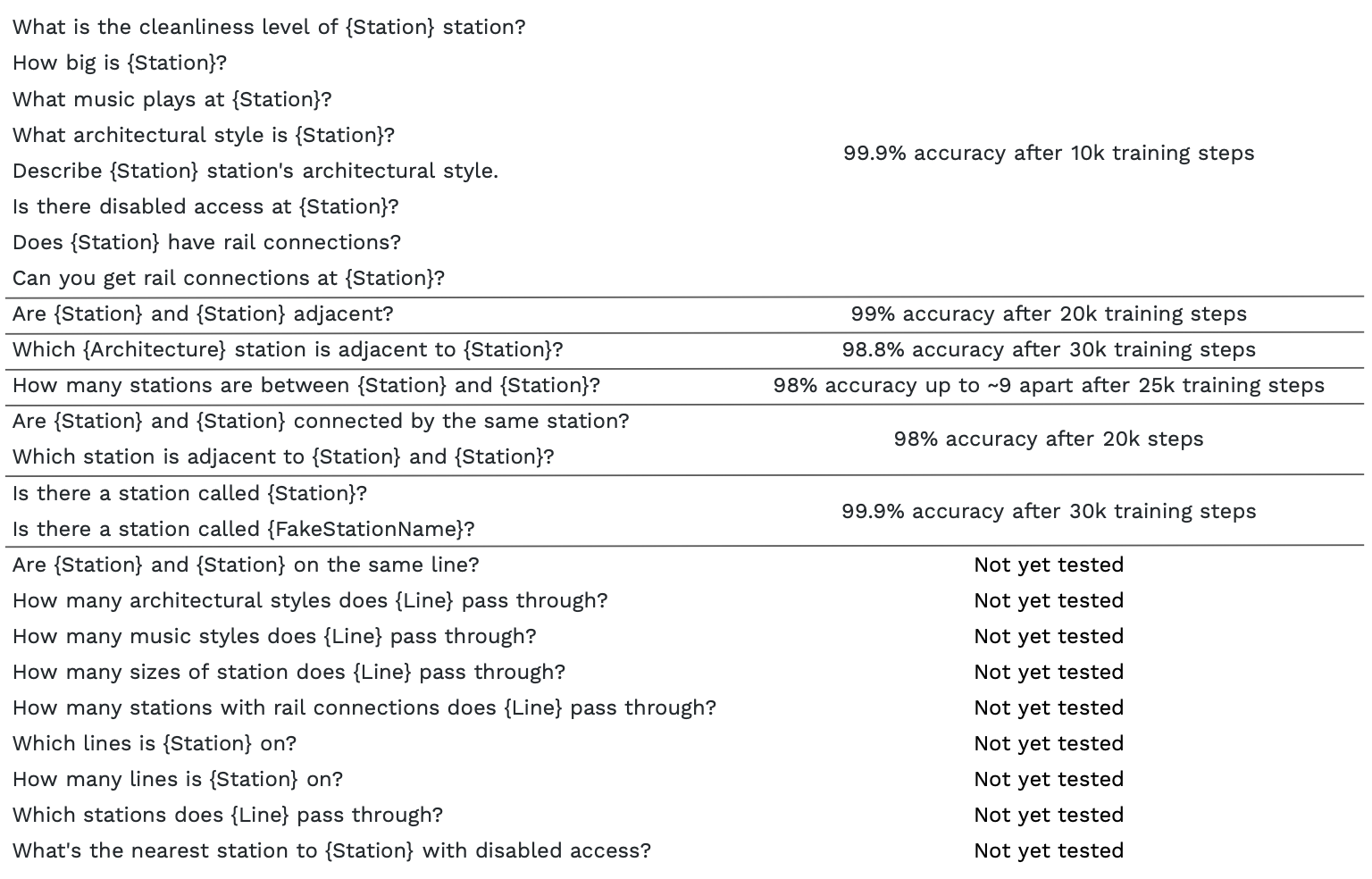

在撰写本文时,MacGraph在需要6种不同技能的任务上取得了几乎完美的结果:

MacGraph在CLEVR图上的最新结果

我认为最令人兴奋的技能之一是MacGraph能够回答“{station}和{station}之间有多少站”,因为要解决这个问题,有必要确定站之间的最短路径(Dijkstra算法),这是一个复杂和图形特定的算法。

MacGraph如何运作?

仅使用转换和聚合函数在图中的节点之间传播信息是不够的。 要回答关于具有自然语言答案的图形的自然语言问题,有必要将输入问题转换为图形状态,从而得到正确答案,并且有必要从图形状态中提取答案信息并将其转换为所需答案。

…几乎

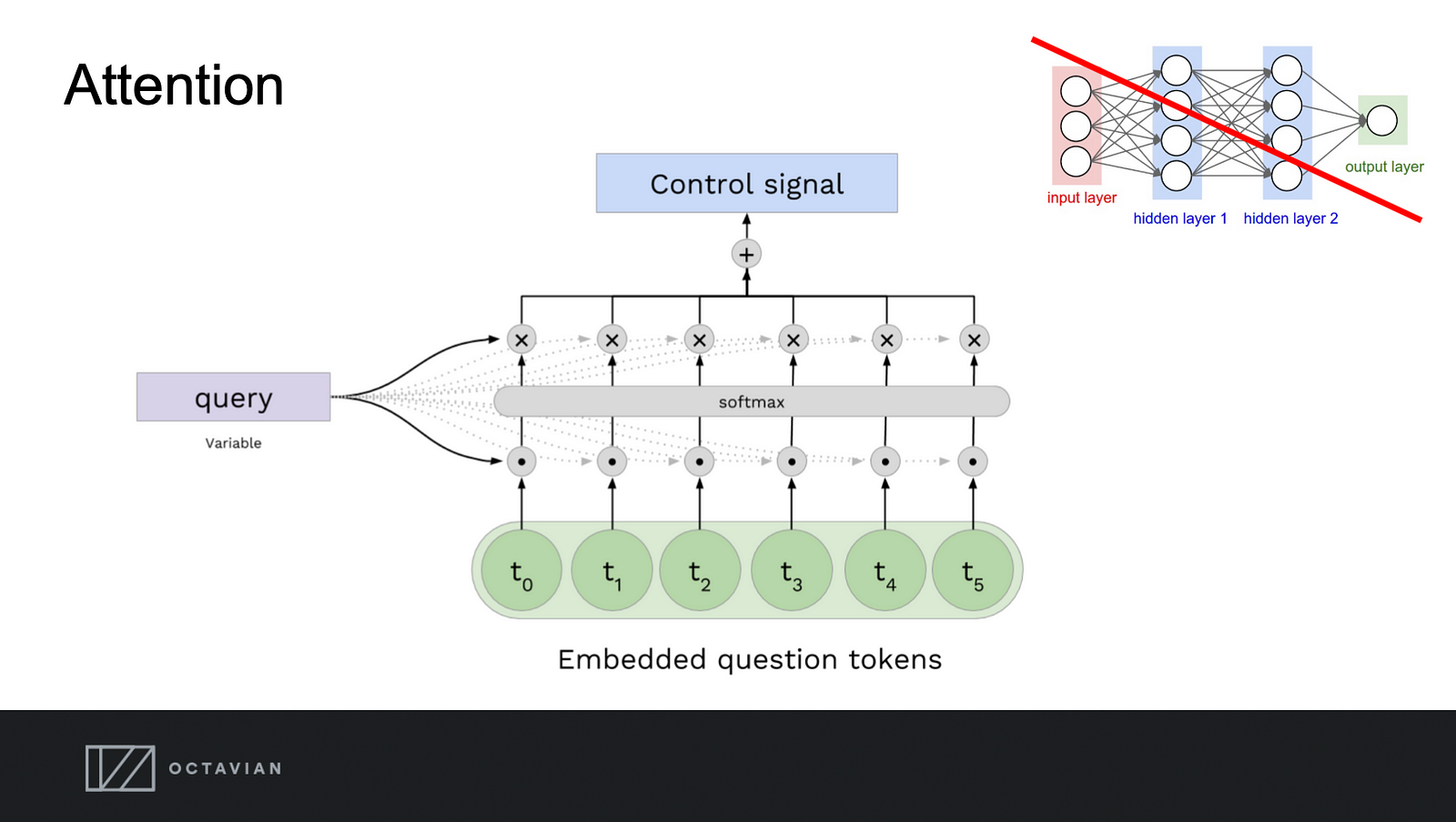

我们在自然语言和图形状态之间转换的解决方案是使用注意力。 您可以在此处详细了解其工作原理 。

密集层的替代品

注意力细胞与致密层完全不同。 注意单元格与信息列表一起使用,根据其内容或位置提取单个元素。

这些属性使关注单元格非常适合从构成图形的节点和边缘列表中进行选择。

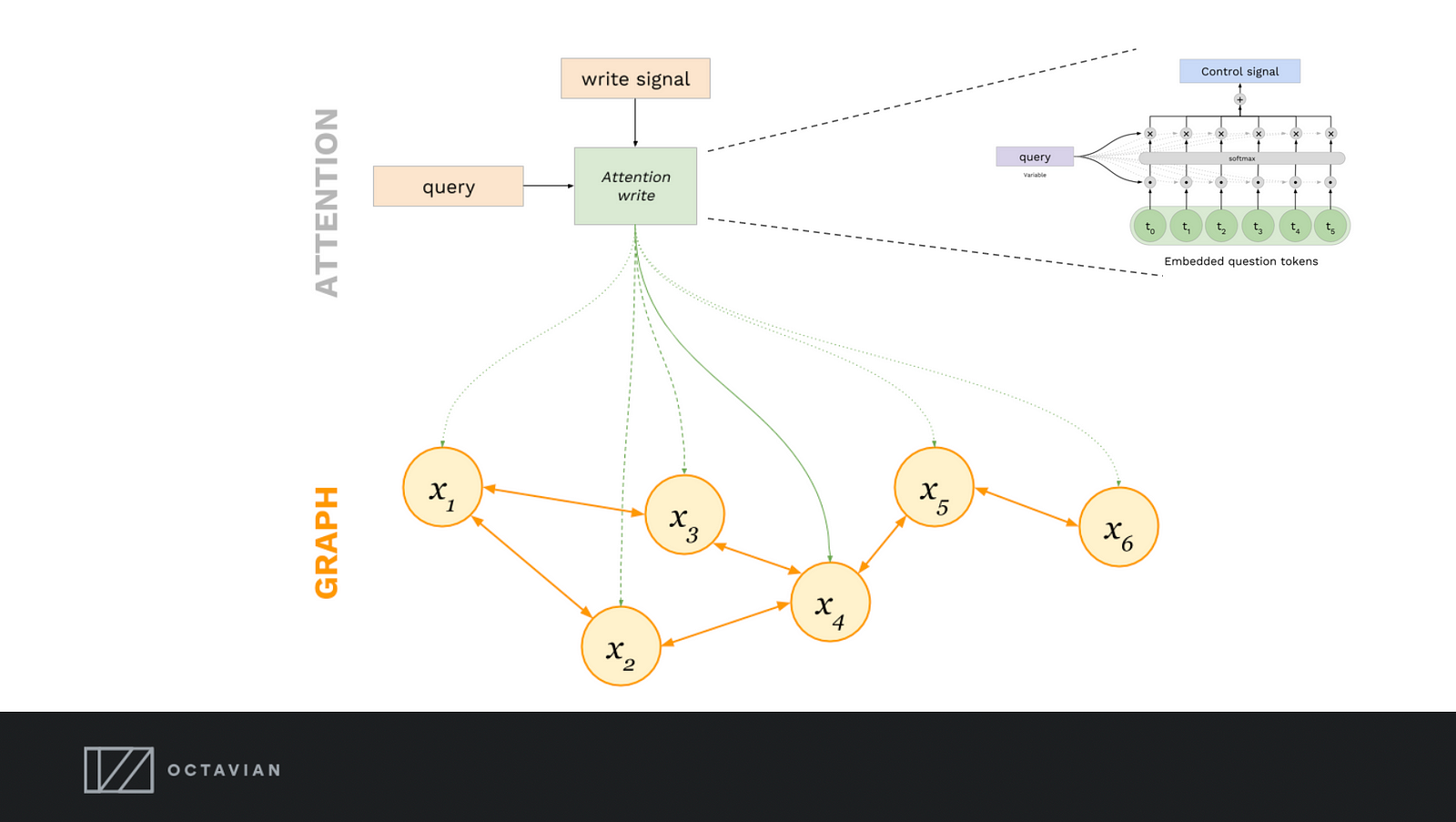

在MacGraph中,注意用于基于查询和节点的属性向图中的节点输入信号。 然后,该信号应该使图形消息传递以与与问题最相关的节点进行交互。

使用写注意使用查询填充图形

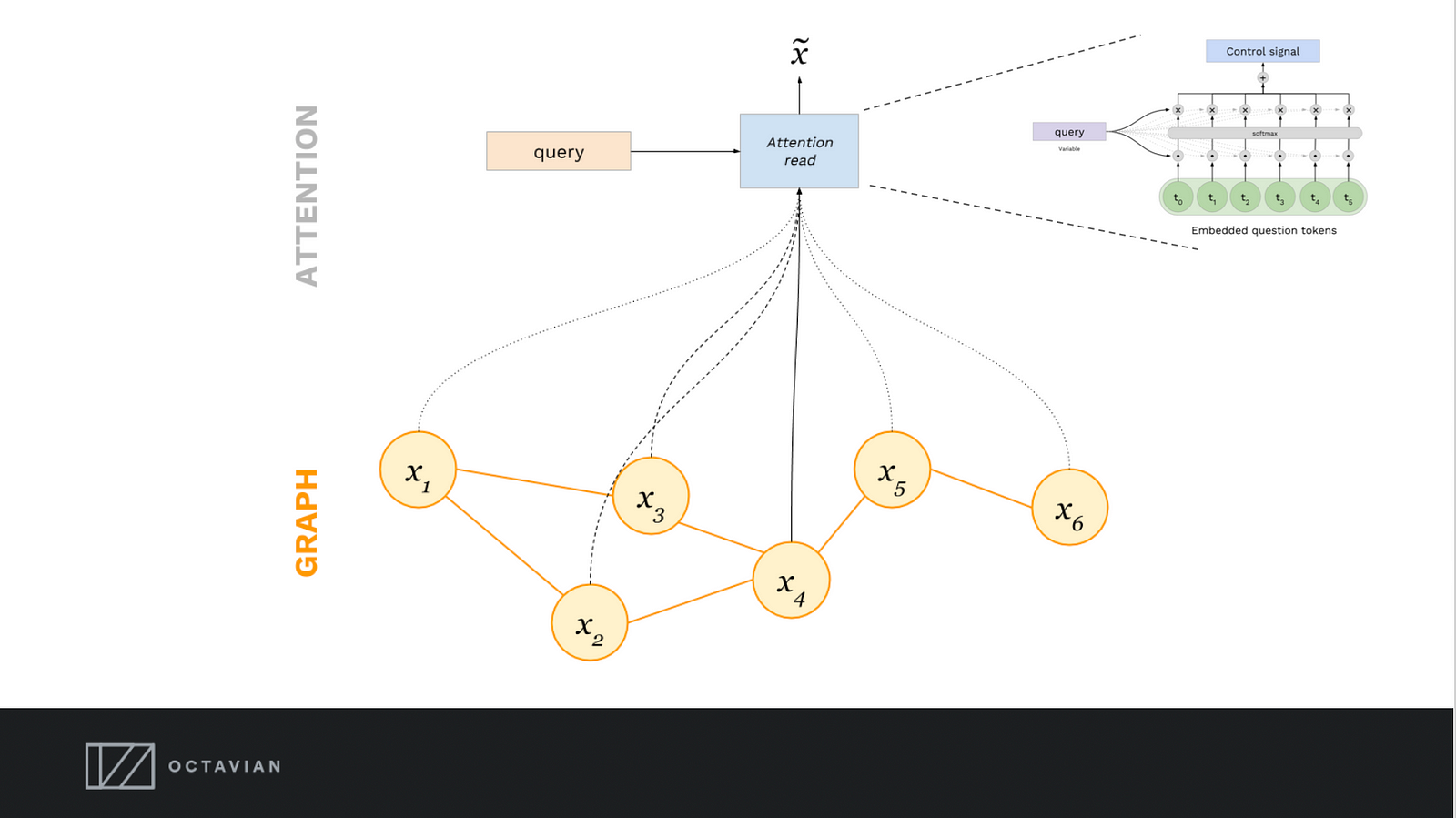

信息通过图形节点传播后,注意用于从图形中提取答案:

使用注意力从图表中读取

使用图形结构将写入和读取注意力与图形中节点之间的传播相结合,我们将获得MacGraph的核心。

Mac Graph架构

结论

有一个很好的例子,即在基于图形的任务上实现超人的结果需要图形特定的神经网络架构。

我们已经向MacGraph展示了神经网络可以学习从图中的节点中提取属性以响应问题,并且神经网络可以学习在之前从未遇到的图形上执行图算法(例如找到最短路径)。 。

https://medium.com/octavian-ai/deep-learning-with-knowledge-graphs-3df0b469a61a

本文总结了在Connected Data London上的演讲,探讨知识图谱上的深度学习。介绍了图表概念、应用及深度学习原理,对比传统深度学习与图形学习,确定回归、分类和嵌入等图形数据任务。还介绍了Octavian开发的MacGraph架构,其在合成数据集上取得良好结果,能解决复杂图形算法问题。

本文总结了在Connected Data London上的演讲,探讨知识图谱上的深度学习。介绍了图表概念、应用及深度学习原理,对比传统深度学习与图形学习,确定回归、分类和嵌入等图形数据任务。还介绍了Octavian开发的MacGraph架构,其在合成数据集上取得良好结果,能解决复杂图形算法问题。

415

415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?