目录

第一章 绪论

机器学习所研究的主要内容,是关于在计算机上从数据中产生“模型”的算法。

基本术语

数据集、样本、特征、特征空间、训练集、测试集、标记、标记空间;分类、回归、聚类;监督学习、无监督学习;

泛化能力:学得模型适用于新样本的能力。

假设空间、假设集合;

归纳偏好:机器学习算法在学习过程中对某种类型假设的偏好。

“奥卡姆剃刀”、“没有免费的午餐”原理

第二章 模型评估与选择

我们往往有多种学习算法可选择,甚至对同一种学习算法,使用不同的参数配置时也会产生不同的模型。选哪一个学习算法呢?选择哪一种参数配置呢?这就是模型选择问题。

解决方案:对这些模型评估。但由于无法得到泛化误差,训练误差又存在过拟合现象。所以使用测试误差来近似泛化误差进行评估模型。

2.1 经验误差与过拟合

经验误差(训练误差)

-定义:训练集上实际输出与预测输出的差异

泛化误差

-定义:学习器在新样本上的误差

过拟合

-定义:将训练样本的特点误认为普遍性质

-原因:考虑特征过多

欠拟合

-定义:未能学好训练样本的一般性质

-原因:考虑特征过少

2.2 评估方法

-定义:使用测试误差近似泛化误差

测试集与训练集互斥

划分训练集和测试集的方法

2.2.1 留出法

- 定义:D分为互斥的S和T

- 特点:分层采样,多次随机划分取平均值

2.2.2 交叉验证法

- 定义:D分为k个子集,轮流作为测试集

- 特点:每次k-1个子集训练,1个子集测试

- 常见方法:10次10折交叉验证法、留一法

2.2.3 自助法

- 定义:从D中随机采样形成D',再划分为训练集和测试集

- 特点:改变数据分布,引入估计偏差

- 适用情况:数据集较小或难划分时

2.2.4 调参与最终模型

调参(Parameter Tuning),调参过程涉及对不同参数配置的模型进行评估和选择。调参可视为算法选择的一部分,两者均涉及模型评估。参数配置通常在一个预设范围内进行选择。

在模型评估与选择过程中,部分数据被用作评估测试,而非全部用于训练。一旦选定学习算法和参数配置,应使用完整数据集D重新训练模型。这个模型利用了所有M个样本,代表了最终提交给用户的产品。

测试集与验证集

-测试集:实际使用中遇到的数据,用于估计模型泛化能力。

-验证集(Validation Set):在模型评估与选择中使用的评估测试数据集。验证集用于模型选择和调参,以区分实际使用中的数据。

泛化性能对比,使用测试集上的判别效果来评估不同算法的泛化性能。训练数据被划分为训练集和验证集,以在验证集上评估模型性能。

实际中常采用的是:先用留出法将数据集划分出训练集和测试集,然后再对训练集采用留出法划分出训练集和验证集,接着基于验证集的测试结果来调参选出最优参数配置方案,最后将验证集合并进训练集(训练集数据量够的话也可不合并),用选出的最优参数配置在合并后的训练集上重新训练,再用测试集来评估训练得到的模型的性能。

2.3 性能度量

- 定义:衡量模型泛化能力的评估标准

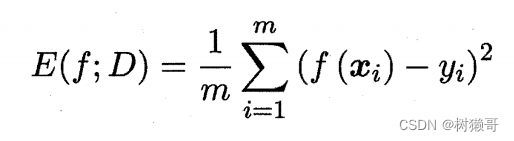

- 回归任务的度量:均方误差

- 一般情况:考虑样本出现概率不同的性能度量

2.3.1 错误率与精度

- 错误率:分类错误的样本数占总数的比例

- 精度:分类正确的样本数占总数的比例

2.3.2 查准率P、查全率R和F1

- 查准率P:挑出好瓜中真正的好瓜比例

- 查全率R:挑出的好瓜占全部好瓜的比例

- F1分数:2 * (P * R) / (P + R)

2.3.3 ROC

ROC(Receiver Operating Characteristic) 纵轴:真正例率(True Positive Rate),横轴:假正例率(False Positive Rate)

AUC(Area Unger ROC Curve):ROC曲线的面积

2713

2713

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?