文章目录

目的

基于深度学习对手部骨龄进行预测。

主要评估指标

以月为单位的平均绝对距离(MAD),它是根据模型估计值与参考标准的骨龄之间的差的绝对值的平均值计算得出。

数据及结果

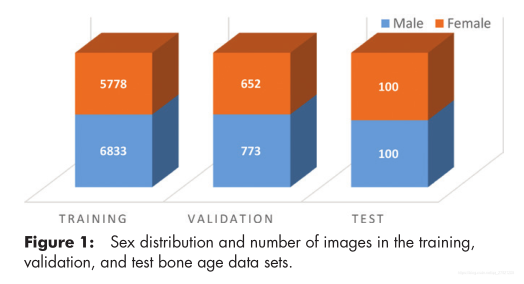

提供了由14236张手部X射线照片组成的数据集(12611个训练集,年龄1-228个月整数,非连续分布,1425个验证集,200个测试集),几乎所有方法都使用基于一个或多个卷积神经网络(CNN)的深度神经网络技术。基于MAD的最佳五个结果分别为4.2、4.4、4.4、4.5和4.5个月。

解决方案总结如下:

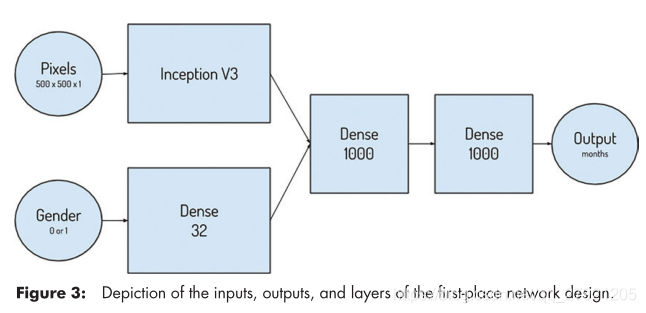

第一名:Alexander Bilbily等16 Bit公司-MAD=4.265

参考资料

输入:500x500,基本网络inception V3,数据增强

预处理:使用了20度的旋转范围,最多20%的水平/垂直平移,最多20%的缩放和水平翻转。

特点:结合了性别信息

结果:多模型融合

网络:

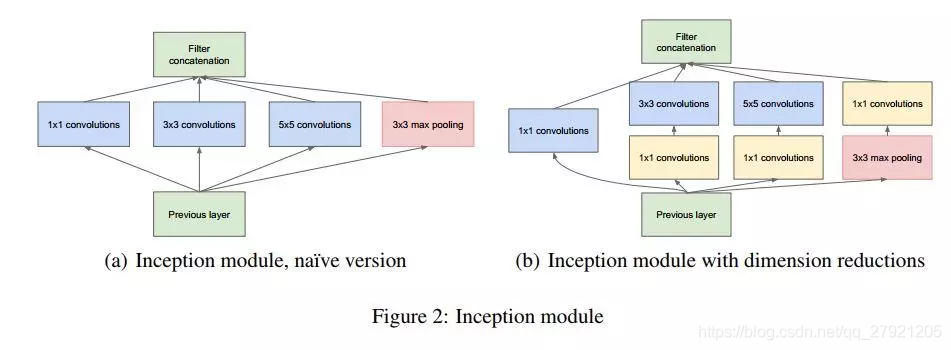

inception介绍

[v1] Going Deeper with Convolutions, 6.67% test error, http://arxiv.org/abs/1409.4842

[v2] Batch Normalization: Accelerating Deep Network Training by Reducing Internal Covariate Shift, 4.8% test error, http://arxiv.org/abs/1502.03167

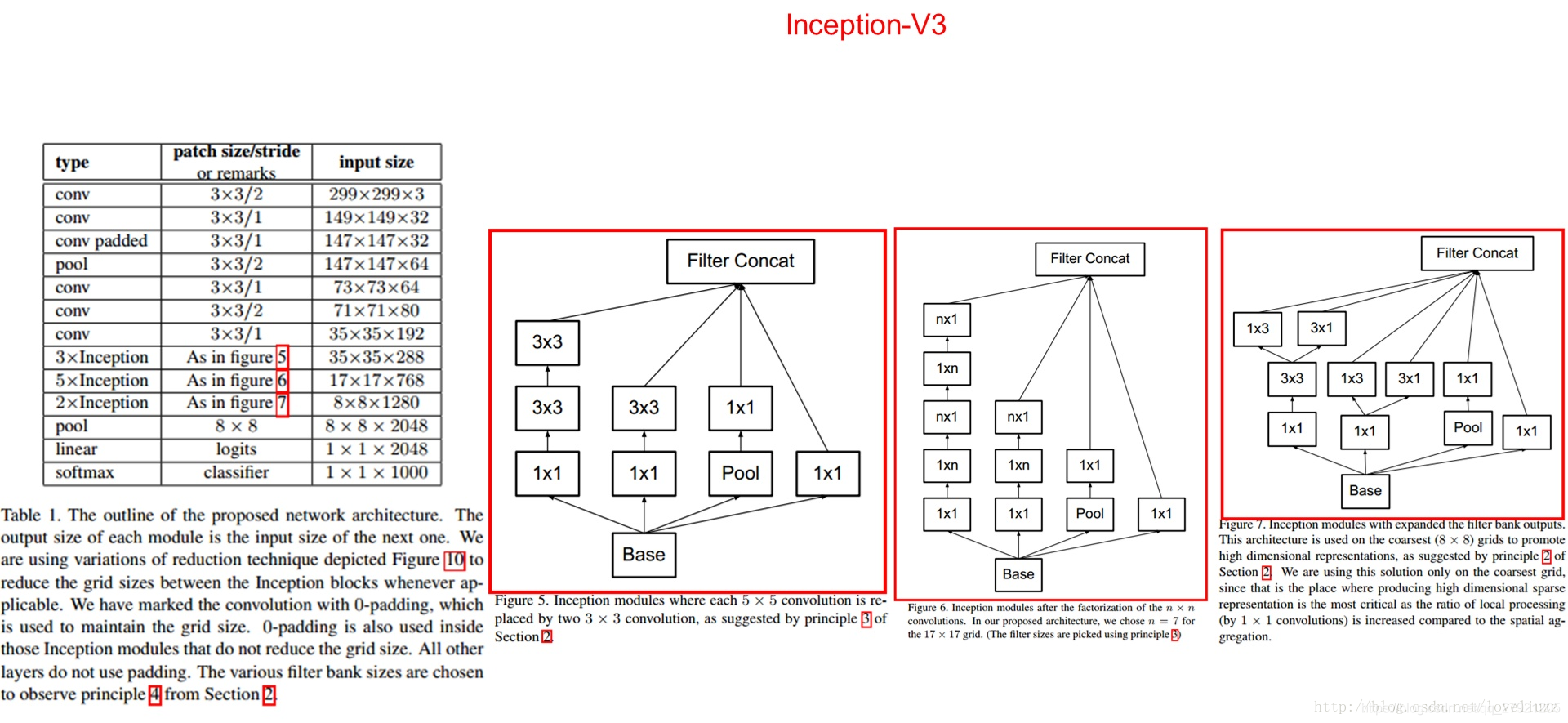

[v3] Rethinking the Inception Architecture for Computer Vision, 3.5% test error, http://arxiv.org/abs/1512.00567

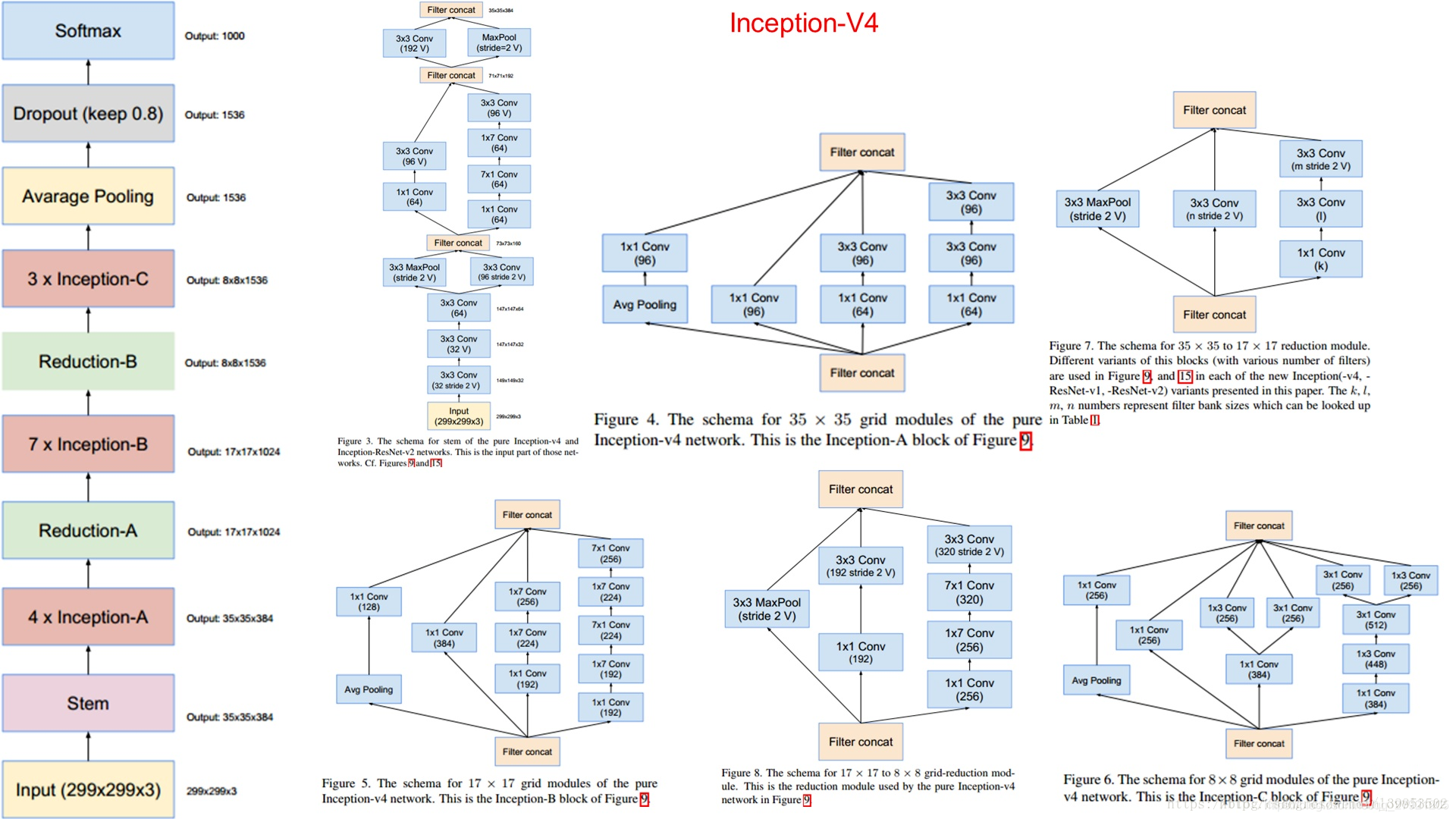

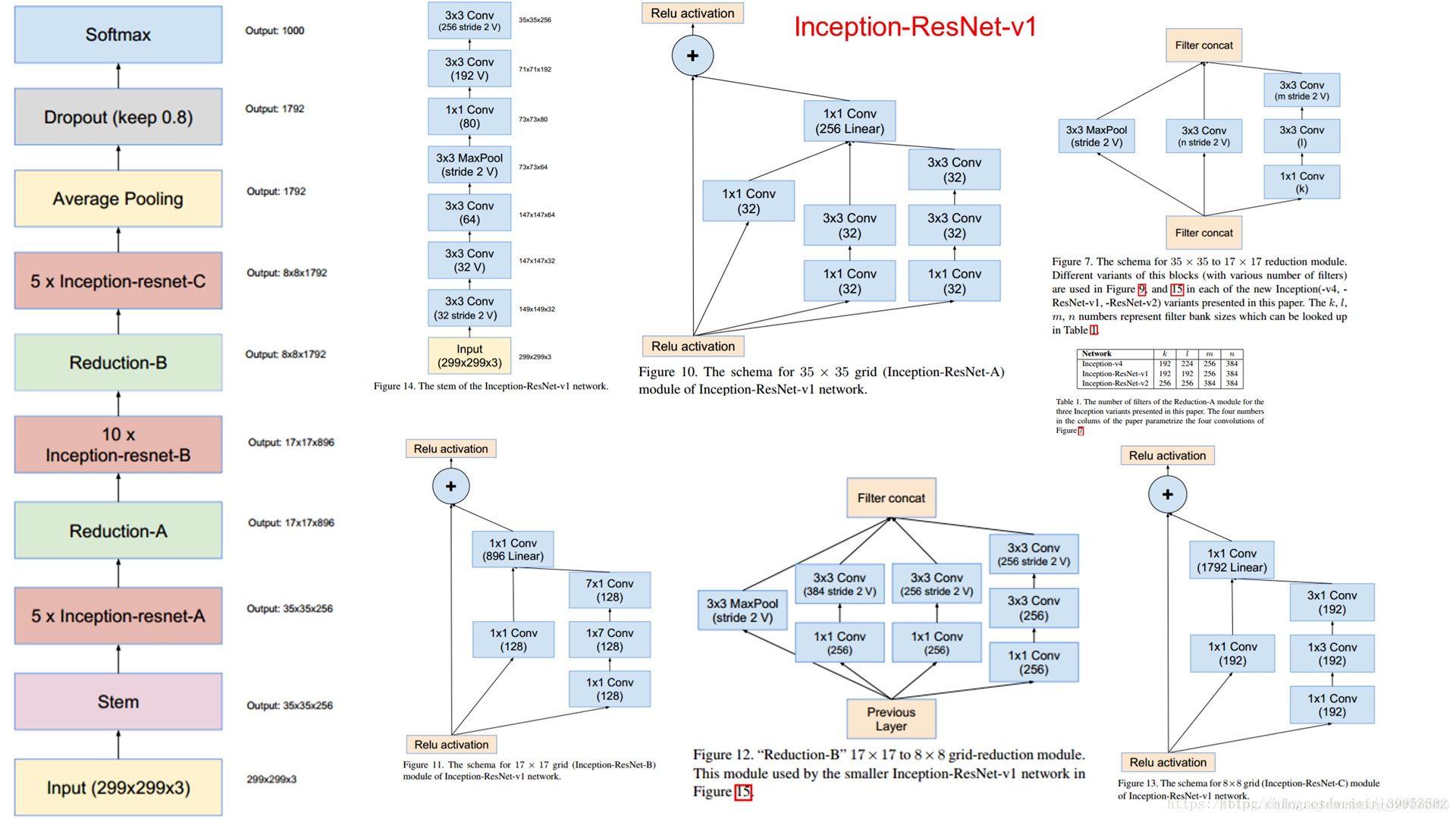

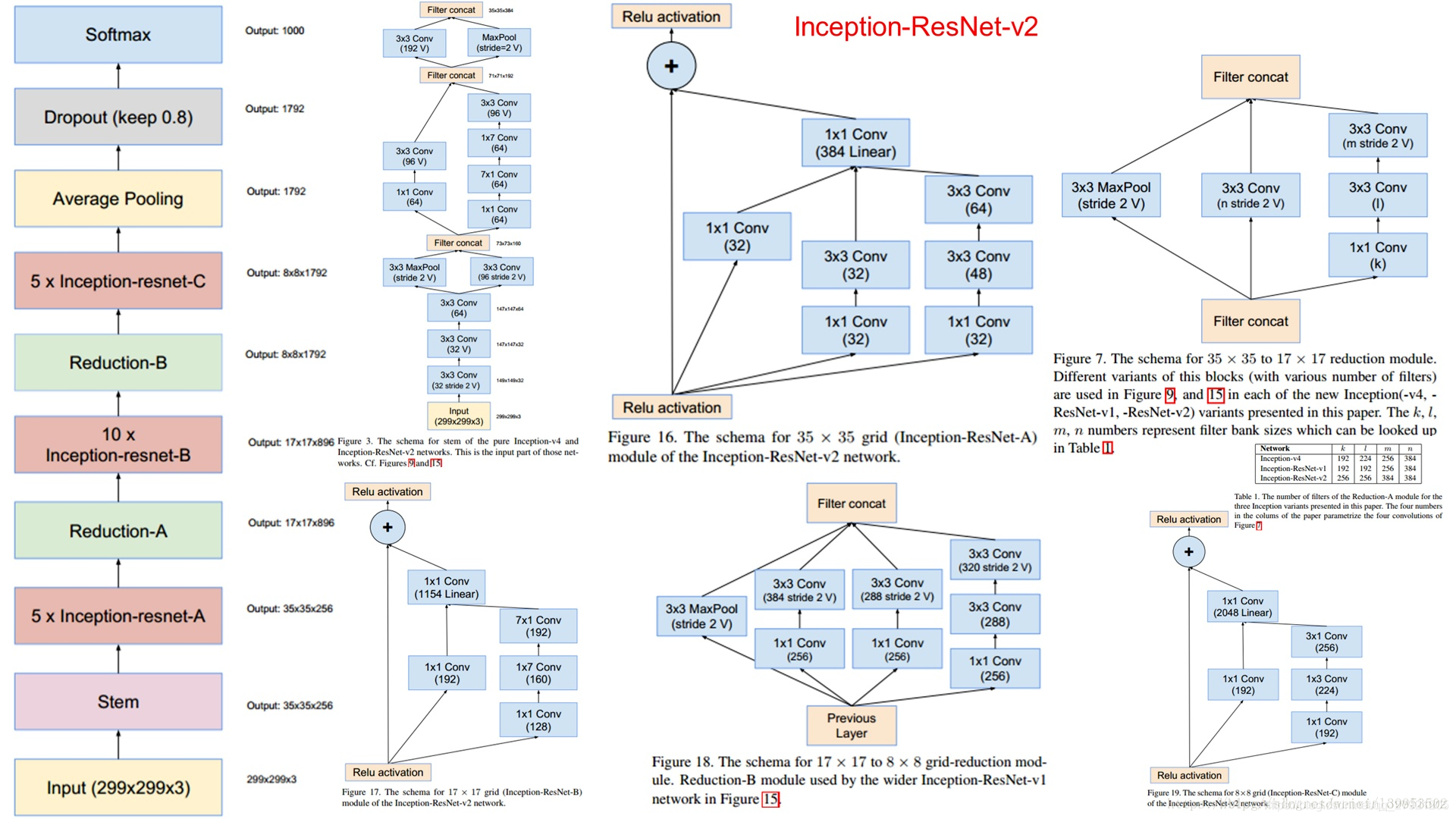

[v4] Inception-v4, Inception-ResNet and the Impact of Residual Connections on Learning, 3.08% test error, http://arxiv.org/abs/1602.07261

v1:使用多种尺度的卷积核,使用1*1卷积用于降维。可以解决对象在图片中的位置核尺寸差异问题。

v2:使用BN,使用33卷积代替55卷积。可实现收敛更快,参数更少。

v3:使用对称卷积。不过在中度大小的feature map上使用效果才会更好,对于mxm大小的feature map,建议m在12到20之间。

v4:

inception-ResNet v1

inception-ResNet v2

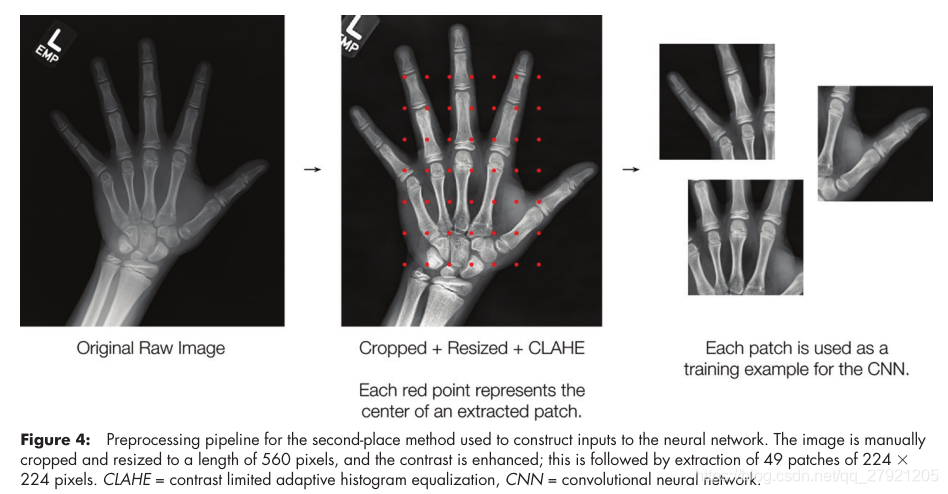

第二名: Ian Pan-MAD=4.350

输入:把原图缩放到560,再切块49份,大小为224X224,对比度增强,男性和女性分开训练

网络:Resnet-50,基于ImageNet的预训练模型

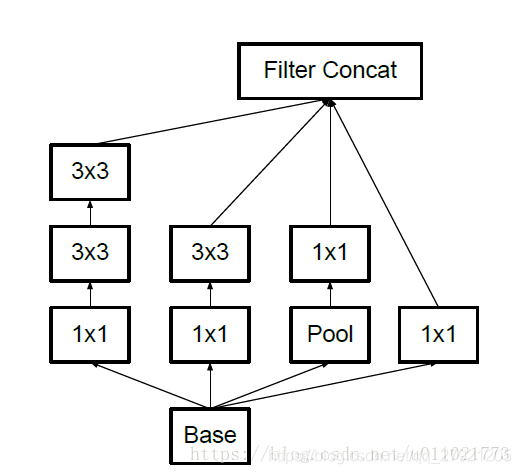

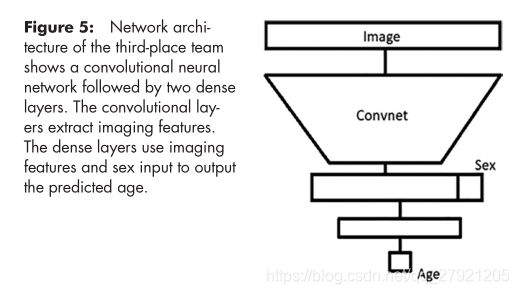

第三名: Felipe Campos Kitamura-MAD=4.382

输入:把训练集划分成5份,每份进行训练,训练集最好的四个网络用于测试,测试结果取平均值。

网络:

整体网络:

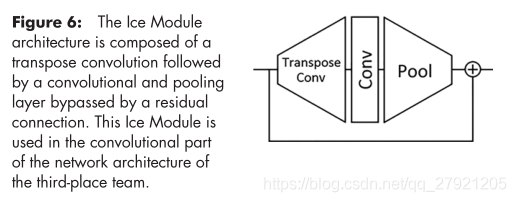

提出了新的模块Ice module:

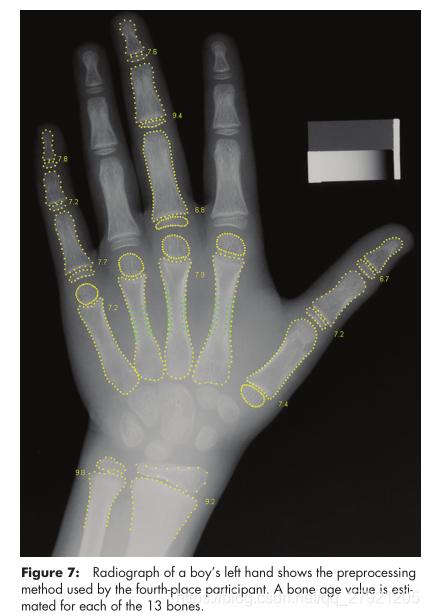

第四名: Hans Henrik Thodberg-MAD=4.505

使用了传统机器学习的方法:使用图像预处理,分割成15块骨头区域,使用传统方法获取特征:骨头形状,生长区的强度模式,生长区的gabor纹理特征。

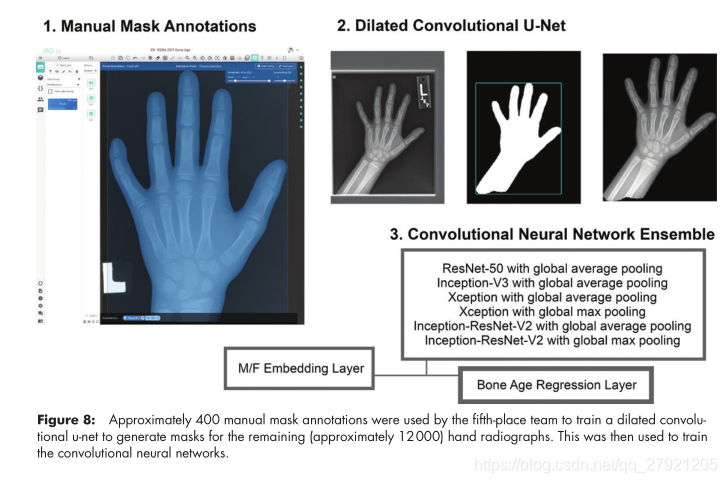

第五名: Leon Chen-MAD=4.527

特点:标注了400张手掌掩膜,训练了一个UNet网络,再对训练集进行分割,最后基于掩膜进行骨龄预测,其中还使用了年龄回归和性别嵌入层。

5394

5394

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?