目录

1、目标检测位置回归损失函数详解

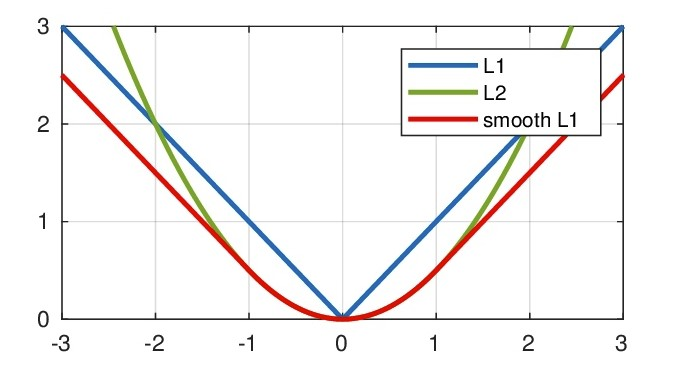

1.1、L1 Loss

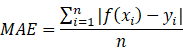

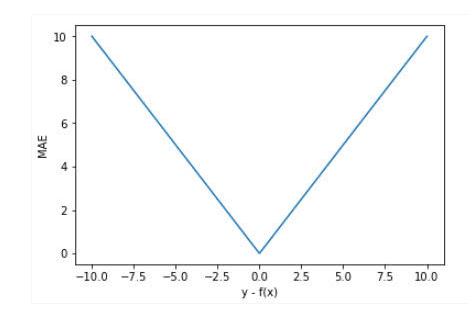

MAE

优点:1、离群点不敏感 2、稳定梯度 避免梯度爆炸

缺点:1、x=0处不可导 2、训练后期震荡

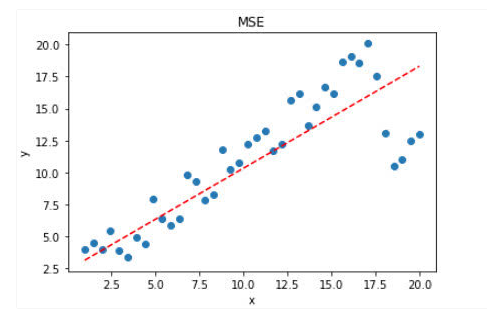

1.2、L2 Loss

![]()

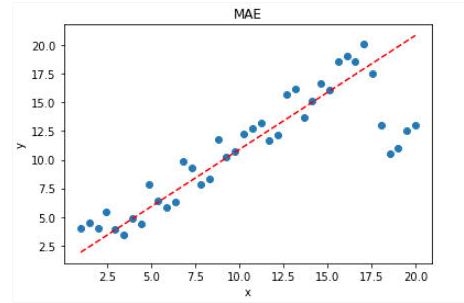

MSE

优点:1、梯度动态变化 加速收敛 2、x=0处可导

缺点:1、离群点敏感

1.3、Smooth Loss

![]()

1.4、IOU Loss

![]()

![]()

1.5、GIOU Loss

![]()

![]()

1.6、DIOU Loss

![]()

![]()

1.7、CIOU Loss

![]()

![]()

![]()

![]()

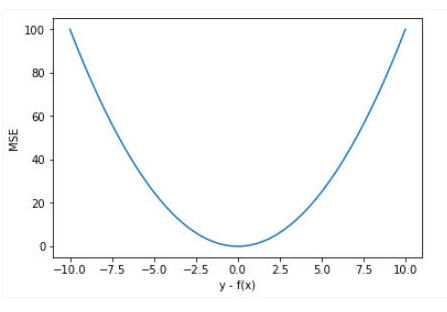

smooth L1

应用模型:faster rcnn ssd

优点:1、pred和gt差异大时,梯度值不至于过大 2、pred和gt差异小时,梯度值足够小

完美避开L1和L2的缺点,继承L1和L2的优点

缺点:1、xywh 独立四个点 但是是有相关性的

2、实际推理时使用IOU loss 而训练时是用L1 L2损失,两者不等价

3、L1 L2 loss相等时 IOU不唯一

4、基于L1 L2 loss 不具有尺度不变性

IOU loss

优点:smooth L1 的缺点就是IOU loss 的优点

1、尺度不变性 2、推理 训练 等价 3、

缺点:1、当预测框和目标框不相交时,IoU(A,B)=0时,不能反映A,B距离的远近,此时损失函数不可导,IoU Loss 无法优化两个框不相交的情况

2、假设预测框和目标框的大小都确定,只要两个框的相交值是确定的,其IoU值是相同时,IoU值不能反映两个框是如何相交的。

GIOU loss

优点:IOU loss 的缺点就是GIOU loss 的优点 解决IOU loss 不相交情况

缺点:

DIOU loss

优点:解决GIOU loss 两者包裹情况

缺点:

CIOU loss

优点:

缺点:

参考文献

回归损失函数1:L1 loss, L2 loss以及Smooth L1 Loss的对比 - Brook_icv - 博客园

723

723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?