参考博客:https://tangshusen.me/2018/12/09/vc-dimension/

疑问:

(1)一般情况下,假设空间的VC维约等于假设自由变量的数目。

这个在线性分类器是成立的,神经网络的vc维是无穷大。

(2)为什么深度学习和VC维有矛盾

深度学习里,在cifar10数据集,简单的卷积网络和残差网络的参数的数量相差了很多,前者的参数量远小于后者,用vc维解释的话,测试误差和训练误差应该后者更大,但是为什么反而小了呢?

我感觉是因为VC维的这些推论很大程度上是过于把问题简化,都是在线性分类器情况下。

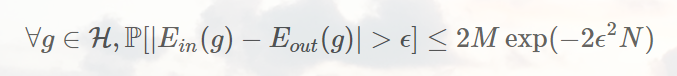

比如这个公式:

实际中M是无穷大,N也是无穷大,因此这个公式根本就和实际不相符。

而且本质上M、N都是不可数的,只有可数才能用limt->无穷来证明。

反正就是它里面的公式在深度学习情况下完全不成立的,只能大概看看

2746

2746

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?