7. 主成分分析 PCA

- pdf版本下载:https://pan.baidu.com/s/1bKDYAa

- html版本下载:https://pan.baidu.com/s/1o7H7DsI

主成分分析(Principal Component Analysis)属于非监督学习,是特征降维中最老牌的算法之一,应用十分广泛。特别是在现在深度学习进行特向特征提取的过程中,往往由于原始特征过于复杂需要进行降维处理。

1 降维的原因

原因:

- 1.使得数据更容易显示,更容易理解

- 2.降低算法的计算开销

- 3.去除噪声

PCA的过程就是将高维的数据投影到较低维的空间上,所以它不同于特征选择,通过PCA提取得到的特征是原始特征的线性组合。而其中的提取规则如下

2 PCA降维原理

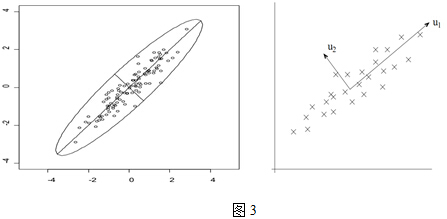

在信号处理中认为信号具有较大的方差,噪声有较小的方差,信噪比就是信号与噪声的方差比,越大越好。例如上面的图中,我们需要把二维平面上的数据点降到一维,显然数据点在 u1 方向上的投影方差较大,因此对所有的数据点具有较好的区分效果。所以,一般地,当我们需要把n维的数据降维降到k维时,就需要数据在这k维上都具有较好的区分度(较大的方差)。

- 假设数据集: D={

x1,x2,..,xm} ,每个数据的维数 d

假设需要降低到k 维。 步骤:

- 1.对所有数据中心化: xi←xi−1m∑t=1mxt

- 2.计算样本的协方差矩阵: XXT

- 3.对 XXT 做特征值分解

- 4.取最大的k个特征值所对应的k个特征向量 w1,..wk

- 5.输出投影矩阵 W=(w1,..,wk)

最后,这里的 k 如何确定呢?可以预先指定一个降维的主成分比例,即得到的k维数据满足:

3 公式推导

最近重构性:样本点到这个超平面的距离都足够近。

- 假设数据 { x1<

主成分分析PCA是一种非监督学习的特征降维方法,常用于深度学习的特征提取。PCA通过找到数据最大方差的方向进行降维,保证新特征的线性组合。本文介绍了PCA降维的原因、原理、公式推导以及问题求解过程。

主成分分析PCA是一种非监督学习的特征降维方法,常用于深度学习的特征提取。PCA通过找到数据最大方差的方向进行降维,保证新特征的线性组合。本文介绍了PCA降维的原因、原理、公式推导以及问题求解过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4276

4276

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?