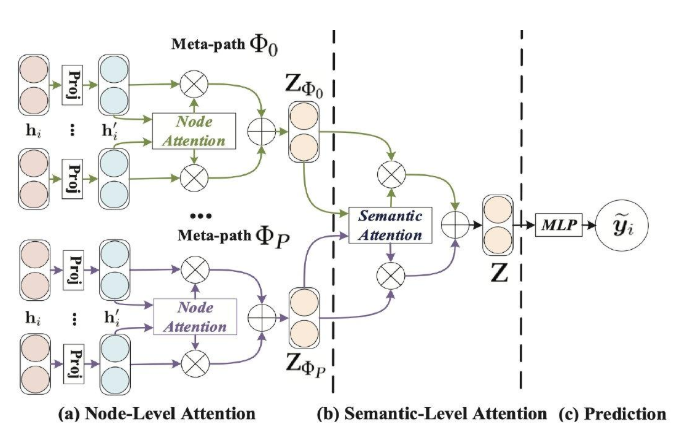

在图神经网络(GNN)领域,HAN(Heterogeneous Attention Network)是专门为异构信息网络(Heterogeneous Information Networks, HIN)设计的一种模型。HAN通过节点级别聚合和语义级别聚合来有效捕捉不同类型节点间的关系,结合多种信息,提供了一种灵活的方式来学习节点表示。

1. 节点级别的聚合(Node-Level Aggregation)

节点级别的聚合主要关注具体节点之间的关系和信息传递。它的目标是根据邻居节点的状态来更新中心节点的表示。

过程:

- 每个节点在聚合过程中只考虑其直接的邻居节点(即1-hop邻居)。

- 节点可以通过不同的消息传递机制从邻居节点收集信息。

- 通过加权平均或其他聚合方法,将邻居节点的信息结合起来。

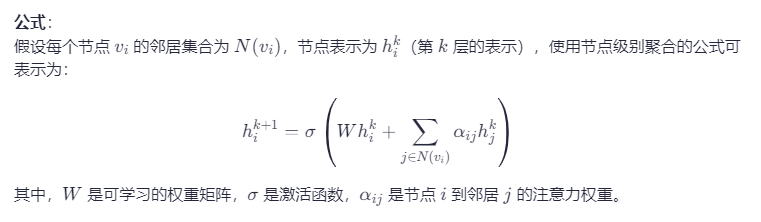

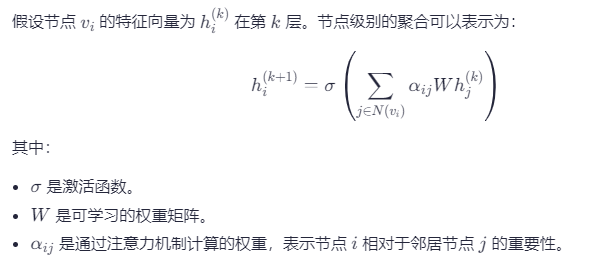

公式:

2. 语义级别的聚合(Semantic-Level Aggregation)

语义级别的聚合则关注于从不同类型的邻居节点中提取信息。在异构网络中,不同类型的节点可能承载不同的语义信息。因此,语义级别的聚合旨在从不同的节点类型中获取更丰富的上下文信息。

过程:

- 在聚合过程中,HAN首先会在每一层提取不同类型节点的信息。

- 然后对这些信息进行合并,从而获取更高层次的语义数据。

- 使用注意力机制为每种类型的节点赋予不同的权重,以反映其相对重要性。

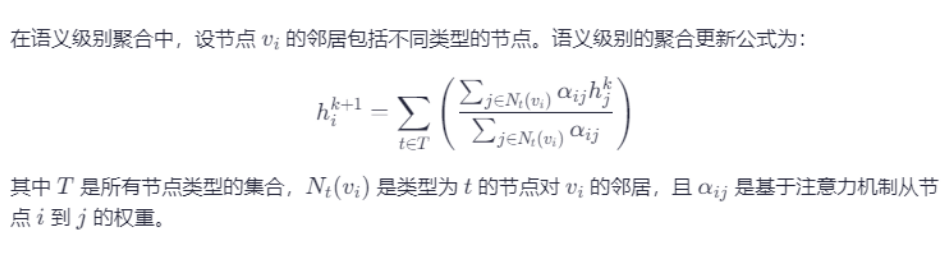

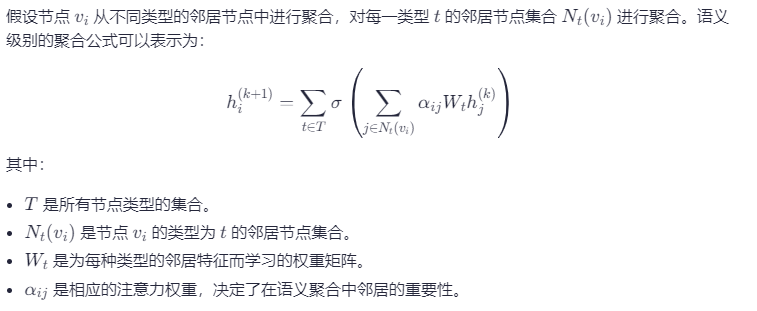

公式:

通过节点级别的聚合,HAN能够捕捉到邻居节点的信息并更新特征,而语义级别的聚合则使得模型能够整合来自不同类型的节点的丰富信息,从而增强了模型在异构网络中的学习能力。组合这两种聚合策略,HAN能够有效地处理异构信息网络上的任务,如节点分类、关系预测等。

HetGNN(Heterogeneous Graph Neural Networks)是一种用于异构图的图神经网络,旨在有效地融合不同类型节点和边的信息。它利用节点级别和语义级别的聚合机制来学习节点表示。下面详细介绍这两种聚合的机制。

1. 节点级别的聚合(Node-Level Aggregation)

在HetGNN中,节点级别的聚合主要关注于每个节点与其邻居节点之间的信息传递。通过对邻居节点的特征进行聚合,中心节点的表示可以更新为更具信息量的特征。

节点级别聚合的过程:

- 信息收集:对于每个节点

,通过与其邻居节点

的特征进行整合来获取信息。

- 加权组合:使用可学习的参数为每个邻居节点赋予不同的权重。可以使用各种聚合方法(如求和、平均或最大池化等)对信息进行聚合,这种方法可以有效捕捉局部结构信息。

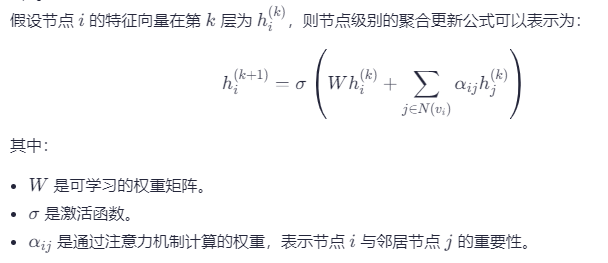

公式:

2. 语义级别的聚合(Semantic-Level Aggregation)

在HetGNN中,语义级别的聚合强调从不同类型的邻居节点中提取信息。由于在异构网络中,不同类型的节点可能具有不同的特征和重要性,因此语义级别聚合能够利用这些多样性来增强模型的表达能力。

语义级别聚合的过程:

- 类型区分:将邻居节点按照其类型进行分组,并针对每种类型进行独立的聚合。

- 加权平均/求和:对每一类型的邻居节点聚合其特征,然后将不同类型得到的聚合结果结合起来,从而更新中心节点的特征。

- 考虑类型权重:不同类型的邻居对中心节点的影响可能不同,使用注意力机制为每种类型的邻居分配权重。

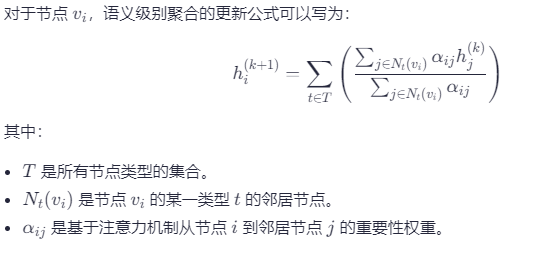

公式:

在HetGNN中,通过节点级别的聚合,模型能够有效地从直接邻居节点中更新其特征,而语义级别的聚合则使得模型可以从不同类型的邻居节点中整合信息,提升了模型对异构图的表达与学习能力。两者结合,使HetGNN在处理复杂的异构图结构时具备了更强的性能。

HGAT(Heterogeneous Graph Attention Network)是用于异构图的图神经网络,结合了图卷积和注意力机制的优势。HGAT通过节点级别和语义级别的聚合策略,能够灵活地学习不同类型节点的信息并有效地提取其关系特征。以下是关于HGAT中节点级别和语义级别聚合的详细介绍。

1. 节点级别的聚合(Node-Level Aggregation)

节点级别的聚合主要集中在如何从每个节点的邻居节点中获取信息。在HGAT中,节点级别的聚合通过压缩邻居节点的信息来更新中心节点的特征。

过程:

- 信息收集:每个节点通过其邻居节点的特征进行信息收集。

- 加权聚合:使用注意力机制为邻居节点的特征分配权重,从而将这些特征加权组合。

公式:

2. 语义级别的聚合(Semantic-Level Aggregation)

在HGAT中,语义级别的聚合主要关注于从不同类型的邻居节点中提取信息。熵聚合机制使得HGAT能够整合来自不同类型节点的多重视角,从而获得更丰富的上下文信息。

过程:

- 分类型聚合:根据节点的类型,将其邻居节点进行分组,对每种类型的邻居进行独立的聚合。

- 注意力机制:为不同类型的邻居节点分配不同的权重,以反映其在信息聚合过程中的重要性。

- 合并语义:对每一类型的聚合结果进行整合,形成对中心节点的语义表示。

公式:

HGAT通过节点级和语义级聚合的方式,利用注意力机制有效地收集和整合异构图中不同类型节点的信息。这种灵活性使得HGAT能够在异构数据集上执行节点分类、关系预测等任务时,充分利用多种类型的节点和边的特性,提高模型的表达能力和性能。

1493

1493

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?