1 背景

自从GAN提出后,其在图像合成领域一直非常火热,尤其是基于深度卷积神经网络的GAN。

对于多分类实验结果不理想,GAN擅于获取具有连续几何结构的模式,比如能精确模拟狗的毛发而对几只分散的脚无法准确判断。

这可能是由于对卷积的频繁使用导致的,因为卷积核受到视野域的影响,空间分离的模式只有在深层网络中才能挖掘。

增大卷积核可以缓解该问题,但会增大计算量。

注意力机制可以花费少量的计算获取特征的权重以克服空间分离的问题。

相关工作证实被很好地约束的生成器能使结果表现更佳。

2 挑战

- GAN的训练对超参数的选择敏感。

- 空间分离问题。

3 创新

- 将注意力机制引入GAN的生成器和判别器,提出Self-Attention-Generative-Adversarial-Networks,SAGAN。

- 将光谱正则化引入GAN的生成器和判别器,以避免异常的梯度出现,稳定训练过程。

- 对生成器和判别器使用不同的学习率。

4 方法

5 实验

使用光谱正则化(spectral normalization,SN) 和不平衡学习率(imbalanced learning rate,TTUR)的实验结果如下所示,可见对训练的稳定性具有很好的作用。

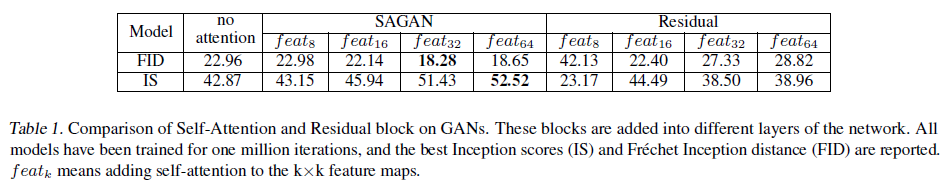

将注意力模块和残差模块进行对比如下表所示,说明该模块对性能的提升作用并不是仅仅因为增加了网络的深度和复杂度。

将注意力图进行可视化,发现它对图片中空间离散的模式挖掘得较好。

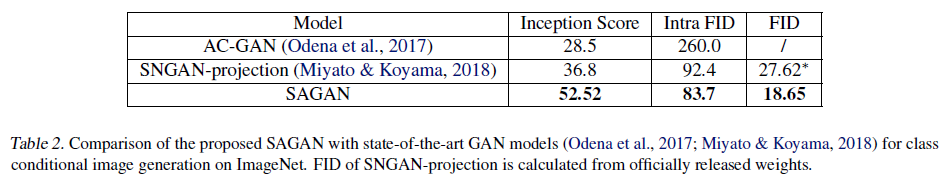

下表说明该方法对类别条件图像生成任务也具有较好的表现。

1866

1866

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?