前言

总结一下特殊层的Tensorflow 实现方式。说不定以后用得着。

一、Squeeze_excitation_layer(SE)

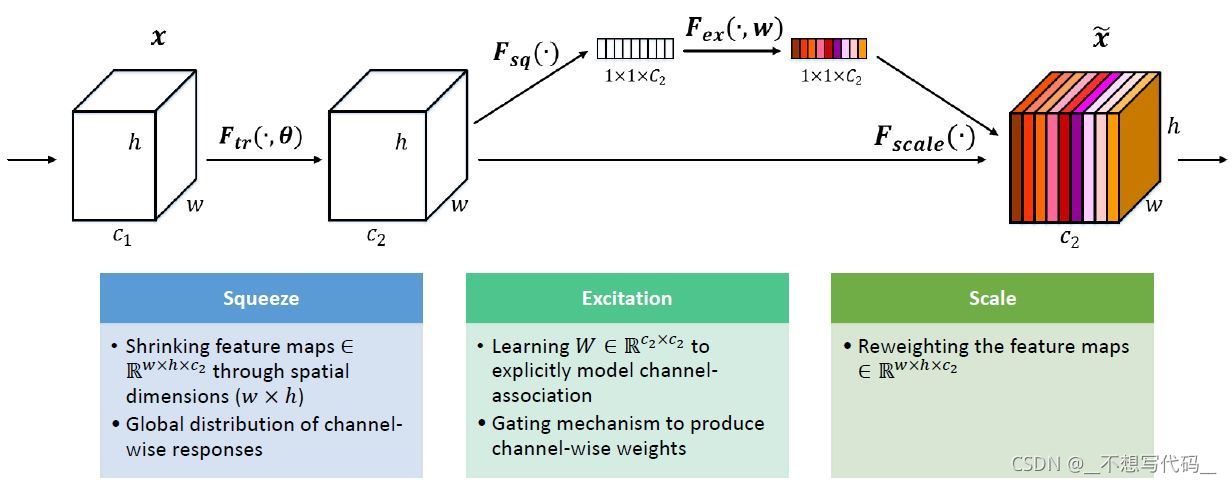

操作方法如下图所示:

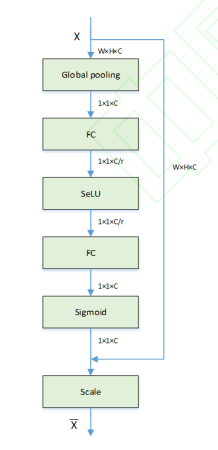

上图看起来有点复杂,我直接从国内论文里摘了一张图,这样比较直观。

r 是压缩比,相当于对用到进行一个权重占比,我们来看一下TensorFlow的实现方式。

def squeeze_excitation_layer(x, outdim, ratio):

'''

SE module performs inter-channel weighting.

'''

squeeze = GlobalAveragePooling2D()(x)

excitation = Dense(outdim//ratio)(squeeze)

excitation = Activation('selu')(excitation)

excitation = Dense(outdim)(excitation)

excitation = Activation('sigmoid')(excitation)

excitation = Reshape((1, 1, outdim))(excitation)

scale = multiply([x, excitation])

return scale

x 是输入的tensor out_dim 为输出维度,ratio 为压缩比。

对于很难分类的数据集Fer2013来说,使用它能达到70% 左右的准确率,对于那片论文使用的网络结构我复现了一下。

完整网络结构代码:

from keras.models import Model

from keras.layers import Input

from keras.layers import Lambda

from keras.layers import Reshape

from keras.layers import Conv2D

from keras.layers import Activation

from keras.layers import AveragePooling2D

from keras.layers import GlobalAveragePooling2D

from keras.layers import BatchNormalization

from keras.layers import Dense

from keras.layers import Concatenate, concatenate

from keras.layers import Add

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

868

868

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?