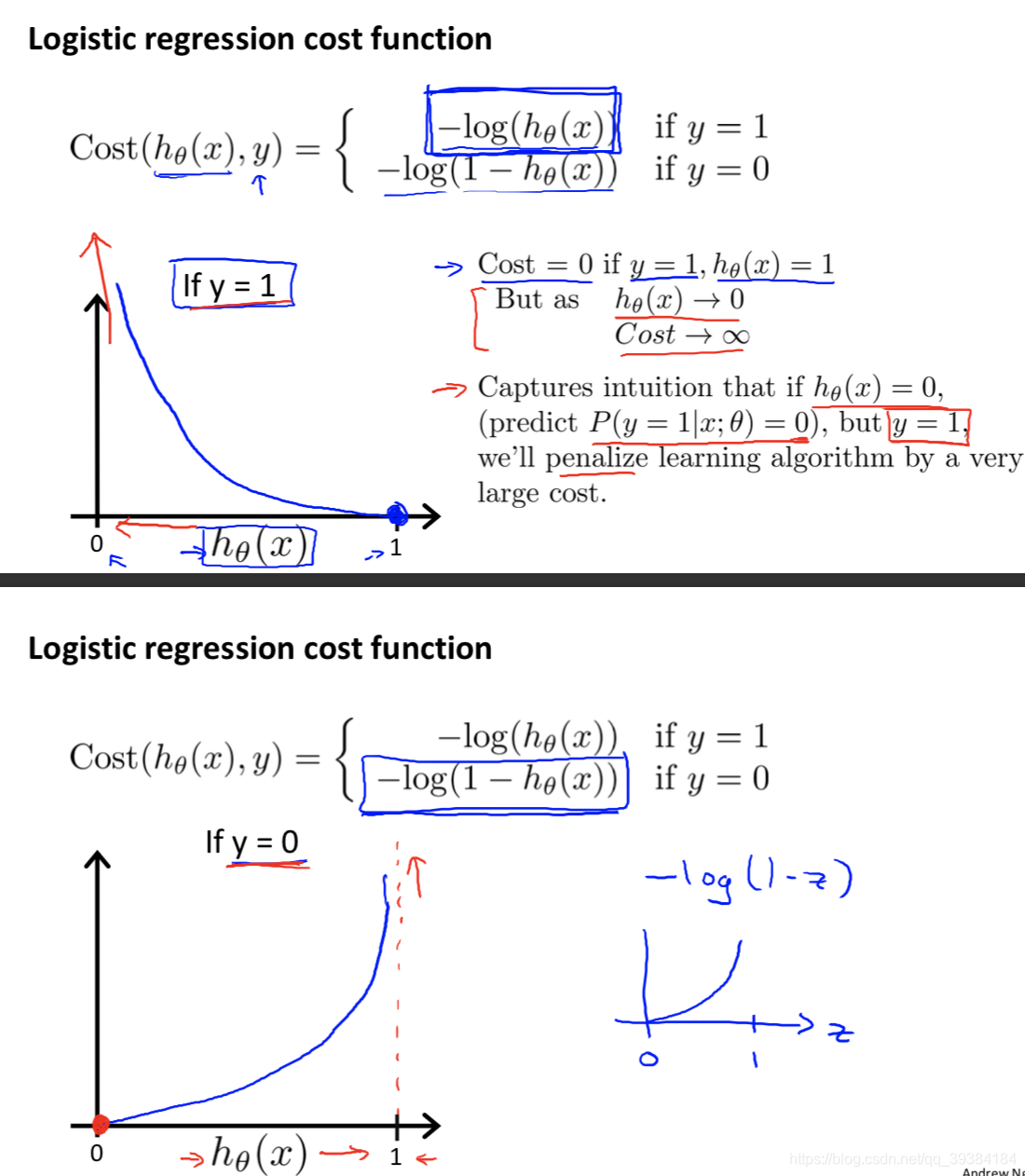

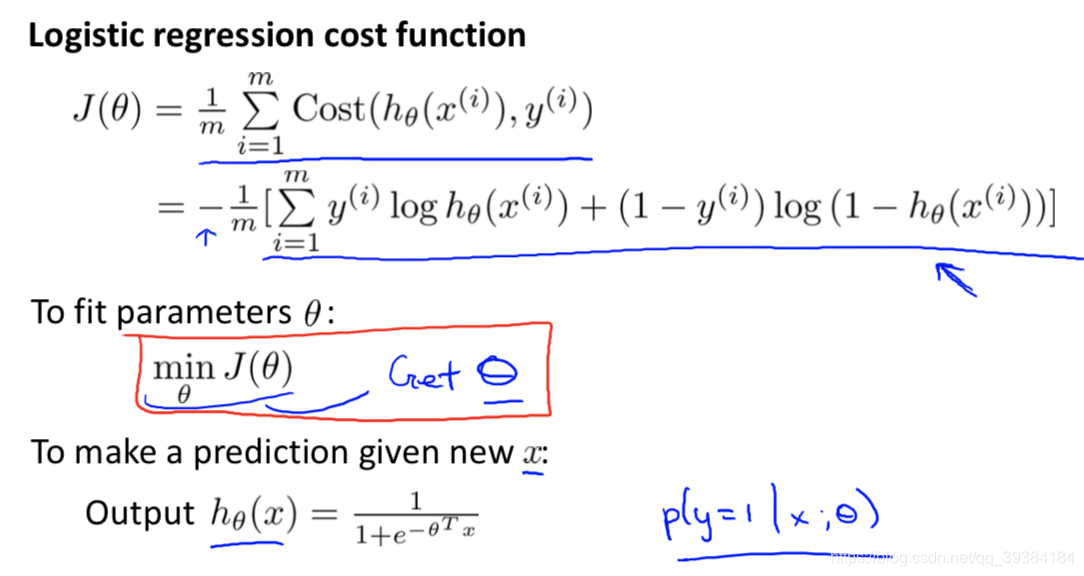

线性回归的损失函数使用平方和,逻辑回归的损失函数使用交叉熵。

线性回归

任务和模型

获取样本数据的一些特征,看作特征空间中的点,然后寻找线去拟合样本分布。

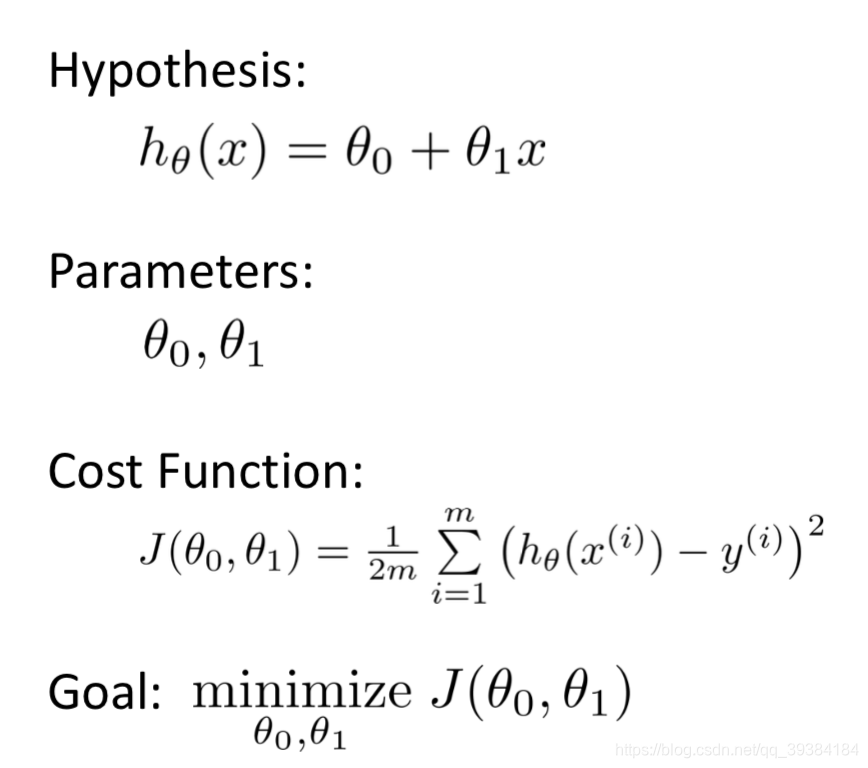

模型表示

训练集->学习算法->假设函数(h:是从 X 到 Y 的一个关系映射,可以是线性的,也可以是非线性的)

任务的损失函数

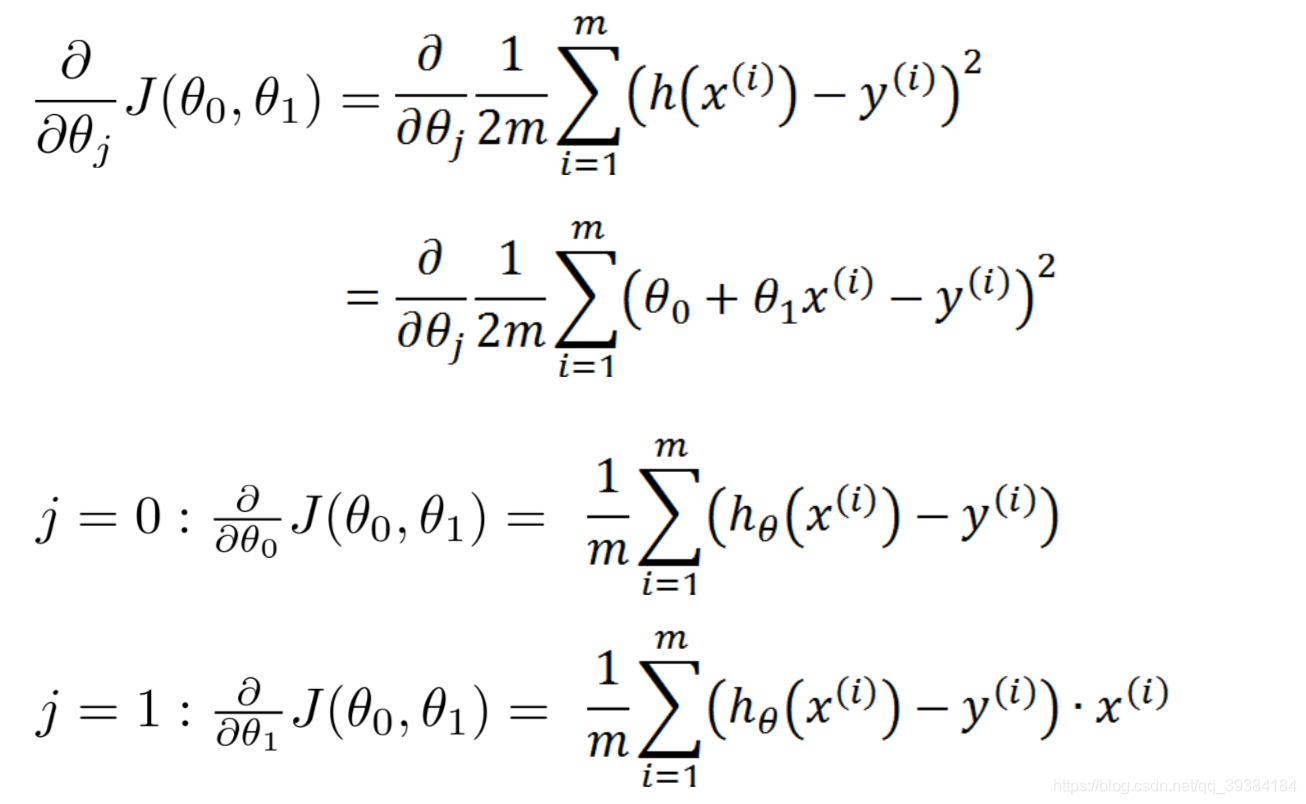

优化(梯度下降)

多元线性回归

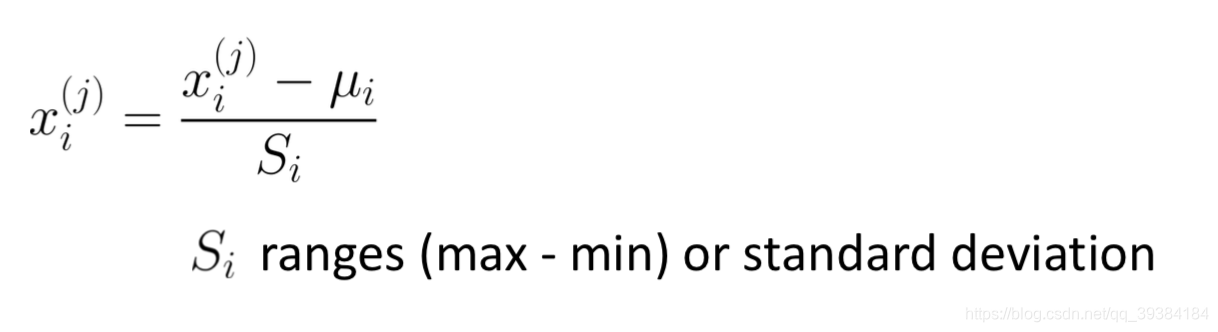

特征缩放

Make sure features are on a similar scale.

- better:(-1,1)

- maybe:(-1/3,1/3)or(-3,3)

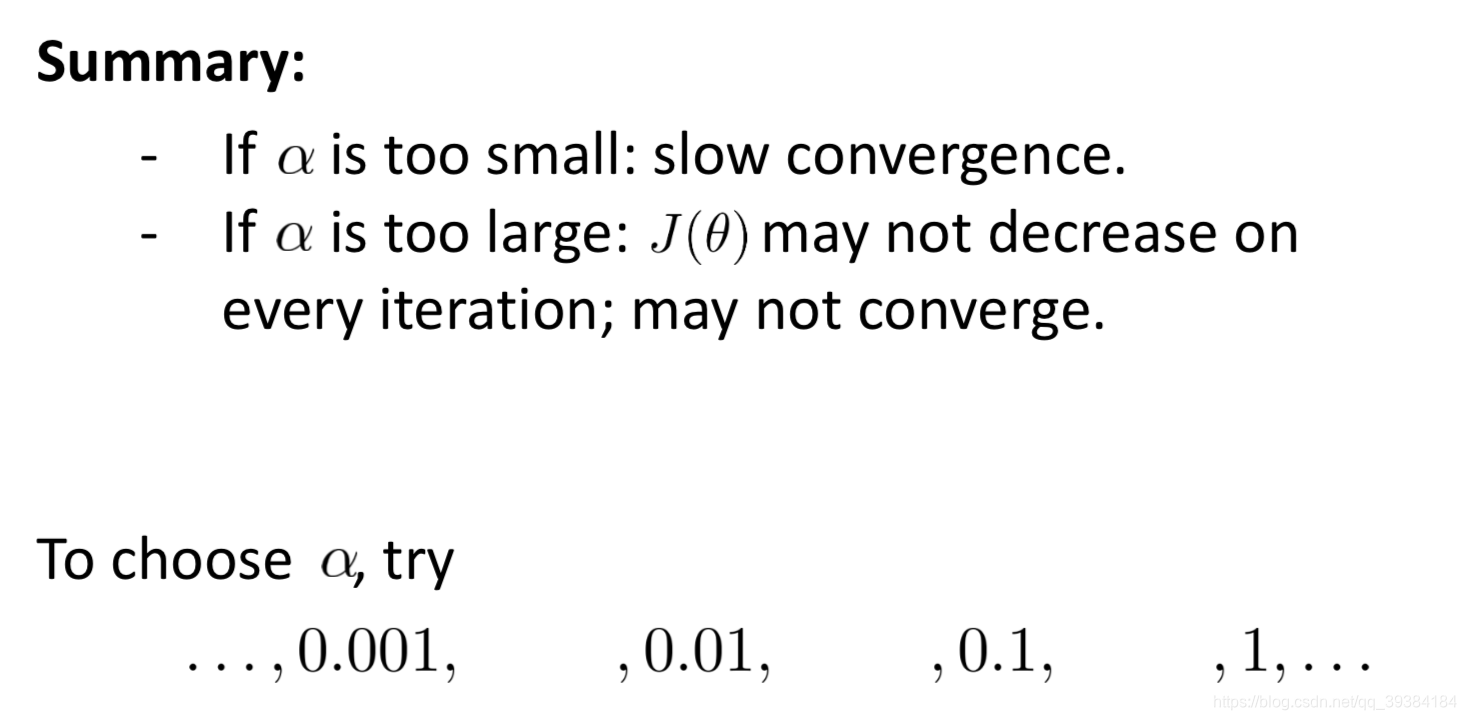

学习率

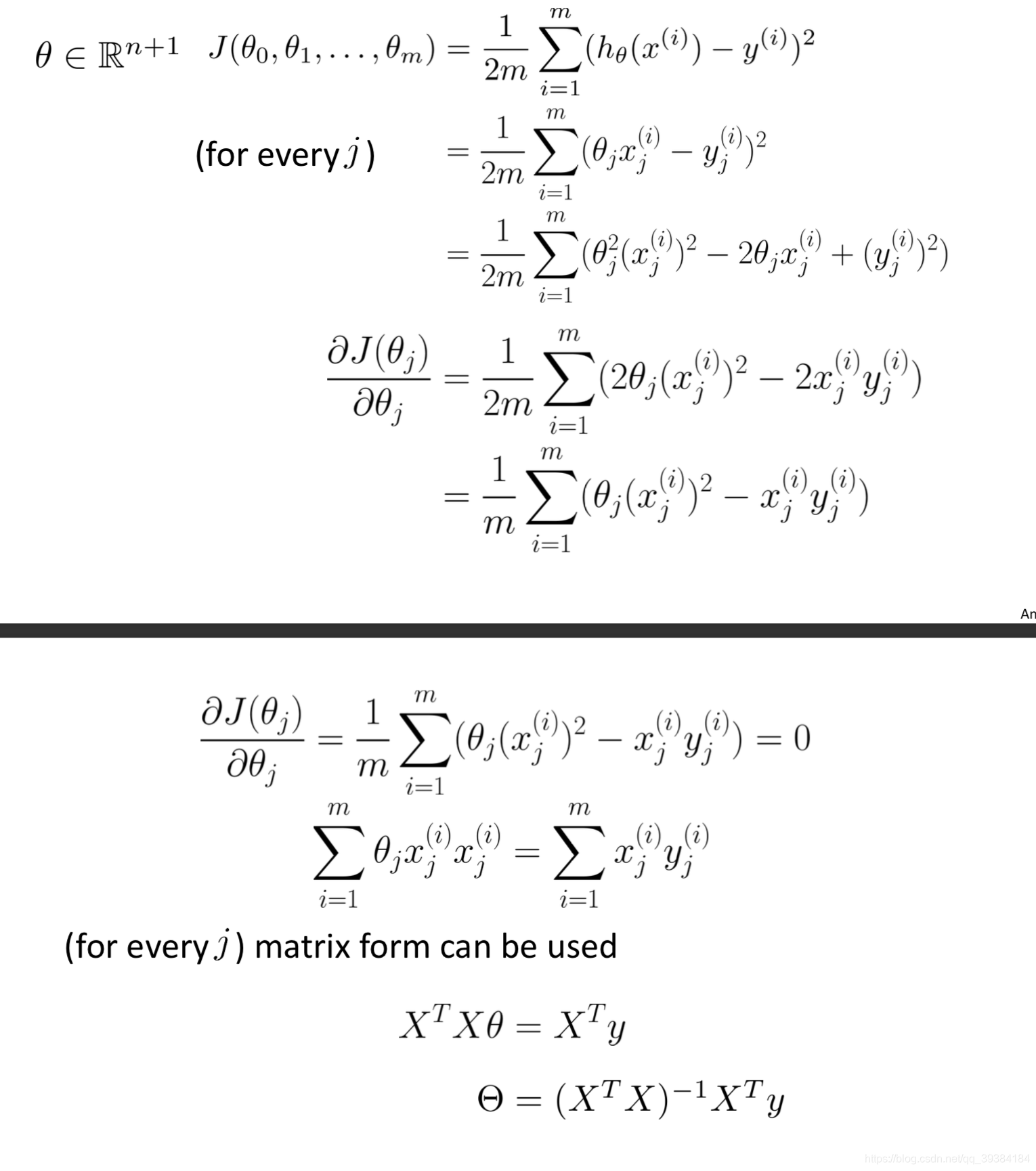

正态方程

若 X 不可逆,则存在冗余的特征,或特征数量太多。

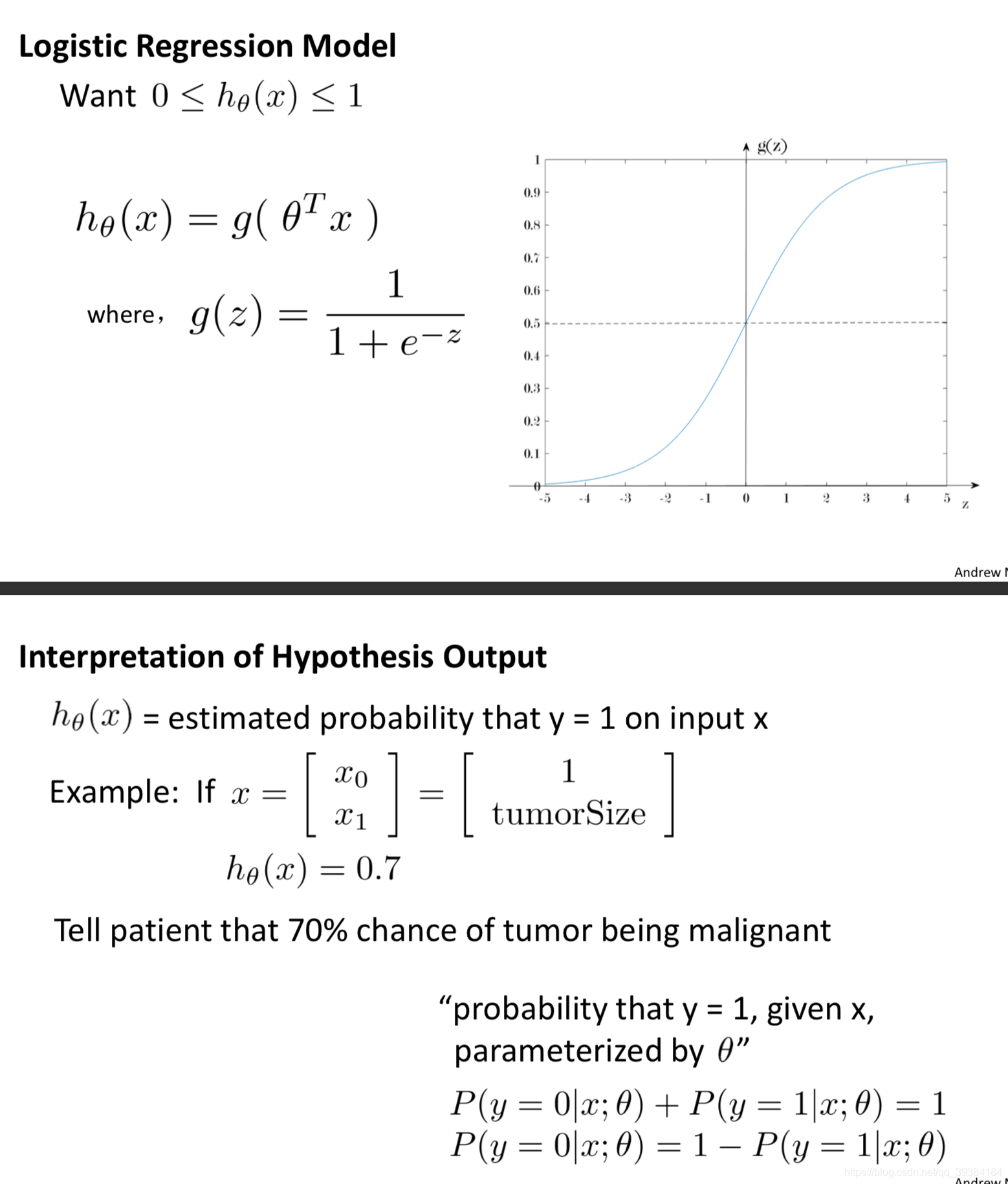

逻辑回归

假设表示

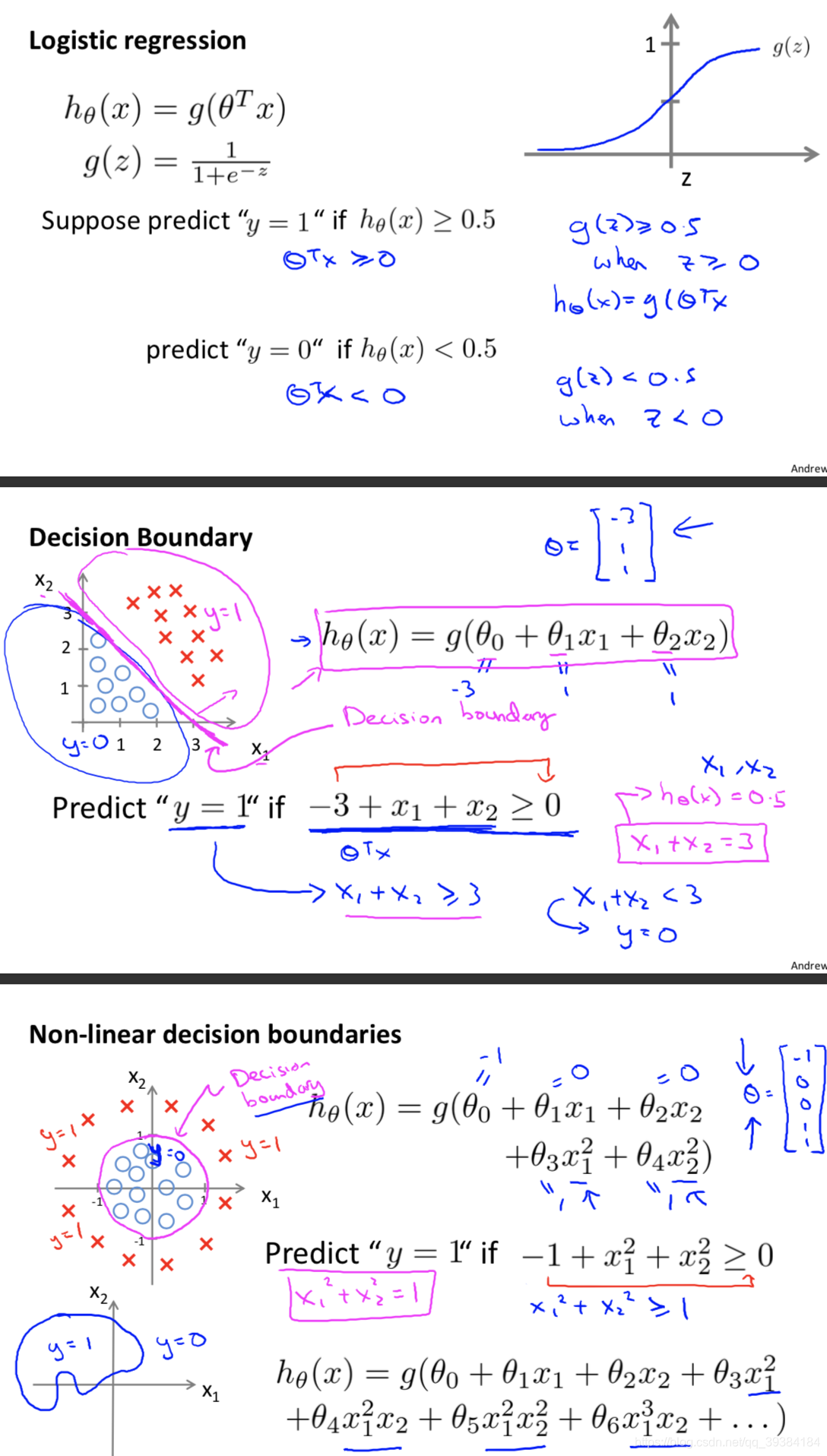

决策边界

也称为判决函数或决策函数。

损失函数

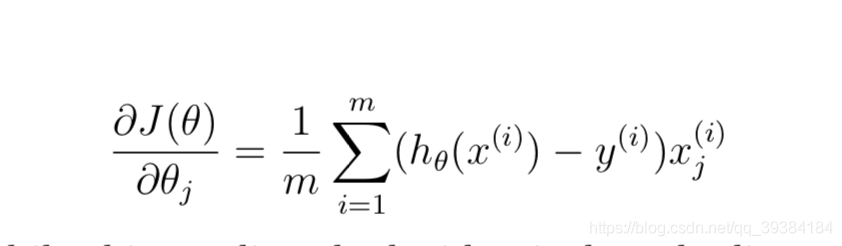

梯度下降

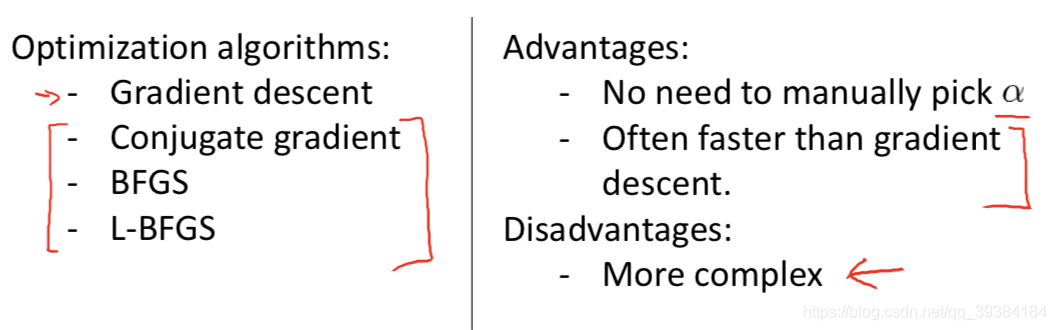

高级优化

通过 matlab 的 fminunc() 来实现。

多元分类:一对多

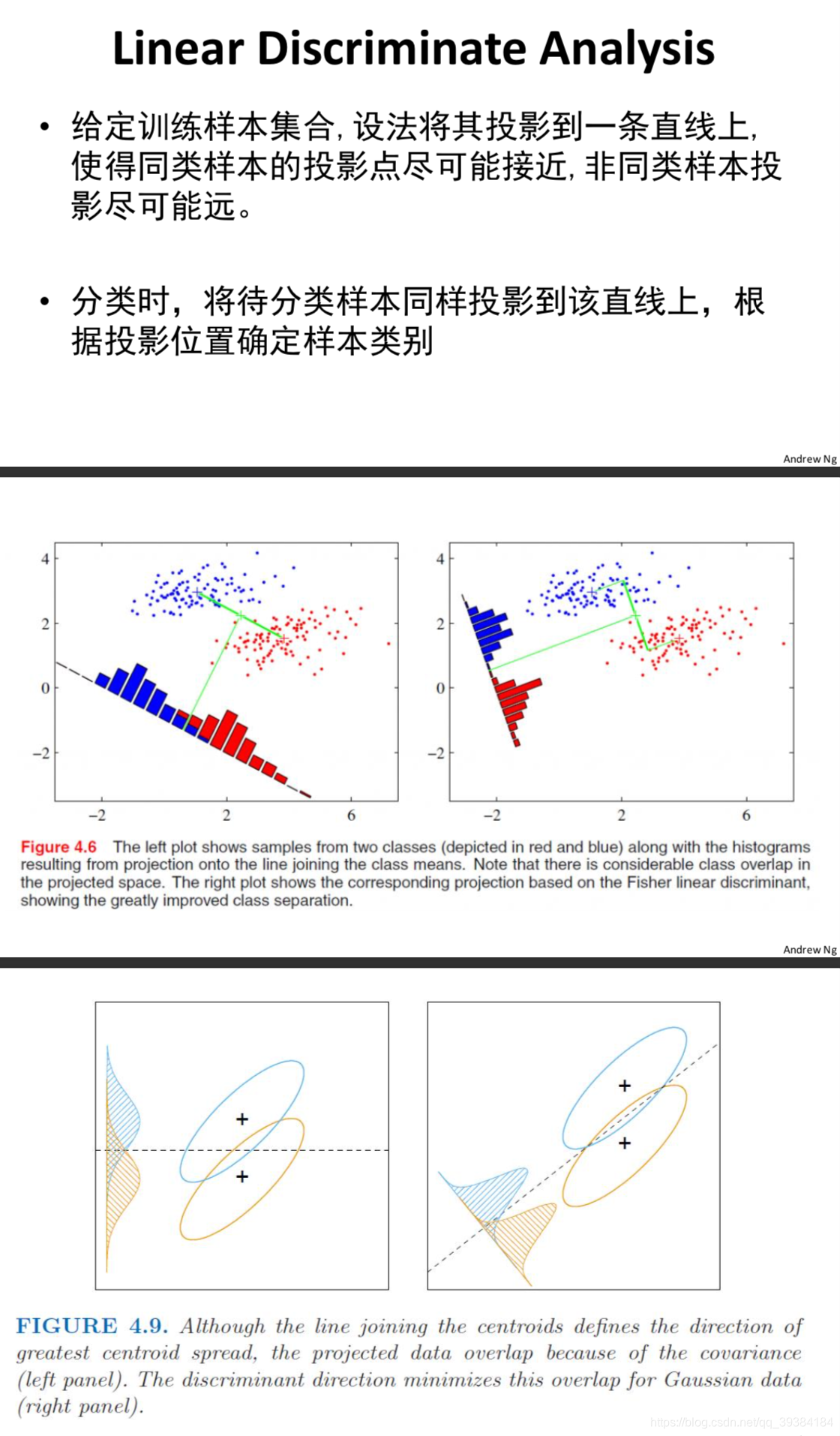

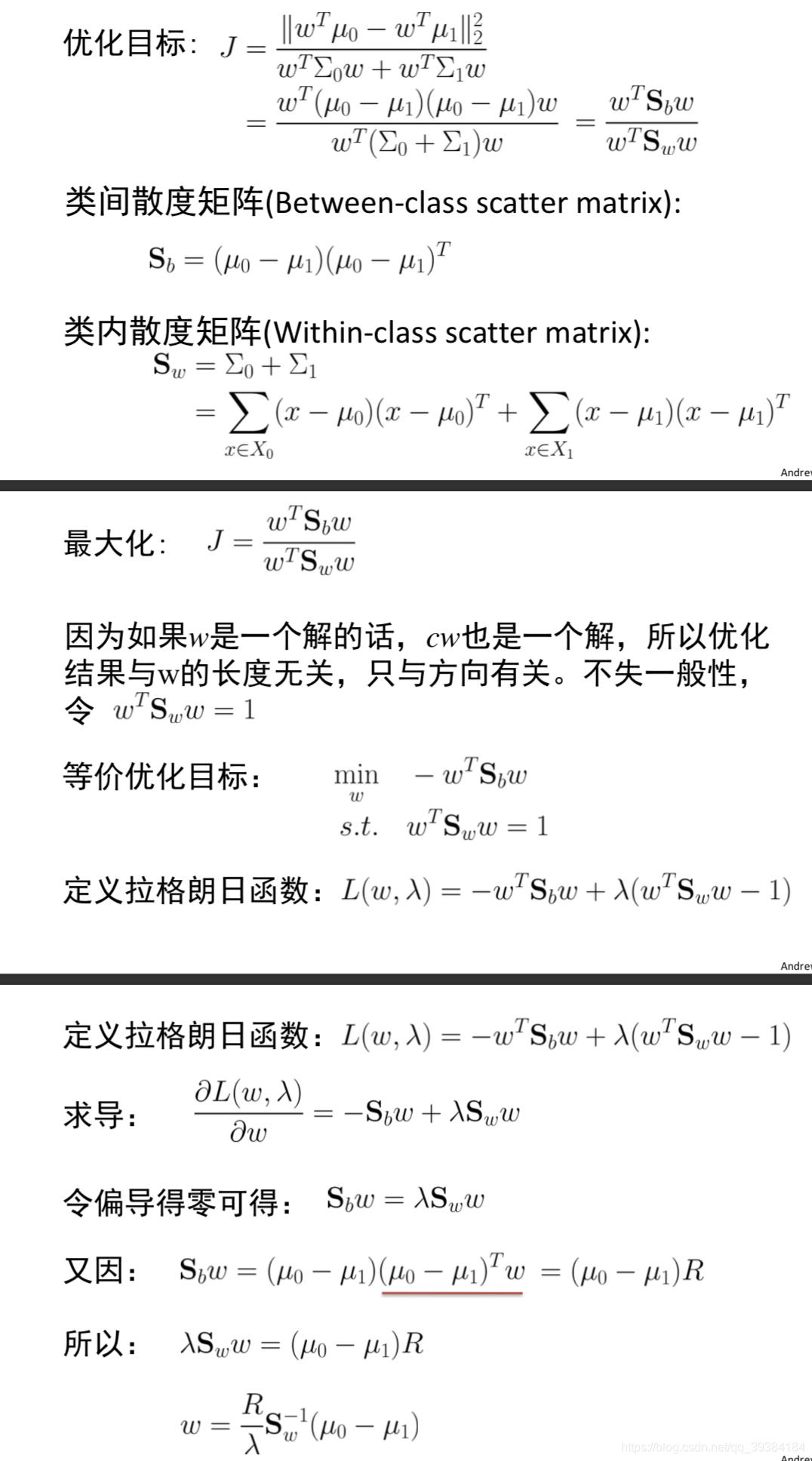

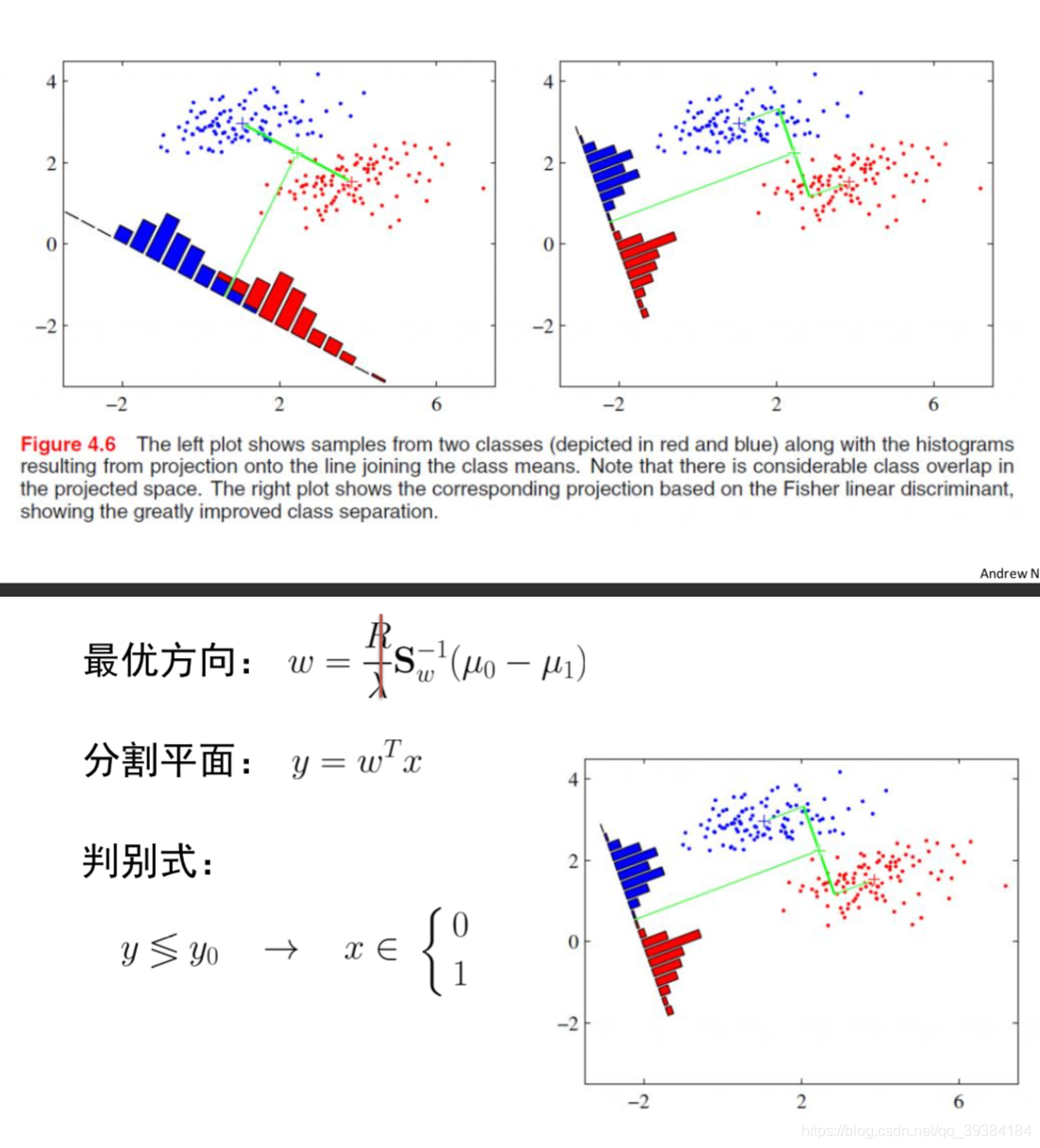

线性判别分析

1491

1491

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?