目录

一.开始

本文记录了在谷歌平台colab上使用yolov5训练自己的模型,包括具体流程和ipynb代码。使用前按照自己的需要,选择开通Google Drive云盘空间(我是开通了200G),以及Colab Pro+。使用colab的优点是价格较其他云平台较实惠,缺点是虚拟机不固定,每隔一段时间有人机验证,每次最多使用24小时(普通版是12小时)

二.修改并上传项目文件

出于方便修改的原因,我是在本地先下载yolov5项目,修改好具体代码,然后再上传到Google drive的。当然也可以在colab/drive中修改代码

1. 下载项目

到yolov5官网下载项目文件,本次项目选用了最新的V5.0版本

2. 制作yolo数据集

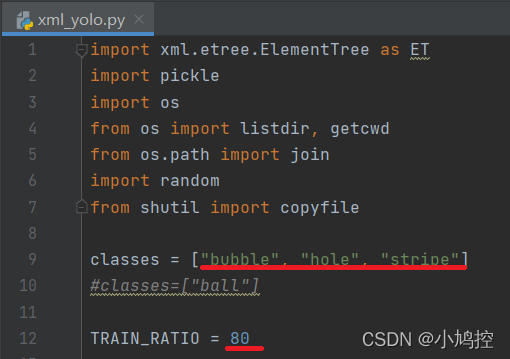

我首先是使用了ImgLabel标注自己的图像,制作原始数据集(由于之前做的项目是mmdet,所以不是yolo格式,是xml格式的);之后使用代码将xml数据集转换成YOLO格式即可;如图修改classes为自己项目的种类,TRAIN_RATIO是训练集的比例,这里设置成80%(测试集就为20%)

- 创建一个名为VOCdevkit文件夹,其子文件夹如下

VOCdevkit

——VOC2007

——ab.yaml(训练使用的文件)

————Annotations(放xml文件)

————JPEGImages(放jpg图片)

xml_yolo.py(和VOCdevkit同级目录)

之后运行xml_yolo即可得到yolo格式的数据集

ab.yaml的内容如下

train: ../VOCdevkit/images/train

val: ../VOCdevkit

本文介绍了如何在Google Colab上利用YOLOv5训练自定义目标检测模型的详细步骤,包括下载项目、制作YOLO格式数据集、修改参数、上传到Google Drive、在Colab环境中配置GPU、连接数据集、训练模型以及中断后的继续训练。

本文介绍了如何在Google Colab上利用YOLOv5训练自定义目标检测模型的详细步骤,包括下载项目、制作YOLO格式数据集、修改参数、上传到Google Drive、在Colab环境中配置GPU、连接数据集、训练模型以及中断后的继续训练。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5295

5295

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?