1.权限控制

Linux中的超级用户是root

HDFS文件系统中的超级用户:是启动namenode的用户

修改所属用户和组:hdfs dfs -chown [-R] root:root / xxx.txt

修改权限:hadoop fs -chmod [-R] 777 /xxx.txt

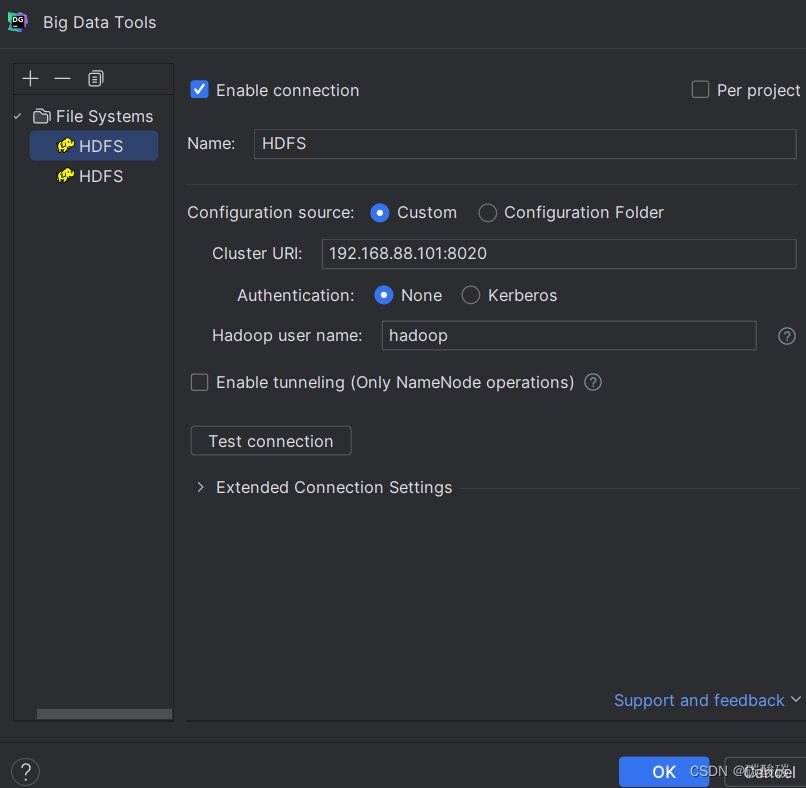

2.在DataGrip中安装使用BigData Tools插件

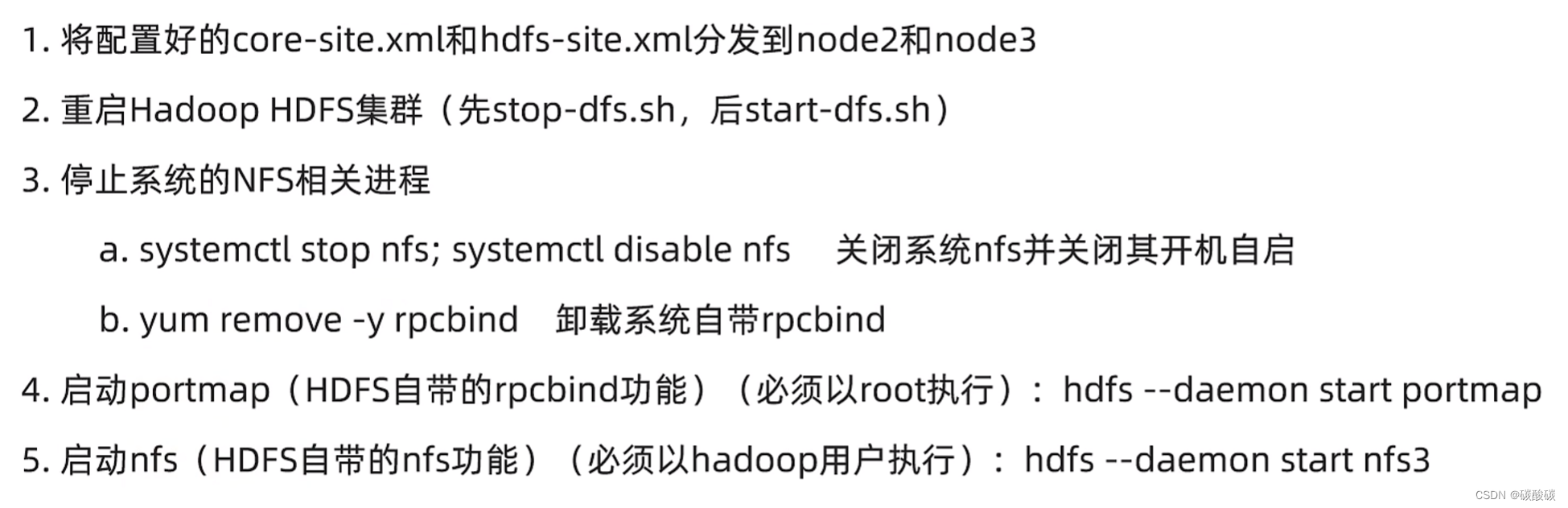

3.配置NFS

core-site.xml hdfs-site.xml新增配置项

开启portmap,nfs3两个新进程

core-site.xml:

<configuration>

<property>

<name>hadoop.proxyuser.hadoop.groups</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.hadoop.hosts</name>

<value>*</value>

</property>

</configuration>

hdfs-site.xml:

<configuration>

<property>

<name>nfs.superuser</name>

<value>hadoop</value>

</property>

<property>

<name>nfs.dump.dir</name>

<value>/tmp/.hdfs-nfs</value>

</property>

<property>

<name>nfs.exports.allowed.hosts</name>

<value>192.168.88.1 rw</value>

</property>

</configuration>

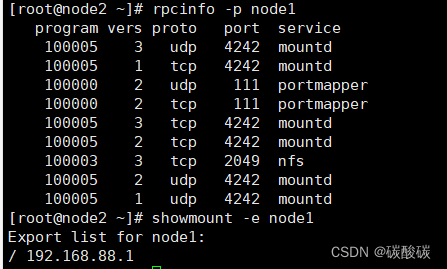

测试:在node3中:

结果正常

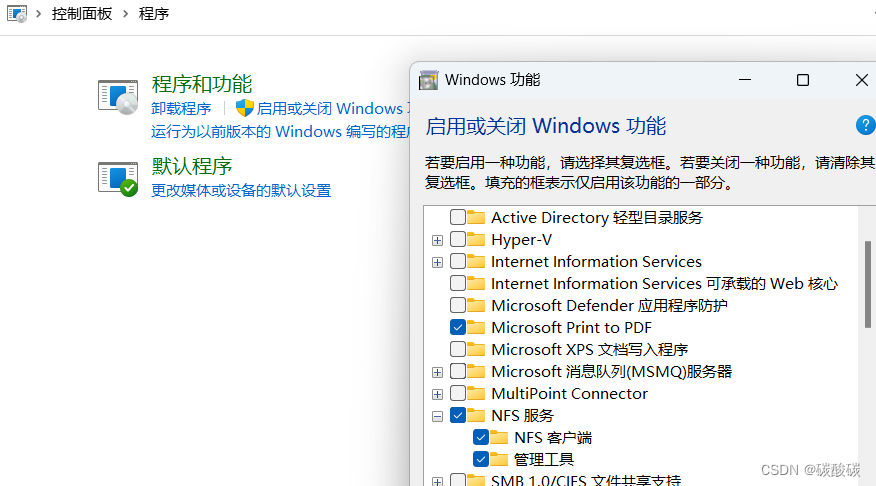

在windows中需要开启NFS功能:

需要window11专业版,家庭版没有这个功能

4.在windows中挂在HDFS文件系统

在cmd中输入

net use X:\\192.168.88.101\!

596

596

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?