开发环境

- 虚拟机Ubuntu 16.04

- 编辑器VsCode

- 交叉编译工具 arm-linux-gnueabihf

- 已制作文件系统,已使能UVC相关驱动

- 正点原子ZYNQ7010启明星开发板

- USB摄像头淘宝随便买的一个

移植libjpeg

下载源码

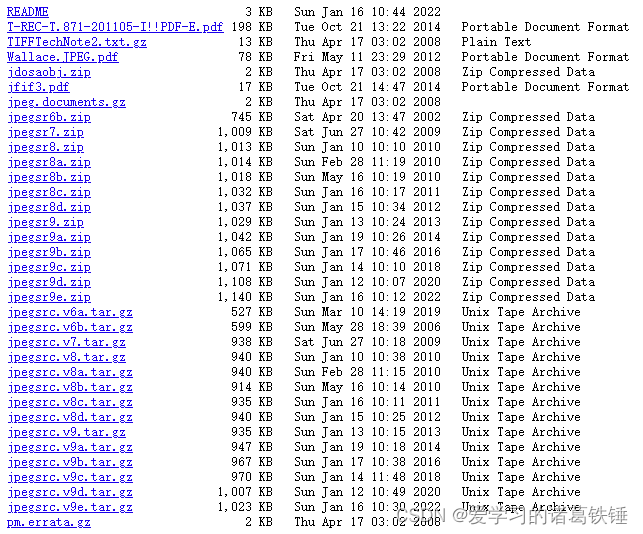

libjpeg源码地址: libjpeg

下载最新的tar.gz即可,我这里下载的是jpegsrc.v9e.tar.gz,将其拷贝到Linux虚拟机某目录下并解压

编译libjpeg

首先创建一个libjpeg库的安装目录,比如在/home/tools目录新建一个名为jpeg的目录

然后进入刚才解压的源码包 jpeg-9e 下,执行以下命令对工程进行配置

./configure --host=arm-linux-gnueabihf --prefix=/home/tools/jpeg/

--host 选项用于指定交叉编译得到的库文件是运行在哪个平台,我这里要运行在ZYNQ开发板上

--prefix 选项则用于指定库文件的安装路径,这里就可以指定在刚才创建的名为jpeg的目录下

配置好之后就可以开始make了,依次执行以下命令

make

make install

编译好之后,创建的名为jpeg的目录下就有以下内容

移植到开发板

进入该安装目录,将 bin 目录下的所有测试工具拷贝到开发板系统/usr/bin 目录

将 lib目录下的所有库文件拷贝到开发板系统/usr/lib 目录

拷贝 lib 目录下的库文件时,需要注意符号链接的问题, 不能破坏原有的符号链接

所以可以将 lib 目录下的所有文件打包成压缩包的形式,比如在目录下用此命令 tar -czf lib.tar.gz ./*

之后拷贝到开发板之后解压即可,搞定!

移植mjpeg-streamer

下载源码

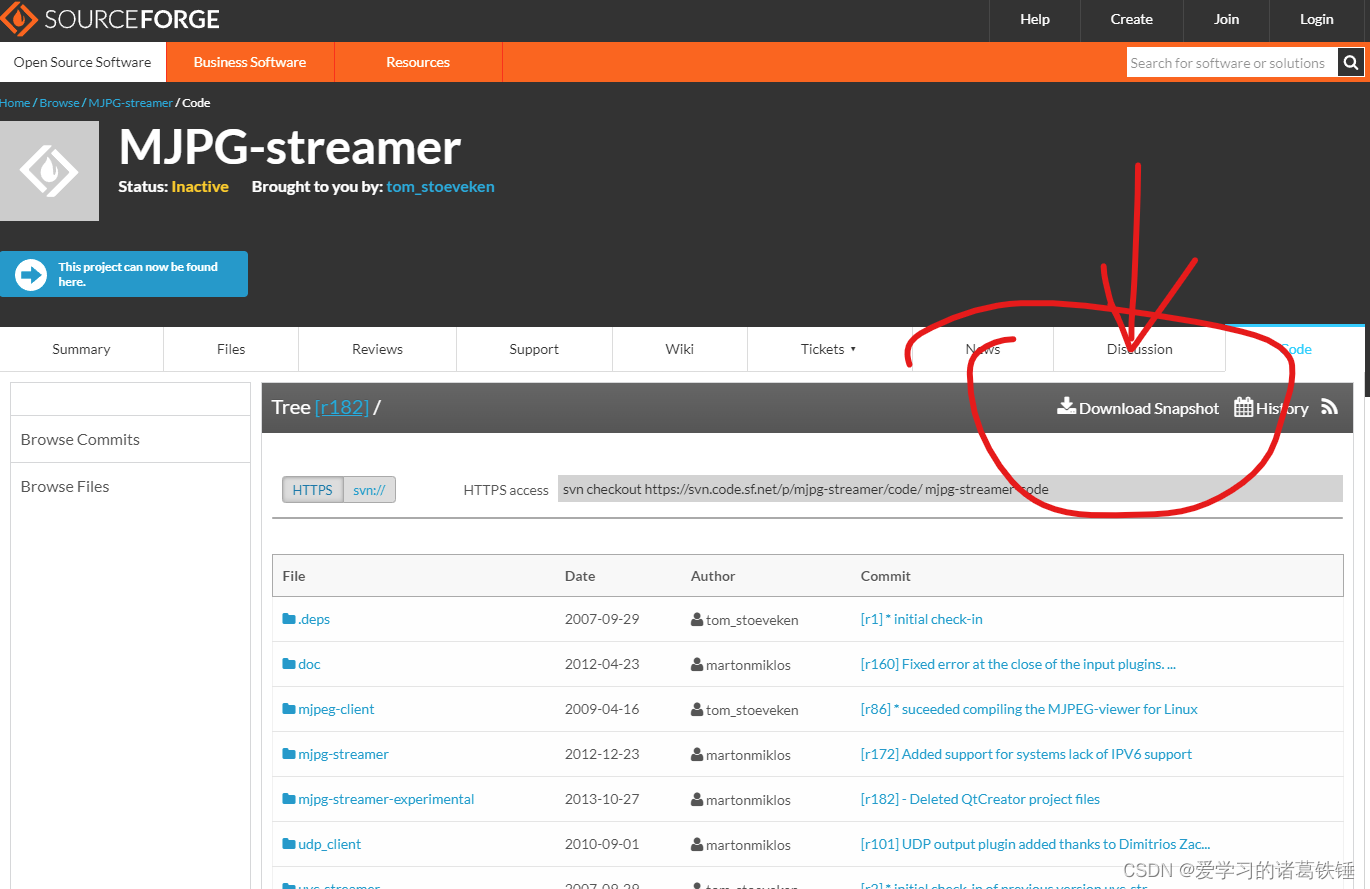

mjpeg-streamer源码地址: mjpeg-streamer,点击下载源码包

拷贝到Linux虚拟机某目录下,解压。解压好之后有以下目录

编译mjpg_streamer

进入到mjpg_streamer目录下,进行以下操作

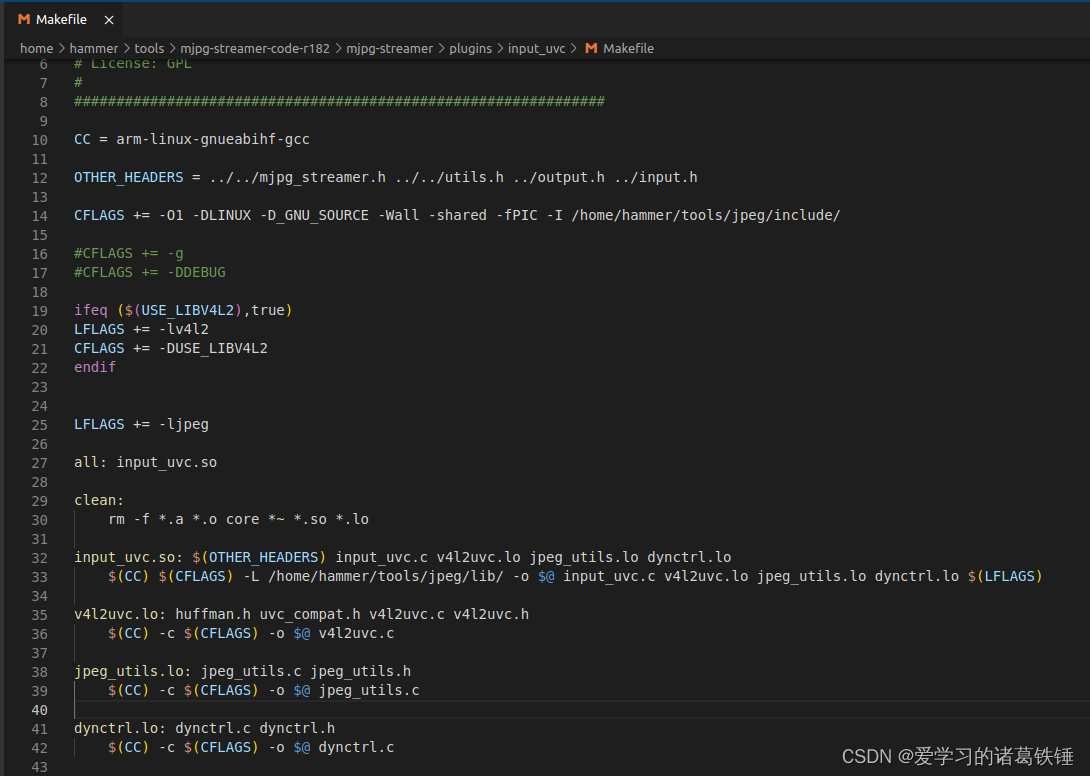

- 修改该目录的Makefile以及子目录plugins中的各级Makefile,将所有

CC=gcc换成CC=arm-linux-gnueabihf-gcc(视个人交叉编译工具修改) - 在/plugins/input_uvc/Makefile 文件中的第14行代码

CFLAGS += -O1 -DLINUX -D_GNU_SOURCE -Wall -shared -fPIC后面添加-I /home/tools/jpeg/include/

(上一节移植的jpeg安装目录下的include目录路径) - 在/plugins/input_uvc/Makefile 文件中的第32行代码

$(CC) $(CFLAGS) -o $@ input_uvc.c v4l2uvc.lo jpeg_utils.lo dynctrl.lo $(LFLAGS)后面添加-L /home/tools/jpeg/lib/

修改好之后大概就是这样子

最后在mjpg-streamer目录下执行 make 命令编译即可

移植到开发板

将整个mjpg-streamer目录复制到开发板,可以使用命令scp -r root@ip_addr:/home/tools/mjpg-streamer

测试一下显示效果

启动开发板,插上USB摄像头,进人mjpg-streamer目录,执行以下命令可以查看如何使用mjpg-streamer

./mjpg_streamer --help

执行以下命令就可以显示视频了

./mjpg_streamer -i "./input_uvc.so -d /dev/video1 -f 30 -r 1280*720 -y" -o "./output_http.so -w ./www"

其中-d /dev/video1 -f 30 -r 1280*720 -y 参数指定了设备/dev/video1 ,帧数30fps,分辨率1280*720

然后打开任意一个网页输入地址http://board_ip_addr/?action=stream 就可以看到视频了(确保开发板能上网)

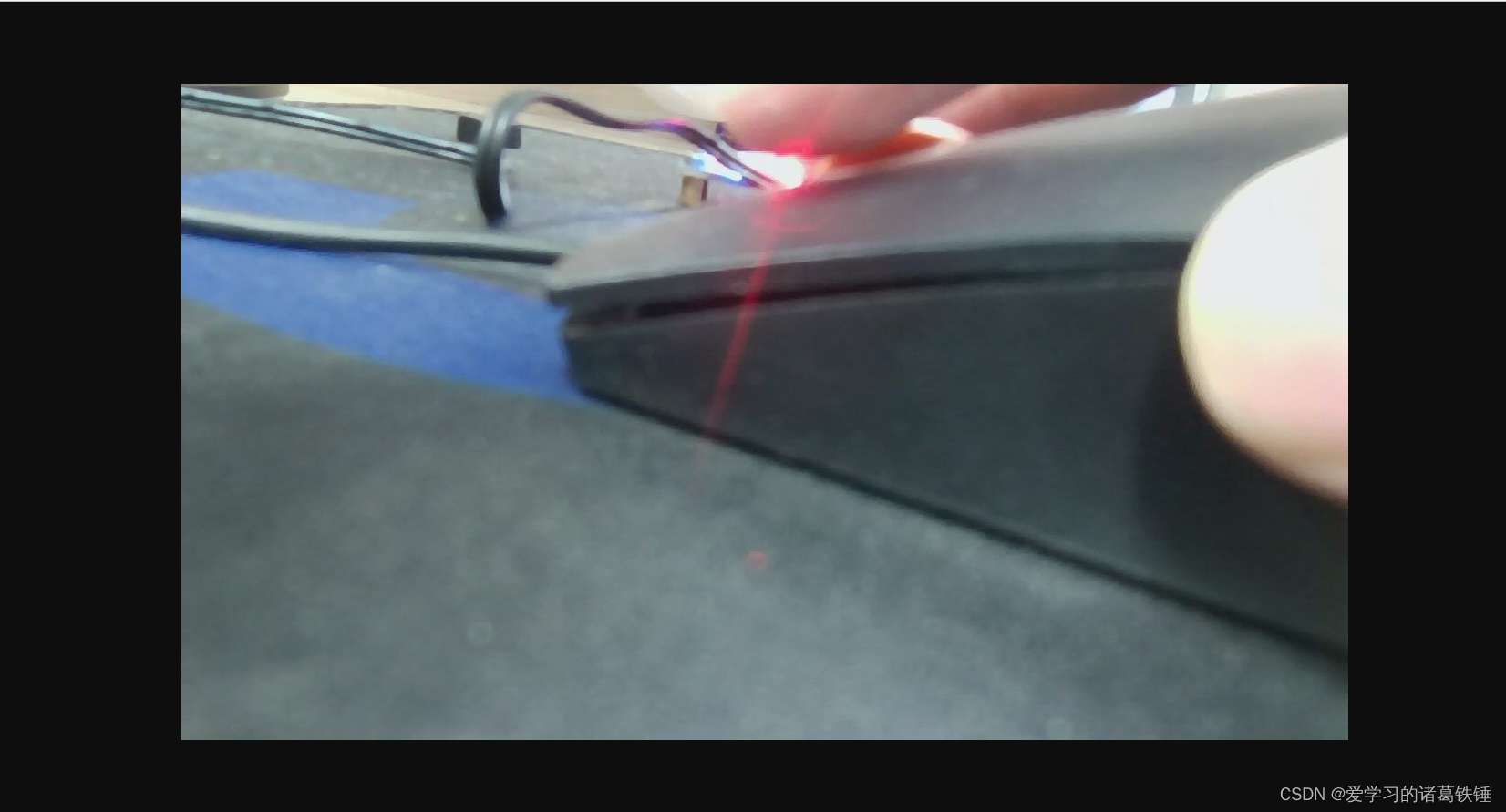

显示效果

帧数太低了,延迟太明显,仅仅试着玩玩,这样是指定不行的

903

903

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?