论文链接:https://arxiv.org/pdf/2309.12585

Code: https://github.com/mkang315/BGF-YOLO

来源: Medical Image Computing and Computer Assisted Intervention – MICCAI 2024

摘要:

针对脑肿瘤检测的新型深度学习模型,名为BGF-YOLO。该模型基于YOLO系列检测器,结合了三大创新技术:双层路由注意机制(Bi-level routing attention)、通用特征金字塔网络(Generalized feature pyramid networks)和第四检测头(Fourth detecting head)。这些改进使模型能够更有效地关注关键信息,同时丰富特征表达,通过融合高层语义特征与空间细节,提升检测性能。

具体而言:

- 注意机制(attention mechanism)帮助模型更关注重要特征,从而提升检测的准确性。

- 特征金字塔网络(feature pyramid networks)通过不同尺度的信息融合,增强模型对不同大小和特征的肿瘤的检测能力。

- 新增的第四检测头(Fourth detecting head)扩展了模型的尺度覆盖范围,使其能更好地检测各种尺寸的脑肿瘤。

实验结果显示,BGF-YOLO在脑肿瘤检测数据集Br35H上,比原始的YOLOv8x模型提升了4.7%的mAP50(平均精度值,衡量检测性能的标准指标),达到了业界的最新水平(state-of-the-art)。

1. 引言

早期诊断可以带来更有效的治疗和更好的预后。脑MRI是检测脑肿瘤的最佳影像手段,而YOLO系列在此任务中已被证实具有较高的准确性。Kang等人提出了基于channel shuffle和重新参数化卷积技术的RCS-YOLO模型,在平衡检测精度和速度方面表现良好。

关于YOLOv8架构,主要由三个部分组成:骨干(backbone)、颈部(neck)和头部(head)。骨干负责特征提取,包含卷积(Conv)、C2f(捷径)和空间金字塔池化(SPPF)模块。C2f模块较YOLOv5中的C3结构更轻量,增强了特征表达能力。SPPF模块则提升了对不同尺度特征的捕获能力。

在颈部部分,使用了特征金字塔网络(FPN)和路径聚合网络(PANet)实现多尺度特征融合,将浅层信息和深层信息有效结合。头部结构采用解耦设计,将分类和回归分开,避免任务之间的冲突,同时采用无锚机制(anchor-free)以更好检测不规则大小的目标。损失函数方面,YOLOv8使用二元交叉熵损失(binary cross-entropy)和方差焦点损失(varifocal loss),同时配合使用完整交并比(CIoU)损失以减少边界框重叠。

最新的YOLOv8改进集中于注意力机制、多尺度特征融合网络和回归损失的优化。例如,MHSA-YOLOv8引入了多头自注意力机制,轻量化版本结合双路径门控注意力和特征增强模块,亦有采用不对称特征金字塔网络(AFPN)、BiFormer块、WIoU等技术的变体。

在本文提出了BGF-YOLO模型,主要通过以下创新措施提升检测性能:

- 重新设计了YOLOv8的颈部,采用基于GFPN的结构化特征融合网络,以加强不同层级的特征融合能力。

- 引入

BRA(Bi-level Routing Attention),结合动态和稀疏注意力机制,更好地关注重要特征,减少冗余。 - 增加第四个检测头,将尺度范围扩展到更大的对象,有助于检测不同大小的脑肿瘤,并优化回归损失以提升准确性。

综上,这些改进旨在增强模型的特征表达和尺度适应能力,从而提升脑肿瘤的检测效率和准确性。

2. 方法

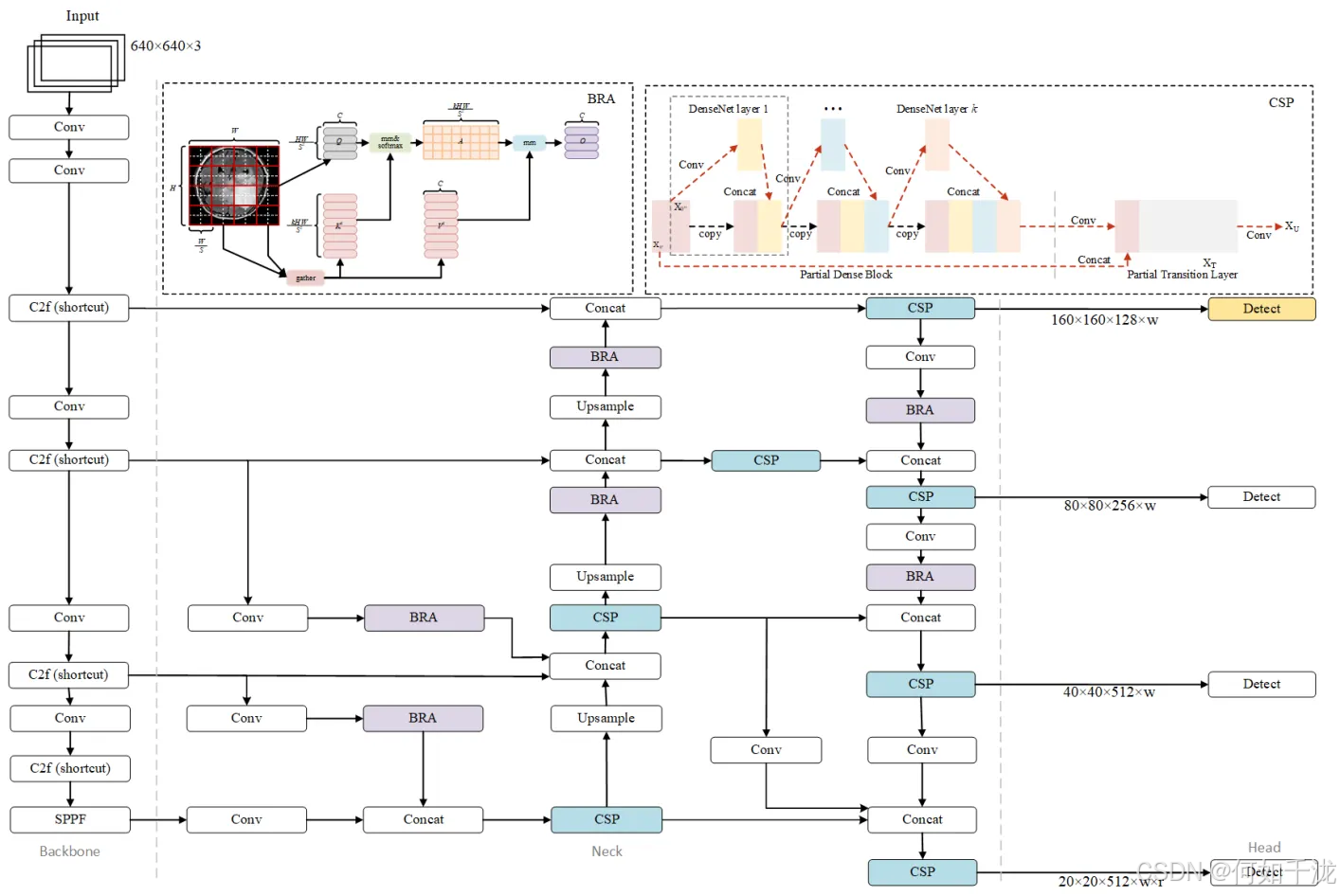

BGF-YOLO的整体架构:

- BGF-YOLO的“neck”部分比传统的YOLOv8更深、更复杂(“very deep and heavy”),而YOLOv8的neck部分较轻。这个“heavy”设计意味着它加强了多层特征融合能力,有助于捕获不同尺度和细节信息。

- backbone(骨架)和head(检测头)部分沿用YOLOv8的设计,但“neck”进行了特殊优化。

2.1 增强的GFPN(Generalized Feature Pyramid Network):

背景:在深度学习中,为了检测不同尺寸的目标(如各种大小的脑肿瘤),需要有效融合不同层次的特征信息。

- FPN(特征金字塔网络)最早提出解决阶层特征融合的问题,帮助模型融合不同尺度的特征,从而提升检测多尺度目标的能力。

- PANet(Path Aggregation Network)加强特征传播,促进信息的重复利用和特征的表达。

- BiFPN(Bidirectional FPN):在FPN基础上增加了自底向上路径,使特征融合更高效,可以同时利用低层和高层信息。

- GFPN(Generalized-FPN):基于“密集连接”和“皇后融合”策略(queen fusion),用串联(concat)操作替代相加,减少信息损失,提升融合效果。

- AFPN(Adaptive Spatial Fusion):采用自适应空间融合,从底层特征到更高级别的特征逐步融合,增强关键层特点,减轻不同目标之间信息冲突的问题。

在YOLOv5和YOLOv8中的应用区别:

- 两者都用FPN和PANet进行多尺度融合,但YOLOv8的“neck”用C2f(无shortcut)模块替换了YOLOv5中的C3模块,简化了结构。

具体的改造措施(模型优化):

- 多路径融合强化:通过增强不同层之间的连接,提高多层特征的融合能力,这对脑肿瘤检测至关重要,因为肿瘤大小、形状、位置变化很大。

- 引入CSP(Cross Stage Partial DenseNet):替代C2f模块,加入跳跃连接(skip connections)和稠密连接(dense connection),使模型可以在不同尺度间共享信息。

- 这让模型同时关注低层空间细节和高层语义信息,提高对多样肿瘤特征的表达能力和鲁棒性,尤其是在脑肿瘤尺寸和类型多变的情况下表现更优。

2.2 BRA(Bi-level Routing Attention)注意机制:

多尺度特征融合的挑战:在YOLOv8的“颈部”部分,不同网络层提取的特征图被融合,以提升多尺度目标检测性能。然而,这个融合层存在冗余信息的问题,即不同特征图中包含重复或无关的信息,从而影响检测准确性。

引入注意机制的目的:为了克服这个问题,作者考虑在特征融合过程中加入注意机制,这种机制可以根据特征的重要性进行加权,突出相关特征,抑制无关特征,从而提升模型性能。

现有的注意机制类型:文中提到五种具有潜力的注意机制:

- SE(Squeeze-and-Excitation):通道注意,用于调整每个通道的响应,以建模通道之间的依赖关系。

- ECA(Efficient Channel Attention):只关注局部通道交互,计算量较低。

- RFA(Receptive-Field Attention) 和 BRA:空间注意机制,增强特征中的空间关系。

- CBAM 和 CA:同时支持通道和空间的注意。

BRA的特点与优势:

- 是一种“动态、查询感知的稀疏注意机制”。

- 只关注每个“查询”对应的少量最相关的“键/值”,实现内容感知的稀疏匹配。

- 通过分区域(segmenting)和线性变换产生查询、键、值。

- 构建有向图(通过邻接矩阵)以定位不同区域之间的关系。

- 使用多头自注意力(multi-head self-attention)在区域间进行调度,重点关注脑部肿瘤区域。

具体的融合方法:

- 将BRA模块放置在卷积或上采样后,用于特征融合,增强模型对目标区域(如肿瘤部分)的关注。

- 通过“区域级关系”的匹配,减少无关区域的干扰,提取最相关的特征。

- 采用“二层路由优化”,引导模型更专注于MRI扫描中潜在的肿瘤区域,提升检测准确性。

总结作用:

- 利用BRA模块实现高效、多尺度的特征融合。

- 去除冗余信息,突出重点区域,提高对肿瘤等微妙特征的检测能力。

- 该方法唯一使用了BiFormer中的BRA模块,而没有将整个BiFormer集成到YOLOv8中。

2.3 增强检测头

原始YOLOv8的检测头:

- 具有三个检测头,分别对应不同的尺度:20×20、40×40 和 80×80。

- 这些尺度主要用于检测不同大小的目标,但对于脑肿瘤检测,特别是较大或多样化大小的肿瘤,原有的尺度不足以满足需求。

引入更大尺度的检测头:

- 增加一个新的检测头,尺寸为160×160,与特征融合网络的新结构相匹配。

- 这个“第四检测头”被加入到原有的80×80尺度检测头旁边。

功能和优势:

- 新的检测头融合了输入图像的浅层信息(来自C2f模块的shortcut信息),利用额外的特征融合网络增强特征信息。

- 这使得模型能够检测各种尺度的目标,特别是更大或不同尺度的肿瘤。

应用场景的好处:

- 不同大小的肿瘤具有不同的特征,增加检测头有助于模型能更准确地识别和定位这些不同尺度的肿瘤。

- 逐步检测(progressive detection)策略:模型可以先识别潜在区域,然后通过后续细化提高检测完全性和精确性,从而提升整体检测的鲁棒性和准确率。

3. 实验和结果

3.1 数据详情

数据集介绍:数据集名为Br35H,包含801张带有标注脑肿瘤的MRI图像。

数据集的划分:

- 训练集:500张图像,用于模型训练。

- 验证集:201张图像,用于调优模型参数和验证模型性能。

- 测试集:100张图像,用于最终的测试评估。

评估方式:所有的实验结果都是在测试集上进行测试得出的,也就是说,用于评估模型性能的指标(如精确率、平均精度等)都是基于测试集的表现。

3.2 实现细节

具体硬件如下:

- CPU:Intel QR Xe(型号可能为Xeon系列)的一台铜;

- CPU频率:2.50 GHz;

- GPU:NVIDIA GeForce GTX 1060 6GB显卡。

所有的模型训练都采用了YOLOv8x的架构作为基础。关于训练参数(超参数):

- 批量大小(batch size):设为5;

- 训练轮数(epochs):共120轮;

- 优化器:采用随机梯度下降(SGD),

- 初始学习率:0.01,

- 最终学习率:0.01(可能在训练过程中保持不变或有调整),

- 动量(momentum):0.937。

3.3 结果

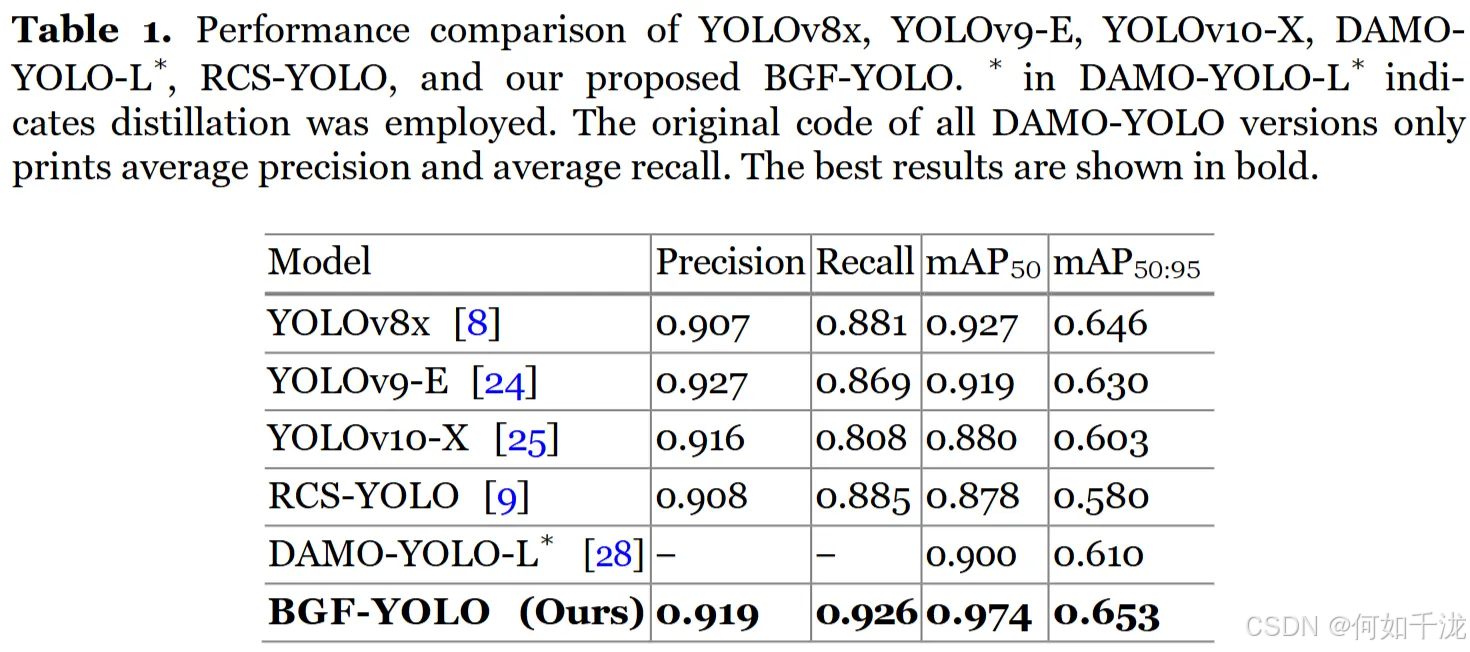

选择了各种竞争模型中表现最好的版本,并采用了与它们相同的评估指标。根据表1的结果,BGF-YOLO在以下几个方面比YOLOv8x模型有明显的性能提升:

- 精确率(Precision)提高了1.2%,

- 平均精度(mAP50)提高了4.7%,

- mAP50:95(针对不同IoU阈值的平均精度指标)提高了0.7%。

此外,BGF-YOLO还优于其他几款先进的检测模型,包括YOLOv9-E、YOLOv10-X、RCS-YOLO和DAMO-YOLO-L*。它不仅超越了基本的YOLOv8模型,还优于采用GFPN结构的DAMO-YOLO以及速度快且高精度的RCS-YOLO。

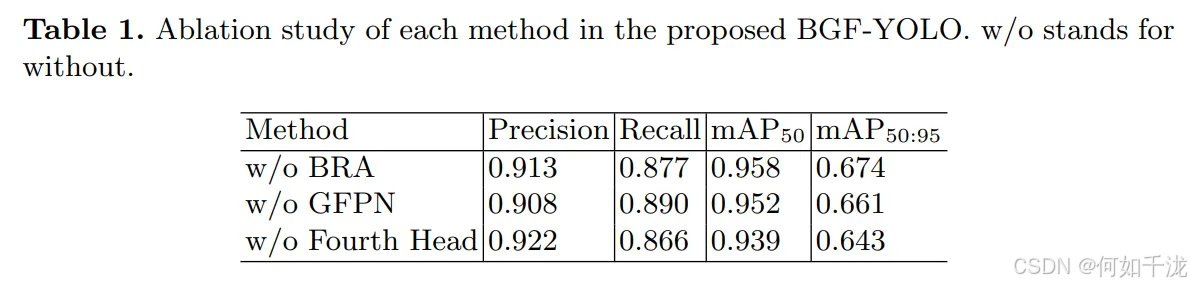

3.4 消融实验

整体架构的消融分析:评估了四个不同的简化版BGF-YOLO模型,即分别去除不同的模块(BRA、GFPN、第四检测头、GIoU)。

结果显示:

- BRA(Bi-level Routing Attention):引入注意机制,显著提升模型性能。

- GFPN(Generalized-FPN):有效改进多尺度特征融合。

- 第四检测头:对准确率(特别是mAP50)影响最大,提升最明显。

- GIoU(Generalized IoU):作为回归损失之一,也对模型表现有贡献。

- 未使用GFPN(w/o GFPN)意味着继续用原始的YOLOv8 FPN-PANet结构。

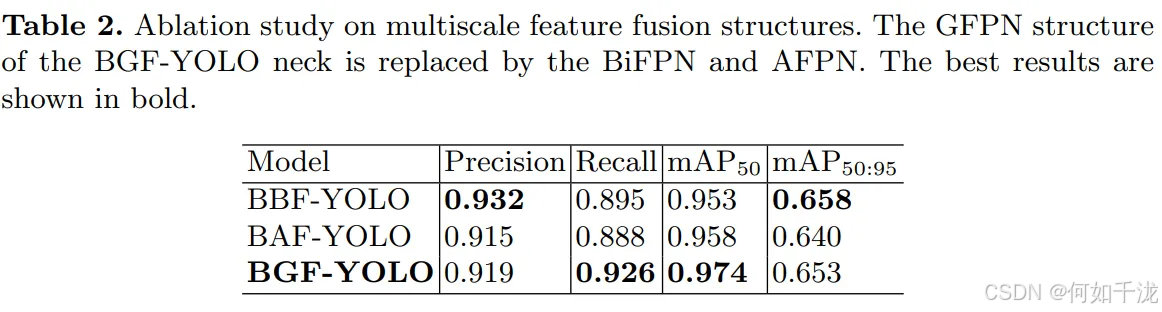

多尺度特征融合结构的比较:

- 将BGF-YOLO中的GFPN替换为其他结构,如BiFPN和AFPN,得到的模型分别叫BBF-YOLO和BAF-YOLO。

- 结果表明,使用GFPN的模型在精确率(precision)、mAP50和mAP50:95上都优于使用BiFPN或AFPN的模型。

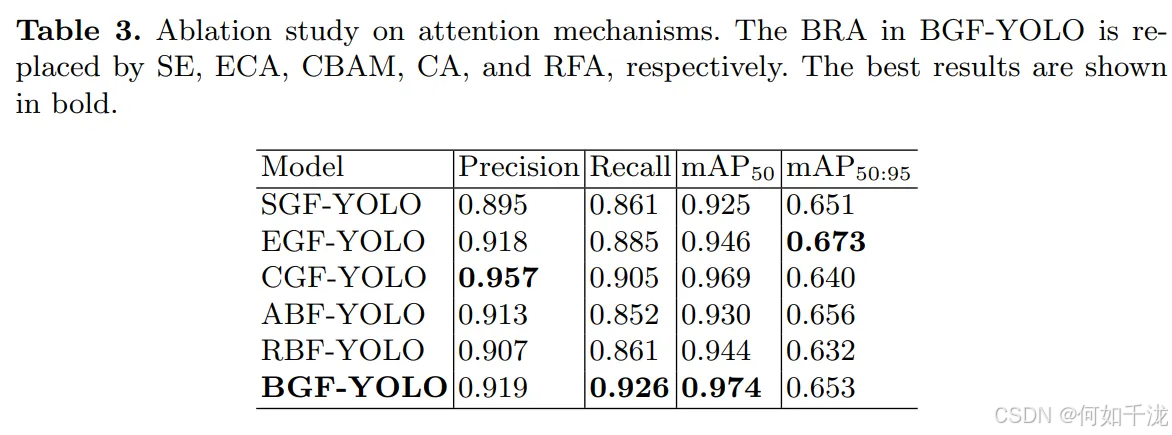

注意机制的分析:研究了多种注意力机制:SE(S)、ECA(E)、CBAM(C)、CA(A)、RFA(R)、BRA(B)。

- BRA带来最大性能提升,显著优于其他注意力机制。

- CBAM排名第二,但在某些指标(如精度)上略逊于BRA。

- 虽然ECA和CA在mAP50:95方面表现更高,但在mAP50方面,BRA优于ECA和CA。

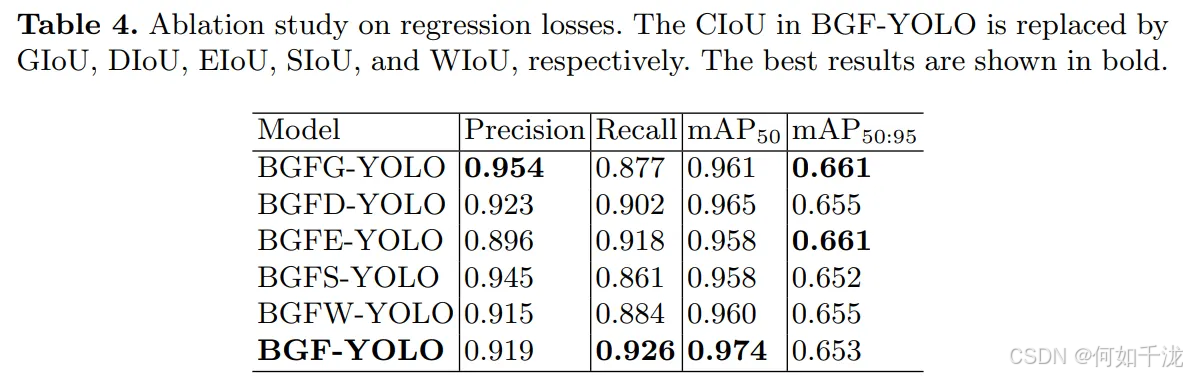

回归损失函数的选择:比较不同的回归损失:GIoU、DIoU、EIoU、SIoU和WIoU v3。

结果显示:

- 原始的CIoU在YOLOv8中表现更鲁棒,尤其是mAP50指标。

- DIoU与CIoU接近,有竞争力。

- GIoU和EIoU在mAP50:95指标上表现更优,但在总体场景下,因考虑鲁棒性,选择CIoU作为回归损失。

4. 结论

本文提出了一种新的模型,叫做BGF-YOLO,它是在YOLOv8的基础上开发的,旨在更准确地检测MRI中的脑肿瘤。通过优化GFPN特征融合结构、引入BRA注意机制,以及添加一个新的检测头,这些改进大大增强了YOLOv8的目标检测能力。这些改进使模型可以在不同层次和更丰富尺度上进行加权特征融合,并生成高质量的锚框,具有动态调焦机制,从而提升检测性能。

此外,作者的BGF-YOLO模型在一系列的实验中,表现优于其他替代技术(如不同的特征融合方式、注意机制和回归损失方法)。最后,他们指出,BGF-YOLO已成为在脑肿瘤检测数据集Br35H上最先进的模型。

621

621

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?