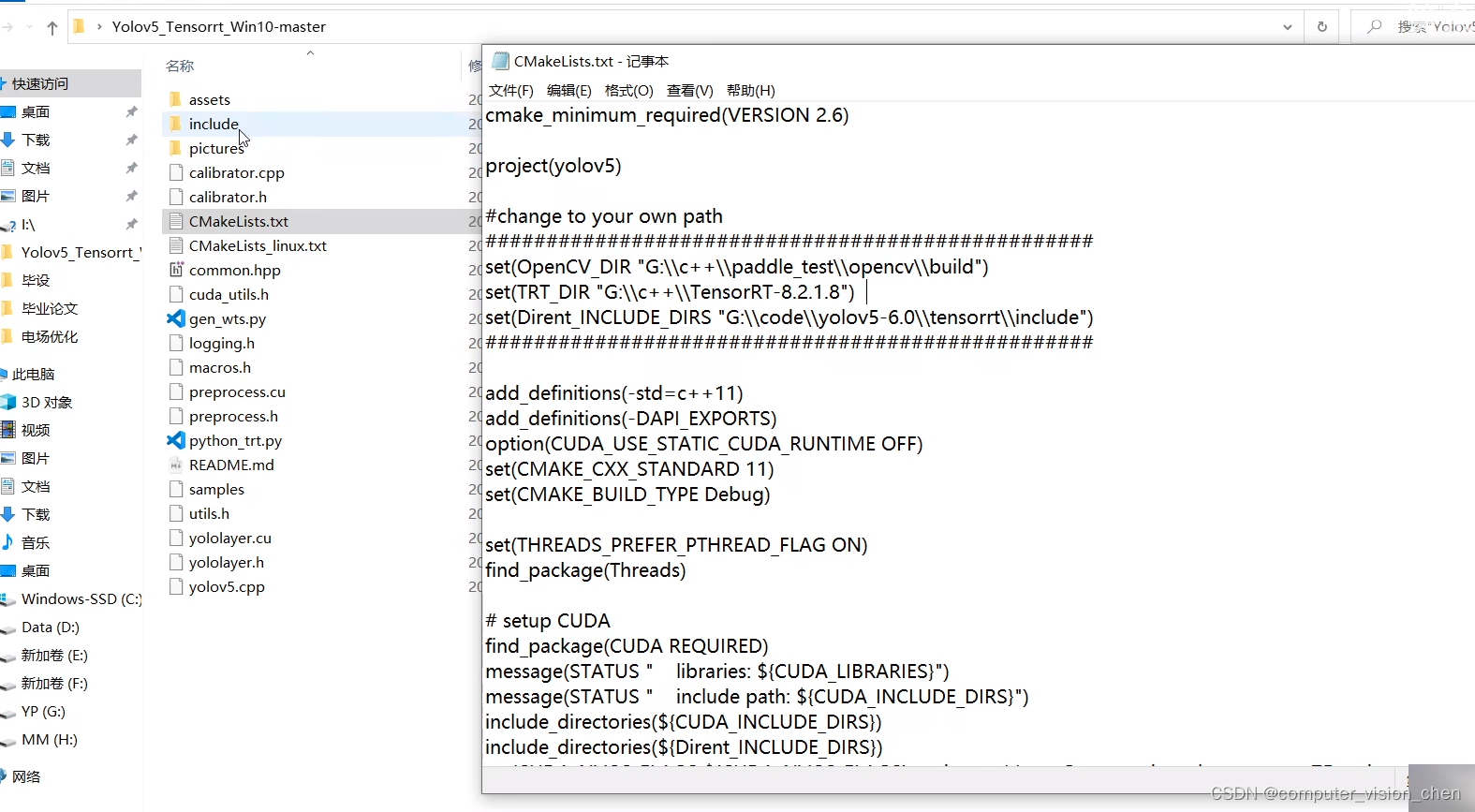

yolov5在windows上部署

https://www.bilibili.com/video/BV113411J7nk/?p=2&spm_id_from=pageDriver&vd_source=ebc47f36e62b223817b8e0edff181613

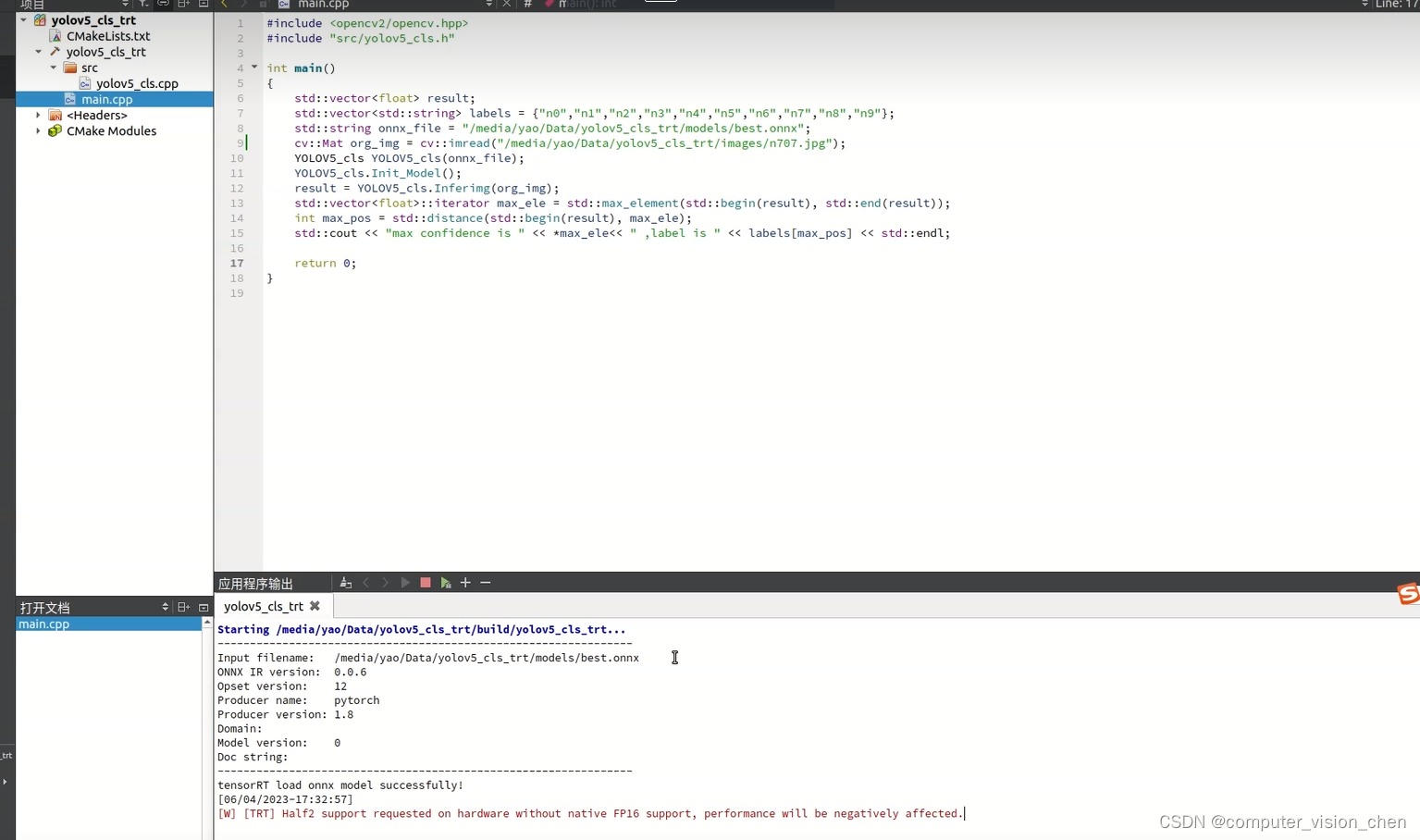

yolov5在linux上的部署

https://www.bilibili.com/video/BV1Th4y1x7b8/?spm_id_from=333.337.search-card.all.click&vd_source=ebc47f36e62b223817b8e0edff181613

同济子豪兄ONNX

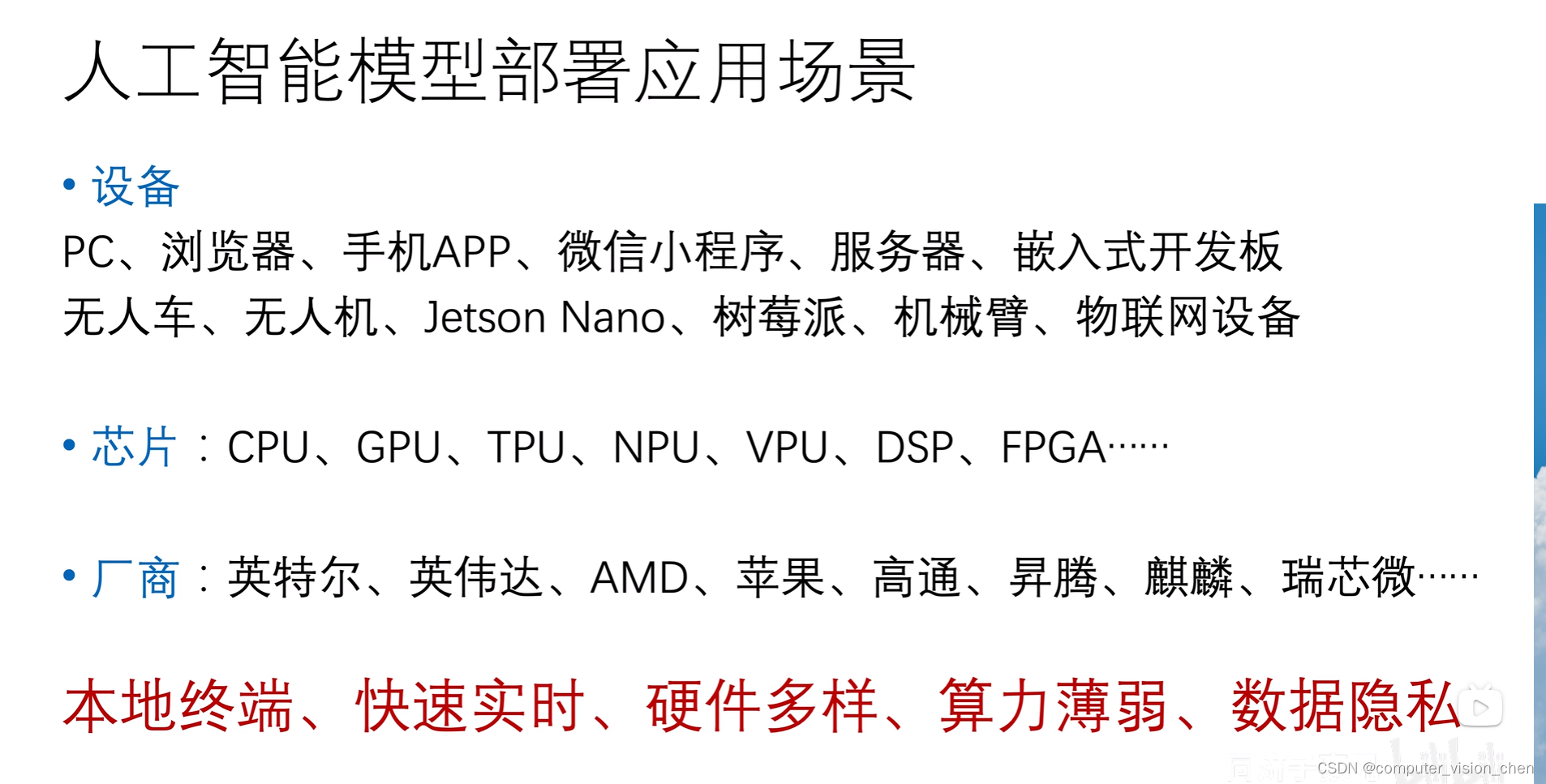

部署之后模型的运算基本上能快5倍。本地部署之后,联网都不需要,数据和隐私不像在网上那样容易泄露了。

模型部署的通用流程

各大厂商都有自己的推理工具。

训练的归训练,部署的归部署,人工智能也分训练端和部署端,每一个端操心自己事就好了。

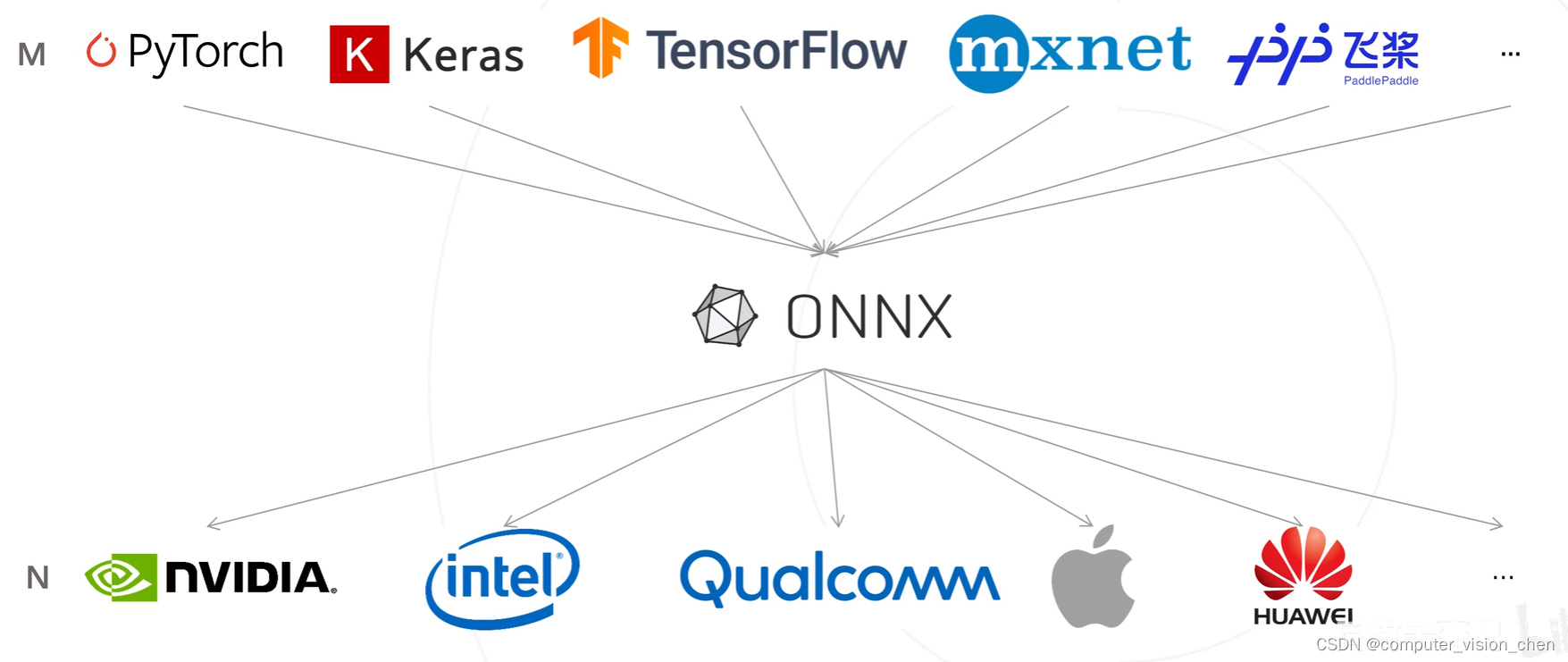

ONNX

TensorRT和ONNX的区别

TensorRT和ONNX是深度学习模型优化和跨平台移植方面两个各有优势的工具。

TensorRT是NVIDIA推出的用于深度学习模型优化的高性能库,旨在最大程度地提高深度学习推理的效率和吞吐量。

它可以将训练好的神经网络模型转换为高度优化的代码,以便在GPU上进行实时推理。

TensorRT针对不同类型的层使用了一系列高效的算法和技巧来加速计算,并且可以通过与CUDA和cuDNN等NVIDIA库的集成,以及利用GPU硬件加速来进一步提高性能。

ONNX(Open Neural Network Exchange)是由微软、Facebook和亚马逊等科技公司联合开发的跨平台深度学习框架,

它借助中间表示的方式将深度学习框架之间的模型和权重参数相互转换,使得用户可以方便地将自己训练好的模型迁移到其他框架或硬件平台上使用。

相比之下,ONNX主要关注的是模型的跨平台移植性,使得用户可以方便地在不同的硬件平台上部署模型,并且支持多种硬件平台,包括CPU、GPU和FPGA等。

679

679

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?