李宏毅2021年机器学习作业4学习笔记

前言

声明:本文参考了李宏毅机器学习2021年作业例程,开发平台是kaggle notebook。

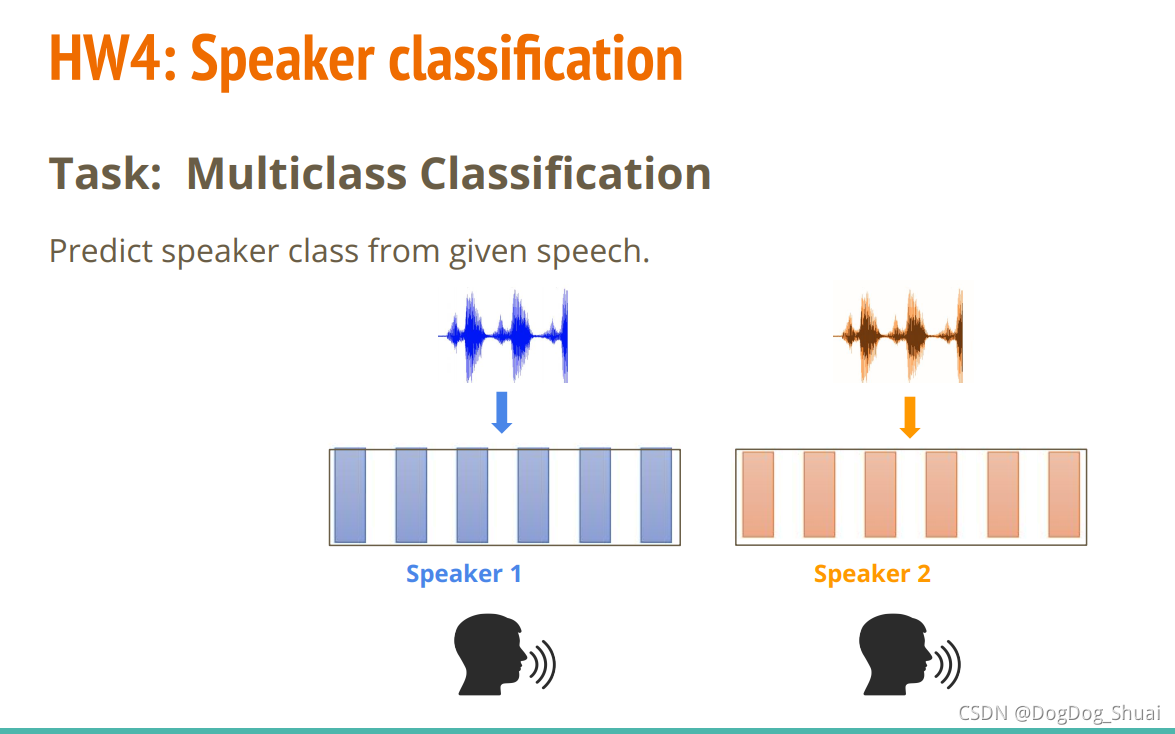

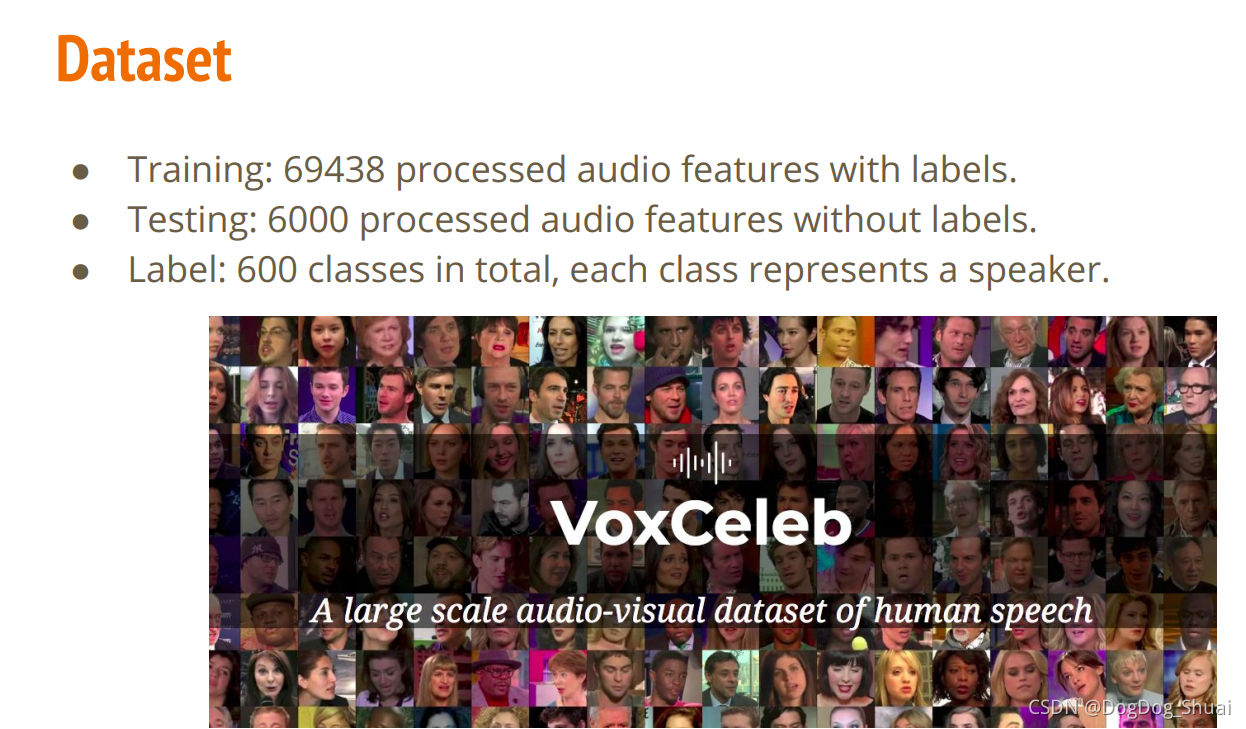

一、问题描述

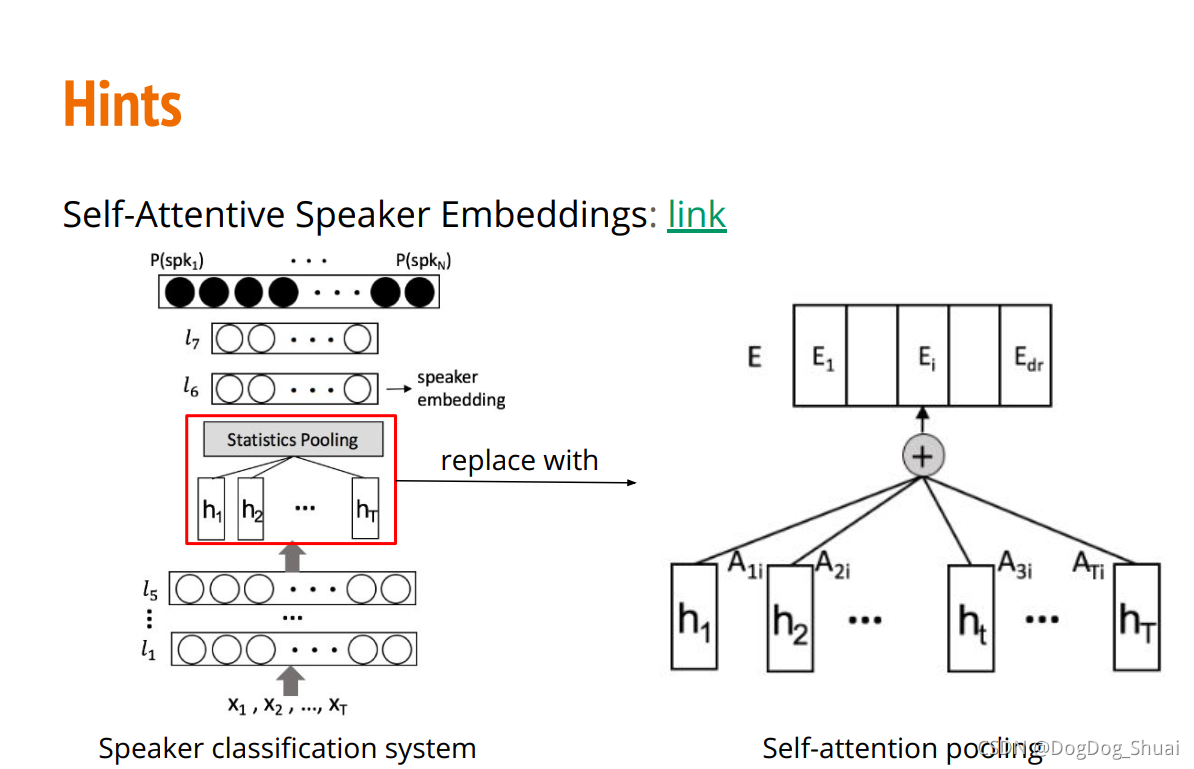

识别出声音信号是哪个人说的,实质是一个classification问题。

B站作业讲解视频

Kaggle地址

Baselines:

○ Simple: Run sample code and know how to use transformer. 0.82523

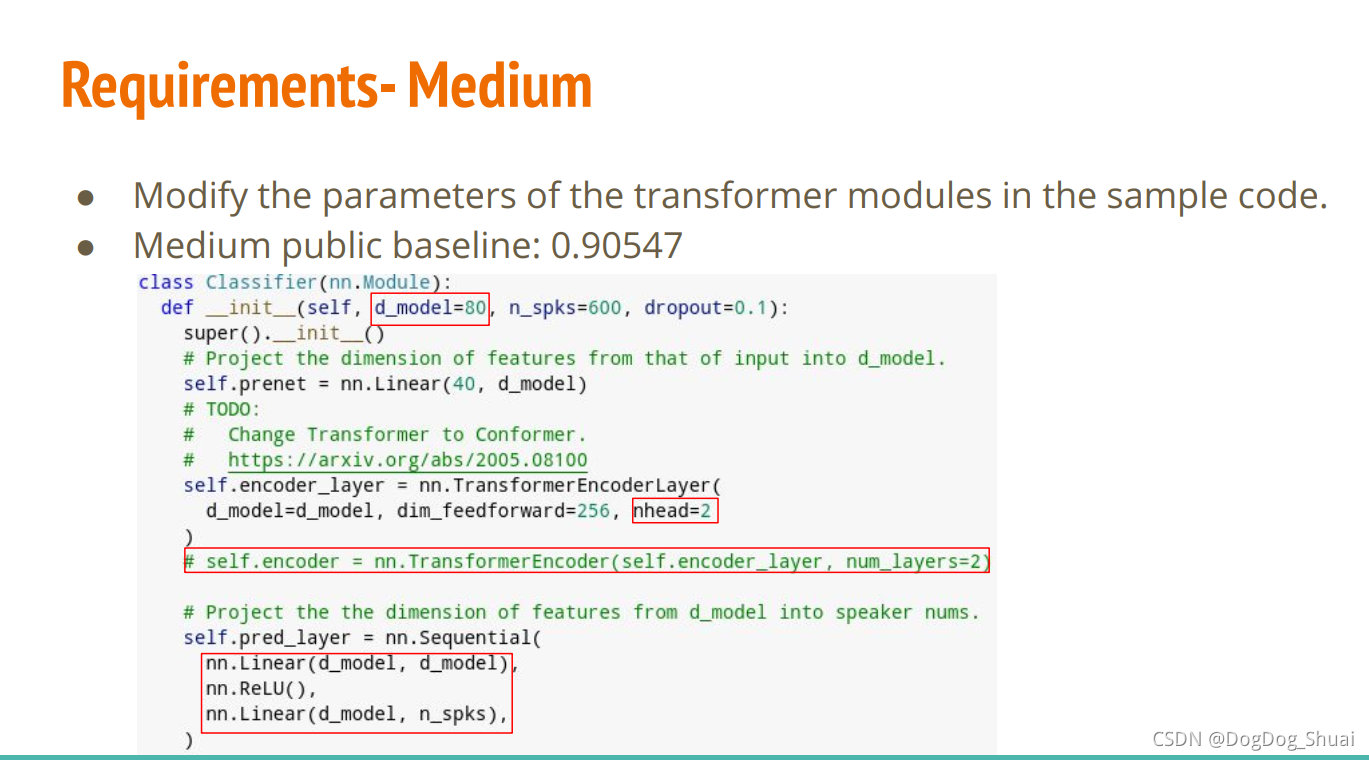

○ Medium: Know how to adjust parameters of transformer.0.90547

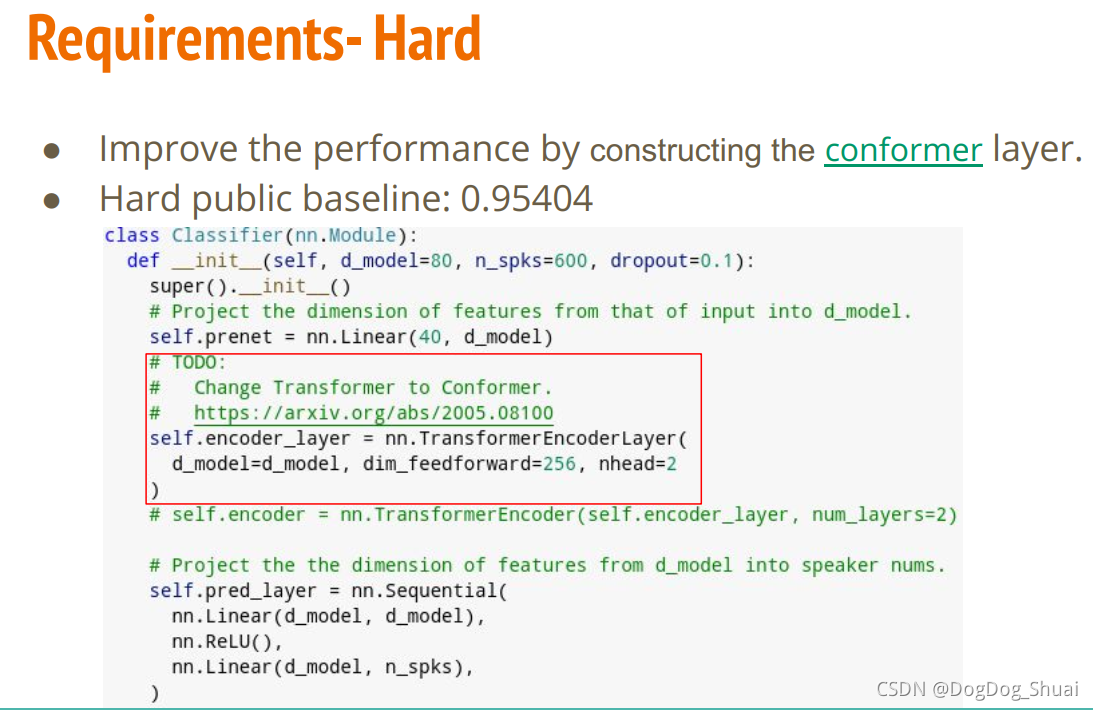

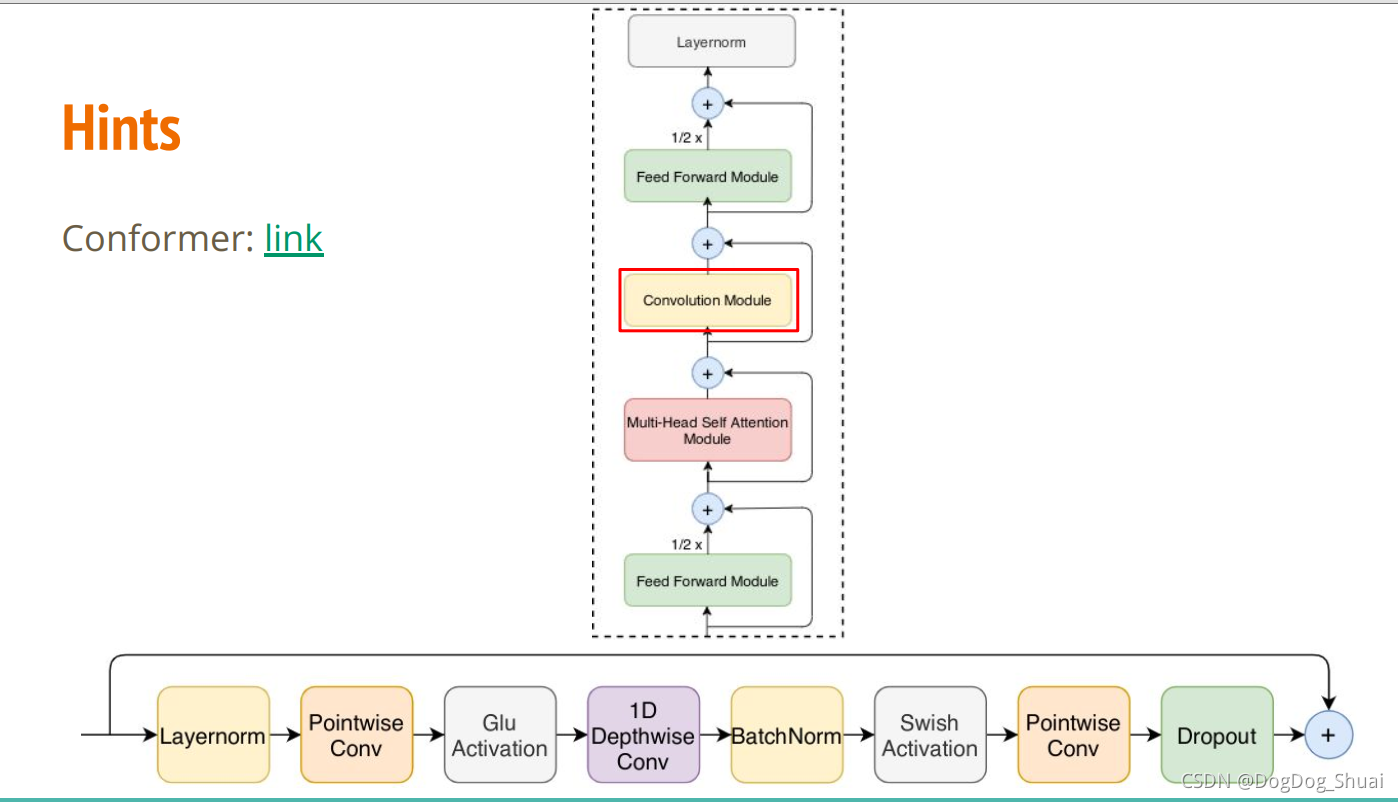

○ Hard: Construct conformer which is a variety of transformer.0.95404

二、实验过程

2.1 跑助教提供的

由于助教讲解作业时提到,baseline能跑到0.82左右,可以改多头注意力部分和全连接层改进,所以我就没有再做。参照其他同学的baseline跑出的结果大概都在0.82左右。

Kaggle得分: 0.811

2.2 多头注意力

操作:将nhead从2改成1;全连接层从2 层改成1层

结果:

运行时长:42min

Kaggle得分:0.83444 0.84357

2.3 加深transformer encoder layer

操作:在2.2基础上,transformer encoder layer从一层改为两层

结果:

运行时长:1h

Kaggle得分:0.89777 0.90142(提升明显)

2.4 Conformer

操作:将2.2基础上transformer换成conformer

结果:

Kaggle得分:0.89555 0.89619

2.5 后续优化方案

- 调conformer相关参数。

- 调高d_model,使模型变复杂。

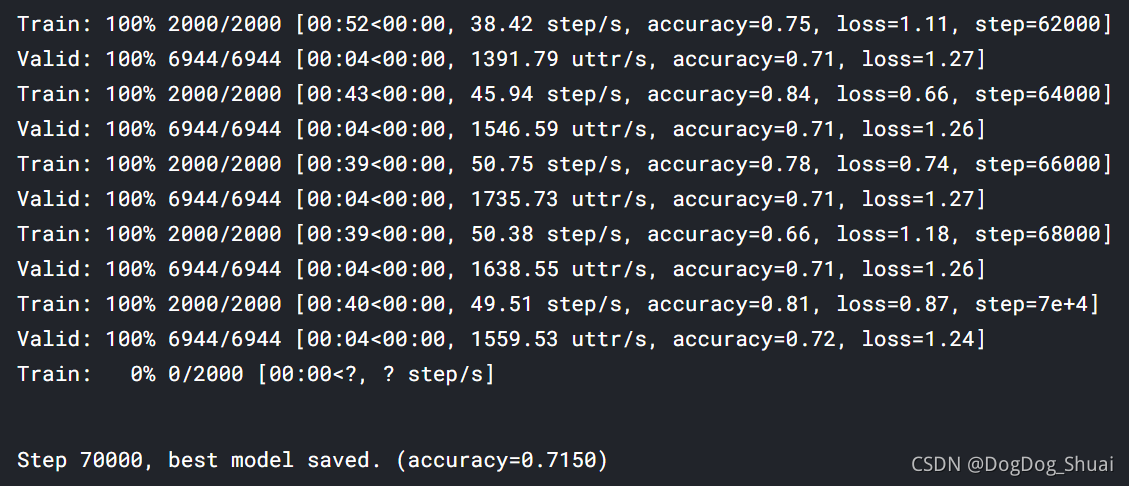

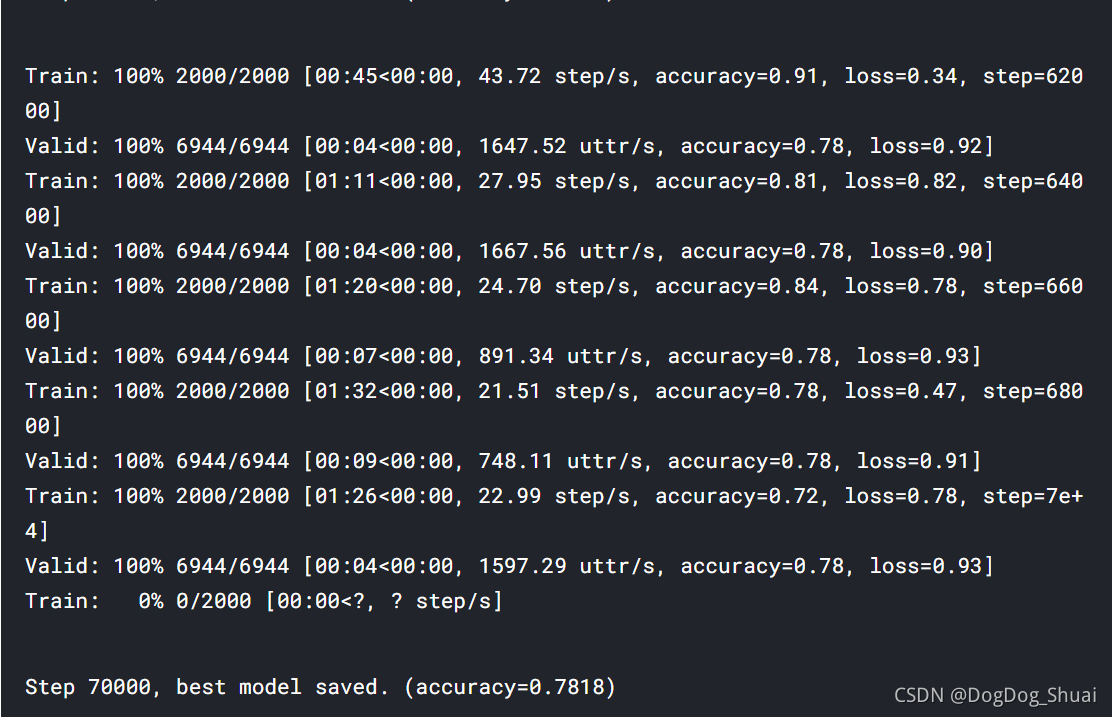

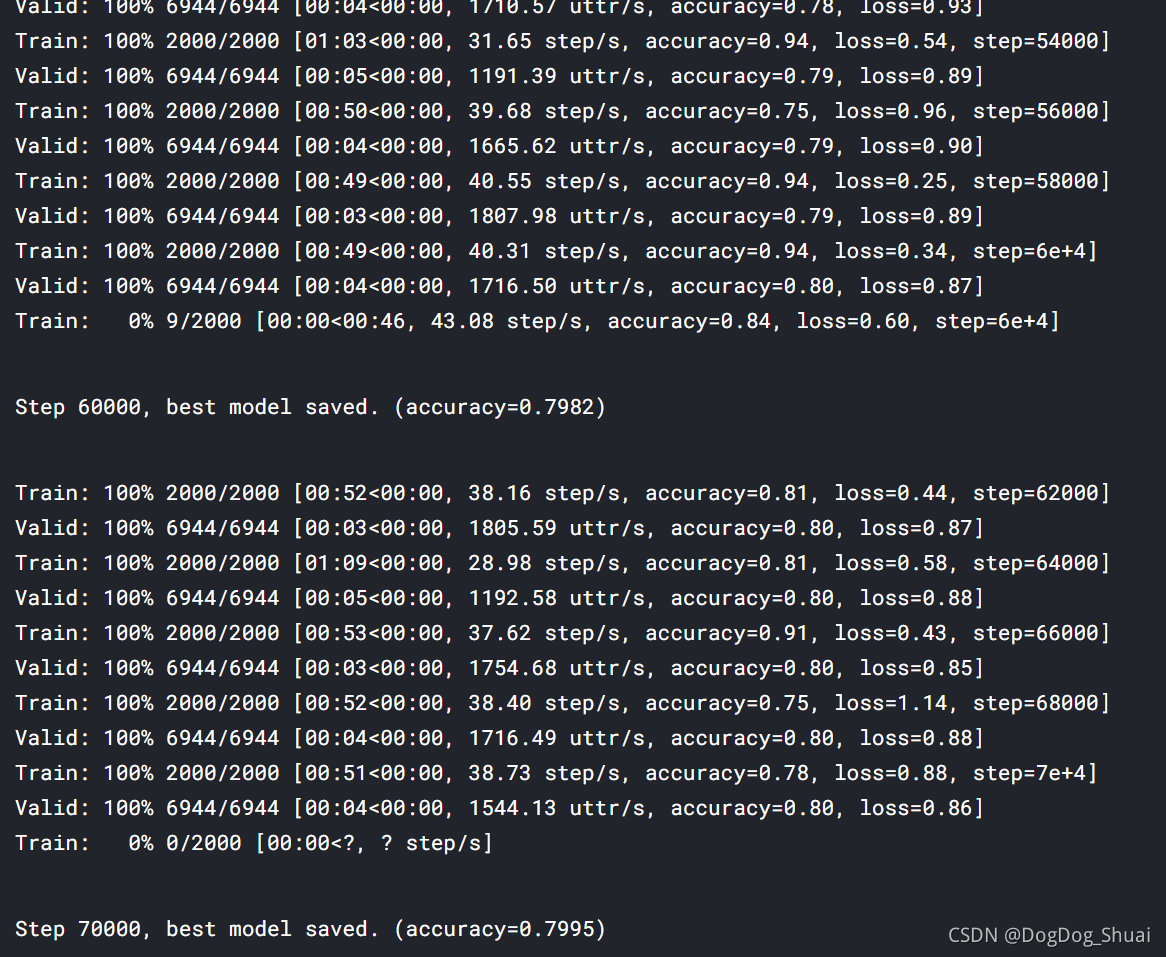

- 可以看到,从60000步到70000步,accuracy依然在增大,可以考虑增大训练轮数。

三、总结

Optimizer

使用AdamW,是Adam的一种变形

network架构

- transformer多头注意力与单头注意力对于不同数据集有不同效果。

- 输出线性层不宜过多

- Conformer相比于Transformer有一定优化

代码链接:

1989

1989

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?