- 文献题目:Pythia - A platform for vision & language research

摘要

-

本文介绍了 Pythia,一个用于视觉和语言任务的深度学习研究平台。 Pythia 以即插即用策略为核心,使研究人员能够为视觉和语言任务(如视觉问答 (VQA)、视觉对话和图像字幕)快速构建、复制和基准测试新模型。 Pythia 构建在 PyTorch 之上

(i) 视觉和语言任务中常用的操作的高级抽象

(ii) 一个模块化且易于扩展的框架,用于快速原型设计和

(iii) 可以无缝处理任务的灵活培训 API。 Pythia 是第一个在视觉和语言领域支持多任务处理的框架。 Pythia 还包括一些最近用于基准测试的最先进模型的参考实现,以及智能配置、多指标、检查点、报告、日志记录等实用程序。我们希望通过提供一个专注于灵活性的研究平台,可重复性和效率,我们可以帮助研究人员推动最先进的视觉和语言任务。 -

在过去几年中,我们在视觉和语言任务方面取得了令人瞩目的进展,例如由深度学习驱动的视觉问答 (VQA) 和图像字幕。大多数最先进的网络都建立在用于生成文本和图像表示以及网络层的相同技术之上。然而,魔鬼在于细节,因此从最先进的模型中复制结果通常并非易事。这反过来又阻碍了更快的实验和研究进展。借助 Pythia,我们希望通过为视觉和语言(VQA 和相关)任务的研究([10][6][14])提供模块化和灵活的平台来打破这些设计、实现和可重复性的障碍,从而轻松实现通过关注 IO、任务、数据集和模型架构的低级细节,同时提供轻松尝试新想法的灵活性,从而提高可重复性并促进新的研究。 Pythia 建立在 2018 年 VQA 挑战赛和 2018 年 Vizwiz 挑战赛的获奖作品之上。Pythia 包含一组当前最先进模型的参考实现,以便于比较。我们从 AllenNLP [8]、Detectron [9] 和 ParlAI [16] 等软件套件中获得灵感,这些套件旨在打破自然语言处理和计算机视觉等其他机器学习领域的类似障碍。

-

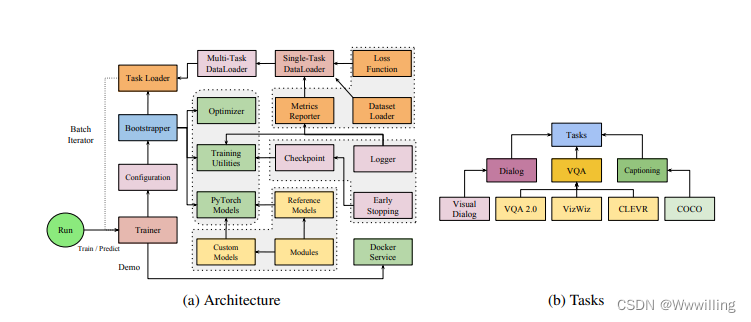

框架设计:在 Pythia(参见图 1a)中,我们有一个中央训练器,它加载一个引导程序,该引导程序设置训练所需的组件。 Bootstrapper 根据研究人员提供的网络配置构建模型。为了加载数据,引导程序实例化任务加载器,它可以根据配置加载多个任务。 Pythia 在基于插件的注册表上工作,其中任务和模型将自己注册到注册表映射中的特定键。此外,数据集将自己注册到一个或多个任务。此注册表有助于在运行时根据配置动态加载模型和任务。一个任务首先构建(如果不存在),然后加载注册到它的数据集。数据集负责其指标、日志记录和损失函数,从而使训练者对数据细节不可知。有关任务(第二级)及其数据集(第三级)的树形概览,请参见图 1b。中央培训师委派给适当的组件

执行主模型的训练(提前停止)和评估。这些委托,连同任务加载器和其他抽象,允许训练器具有通用签名,并且与数据加载器、实用程序和模型无关,并且在任务之间保持不变。

777

777

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?