本次采用python对汉语的一小句文字进行一个简单的分词;

简单介绍一下,分词所用到的—jieba:中文分词组件,可用于中文句子/词性分割、词性标注、未登录词识别,支持用户词典等功能。该组件的分词精度达到了97%以上。

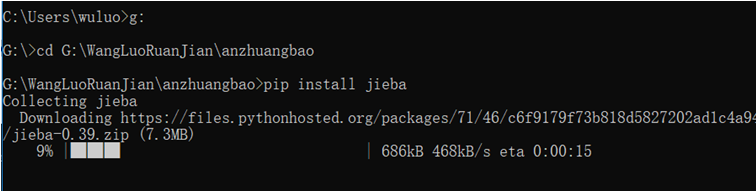

安装jieba:

pip install jieba

分词代码:

#!/usr/bin/env python3

# -*- coding:utf-8 -*-

u'''

Created on 2019年4月15日

@author: wuluo

'''

__author__ = 'wuluo'

__version__ = '1.0.0'

__company__ = u'重庆交大'

__updated__ = '2019-04-15'

import jieba

seg_list = jieba.cut("伟大的北京天安门", cut_all=True)

print("Full Mode:", "/ ".join(seg_list)) # 全模式

seg_list = jieba.cut("伟大的北京天安门", cut_all=False)

print("Default Mode:", "/ ".join(seg_list)) # 精确模式

seg_list = jieba.cut("这里是伟大的北京天安门") # 默认是精确模式

print(", ".join(seg_list))

seg_list = jieba.cut_for_search("这里是伟大的北京天安门,伟大的中华人民共和国!") # 搜索引擎模式

print(", ".join(seg_list))

if __name__ == "__main__":

pass

运行结果:

不用太在意圈中部分!!!

4402

4402

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?