从这节开始是九天老师开始讲解

课程32

讲了一些概念性的东西

课程33

数据集生成函数的创建与使用

手动创建回归数据集

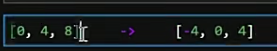

features就是创建的特征矩阵,就是![]() 以这个为大小的矩阵,最后那个就是添加噪声,就是标签不是严格的下面的函数对应关系了,会有微小的偏差

以这个为大小的矩阵,最后那个就是添加噪声,就是标签不是严格的下面的函数对应关系了,会有微小的偏差

这里面的subplot的121表示,第一个12表示子图在一行有两个,最后面的1表示下面要绘制的是第几个子图,scatter用来绘制散点图,大规模的话比matplotlib绘图要快,第一个[:,0]就是x1,这两个图就是x1和x2和y的对应关系的图

创建数据集的函数

假如有截距,那么w的最后一个值就是乘截距的,所以你的特征就会是w的长度减去1,a[:-1]就是把[]里的最后一个元素去除,里面的deg就是幂的次数,为1时候是线性的,此外是非线性的,倒数第二行设置了一个全为1的列是为了更好的进行矩阵的乘法,因为是有bias的

注的意思就是说没办法创建x1x2这种项的方程

手动创建分类数据集

randn标准正态分布,所以只用输入形状大小就行了

normal前面的4,2表示均值和标准差,大小看后面的size进行定义

.long是转化为整型,pytorch中分类问题默认的标签都是整型

影响分类问题建模难度看交叉的数据集多不多

第一行代码就是创建一个空的张量,为了后面可以用full_like这个函数,把自己用的张量按第一行创建的这个进行填充就行

deg_dispersion就是影响数据的离散程度的,数据越大离散程度越好,也就是越好分类,数据越小那么数据都挤在一起了,肯定就不好分类了

惩罚因子的作用就是把上面的不对称分布的值,通过惩罚因子的运算将其变成对称的

shuffle可以对有序的集合进行一个乱序的排序

后面的课程会经常进行创建数据和数据的小批量切分,所以提前进行了定义,并封装称为模块,方便之后的调用,视频后面还解释了代码的含义,然后讲了如何将这些函数封装称为模块,由于本人的项目需求在这部分来说不是很大,所以暂时不作更多的记录,以后用到这部分的内容,会根据课程内容作一些补充。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?