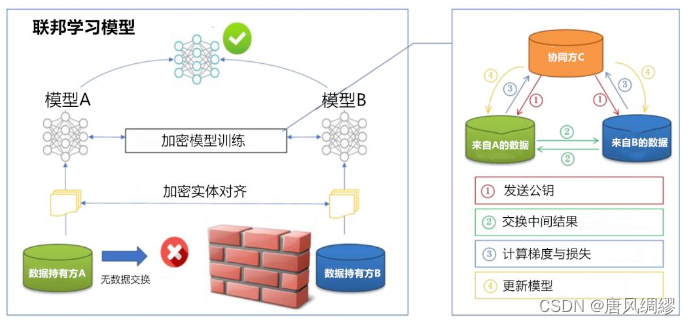

联邦学习出现的原因:联邦双方数据不充分或者数据不完整(一方只有标签、一方只有特征数据)

纵向联邦:样本重叠多,特征重叠少,拓展特征维

第一部分:加密样本对齐。由于两家企业的用户群体并非完全重合,系统利用基于加密的用户样本对齐技术,在 A 和 B 不公开各自数据的前提下确认双方的共有用户,并且不暴露不互相

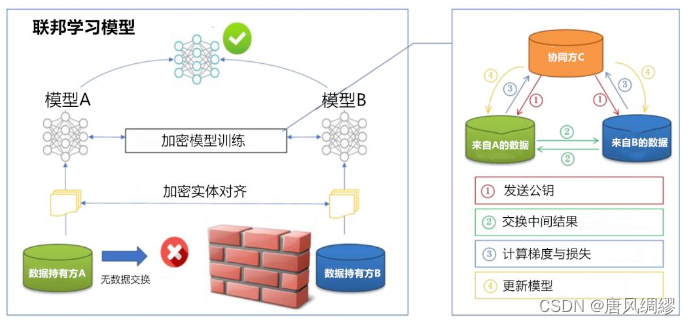

联邦学习出现的原因:联邦双方数据不充分或者数据不完整(一方只有标签、一方只有特征数据)

纵向联邦:样本重叠多,特征重叠少,拓展特征维

第一部分:加密样本对齐。由于两家企业的用户群体并非完全重合,系统利用基于加密的用户样本对齐技术,在 A 和 B 不公开各自数据的前提下确认双方的共有用户,并且不暴露不互相

346

346

8171

8171

3976

3976

4万+

4万+

3034

3034

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?