主干网络论文阅读(按论文时间顺序):

论文阅读 LeNET CONVOLUTIONAL NEURAL NETWORKS FOR ISOLATED CHARACTER RECOGNITION-CSDN博客

论文阅读 AlexNet ImageNet Classification with Deep ConvolutionalNeural Networks-CSDN博客

论文阅读 VGGNet VERY DEEP CONVOLUTIONALNETWORKSFORLARGE-SCALEIMAGERECOGNITION-CSDN博客

论文阅读 GoogleNet(Inception) Going deeper with convolutions-CSDN博客

论文阅读 ResNet Deep Residual Learning for Image Recognition-CSDN博客

论文阅读 ResNext Aggregated Residual Transformations for Deep Neural Networks-CSDN博客

用于单个字符识别的卷积神经网络 远古论文(1998年)

LeNet-5的设计主要是为了解决手写识别问题,此前都是手动设计特征提取器做图像分类任务---根据习得的经验进行特征提取器的开发。整个图像识别模型的好坏几乎完全取决于特征提取器做得好与不好。

如此制作出来的特征提取器几乎丧失了复用性;面对拥有不同特点的数据集,为了保证最终的识别效果,都需要重新手工开发特征提取器。

卷积神经网络和全连接神经网络:

卷积神经网络:卷积核是多维的,如5*5*3是一个3维的卷积核,每个维度上大小为3*3。卷积核的维度取决于输入的维度,而每个卷积核(不管是几维的)输出都是一张一维的特征图,多个卷积核才能产生多维输出。

每张特征图都是一个神经元(卷积核)通过前一层不同位置经过相同计算得来的。一个完整的卷积层是通过几个特征图联合组成的(通过不同的权重向量,即不同卷积核),因此卷积网络可以在输入图像的每个局部位置形成多重特征。

卷积网络和全连接网络:卷积神经网络也是通过一层一层的节点组织起来的。和全连接神经网络一样,卷积神经网络中的每一个节点就是一个神经元。在全连接神经网络中,每相邻两层之间的节点都有边相连,于是会将每一层的全连接层中的节点组织成一列,这样方便显示连接结构。而对于卷积神经网络,相邻两层之间只有部分节点相连,为了展示每一层神经元的维度,一般会将每一层卷积层的节点组织成一个三维矩阵。

图像处理上,卷积网络相较于全连接网络的优点:1、全连接架构的一个不足在于输入的拓扑结构被完全忽略。输入变量可以以任何(固定)顺序呈现,而不会影响训练结果。与之相对的是,图像具有健壮的2D局部结构:空间相邻的像素具有高度相关性。局部相关性对于提取局部特征来说具有巨大优势。卷积神经网络通过限制感受野的隐藏神经元为局部大小从而强制提取局部特征。2、减少参数量(那个年代是挺重要的):设一张图像大小28*28,第一层隐藏层的节点数为500个,那么一个全连接层的神经网络有28*28*500+500=392500个参数;而一个卷积网络只需要5*5*500+500=13000个参数

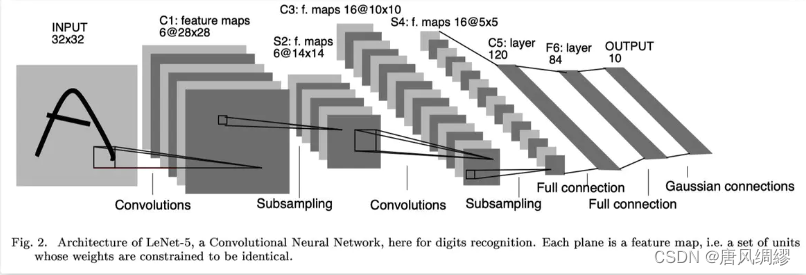

原始论文LeNet-5结构图

除去输入层外一共7层,输入32*32的灰度图(即输入32*32*1)。

C1层6个5*5的卷积核,步长1,没有填充(这篇论文提出时还没有padding操作)。

S2层2*2下采样,步长2。

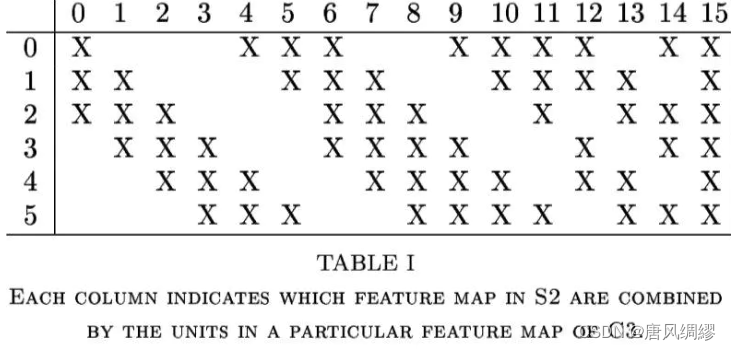

C3层16个卷积核。作者为了控制连接数量和打破网络对称性在S2->C3 卷积核不全是5通道。原文中对这个模式的解释为:前六个(即上图横坐标0-5)卷积核提取中 连续三个子集中的特征,后六个(即上图横坐标6-11)卷积核提取中连续四个子集中的特征,后三个(即上图横坐标12-14)卷积核提取中离散的四个子集中的特征,最后一个提取全图特征,参数量为6∗(3∗5∗5+1)+6∗(4∗5∗5+1)+3∗(4∗5∗5+1)+1∗(6∗5∗5+1)=1516。(现在没人这么干了,可能比较麻烦,效果也不是特别显著)

C3层16个卷积核。作者为了控制连接数量和打破网络对称性在S2->C3 卷积核不全是5通道。原文中对这个模式的解释为:前六个(即上图横坐标0-5)卷积核提取中 连续三个子集中的特征,后六个(即上图横坐标6-11)卷积核提取中连续四个子集中的特征,后三个(即上图横坐标12-14)卷积核提取中离散的四个子集中的特征,最后一个提取全图特征,参数量为6∗(3∗5∗5+1)+6∗(4∗5∗5+1)+3∗(4∗5∗5+1)+1∗(6∗5∗5+1)=1516。(现在没人这么干了,可能比较麻烦,效果也不是特别显著)

S4层同样的下采样。

C5层120个5*5的卷积核,输出1*1的120维向量。但如果INPUT大于32*32那么输出就不是1*1,所以图中写成全连接并不合适。

F6全连接层

OUTPUT:高斯链接---lenet中用到的一种特殊的连接方式

1910

1910

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?