回顾元学习

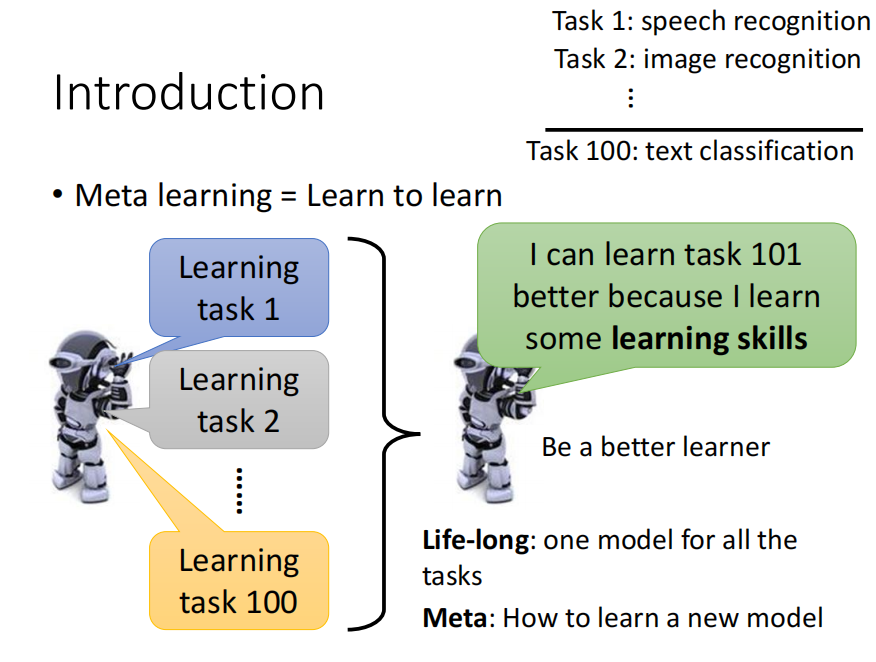

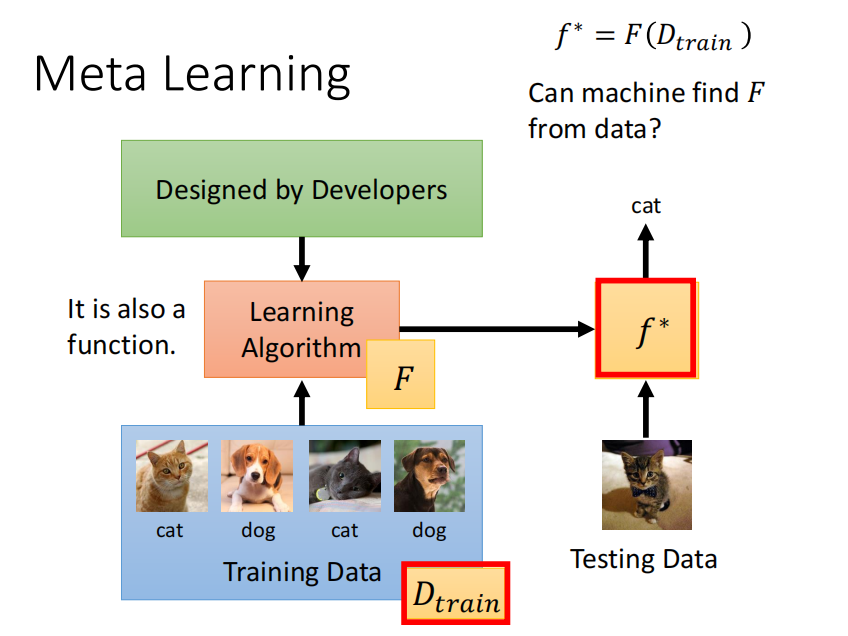

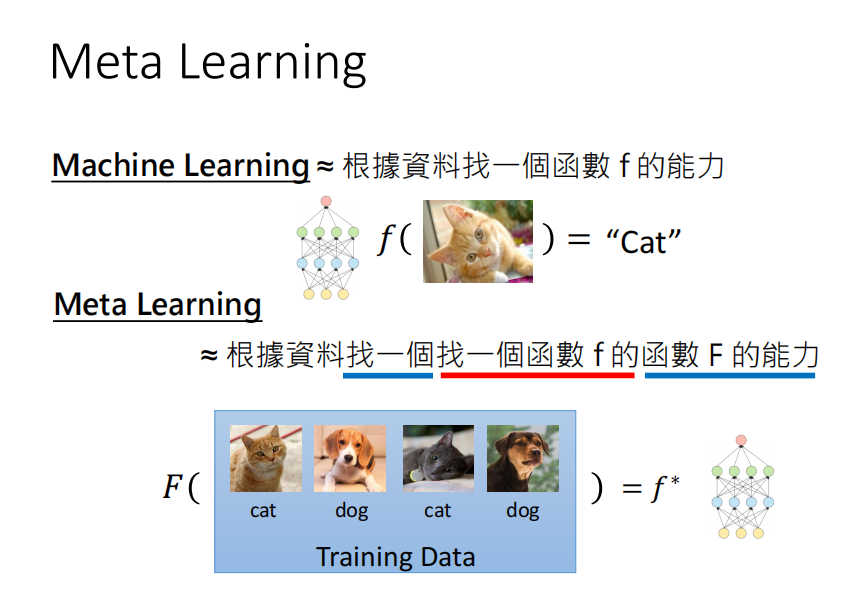

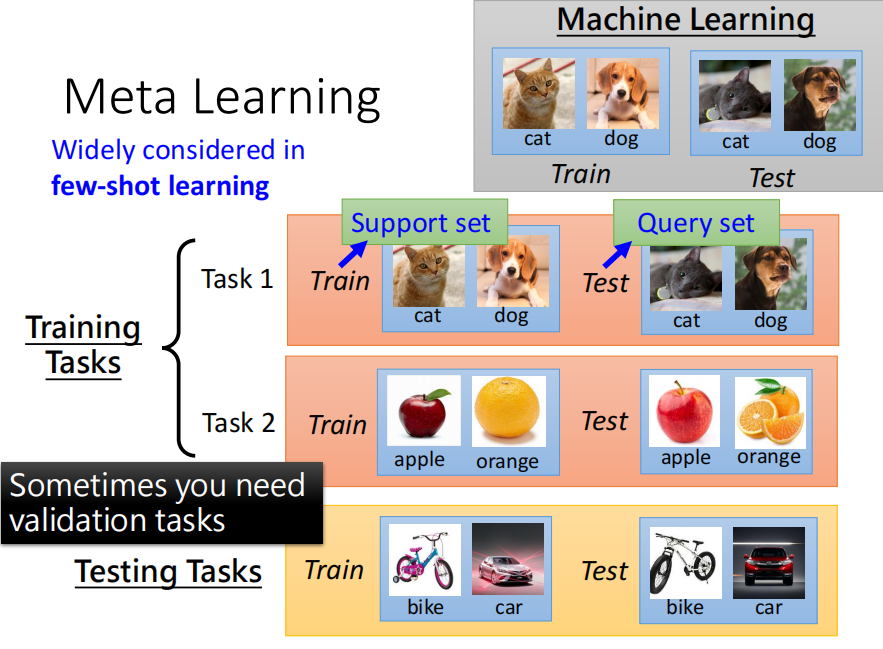

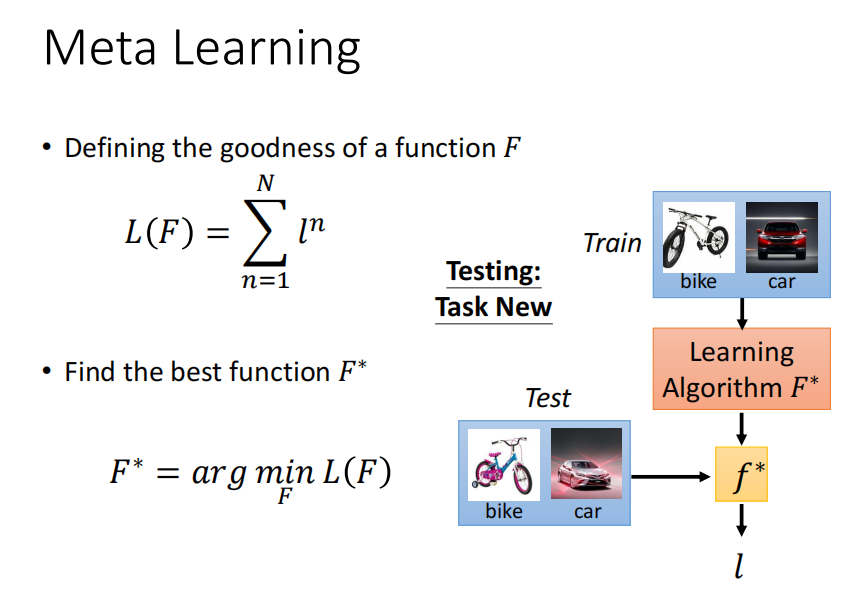

元学习的基本知识参考这篇博客元学习和机器学习的对比

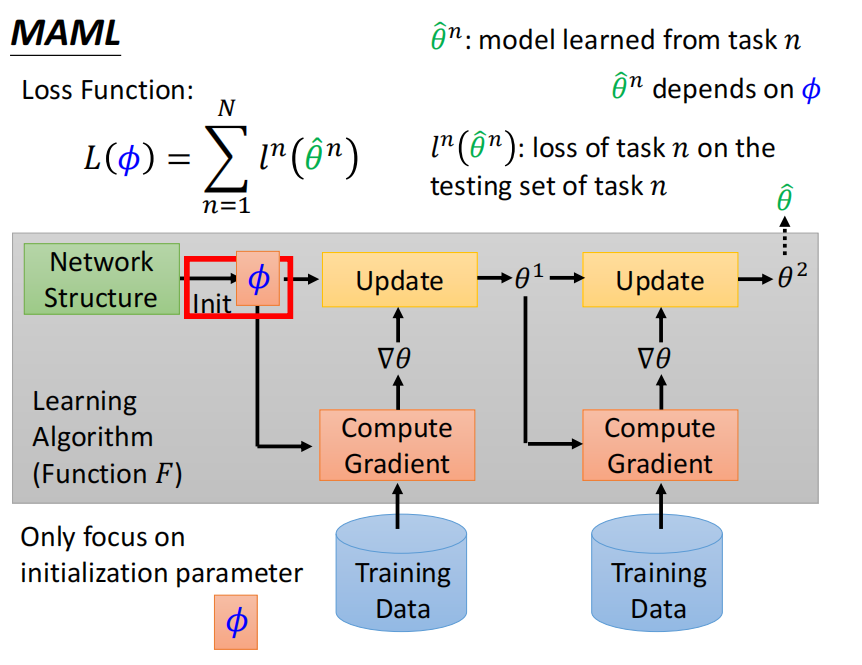

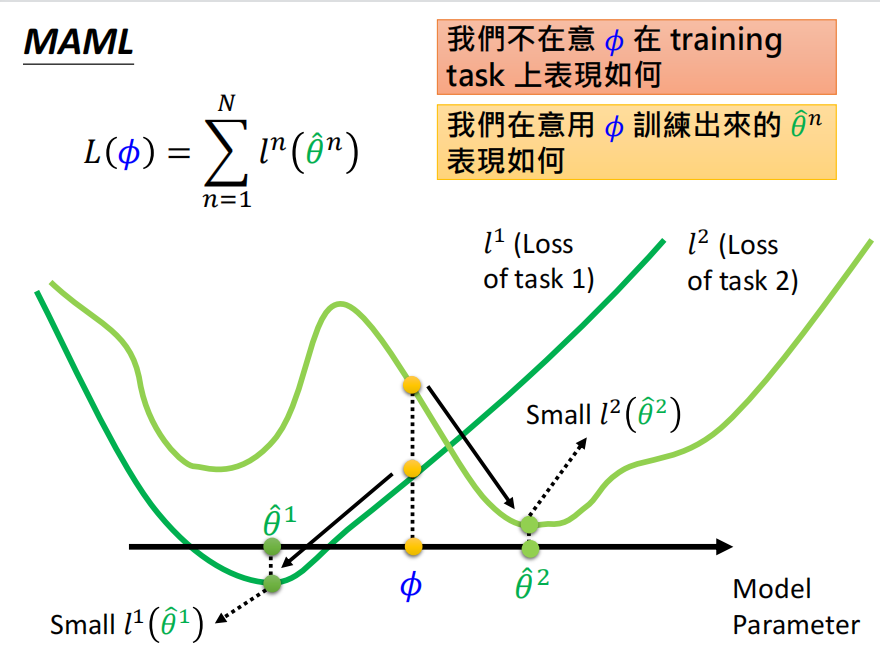

MAML算法

学习初始化参数,所有任务的初始化的参数都是一样的

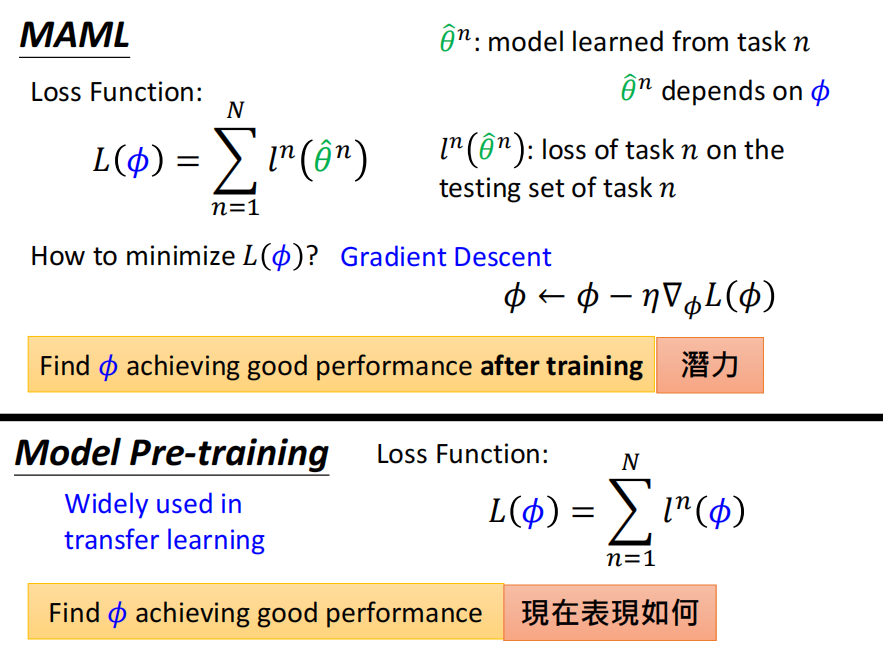

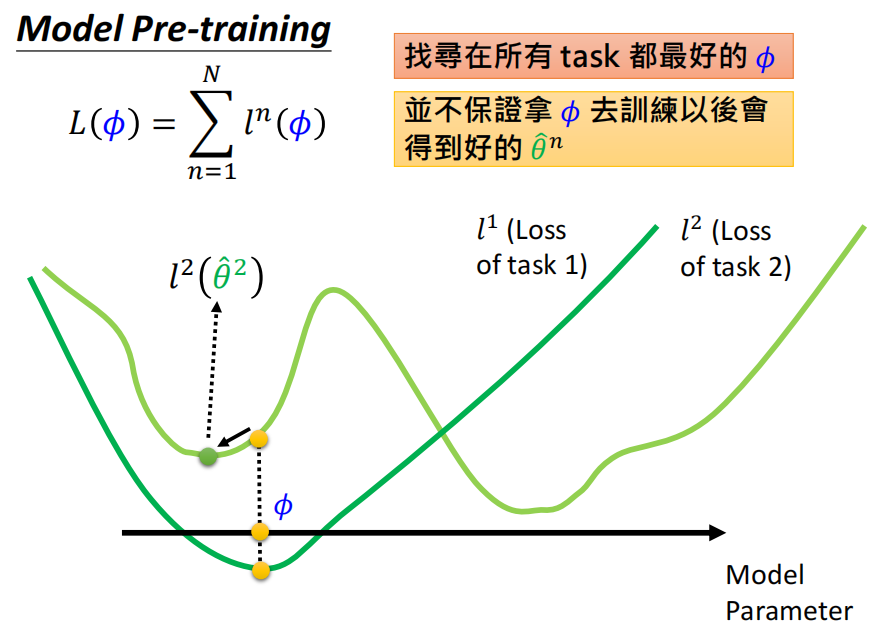

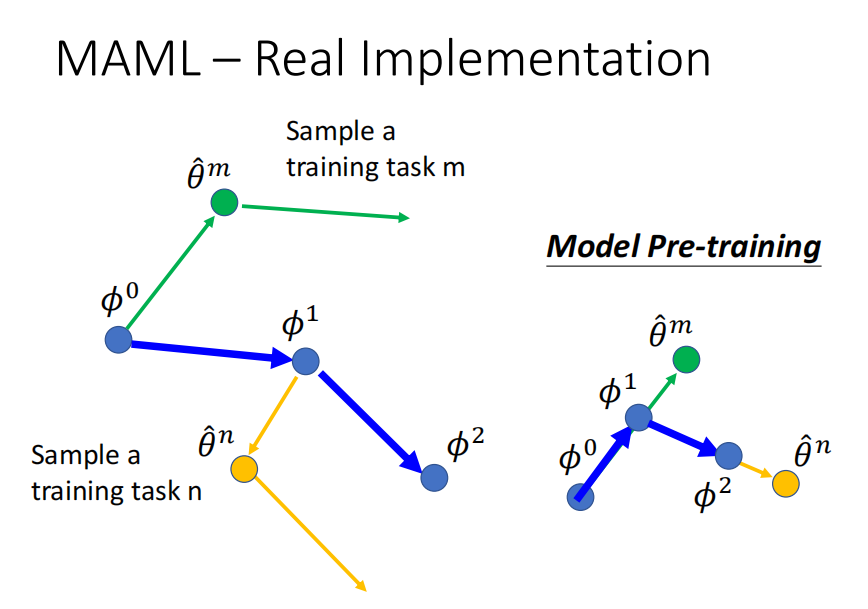

MAML和预训练模型的区别

- MAML使用的是 ϕ \phi ϕ训练完之后的 θ ^ k \hat{\theta}^k θ^k计算得出的

- 预训练模型是用预训练得到的模型参数

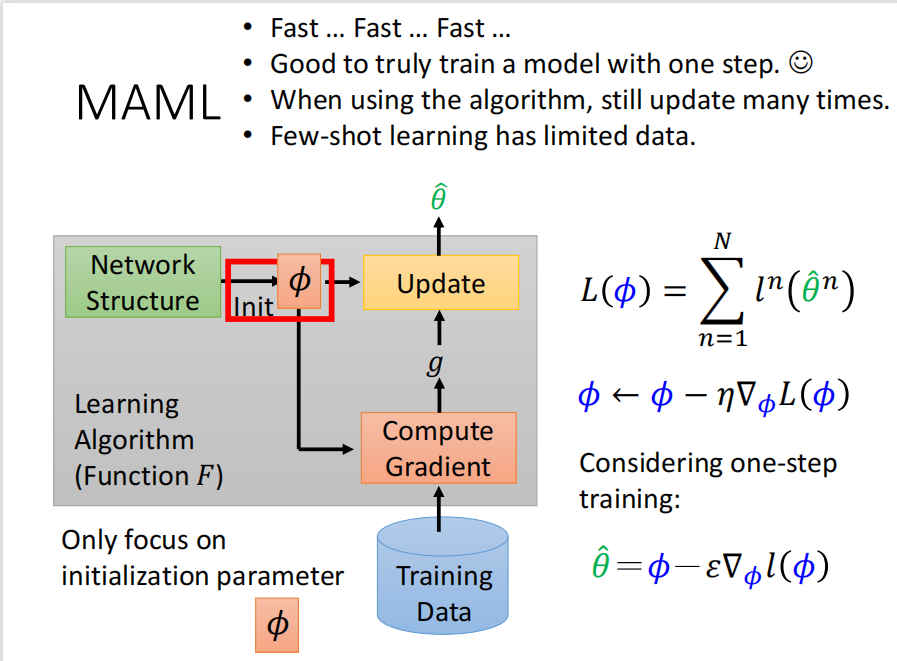

MAML训练的时候只进行一次梯度下降,希望模型在训练的时候更新参数的时候只训练一次就可以得到很好的结果

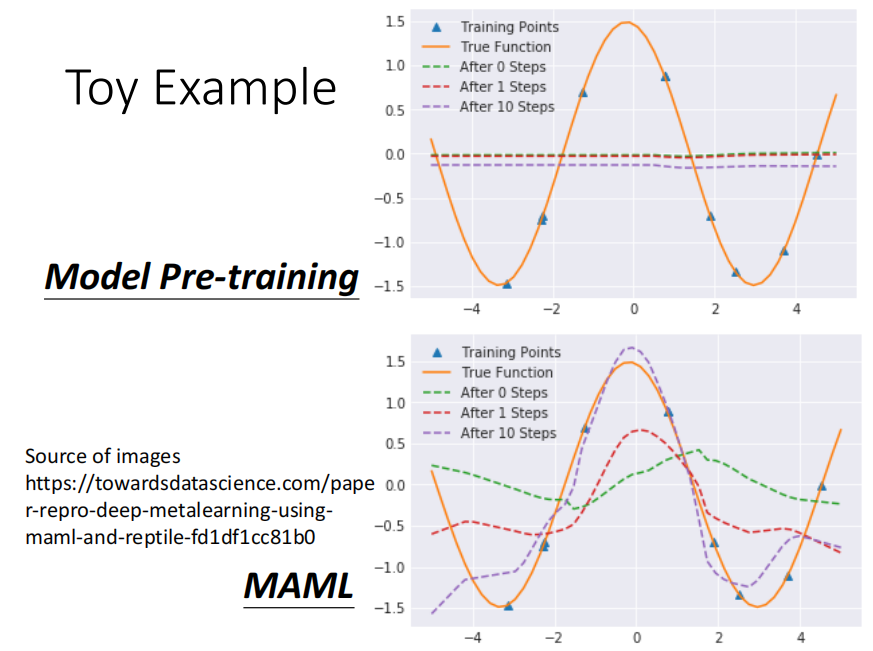

MAML和预训练模型的举例

预训练在初始化参数不好时,训练多次效果仍然不好

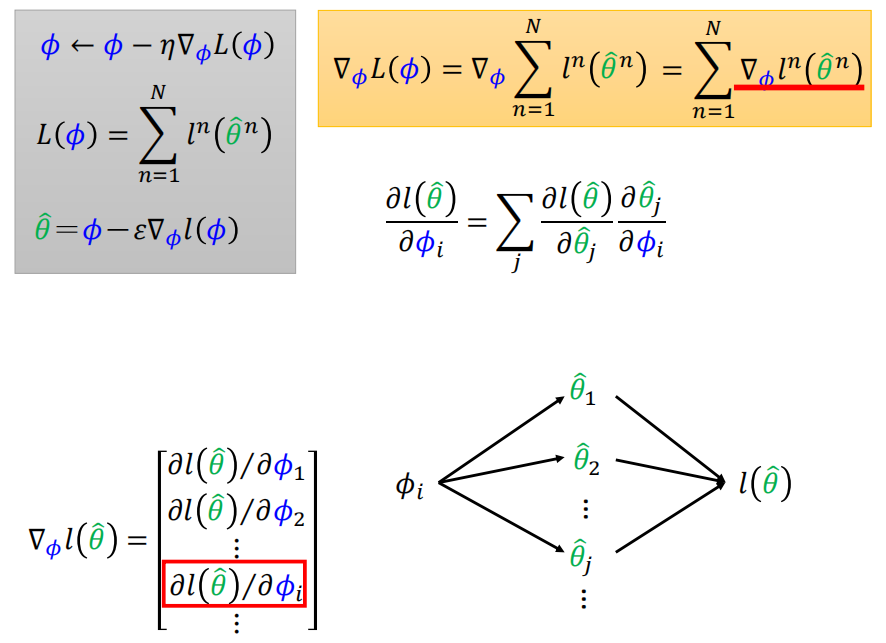

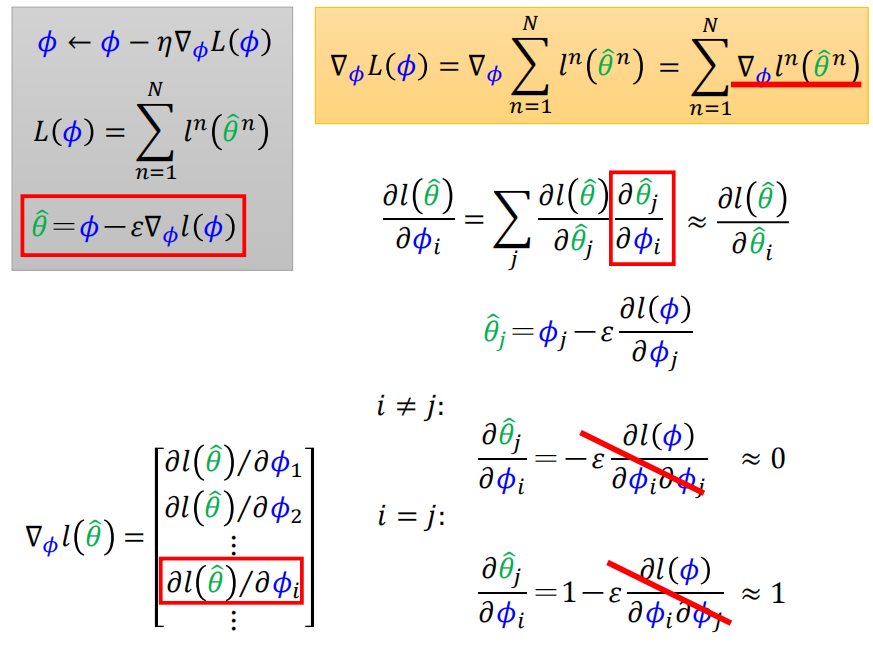

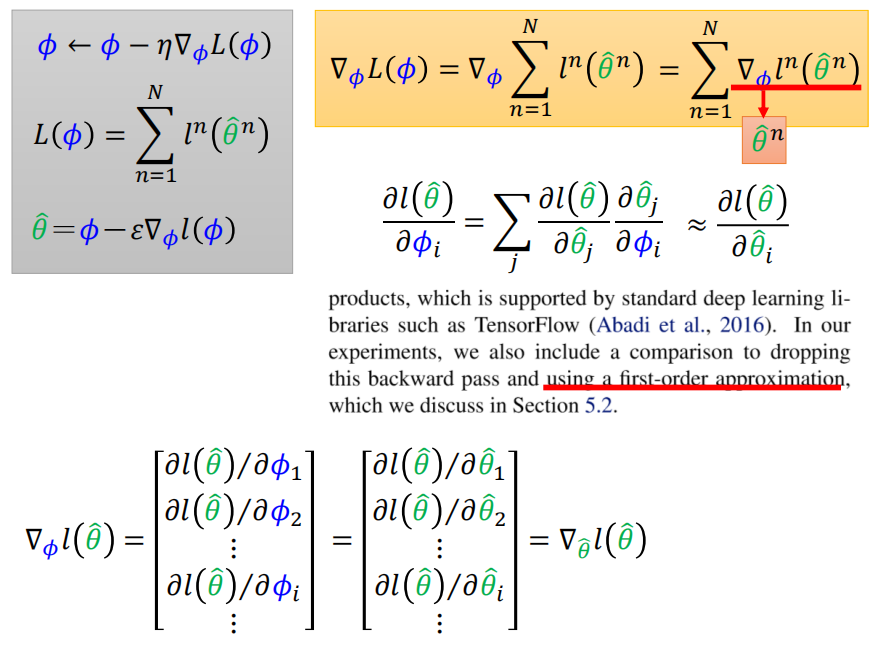

数学推导

MAML实施细节

预训练模型:在每个task上计算一个方向

MAML:每个task计算两次梯度下降得到一个方向

代码可以参考https://github.com/dragen1860/MAML-Pytorch

总结

本文介绍了基于元学习的算法MAML,MAML目标是训练一组初始化参数,模型通过初始化参数,仅用少量数据就能实现快速收敛的效果。为了达到这一目的,模型需要在不同任务上进行学习来不停修正初始化参数,使其能够适应不同种类的数据,最后对MAML和预训练模型进行了对比。

4390

4390

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?