深度循环神经网络

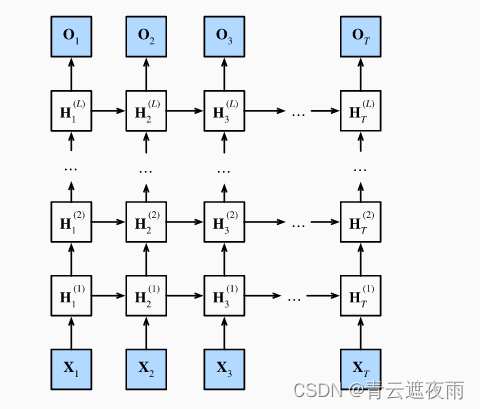

深度循环神经网络(Deep Recurrent Neural Network,简称DRNN)是一种循环神经网络(Recurrent Neural Network,简称RNN)的扩展形式,它具有多个隐藏层,并且可以处理长度不固定的序列数据。与传统的RNN相比,DRNN在每个时间步上执行多次非线性转换,以便对更长的序列数据进行建模。

在DRNN中,每个时间步的输入和隐藏状态都是向量形式的。网络中的每个隐藏层都有自己的权重矩阵,并且这些权重矩阵可以共同对输入和前一个隐藏层的状态进行转换。这使得DRNN能够通过多次非线性变换来学习更高级别的特征,从而提高其在序列数据上的建模能力。

DRNN可以应用于多种领域,如语音识别、自然语言处理、图像处理等。例如,在自然语言处理领域,DRNN可以用于处理不定长的文本序列,并进行情感分析、语音识别和机器翻译等任务。

数学计算

深度循环神经网络(DRNN)的计算公式可以描述为以下步骤:

对于每个时间步

t

t

t,输入

x

t

x_t

xt 和前一个时间步的隐藏状态

h

t

−

1

h_{t-1}

ht−1,计算当前时间步的隐藏状态

h

t

h_t

ht:

h

t

=

f

(

W

x

t

+

U

h

t

−

1

+

b

)

h_t = f(Wx_t + Uh_{t-1} + b)

ht=f(Wxt+Uht−1+b)

其中, W W W 是输入 x t x_t xt 的权重矩阵, U U U 是前一个时间步的隐藏状态 h t − 1 h_{t-1} ht−1 的权重矩阵, b b b 是偏置项。 f f f 是非线性激活函数,如sigmoid、tanh或ReLU等。

对于深度循环神经网络,可以使用多个隐藏层来提高网络的表达能力。每个隐藏层的计算方式与第一个隐藏层相同,但输入为前一个隐藏层的输出

h

t

−

1

(

l

)

h_{t-1}^{(l)}

ht−1(l):

h

t

(

l

)

=

f

(

W

(

l

)

h

t

(

l

−

1

)

+

U

(

l

)

h

t

−

1

(

l

)

+

b

(

l

)

)

h_t^{(l)} = f(W^{(l)}h_t^{(l-1)} + U^{(l)}h_{t-1}^{(l)} + b^{(l)})

ht(l)=f(W(l)ht(l−1)+U(l)ht−1(l)+b(l))

其中, W ( l ) W^{(l)} W(l) 和 U ( l ) U^{(l)} U(l) 分别是第 l l l 个隐藏层的权重矩阵, b ( l ) b^{(l)} b(l) 是第 l l l 个隐藏层的偏置项。

输出层的计算方式与传统的神经网络相同,即将最后一个隐藏层的输出

h

T

(

L

−

1

)

h_T^{(L-1)}

hT(L−1) 通过一个全连接层进行线性变换,并经过一个激活函数

g

g

g(如softmax):

y

=

g

(

V

h

T

(

L

−

1

)

+

c

)

y = g(Vh_T^{(L-1)} + c)

y=g(VhT(L−1)+c)

其中, V V V 是输出层的权重矩阵, c c c 是输出层的偏置项。

整个深度循环神经网络的训练过程就是通过反向传播算法来计算损失函数关于权重和偏置项的梯度,并使用梯度下降等优化算法来更新参数。

实现

import torch

from torch import nn

from d2l import torch as d2l

batch_size, num_steps = 32, 35

train_iter, vocab = d2l.load_data_time_machine(batch_size, num_steps)

vocab_size, num_hiddens, num_layers = len(vocab), 256, 2

num_inputs = vocab_size

device = d2l.try_gpu()

lstm_layer = nn.LSTM(num_inputs, num_hiddens, num_layers)

model = d2l.RNNModel(lstm_layer, len(vocab))

model = model.to(device)

注意:num_layers参数即为隐藏层层数

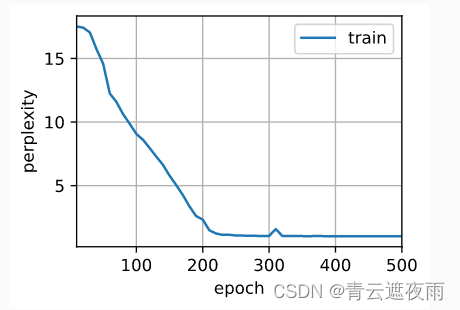

num_epochs, lr = 500, 2

d2l.train_ch8(model, train_iter, vocab, lr*1.0, num_epochs, device)

4329

4329

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?