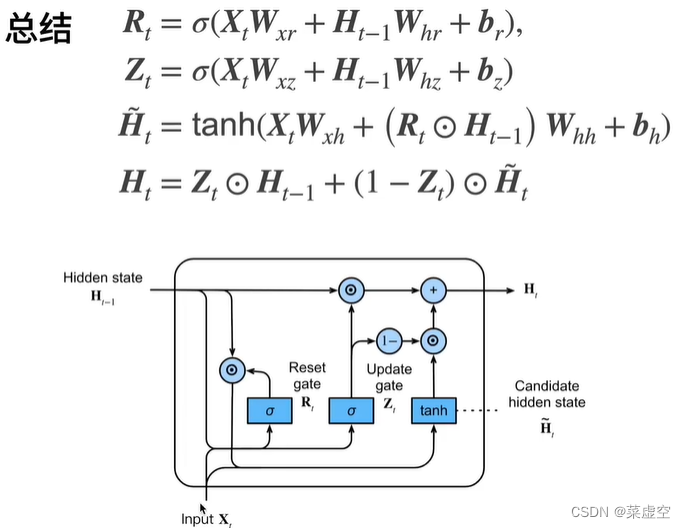

1.门循环神经网络(GRU)

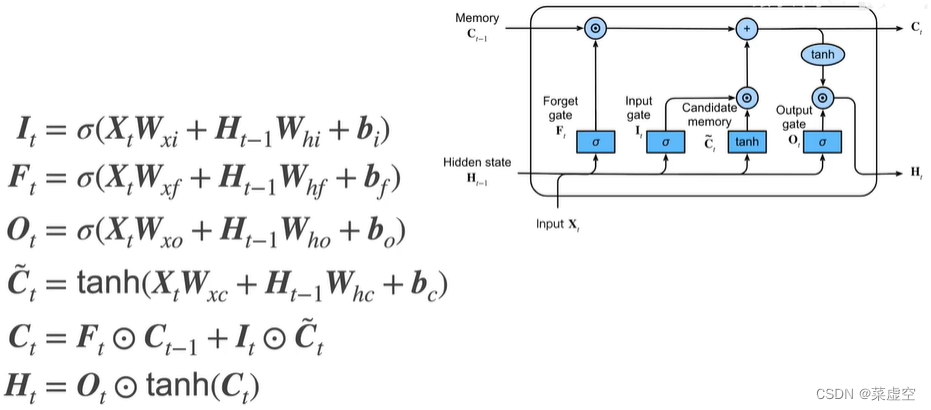

2.长短期记忆神经网络(LSTM)

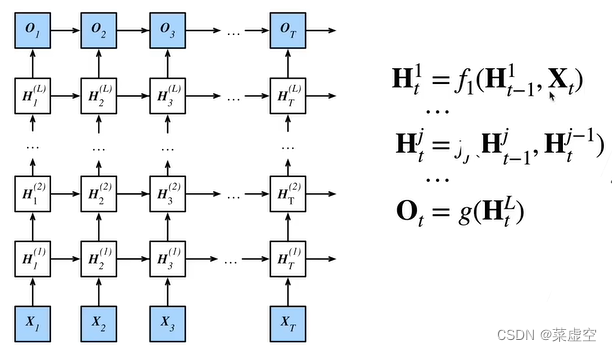

3.深度循环神经网络

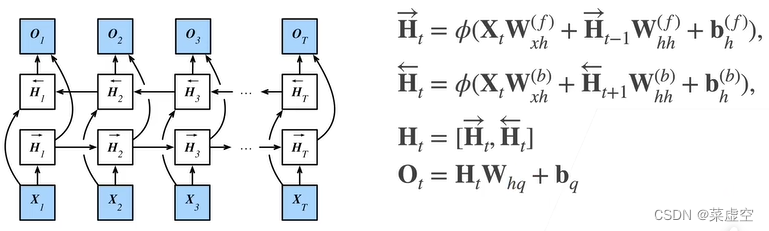

4.双向循环神经网络

这个方向的H:

①先将输入的顺序进行颠倒

=》得到输入到

,

②颠倒的输入传入网络

=》得到到

③将网络输出的H颠倒

=》然后将得到的H顺序颠倒得到到

④将正常输入得到的与颠倒输入③中得到的

进行dim=0维度上的合并,最后丢给输出层。

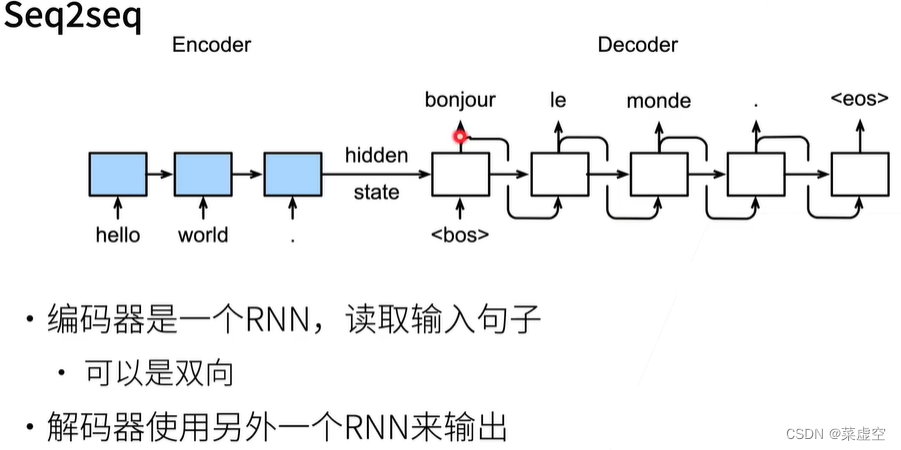

5.sequence to sequence

5.1编码器

其中前面的编码器是一个RNN(可以是简单的RNN、GRU、LSTM);

编码器只是将最后一个时刻的隐藏状态传给解码器;

encoder可以是双向的,因为不需要进行预测;

5.2解码器

解码器也是一个RNN;

首先将编码器的隐藏层输入到解码器;

然后在第一时刻输入<bos>表示开始翻译;

第一时刻解码器的的翻译作为下一个时刻的输入;

...

直到遇到<eos>表示停止。

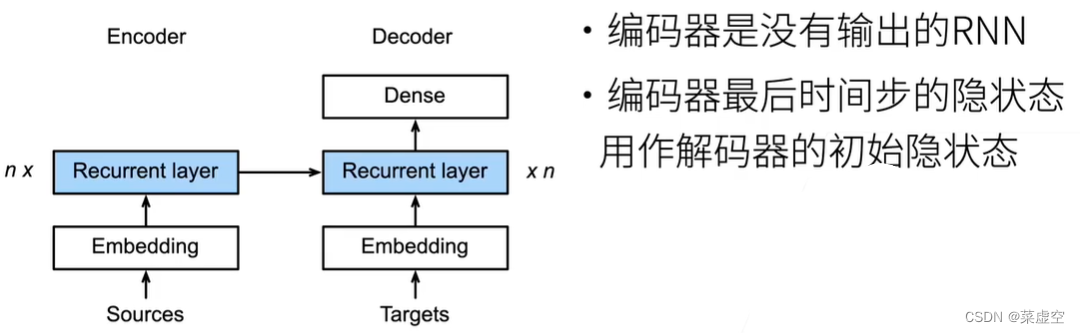

5.3编码器解码器细节

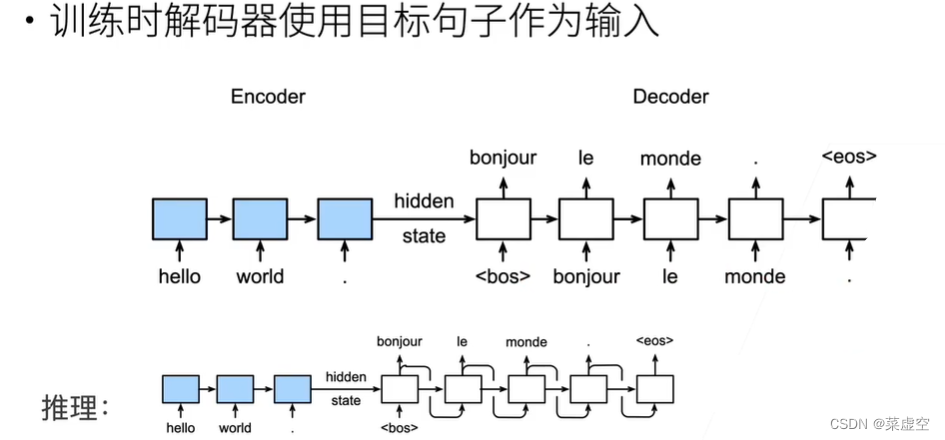

训练时将正确的句子作为输入,即使前一个预测错误了,但是下一个输入任然为正确的输入;

但是推理的时候则不同,每一次的推理都基于前一个时刻的预测单

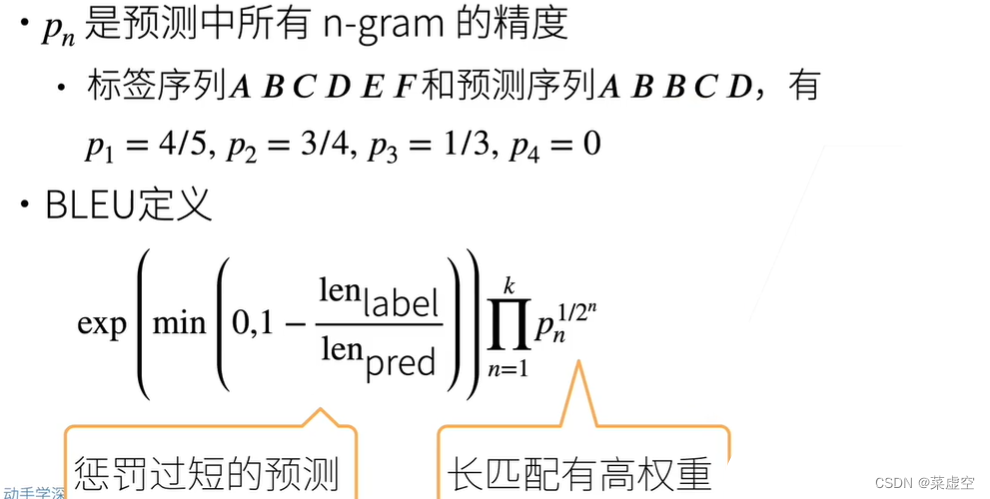

5.4衡量生成序列的好坏的BLEU

其中:P1对应的是一元语法的unigram预测正确的概率:P1=4/5;

P2对应的是二元语法的diagram预测正确的概率:AB、BC、CD,预测正确的有3个

...

5.4总结

723

723

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?