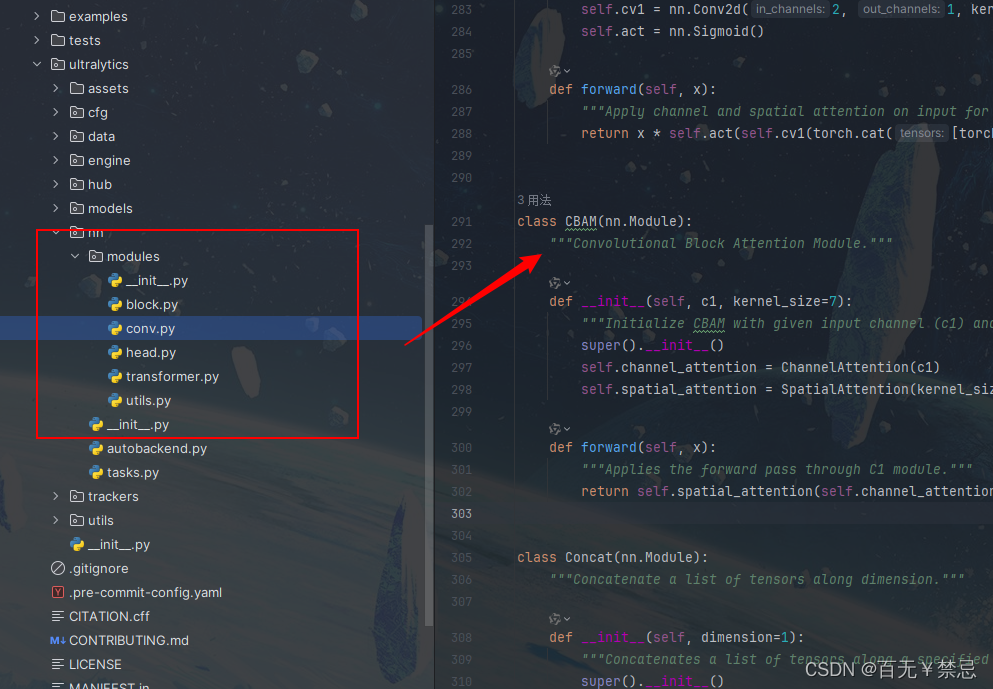

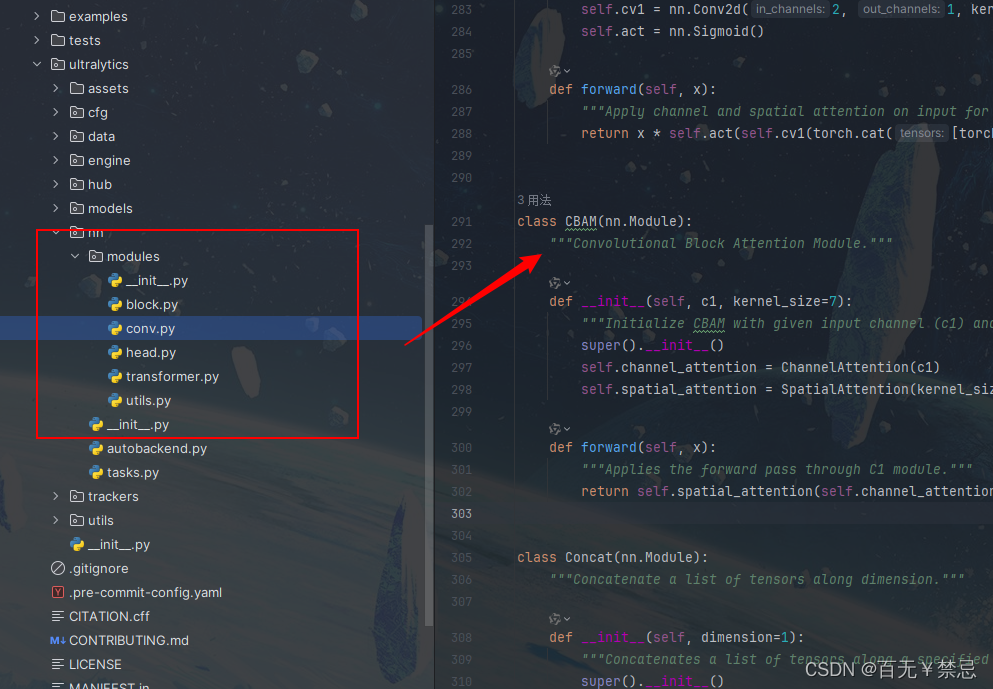

yolov8本身自带CBAM注意力,在nn/modules/conv.py文件最后面可以找到。

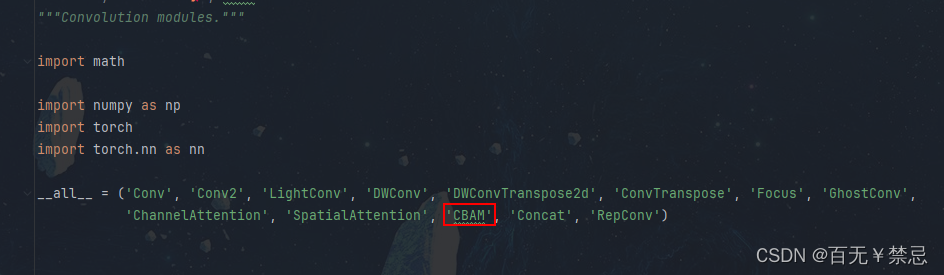

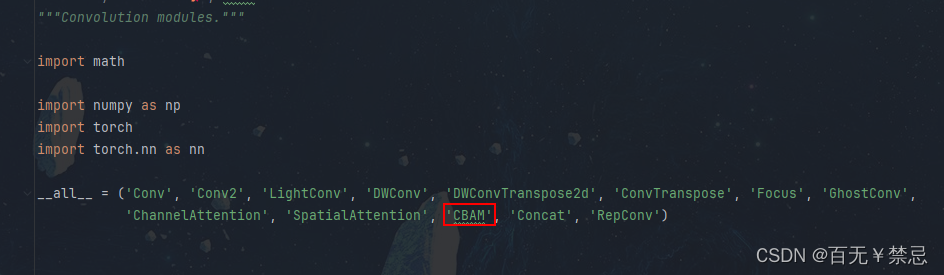

第一步:在conv.py添加名字

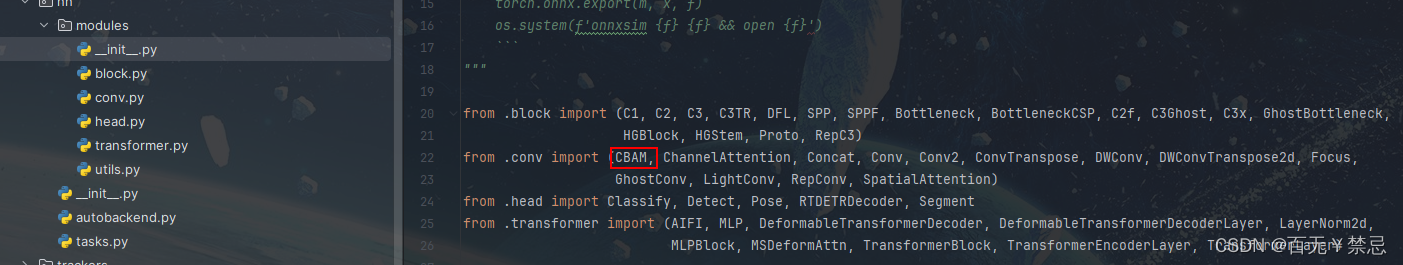

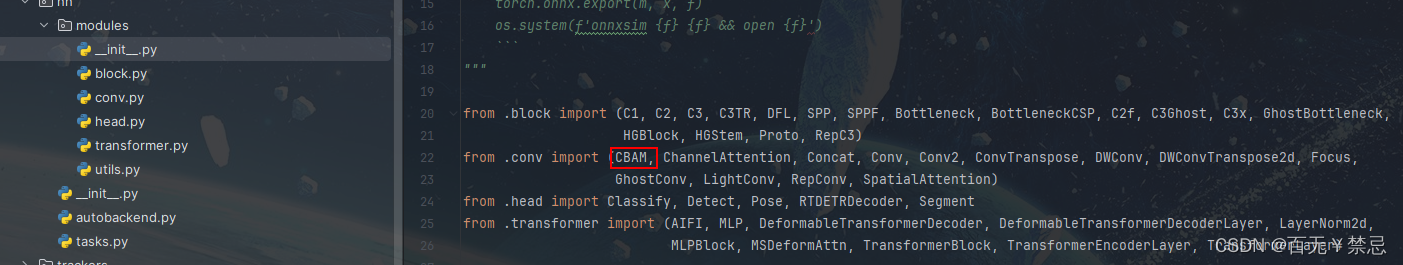

第二步:在_init_.py添加名字

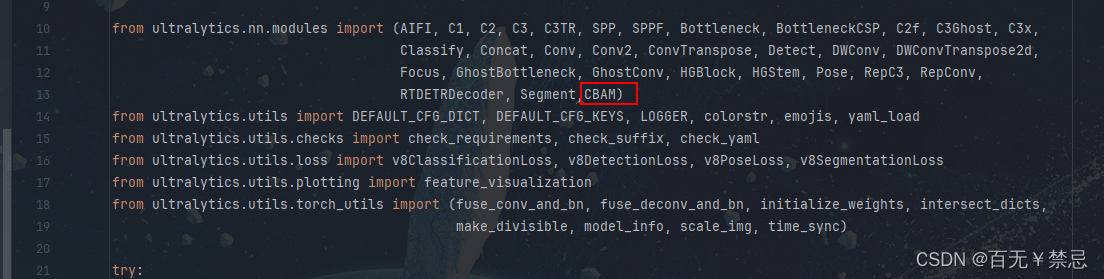

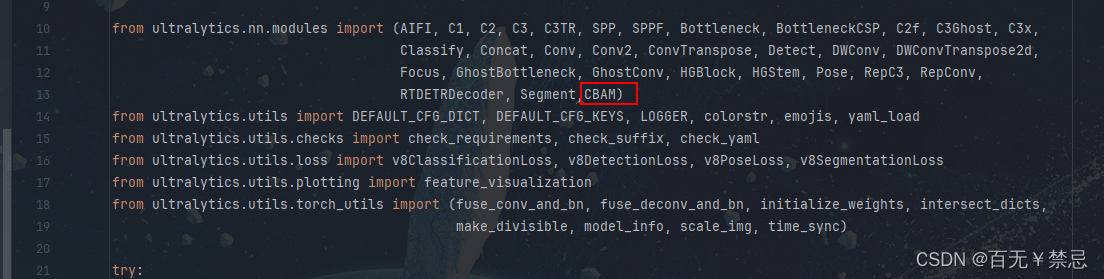

第三步:在tasks.py添加名字

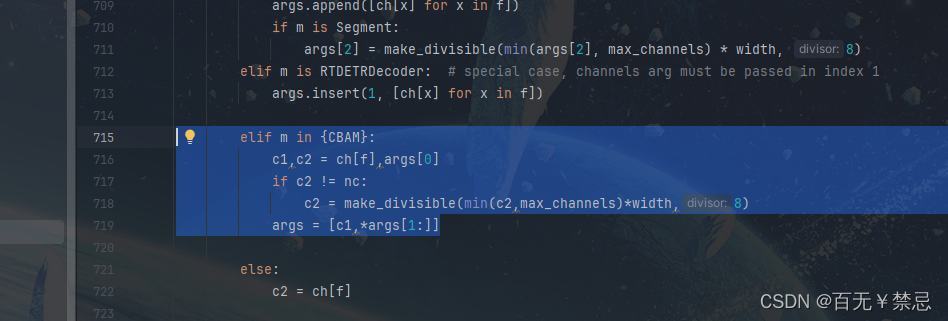

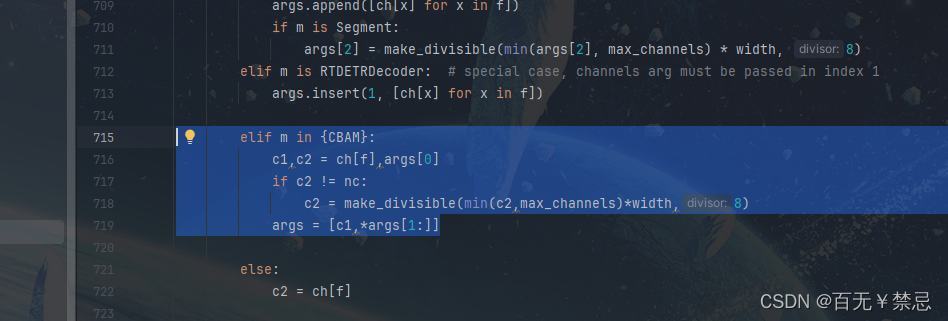

第四步:在tasks.py添加配置。715行左右

elif m in {CBAM}:

c1,c2 = ch[f],args[0]

if c2 != nc:

c2 = makeyolov8本身自带CBAM注意力,在nn/modules/conv.py文件最后面可以找到。

第一步:在conv.py添加名字

第二步:在_init_.py添加名字

第三步:在tasks.py添加名字

第四步:在tasks.py添加配置。715行左右

elif m in {CBAM}:

c1,c2 = ch[f],args[0]

if c2 != nc:

c2 = make 4495

4495

3077

3077

1008

1008

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?