2015-ResNet

关键词: residual connection

CV论文:一般在第一页就放一个很“好看”的图

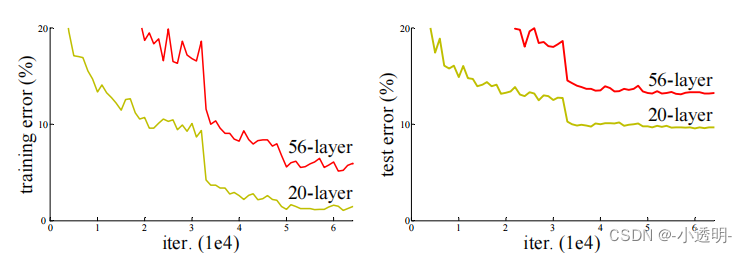

从图可以得到的结论:深的网络更难训练 ( 不仅因为过拟合,因为训练时误差都很难降低 )

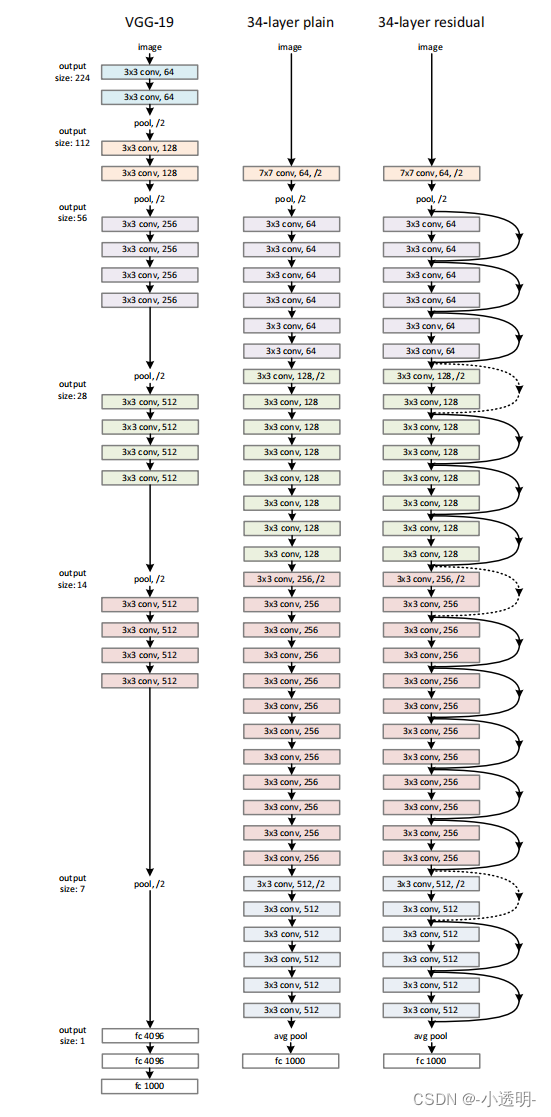

网络结构图

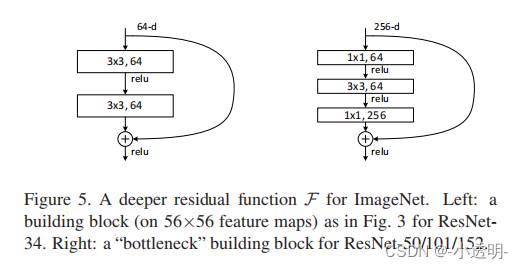

1*1卷积作用:改变通道数 ,提出维度匹配方法:1)补零;2)投影projection(1*1卷积)

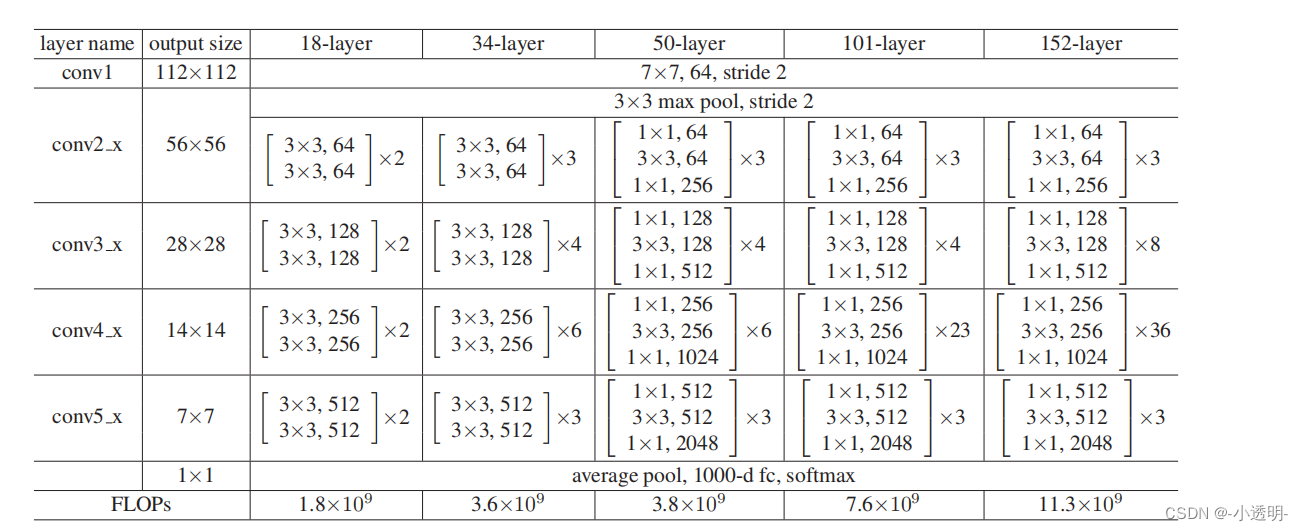

从50层开始,当网络更深,学到的特征就越多,通道数可以变大,为了保证参数量差不多,设计了bottleneck design(先利用1*1减小通道,最后再通过1*1变为更大的通道)

从50层开始,当网络更深,学到的特征就越多,通道数可以变大,为了保证参数量差不多,设计了bottleneck design(先利用1*1减小通道,最后再通过1*1变为更大的通道)

专业英语积累

Deep Residual Learning 深度残差学习

substantially (相当多地)deeper 非常深的

The depth of representations 表示的深度

Solely due to 唯一的原因

integrate 集成

present 提出了

explicitly reformulate 明确的重新制定

Plain Networks 普通的网络

the shallower 较浅的

the degradation problem 退化问题

solution space 解空间 subspace子空间

have non-zero variances 具有非零方差

exhibit 表现出

to some extent 在一定程度上

conjecture 猜测

exponentially low convergence rates 收敛率呈指数级降低

The baseline architectures 基线架构

identity mapping 恒等映射

be omitted 被省略

notations 记号

when the error plateaus 当误差趋于稳定时

accuracy gains 精度收益(提高)

marginally better than 略好于

ensemble result 集成的结果

exactly the same 完全相同的

horizontal flip 水平翻转

1397

1397

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?