神经网络(Neural Networks)是模仿生物神经系统的计算模型,用于处理复杂的模式识别和数据分析任务。下面是一些主要的神经网络类型及其特点和原理说明。

标准网络

-

感知器(Perceptron):

- 原理:单层感知器是最简单的神经网络,只有一个输入层和一个输出层。通过对输入特征的线性组合,再经过激活函数(通常是阶跃函数)得到输出。它主要用于二分类问题。

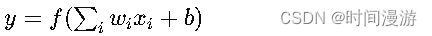

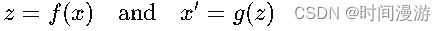

- 公式:

- 应用:适用于简单的线性可分问题。

-

前馈神经网络(Feed-Forward Neural Network, FFNN):

- 原理:信息在网络中单向流动,依次经过输入层、一个或多个隐藏层和输出层。每一层的神经元与下一层的神经元全连接。训练时使用反向传播算法,通过梯度下降法最小化误差。

- 公式:

- 应用:图像识别、语音识别等各种分类和回归任务。

-

残差网络(Residual Network, ResNet):

- 原理:为了解决深层神经网络的梯度消失问题,ResNet通过引入跳跃连接(skip connections)使得梯度可以直接传递到浅层,减轻了梯度消失和爆炸的问题。

- 公式:

- 应用:深度图像识别和分类任务。

循环网络

-

循环神经网络(Recurrent Neural Network, RNN):

- 原理:RNN具有环形结构,能够处理序列数据。每个节点的输出会影响自身的后续节点,具备记忆能力。常用的激活函数有tanh和ReLU。

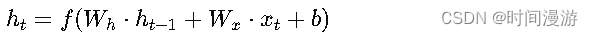

- 公式:

- 应用:文本生成、时间序列预测、语言模型。

-

长短期记忆网络(Long Short-Term Memory Network, LSTM):

- 原理:LSTM通过引入“遗忘门”、“输入门”和“输出门”控制信息的流动,解决了RNN中的长期依赖和梯度消失问题。

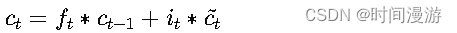

- 公式:

- 应用:序列预测、语音识别、机器翻译。

卷积网络

- 卷积神经网络(Convolutional Neural Network, CNN):

- 原理:通过卷积层和池化层的组合提取局部特征,减少参数数量,提高训练效率。卷积操作用来检测输入数据中的局部模式。

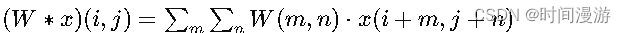

- 公式:

- 应用:图像和视频识别、物体检测、图像分割。

自动编码器

- 自动编码器(Autoencoder):

- 原理:一种无监督学习算法,包含编码器和解码器两部分。编码器将输入数据映射到隐空间,解码器将隐空间的表示重建回原始数据。

- 公式:

- 应用:数据降维、特征提取、去噪。

其他网络

-

BP网络(Back Propagation Network):

- 原理:多层前向神经网络,通过误差反向传播算法训练。每层神经元的输出通过权重连接到下一层神经元。

- 公式:

- 应用:分类和回归任务。

-

径向基函数网络(Radial Basis Function Network, RBF):

- 原理:使用径向基函数作为激活函数,通常用于函数逼近和分类。输出层是输入层到隐层的径向基函数的加权和。

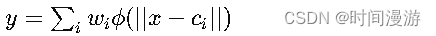

- 公式:

- 应用:函数逼近、时间序列预测。

-

Hopfield网络:

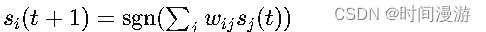

- 原理:递归神经网络,具备联想记忆功能。网络中的每个神经元与其他所有神经元相连接,能记忆输入模式并进行模式恢复。

- 公式:

- 应用:联想记忆、优化问题。

-

自组织特征映射网络(Self-Organizing Map, SOM):

- 原理:无监督学习神经网络,将高维输入数据映射到低维格子,保持数据的拓扑结构。

- 公式:

- 应用:数据可视化、聚类。

-

注意力机制网络(Attention Network):

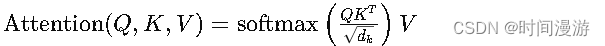

- 原理:通过分配不同权重给输入的不同部分,提高模型对重要信息的关注度。广泛应用于自然语言处理任务。

- 公式:

- 应用:机器翻译、文本生成、图像描述。

-

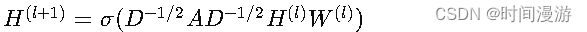

图卷积神经网络(Graph Convolutional Network, GCN):

- 原理:处理图结构数据,通过卷积操作提取节点特征。适用于社交网络、通信网络等具有不规则拓扑结构的数据。

- 公式:

- 应用:节点分类、图嵌入、社交网络分析。

特殊类型

- 全连接层(Fully Connected Layer):

- 原理:每个神经元与前一层的所有神经元相连接,常用于神经网络的最后几层进行分类或回归任务。

- 公式:

- 应用:各种深度学习任务中的最后分类或回归层。

通过了解这些神经网络的特点和工作原理,可以更好地选择和应用合适的神经网络结构来解决具体问题。

参考文献

- Wikipedia: Artificial neural network

- Towards Data Science: Types of Neural Networks

- OpenAI Documentation

- Deep Learning by Ian Goodfellow, Yoshua Bengio, and Aaron Courville

60万+

60万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?