集成学习

我们之前讨论的学习器都是单一的,独立的。

整体表现比较差的学习器,在一些样本上的表现是否有可能会超过“最好”的学习器。

集成学习就是组合多个学习器,最后可以得到一个更好的学习器。

bagging

有放回的抽样

例子

# 导入算法包以及数据集

from sklearn import neighbors

from sklearn import datasets

from sklearn.ensemble import BaggingClassifier

from sklearn import tree

from sklearn.model_selection import train_test_split

import numpy as np

import matplotlib.pyplot as plt

iris = datasets.load_iris()

x_data = iris.data[:,:2]#这里只要鸢尾花的第零个和第一个特征

y_data = iris.target #获取标签

x_train,x_test,y_train,y_test = train_test_split(x_data, y_data)

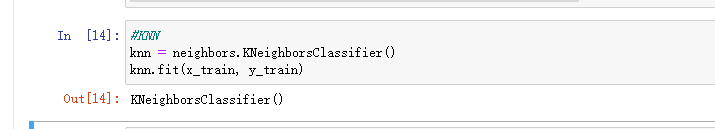

#KNN

knn = neighbors.KNeighborsClassifier()

knn.fit(x_train, y_train)

#画图

def plot(model):

# 获取数据值所在的范围

x_min, x_max = x_data[:,0].min() - 1, x_data[:,0].max() + 1

y_min, y_max = x_data[:,1].min() - 1, x_data[:,1].max() + 1

# 生成网格矩阵

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.02),

np.arange(y_min, y_max, 0.02))

z = model.predict(np.c_[xx.ravel(), yy.ravel()])

# ravel与flatten类似,多维数据转一维。flatten不会改变原始数据,ravel会改变原始数据

z = z.reshape(xx.shape)

# 等高线图

cs = plt.contourf(xx, yy, z)

# 画等高线图

plot(knn)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

# 显示准确率

knn.score(x_test, y_test)

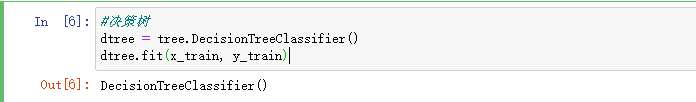

#决策树

dtree = tree.DecisionTreeClassifier()

dtree.fit(x_train, y_train)

# 画图

plot(dtree)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

# 准确率

dtree.score(x_test, y_test)

#集成学习

# knn表示传入的模型,n_estimators=100表示有放回的抽样要进行100次

bagging_knn = BaggingClassifier(knn, n_estimators=100)

# 输入数据建立模型

bagging_knn.fit(x_train, y_train)

plot(bagging_knn)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

bagging_knn.score(x_test, y_test)

bagging_tree = BaggingClassifier(dtree, n_estimators=100)

# 输入数据建立模型

bagging_tree.fit(x_train, y_train)

plot(bagging_tree)

# 样本散点图

plt.scatter(x_data[:, 0], x_data[:, 1], c=y_data)

plt.show()

bagging_tree.score(x_test, y_test)

#加入bagging之后,准确率变低

加入之后,准确率有可能变低,也有可能变高,还有可能不变,但如果是大的数据集的话,大概率是变高的。

886

886

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?