一.文献名字和作者

Dropout: A Simple Way to Prevent Neural Networks from Overtting

二.阅读时间

2014年11月19日

三.文献的贡献点

这篇文章主要还是复述了一遍那篇引入dropout的文章《Improving neural networks by preventing co-adaptation of feature detectors》里面的观点:1.Dropout能够克服Overfitting,同时也是一种能够高效整合不同网络结构的技术;2.使用权值梯度的L2模的上限能够获得比使用权值的L2模的惩罚项更好的效果,这样也能叫做max-norm惩罚项。

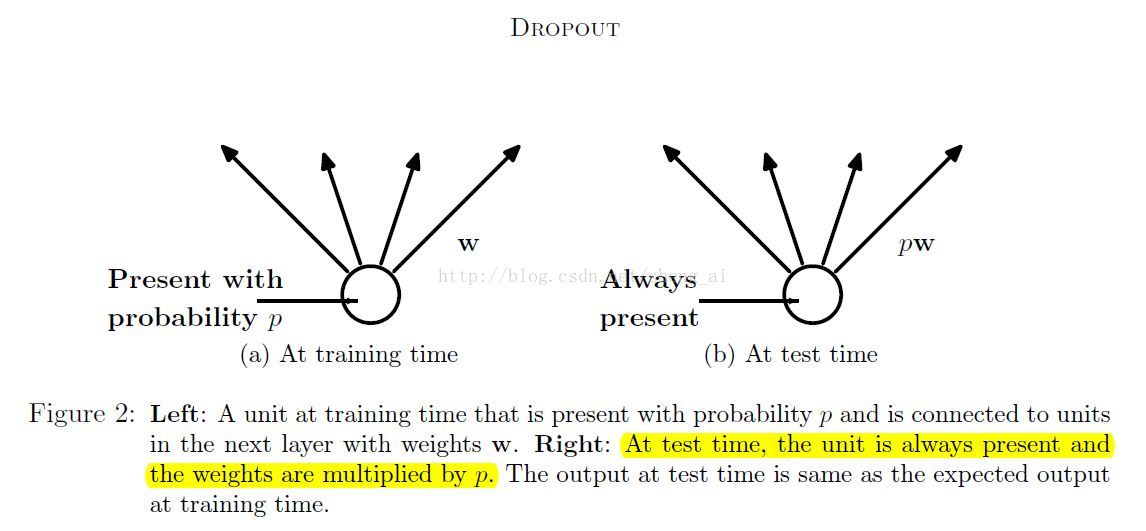

使用Dropout的训练过程和测试过程可以用下图表示,在训练过程,每一个隐藏层神经元以概率p的形式进行激活,而在测试过程中,所有的隐藏层神经元都进行激活,但是,每一个隐藏层神经元的输出都乘以p。

相比于DAEs,dropout主要是用在有监督训练的过程中,其主要思想也是有借鉴DAEs的感觉。

在使用预训练得到的网络进行Dropout,需要将获得的权值乘以1/p,这样才可以保持在使用Dropout的过程中,神经与的激活和预训练过程程度一样。

用于避免神经网络Overfitting的惩罚方法有几种:L2衰减,lasso,KL稀疏和最大模惩罚。

对于Dropout来说,一个附件的作用就是能够使得隐藏层神经元出现稀疏性。

作者也提出了一个Dropout Restricted Boltzmann Machines,具体内容还没自己看,mark一下,以后用到DNN的时候再来深入研究下。

作者也发现了,使用Dropout的缺点就是会使得训练时间增加,是没使用Dropout网络的2-3倍,因此,加速Dropout也是未来一个研究点。一个在减少时间的同时也获得dropout效果的方法就是加入一个和Dropout效果相同的惩罚项。

版权所有,欢迎转载,转载请注明出处,谢谢

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?