本次介绍的依然是压缩网络的方法,不过有了具体的应用场景:压缩的模型是DeepID2+。方法来源于《2015 arxiv: Sparsifying Neural Network Connections for Face Recognition》,文章是王晓刚、汤晓鸥团队的,所以结果依旧很漂亮,但谁又能保证没点trick呢。T_T

压缩的核心:剪枝+再训练

算法流程

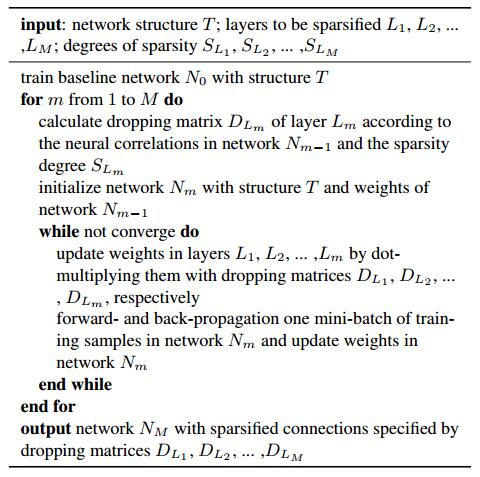

整个算法的流程很简单:从网络的最后一层开始,根据一定规则对该层进行剪枝,然后retrain网络,循环上述过程。

剪枝的实现方法,就是为权重施加一个相同大小的Mask, Mask中只有激活的地方才是1,其余全0.

算法流程图如下:

剪枝准则

剪枝的目标就是只保留重要的权重。

全连接层剪枝

首先,对于如全连接和局部连接这些没有权值共享的层,我们可以很简单的计算神经元之间的相关性

本文介绍了压缩DeepID2+网络的方法,通过剪枝和再训练,专注于全连接层和卷积层的优化。算法流程包括从最后一层开始逐步剪枝并重新训练,剪枝基于神经元之间的相关性计算,实验表明在保持性能的同时减少了网络参数。

本文介绍了压缩DeepID2+网络的方法,通过剪枝和再训练,专注于全连接层和卷积层的优化。算法流程包括从最后一层开始逐步剪枝并重新训练,剪枝基于神经元之间的相关性计算,实验表明在保持性能的同时减少了网络参数。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

5284

5284

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?