以下内容和图片均来自台湾大学深度学习课程。

课程地址:https://www.csie.ntu.edu.tw/~yvchen/f106-adl/syllabus.html

Review

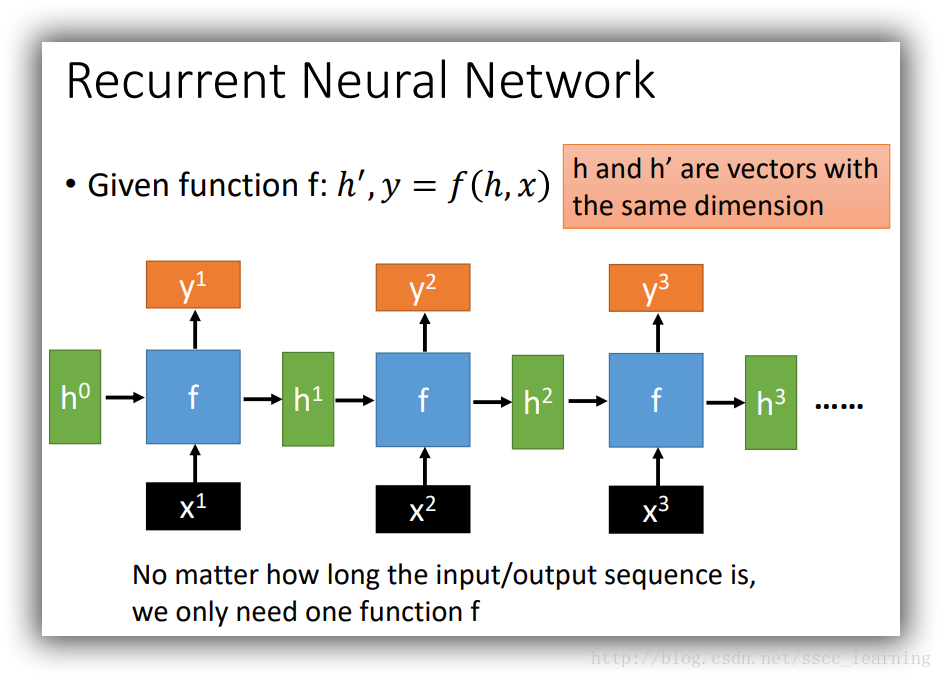

首先复习一下 lecture3-1 Recurrent Neural Network 讲过的RNN结构。

RNN

假设现在有3个sequence表示为 x1 、 x2 、 x3 ,设定的初始化向量 h0 ;将 x1 与 h0 放入function f 中,得到

sequence。

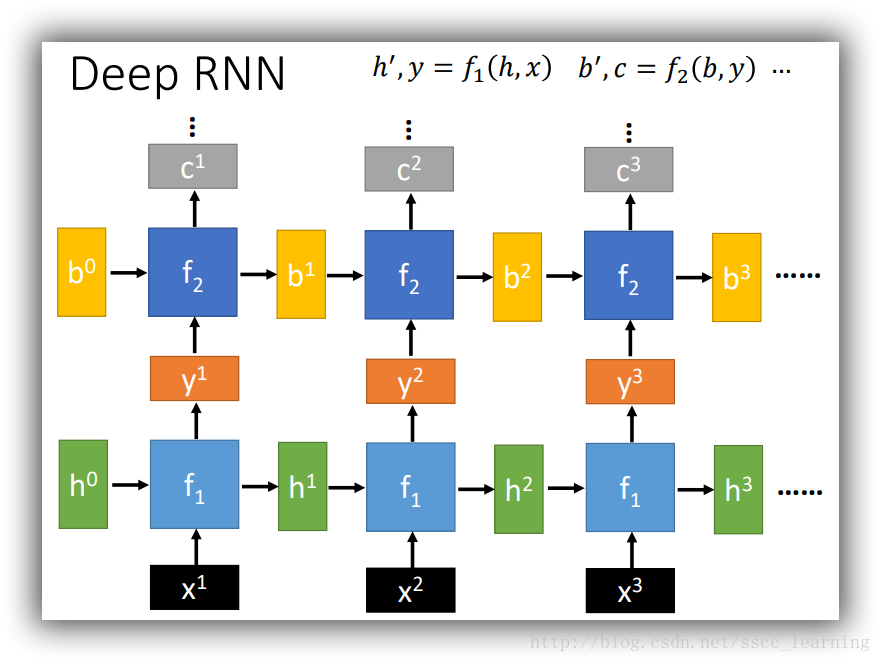

Deep RNN

上面说的方法只有一个隐藏层,RNN当然也可以是多个隐藏层的Deep RNN。如下图,输出的 y1 结果可以和另一个初始化的向量 b0 放到另一个function f2 中,得到 c1 与 b1 ,然后继续……

Bidirectional RNN 双向

首先从 x1 到

这篇博客是台湾大学深度学习课程的学习笔记,重点讲解了LSTM和GRU两种门控循环神经网络。内容涵盖RNN回顾、Deep RNN、双向RNN,详细介绍了LSTM的结构、工作原理以及GRU的简化设计,并对比了LSTM与GRU的差异。文中引用了相关文献,探讨了不同处理方式对LSTM效果的影响。

这篇博客是台湾大学深度学习课程的学习笔记,重点讲解了LSTM和GRU两种门控循环神经网络。内容涵盖RNN回顾、Deep RNN、双向RNN,详细介绍了LSTM的结构、工作原理以及GRU的简化设计,并对比了LSTM与GRU的差异。文中引用了相关文献,探讨了不同处理方式对LSTM效果的影响。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1140

1140

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?