1、概率分布函数与概率密度函数

我们可以用随机变量

X

(

A

)

X(\rm A)

X(A)表示随机事件A与实数之间的关系。为了简化表达,我们用

X

X

X表示这个随机变量,省去了A。随机变量可以是离散的,也可以是连续的。

随机变量

X

X

X的概率分布函数可以表示为

P

X

(

x

)

=

P

r

(

X

≤

x

)

,

P_X(x)={\rm Pr}(X\le x),

PX(x)=Pr(X≤x),其中

P

r

(

X

≤

x

)

{\rm Pr}(X\le x)

Pr(X≤x)表示随机变量

X

X

X落到实数区间

(

−

∞

,

x

)

(-\infty,x)

(−∞,x)内的概率,

x

x

x为一个实数。分布函数

P

X

(

x

)

P_X(x)

PX(x)有如下性质:

- 0 ≤ P X ( x ) ≤ 1 0\le P_X(x)\le 1 0≤PX(x)≤1

- P X ( x 1 ) ≤ P X ( x 2 ) , i f x 1 ≤ x 2 P_X(x_1)\le P_X(x_2),\quad {\rm if}\ x_1\le x_2 PX(x1)≤PX(x2),if x1≤x2

- P X ( − ∞ ) = 0 P_X(-\infty)=0 PX(−∞)=0

-

P

X

(

∞

)

=

1

P_X(\infty)=1

PX(∞)=1

随机变量另外一个非常有用的函数是概率密度函数(probability density function, pdf),它的定义是

p X ( x ) = d P X ( x ) d x , p_X(x)=\frac{{\rm d}P_X(x)}{{\rm d}x}, pX(x)=dxdPX(x),显然它也是实数 x x x的函数。那么为什么我们把它叫做“密度函数”呢?我们来看看随机变量落到区间 [ x 1 , x 2 ] [x_1,x_2] [x1,x2]上的概率:

P r ( x 1 ≤ X ≤ x 2 ) = P r ( X ≤ x 2 ) − P r ( X ≤ x 1 ) = P X ( x 2 ) − P X ( x 1 ) = ∫ x 1 x 2 p X ( x ) d x \begin{aligned} {\rm Pr}(x_1\le X\le x_2)&={\rm Pr}(X\le x_2)-{\rm Pr}(X\le x_1)\\ &=P_X(x_2)-P_X(x_1)\\ &=\int_{x_1}^{x_2}p_X(x)dx \end{aligned} Pr(x1≤X≤x2)=Pr(X≤x2)−Pr(X≤x1)=PX(x2)−PX(x1)=∫x1x2pX(x)dx

这样, X X X落到非常窄的区间 [ x , x + Δ x ] [x, x+\Delta x] [x,x+Δx]上的概率可以近似为

P r ( x ≤ X ≤ x + Δ x ) = ∫ x x + Δ x p X ( x ) d x ≈ p X ( x ) Δ X {\rm Pr}(x\le X\le x+\Delta x)=\int_x^{x+\Delta x}p_X(x)dx\approx p_X(x)\Delta X Pr(x≤X≤x+Δx)=∫xx+ΔxpX(x)dx≈pX(x)ΔX这样当 x → 0 x\rightarrow 0 x→0时,我们可以得到

P r ( X = x ) = p X ( x ) d x . {\rm Pr}(X=x)=p_X(x)dx. Pr(X=x)=pX(x)dx.

随机变量的pdf具有如下性质: - p X ( x ) ≥ 0 p_X(x)\ge 0 pX(x)≥0

- ∫ − ∞ ∞ p X ( x ) d x = 1. \int_{-\infty}^{\infty}p_X(x)dx=1. ∫−∞∞pX(x)dx=1.

2、集合平均

在第2.1节我们介绍了时间平均算子。时间平均算子对确定信号而言是非常有用的运算,因为确定信号的直流、能量、平均功率、相关函数等都是基于时间平均算子来定义的。2.1节中也提到,我们还有一种平均算子就叫做集合平均,下面我们来看看它是如何定义的。

对于随机变量

X

X

X,它的均值(期望值)定义为

m

X

=

E

[

X

]

=

∫

−

∞

∞

x

p

X

(

x

)

d

x

m_X={\rm E}[X]=\int_{-\infty}^{\infty}xp_X(x)dx

mX=E[X]=∫−∞∞xpX(x)dx这里的

E

[

⋅

]

{\rm E}[\cdot]

E[⋅]就称为集合平均算子。随机变量

X

X

X概率分布的

n

n

n阶矩定义为

E

[

X

n

]

=

∫

−

∞

∞

x

n

p

X

(

x

)

d

x

{\rm E}[X^n]=\int_{-\infty}^{\infty}x^np_X(x)dx

E[Xn]=∫−∞∞xnpX(x)dx

从通信系统分析角度来看,我们最为常用的是一阶以及二阶矩,具体定义如下:

- 一阶(原点)矩:也就是上面定义的

X

X

X的均值

m X = E [ X ] = ∫ − ∞ ∞ x p X ( x ) d x m_X={\rm E}[X]=\int_{-\infty}^{\infty}xp_X(x)dx mX=E[X]=∫−∞∞xpX(x)dx - 二阶(原点)矩:也就是

X

X

X的均方值

E [ X 2 ] = ∫ − ∞ ∞ x 2 p X ( x ) d x {\rm E}[X^2]=\int_{-\infty}^{\infty}x^2p_X(x)dx E[X2]=∫−∞∞x2pX(x)dx

我们还可以定义中心矩来刻画 X X X与 m X m_X mX之间的偏差,常用的包括: - 二阶(中心)矩:也就是

X

X

X的方差(variance)

v a r ( X ) = σ x 2 = E [ ( X − m X ) 2 ] = ∫ − ∞ ∞ ( x − m X ) 2 p X ( x ) d x {\rm var}(X)=\sigma_x^2={\rm E}[(X-m_X)^2]=\int_{-\infty}^{\infty}(x-m_X)^2p_X(x)dx var(X)=σx2=E[(X−mX)2]=∫−∞∞(x−mX)2pX(x)dx其中 σ x \sigma_x σx称为 X X X的标准偏差。

关于方差,有两个问题我们需要注意一下。首先是方差的物理意义。方差是随机变量 X X X“随机性”的量度,给定了随机变量的方差,实际也就是给定了它的概率密度函数的宽度,其次是均值、均方值与方差的关系。我们可以得到

σ x 2 = E [ ( X − m X ) 2 ] = E [ X 2 + m X 2 − 2 m X X ] = E [ X 2 ] − m X 2 \begin{aligned} \sigma_x^2&={\rm E}[(X-m_X)^2]\\ &={\rm E}[X^2+m^2_X-2m_XX]\\ &={\rm E}[X^2]-m_X^2 \end{aligned} σx2=E[(X−mX)2]=E[X2+mX2−2mXX]=E[X2]−mX2也就是说,方差等于均方值减去均值的平方。

3、高斯分布

高斯分布(也称为正态分布),是所有做通信、信号处理人的最爱.这种爱,不仅仅来自于她的优雅对称,更来自于我们几乎可以得到所有相关的统计特性。在分析中,只要能够把一个变量看作是高斯分布,我们立刻就喜笑颜开,如释重负,美好前景就在前面。如果是非高斯分布?好吧,我们慢慢来……

这部分的参考文献大家可以在网上找到很多,我们下面引用的是一篇《名为正态分布的前世今生》,我给出了网页的拷屏图片,以感谢为了科学的普及在网上默默付出的人们。我们仅仅引用了其中的第一部分,同时对部分内容用【注:】的形式进行了解释。我知道你在概率课程里面已经学过高斯变量,不过如果你能够静下心来好好品味,也许会领略到高斯分布别样的风情。

一、正态分布,熟悉的陌生人

学过基础统计学的同学大都对正态分布非常熟悉。这个钟型的分布曲线不但形状优雅,其密度函数写成数学表达式

p

X

(

x

)

=

1

2

π

σ

e

−

(

x

−

μ

2

)

2

σ

2

p_X(x)=\frac{1}{\sqrt{2\pi}\sigma}e^{-\frac{(x-\mu^2)}{2\sigma^2}}

pX(x)=2πσ1e−2σ2(x−μ2)也非常具有数学的美感。【注:这里的

μ

\mu

μ、

σ

2

\sigma^2

σ2分别为均值和方差】。其标准化后的概率密度函数【注:标准化就是把均值化为0,方差化为1】为

p

X

(

x

)

=

1

2

e

−

x

2

2

p_X(x)=\frac{1}{2}e^{-\frac{x^2}{2}}

pX(x)=21e−2x2

更加的简洁漂亮。两个最重要的数学常量

π

\pi

π、

e

e

e 都出现在了公式之中。在我个人的审美之中,它也属于top-N的最美丽的数学公式之一,如果有人问我数理统计领域哪个公式最能让人感觉到上帝的存在,那我一定投正态分布的票。因为这个分布戴着神秘的面纱,在自然界中无处不在,让你在纷繁芜杂的数据背后看到隐隐的秩序。

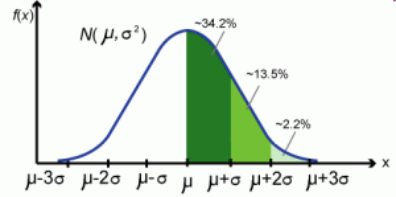

【注:上面这张图原文中没有做解释,大家可以跟我一起看一下。这是概率密度函数曲线,横坐标是实数轴,纵坐标是概率密度。正态分布的概率密度函数关于均值左右对称。高斯分布的随机变量 X X X取值落在 [ μ , μ + σ ] [\mu,\mu+\sigma] [μ,μ+σ]区间的大约概率为34.2%,在 [ μ + σ , μ + 2 σ ] [\mu+\sigma,\mu+2\sigma] [μ+σ,μ+2σ]区间的概率大约为13.5%,在 [ μ + 2 σ , μ + 3 σ [\mu+2\sigma,\mu+3\sigma [μ+2σ,μ+3σ]区间的概率大约为2.2%。提个问题,在区间 [ − ∞ , μ ] [-\infty,\mu] [−∞,μ]的概率为多少?】

正态分布又通常被称为高斯分布,在科学领域,冠名权那是一个很高的荣誉。去过德国的兄弟们还会发现,德国的钢镚和10马克的纸币上都留有高斯的头像和正态密度曲线。正态分布被冠名高斯分布,我们也容易认为是高斯发现了正态分布,其实不然,不过高斯对于正态分布的历史地位的确是起到了决定性的作用。

正态曲线虽然看上去很美,却不是一拍脑袋就能想到的。我们在学习数理统计的时候,课本一上来介绍正态分布就给出密度分布函数,却从来不说明这个分布函数是通过什么原理推导出来的。所以我一直搞不明白数学家当年是怎么找到这个概率分布曲线的,又是怎么发现随机误差服从这个奇妙的分布的。我们在实践中大量的使用正态分布,却对这个分布的来龙去脉知之甚少,正态分布真是让人感觉既熟悉又陌生。直到我读研究生的时候,我的导师给我介绍了陈希儒院士的《数理统计学简史》这本书,看了之后才了解了正态分布曲线从发现到被人们重视进而广泛应用,也是经过了几百年的历史。

【注:中间的主要内容我们略去了,因为涉及很多统计学的内容。有兴趣的同学可以自己进行阅读http://songshuhui.net/archives/76501。我们最后引用文章的结尾】

好的,风景欣赏暂时告一段落。所谓横看成岭侧成峰,远近高低各不同,正态分布给人们提供了多种欣赏角度和想象空间。法国菩萨级别的大数学家庞加莱对正态分布说过一段有意思的话,引用来作为这个小节的结束:

【注:或者换句话说,高斯分布建立了数学与物理世界的联系,明白我们为何如此看重它了吧?在我们这门课程里面,大家跟高斯分布打交道主要是分析噪声。】

本文深入探讨概率分布函数与概率密度函数的概念,解析集合平均的数学意义,并详细阐述高斯分布的魅力及其在自然界的广泛存在。高斯分布,以其优雅的钟形曲线和简洁的数学表达式,成为统计学中的明星,不仅因其美学价值,更因其在自然界中的普遍适用性和强大的数学特性。

本文深入探讨概率分布函数与概率密度函数的概念,解析集合平均的数学意义,并详细阐述高斯分布的魅力及其在自然界的广泛存在。高斯分布,以其优雅的钟形曲线和简洁的数学表达式,成为统计学中的明星,不仅因其美学价值,更因其在自然界中的普遍适用性和强大的数学特性。

1294

1294

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?