《Deep Residual Learning for Image Recognition》论文解读。

本文来自于MSRA,作者是大神何凯明。

概述

本文提出了一种Residual learning的框架,和以前的深层模型比起来,层数要深很多。在ImageNet2015的比赛中,作者使用了152层的网络取得了第一名。

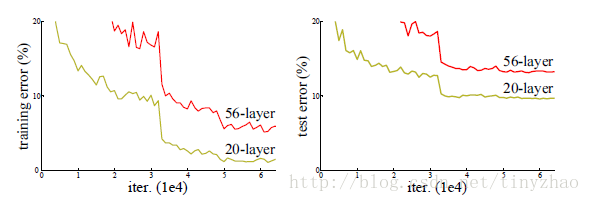

随着网络结构的加深,带来了两个问题:一是vanishing/exploding gradient,导致了训练十分难收敛,这类问题能够通过normalized initialization 和intermediate normalization layers解决;另一个是被称为degradation的退化现象。对合适的深度模型继续增加层数,模型准确率会下滑(不是overfit造成),training error和test error都会很高,相应的现象在CIFAR-10和ImageNet都有出现。

结构

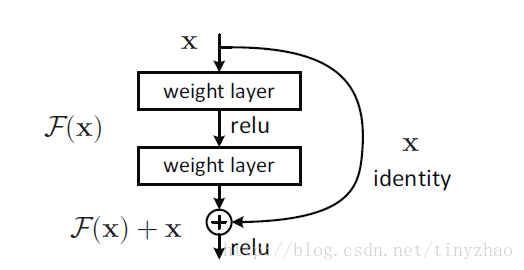

作者提出了residual learning的网络结构。

假设潜在映射为H(x),结构中的非线性层拟合残差 F(x):=H(x)−x

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

683

683

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?