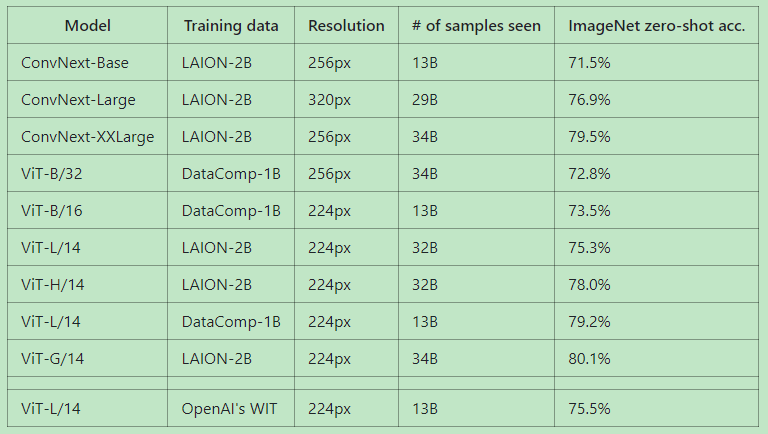

在多模态的视觉编码主干中,若采用分类的backbone效果很差,经过语义对齐的backbone,比如clip的vit,效果则好很多。

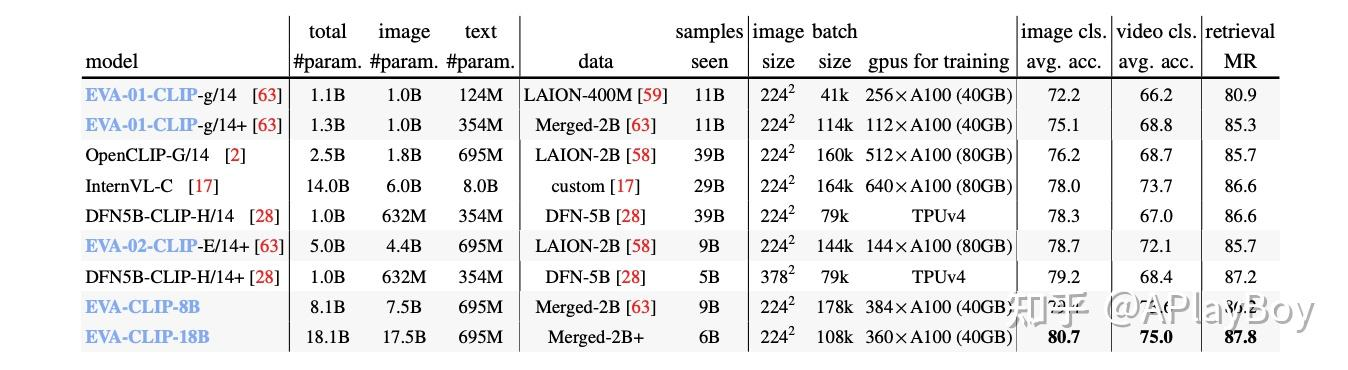

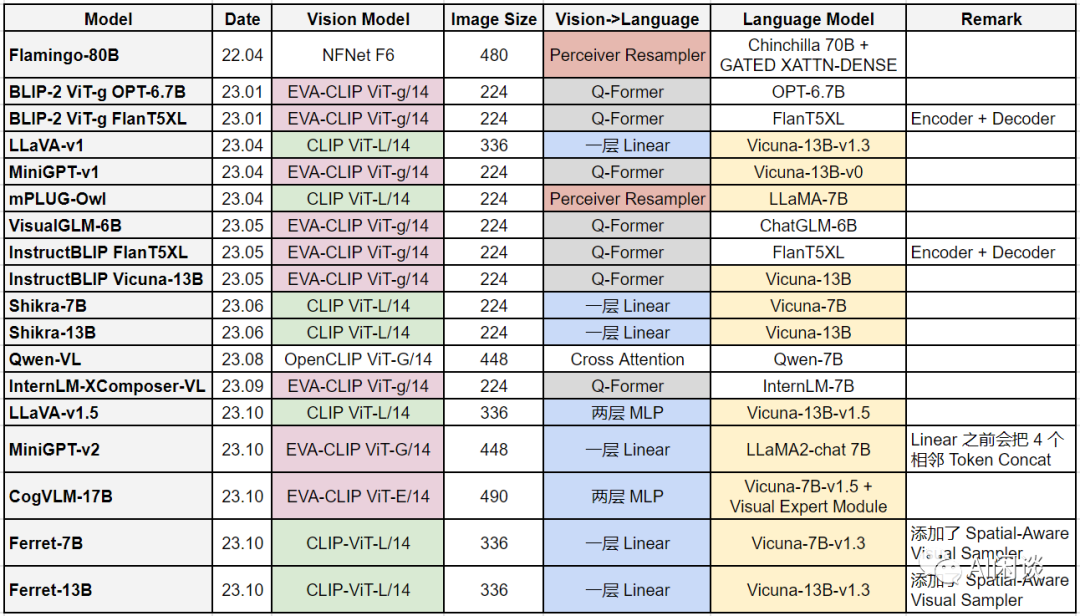

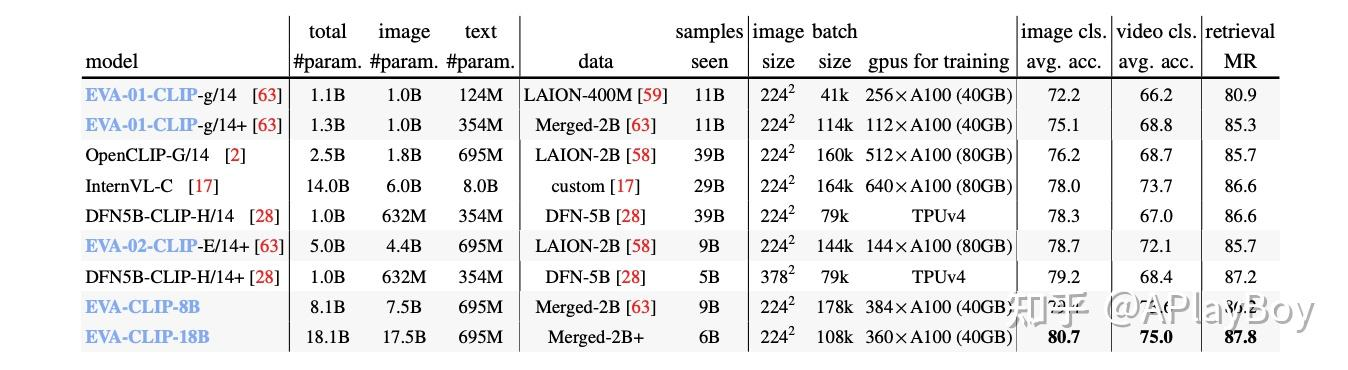

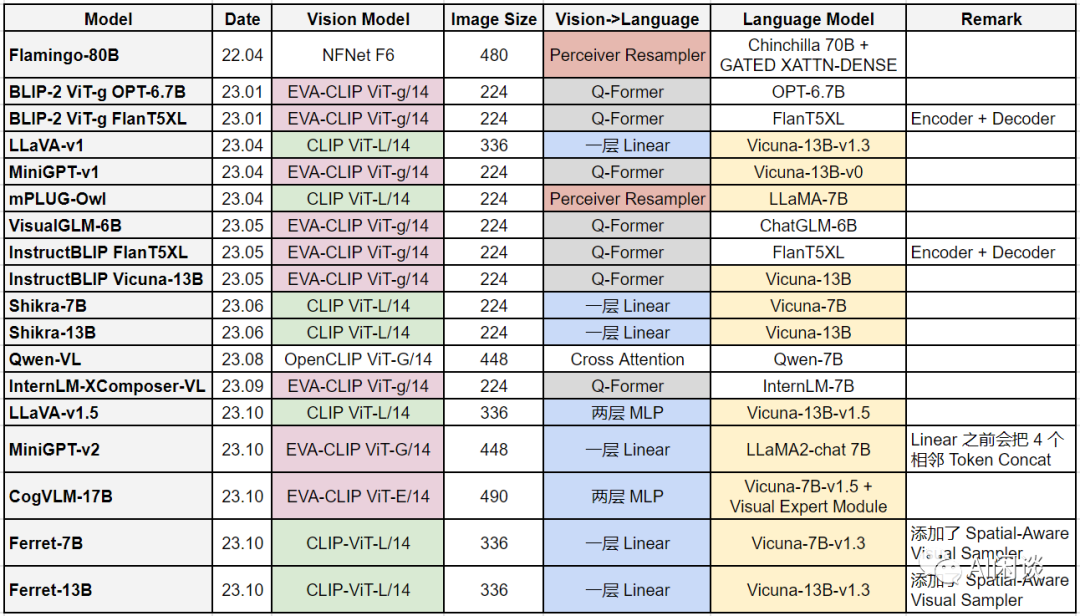

1.Cogvlm中的EVA2-CLIP-E,VIT中最后一层被移除,4.4B,支持分辨率为334/490.

2.QWEN-VL中openclip的ViT-bigG,1.9B,支持分辨率448x448。

在多模态的视觉编码主干中,若采用分类的backbone效果很差,经过语义对齐的backbone,比如clip的vit,效果则好很多。

1.Cogvlm中的EVA2-CLIP-E,VIT中最后一层被移除,4.4B,支持分辨率为334/490.

2.QWEN-VL中openclip的ViT-bigG,1.9B,支持分辨率448x448。

1245

1245

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?