本文是今年cvpr的一篇spotlight,也应该是目前为止faster rcnn所有变种中最好的一个。文章传送门:点击打开链接

和之前的RCNN以及之后的一些变种一样,本文也是region-based object detection framework。相比与faster rcnn,hypernet更擅长处理小物体,并且产生更高质量的proposal。

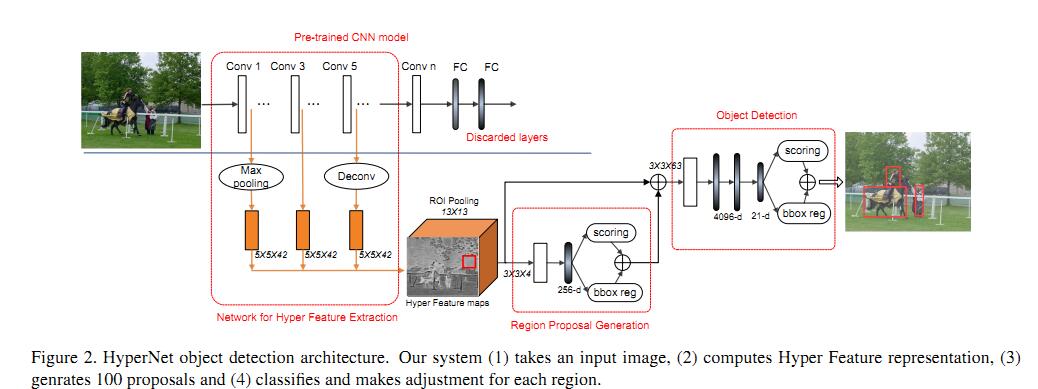

整体的框架见下图:

按照红框的依次介绍:

Network for Hyper Feature Extraction:

RCNN之后的framework在做小物体检测时有一个通病,就是物体的的信息会损失的非常厉害,比如原来32*32的物体,到最后一层feature map 只剩下了2*2,所以本文为了处理这个问题提出了两种方法,第一种,放大feature map,第二种,skip layer。按照标配输入1000*600的图最后的map size 会是62*37, 这样的话信息损失非常严重,所以作者想办法把最后的map放大到250*150,把第一层的map做一个max pooling, 把最后一层的map做一个deconv,然后把1,3,5层的map LRN之后连在一起。LRN是必要的,因为不同层的feature resolution 不同,如果不做正则norm大的feature会压制住norm小的feature。

在产生hyper feature map

HyperNet是CVPR会议上的一篇亮点论文,改进了区域提议生成和联合目标检测,尤其擅长小物体检测。通过放大特征映射、跳跃层连接和超特征映射生成,减少了信息损失,提高了提案质量。尽管在生成提案阶段存在速度瓶颈,但提出的框架在Top 100提案中达到了97%的召回率,表现优秀。

HyperNet是CVPR会议上的一篇亮点论文,改进了区域提议生成和联合目标检测,尤其擅长小物体检测。通过放大特征映射、跳跃层连接和超特征映射生成,减少了信息损失,提高了提案质量。尽管在生成提案阶段存在速度瓶颈,但提出的框架在Top 100提案中达到了97%的召回率,表现优秀。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6536

6536

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?