近日,美国斯坦福大学发布第八版《人工智能指数报告》(AI Index Report 2025),追踪了 2024 年全球人工智能(AI)行业的发展趋势。

《2025 AI Index》报告总共 456 页,涵盖了研发、技术性能、负责任的人工智能、经济影响、科学和医学、政策、教育和公众舆论等主题的图表和数据。

>>>往期:2024 | 2023 | 2022 | ...

-

报告地址:https://hai-production.s3.amazonaws.com/files/hai_ai_index_report_2025.pdf

今年的这份报告是迄今为止最为全面的一版,新增了对 AI 硬件演进、推理成本估算、AI 出版和专利趋势的深入分析,并扩大了关于企业采用负责任 AI 实践以及 AI 在科学和医学领域角色的新鲜数据。

除了谷歌、OpenAI 之外,中国公司 DeepSeek 也成为报告关注的焦点,在 PDF 全文中被提到了 45 次。

报告共八个章节,其核心内容可以总结为以下五点:

一、技术突破与性能提升

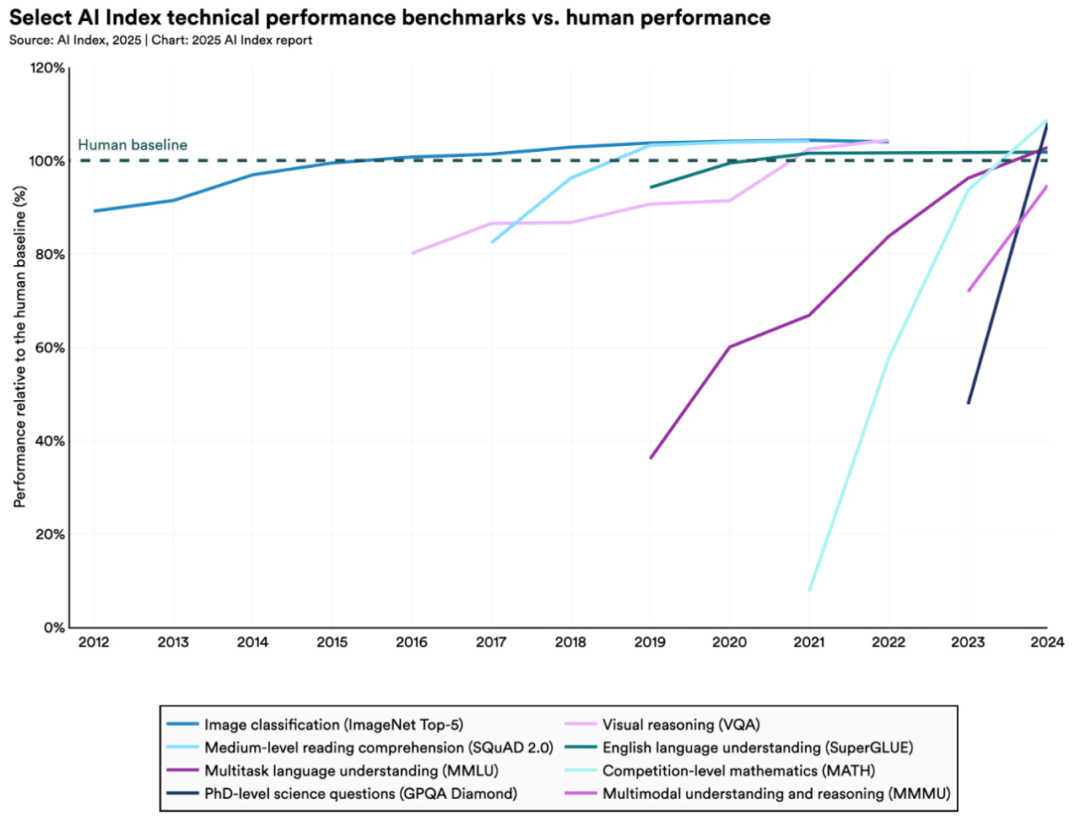

01 基准性能持续提升

2023 年,研究人员引入新的基准 MMMU、GPQA 和 SWE-bench 来测试高级 AI 系统的极限。然而仅一年后,AI 模型在这些基准上的表现就出现了惊人的飞跃,得分分别提升了 18.8、48.9 和 67.3 个百分点。

尤其在 SWE-bench(软件工程基准)上,AI 解决编码问题的能力从 2023 年的仅 4.4% 飙升至 2024 年的 71.7%。同时,高质量视频生成等领域也取得了重大进展。

图:AI在苛刻基准上的表现持续提升

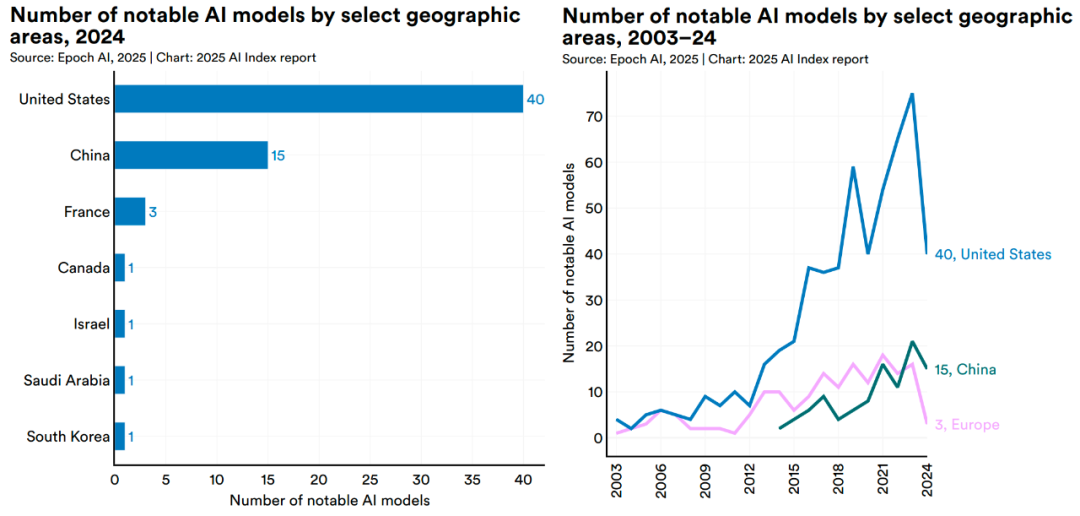

02 中美差距显著缩小

报告显示,美国依旧是顶尖 AI 模型的“生产大户”。

2024年,美国机构开发了 40 个值得关注的 AI 模型,中国为 15 个,欧洲为 3 个。

在过去十年中,来自美国的值得关注的机器学习模型数量超过任何其他国家。

图:2003-2024年按选定地理区域分列的著名人工智能模型数量

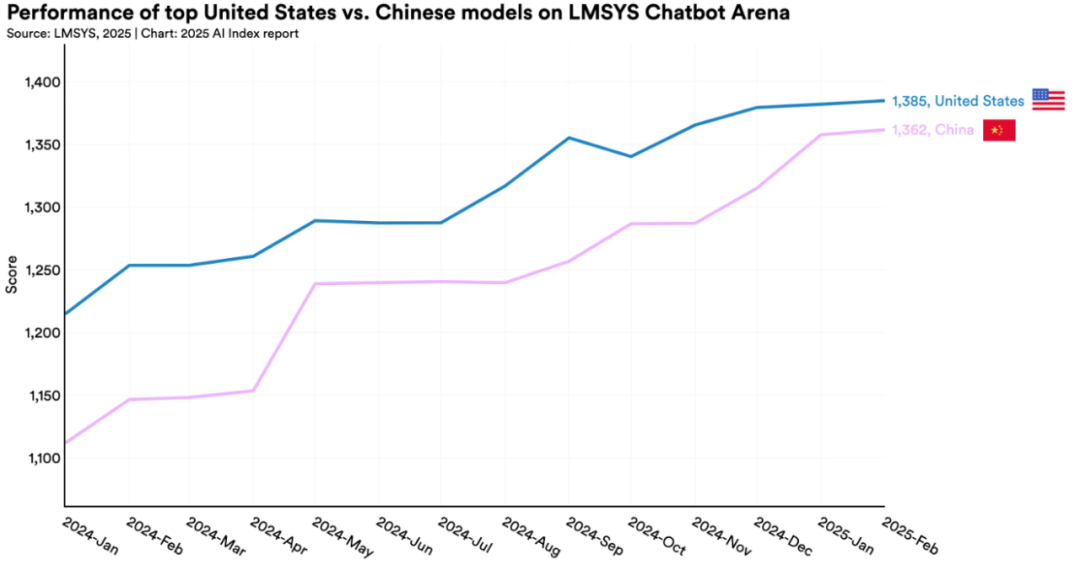

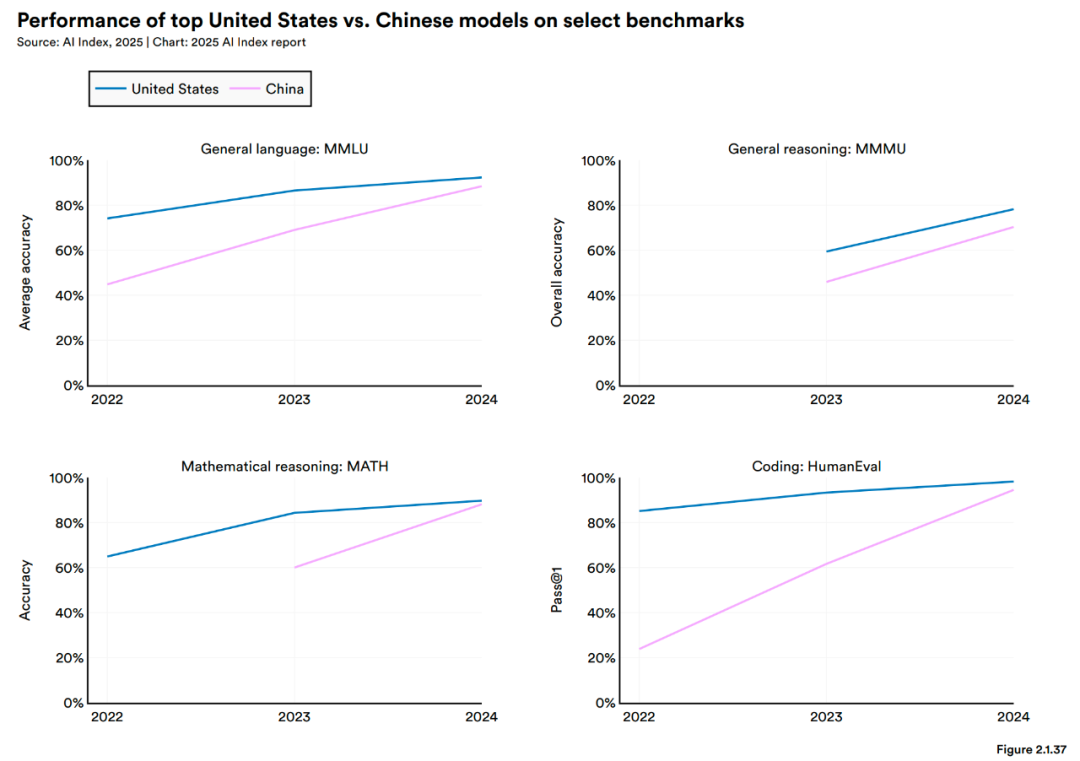

虽然美国在数量上保持领先,但中国模型已迅速缩小质量差距:在 MMLU 和 HumanEval 等主要基准上的性能差异从 2023 年的两位数迅速缩小至 2024 年的近乎持平,部分基准差距仅为个位数甚至零点几。

这表明中国 AI 模型的“质量”正在快速追赶。

图:在创造顶级AI模型方面,中国正在缩小与美国的差距

图:美国与中国模型在特定基准上的表现

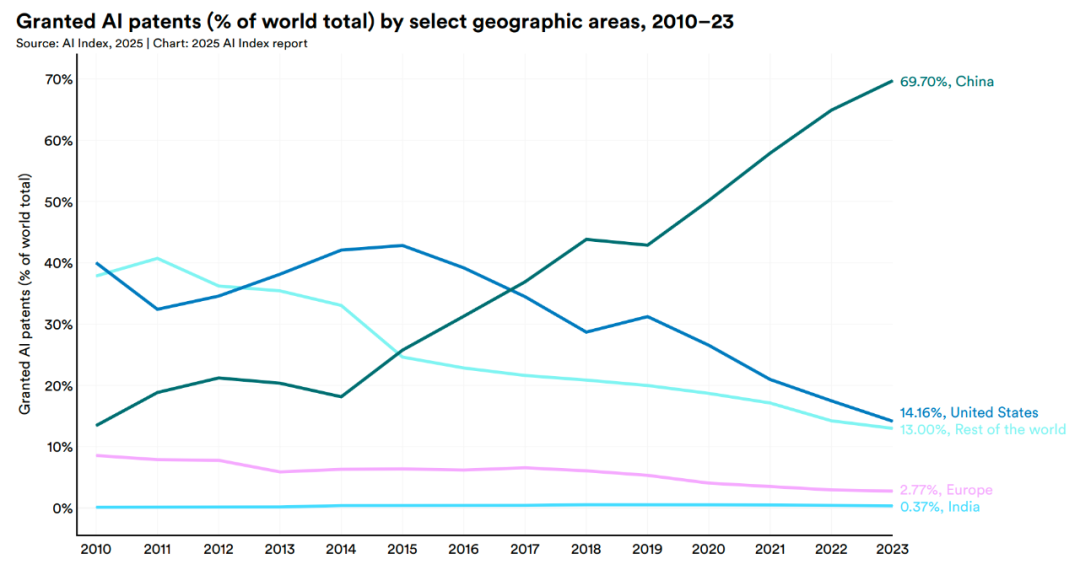

同时,中国在 AI 出版物和专利方面继续领先。

图:按选定地理区域划分的已获人工智能专利分布(占全球总数的百分比)

03 技术前沿趋于收敛

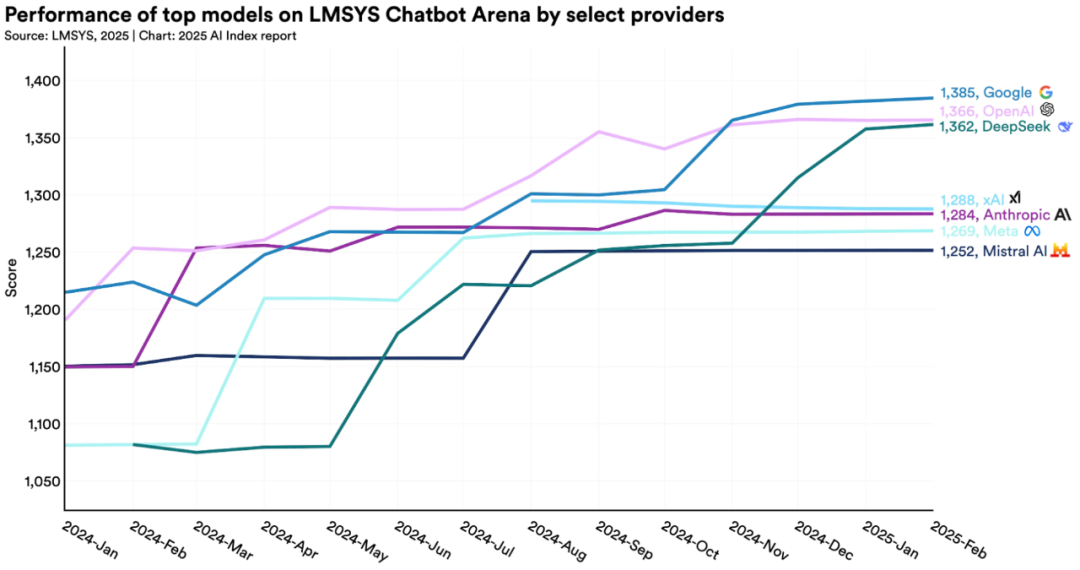

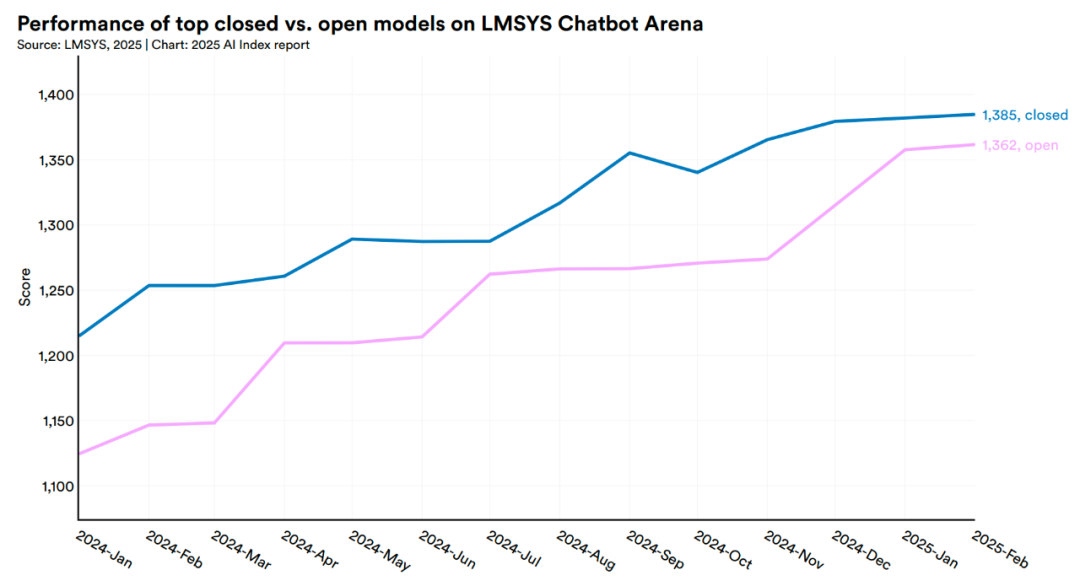

根据去年的 AI 指数,LMSYS Chatbot Arena 排行榜上排名第一和第十的模型之间的 Elo 分数差异为 11.9%。到 2025 年初,这一差距已缩小至仅 5.4%。

更值得注意的是,排名前两位的模型差距也从 2023 年的 4.9% 骤降至 2024 年的仅 0.7%。

这意味着顶尖模型的性能水平日益接近,高质量模型不再是少数巨头的专利,开发者生态系统正变得越来越有竞争力。

图:在 LMSYS ChatBot 竞技场的不同顶级模型表现

04 小模型异军突起,开源模型奋起直追

另一个显著趋势是“小模型”展现出的强大能力。

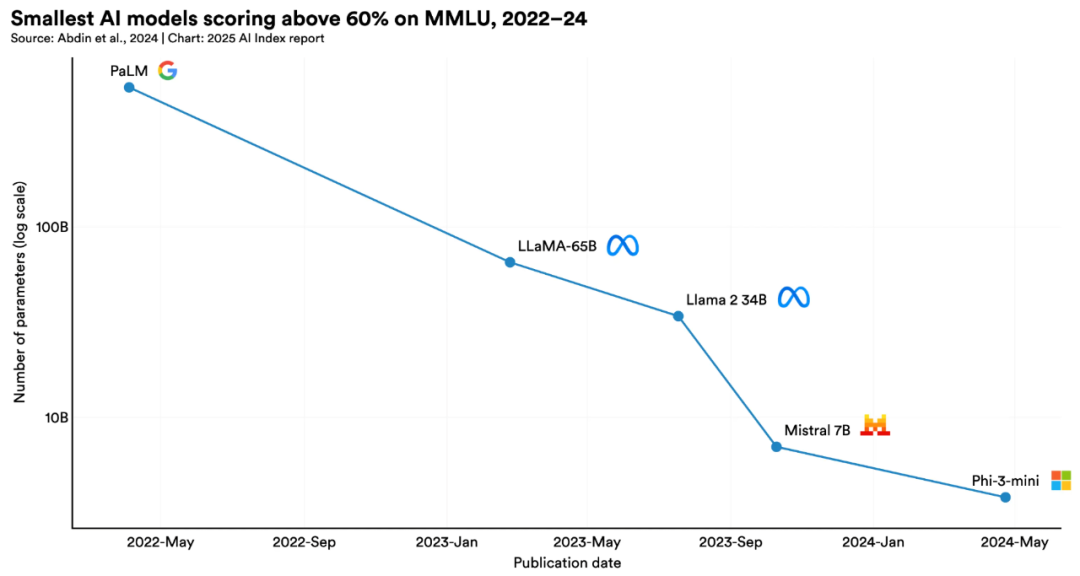

2022 年,在 MMLU 上得分超过 60% 的最小模型是拥有 5400 亿参数的 PaLM。而到 2024 年,微软仅有 38 亿参数的 Phi-3-mini 就达到了同样门槛,参数量缩减了 142 倍。这得益于算法效率的提升。

图:更小的模型带来更强的性能

同时,开源模型与闭源模型之间的性能差距也几乎消失。在 Chatbot Arena 上,2024 年 1 月初,领先的闭源模型比顶尖开源模型高出 8.04%,到 2025 年 2 月,这一差距已缩小至 1.70%。

这标志着先进 AI 技术的获取门槛正在快速降低。

图:顶级闭源模型与开放模型在 LMSYS Chatbot Arena 的表现

05 AI Agent展现出初步潜力

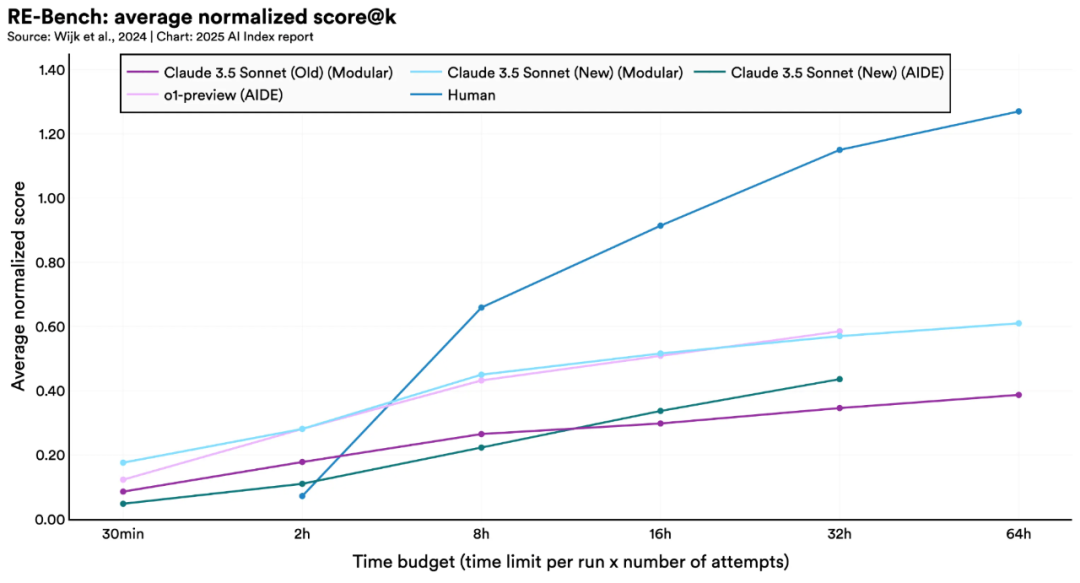

2024 年推出的 RE-Bench 为评估 AI 智能体的复杂任务提供了严格的基准测试。在短时间范围内(两小时预算),顶级 AI 系统的得分是人类专家的四倍,但随着时间预算的增加,人类表现优于 AI——在 32 小时内领先 AI 两倍。

尽管如此,AI 智能体在特定任务(例如编写 Triton 内核)上已经能与人类专业知识相匹配,同时以更快的速度和更低的成本提供结果。

图:RE-Bench 平均标准化得分

二、应用拓展与商业化加速

01 投资再创新高,美国优势扩大

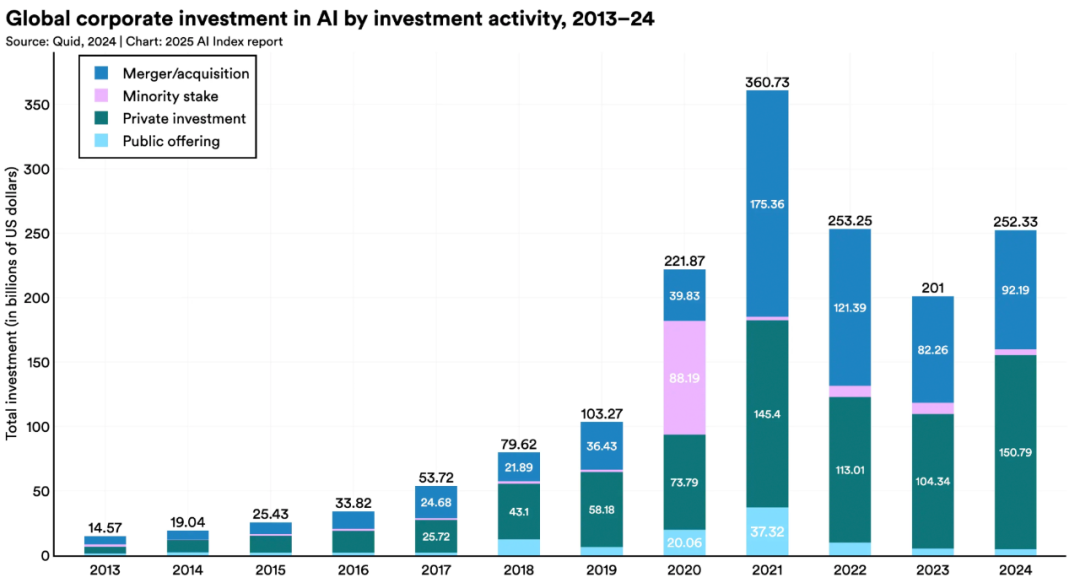

全球私有 AI 投资在经历短暂回调后,于 2024 年强劲反弹至创纪录的 2523 亿美元(企业总投资,包括并购等)。其中,私有投资额达到 1,508 亿美元,比上一年增长 44.5%,并购增长 12.1%。

图:2013-2024 年全球企业在人工智能领域的投资活动情况

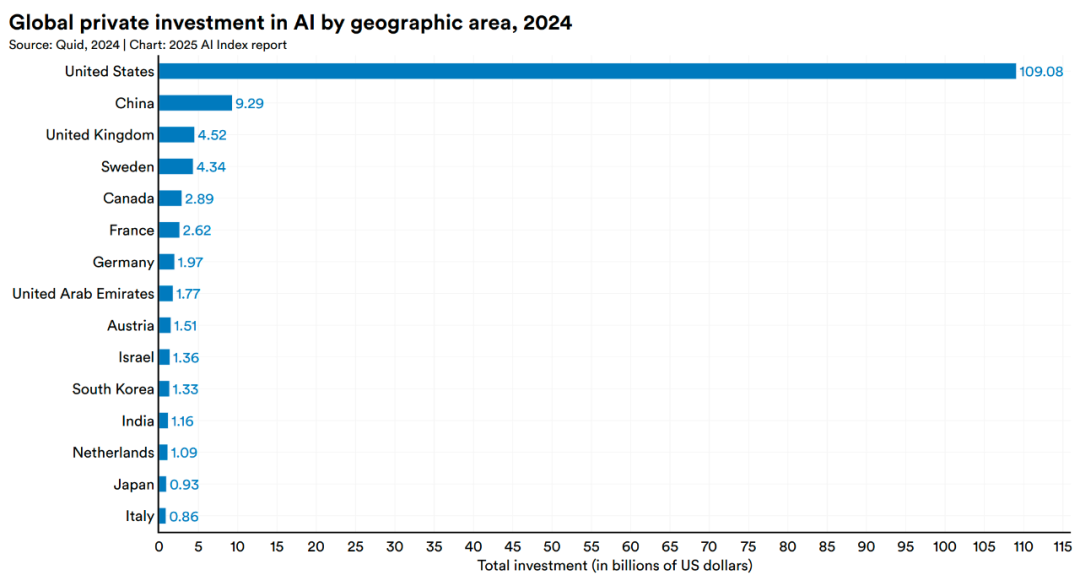

美国依然是全球 AI 投资的绝对中心,2024 年吸引了 1,091 亿美元的私有投资,是中国的 93 亿美元的近 12 倍,是英国的 45 亿美元的 24 倍。

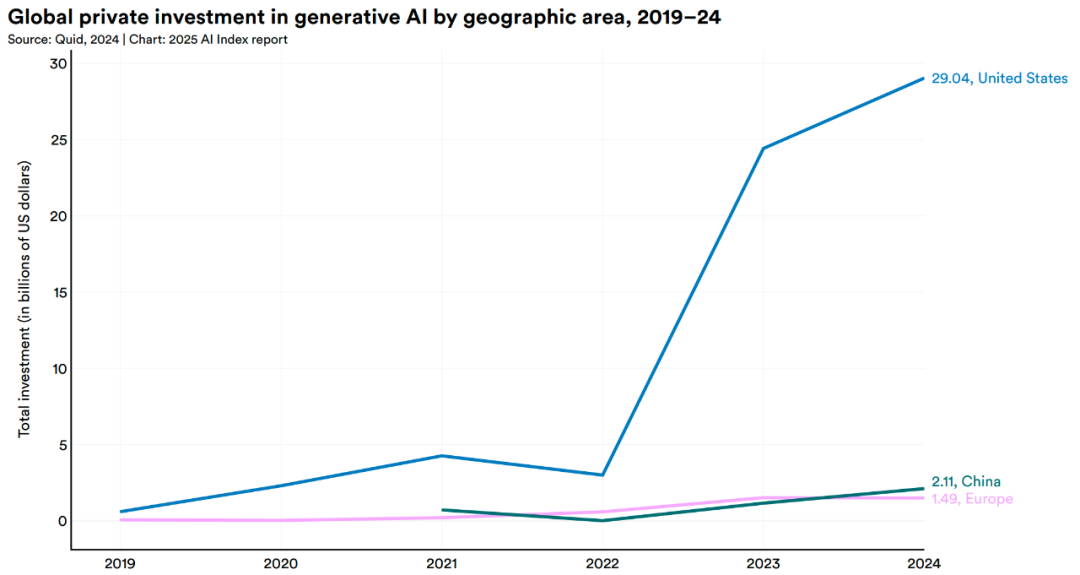

尤其在生成式 AI 领域,美国投资额(2024 年为 290.4 亿美元)比中国和欧盟+英国的总和还要多出 254 亿美元,差距进一步拉大。生成式 AI 本身也成为吸金热点,全球共获得 339 亿美元投资,同比增长 18.7%。

图:2024 年按地理区域划分的全球人工智能私有投资

图:2019-2024 年按地理区域划分的全球生成式人工智能私有投资

02 成本效益显著提升

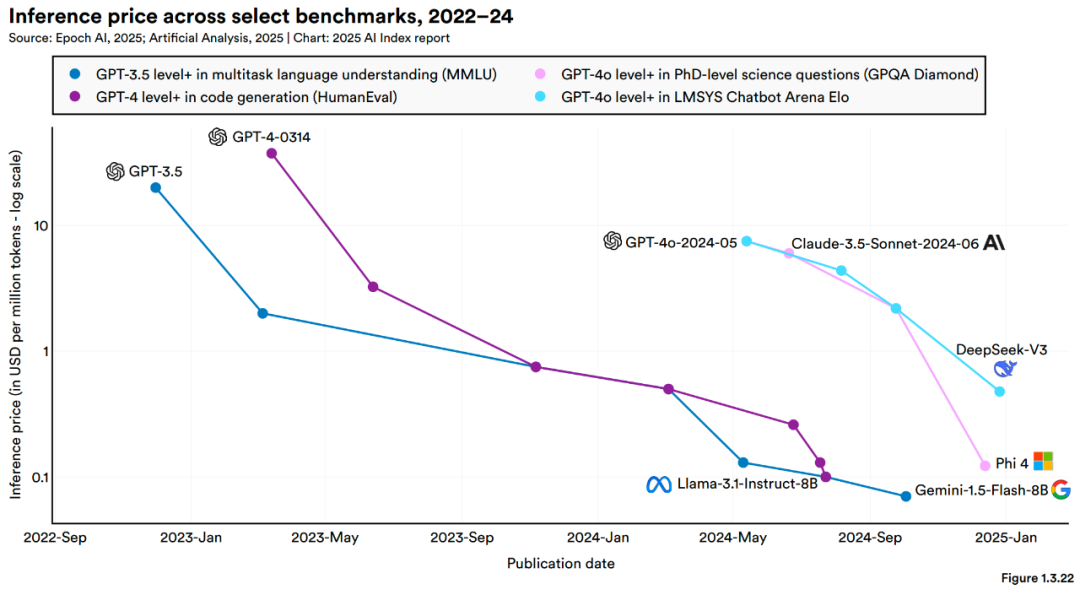

报告首次对推理成本进行了追踪。

结果显示,达到 GPT-3.5(在 MMLU 上约 64.8% 准确率)性能水平的 AI 模型,其推理成本从 2022 年 11 月的每百万 token 20 美元,骤降至 2024 年 10 月的仅 0.07 美元(以 Gemini-1.5-Flash-8B 为例),降幅超过 280 倍。

图:2022–24 年间在选定基准上的推理成本

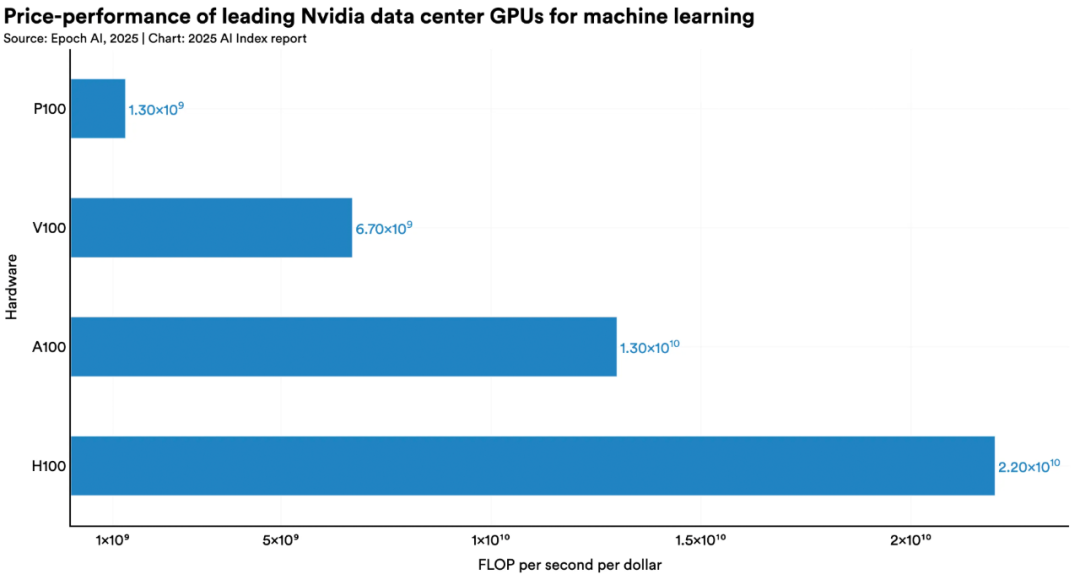

人工智能硬件变得更快、更便宜、更节能。最新研究表明,以 16 位浮点运算衡量的机器学习硬件性能每年增长 43%,每 1.9 年翻一番。性价比有所提升,成本每年下降 30%,能效每年提高 40%。

图:面向机器学习的领先 Nvidia 数据中心 GPU 的性价比

03 AI正越来越多地融入到日常生活中

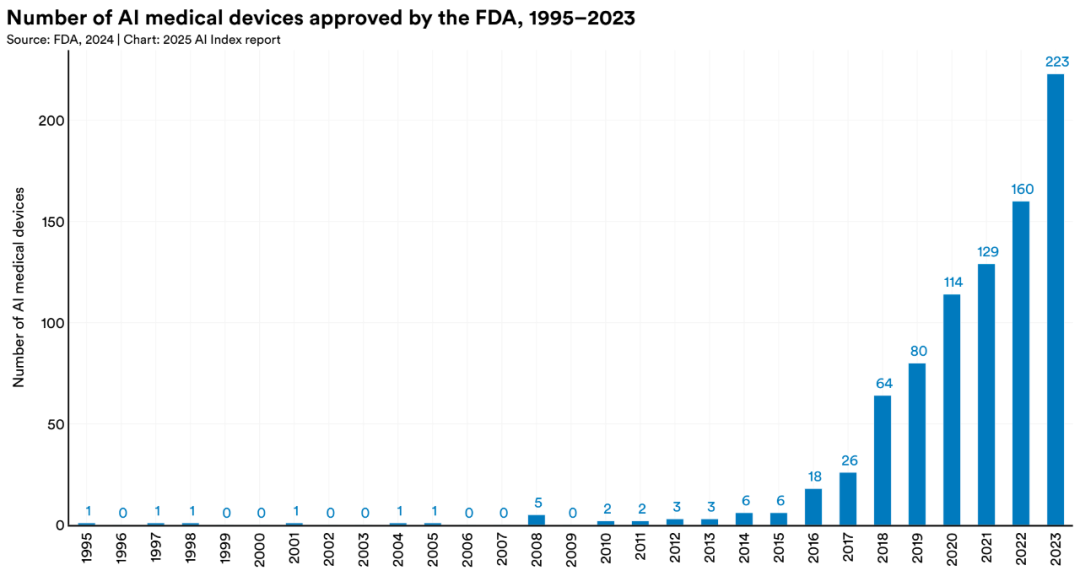

从医疗保健到交通运输,AI 正迅速从实验室走向日常生活。2023 年,FDA 批准了 223 种AI医疗设备,而 2015 年仅为 6 种。

自动驾驶汽车也已投入实际运营,如美国的 Waymo 每周提供超过15万次自动驾驶出行,中国的“萝卜快跑”自动驾驶出租车车队也在多个城市提供服务。

图:1995-2023 年美国FDA批准的人工智能医疗设备数量

04 企业应用空前普及

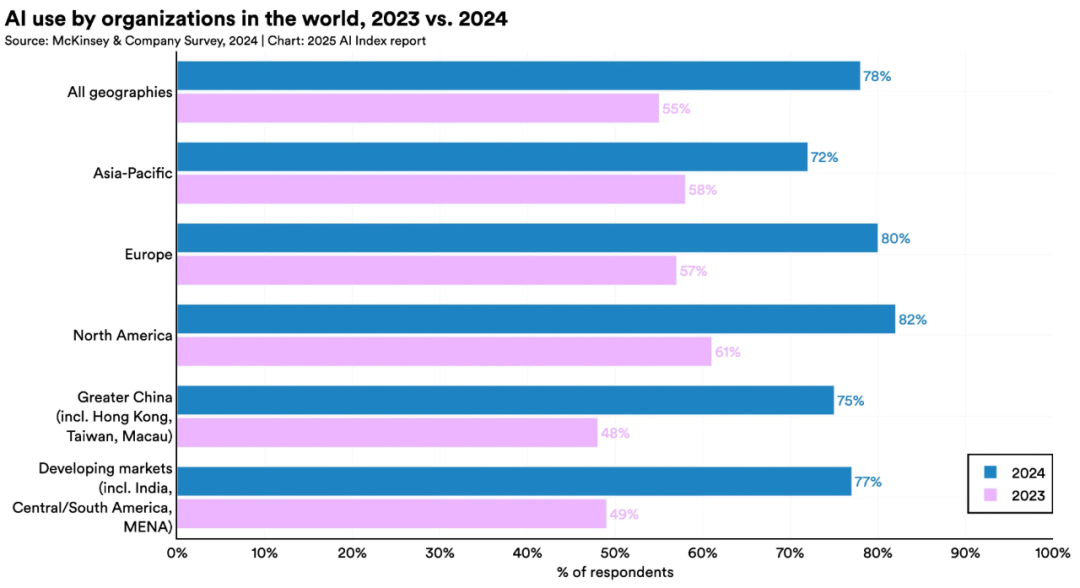

虽然北美在组织机构使用人工智能方面保持领先地位,但大中华区表现出最显著的同比增长率之一,组织机构使用人工智能的比例增加了 27 个百分点。紧随其后的是欧洲,增幅为 23 个百分点,这表明全球人工智能格局正在迅速演变,人工智能实施方面的国际竞争日益激烈。

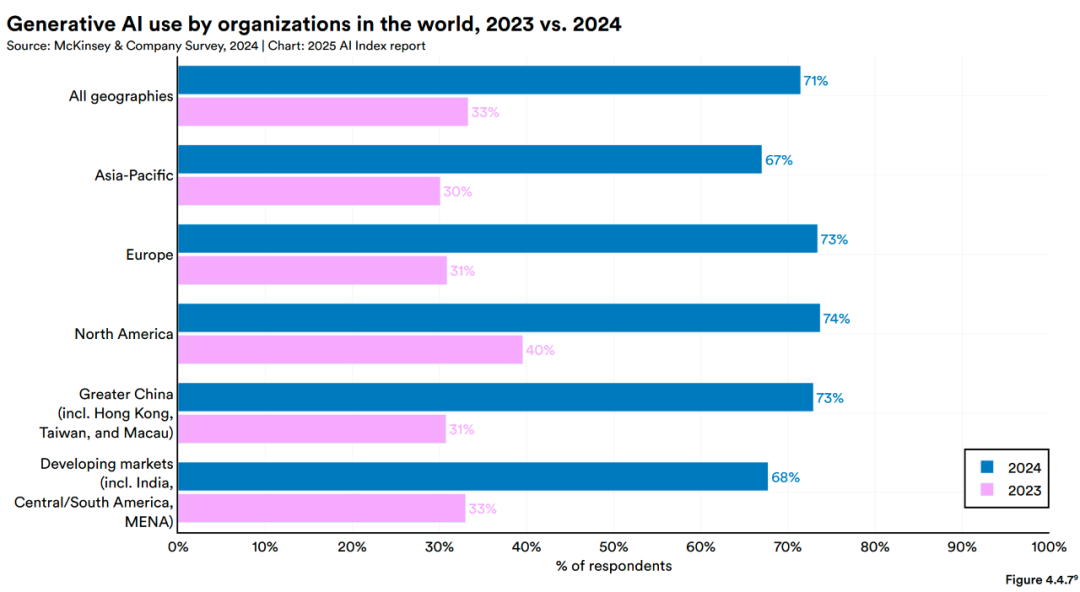

企业对 AI 的应用不再停留在实验阶段。麦肯锡的调查显示,2024 年报告在其组织中至少一个业务功能中使用 AI 的受访者比例从 2023 年的 55% 跃升至 78%。同样,报告使用生成式 AI 的比例也从 33% 翻倍增长至 71%。AI 正从企业的边缘工具转变为核心驱动力。

图:2023 年与 2024 年全球组织的人工智能使用情况

图:2023 年与 2024 年全球组织的生成式AI使用情况

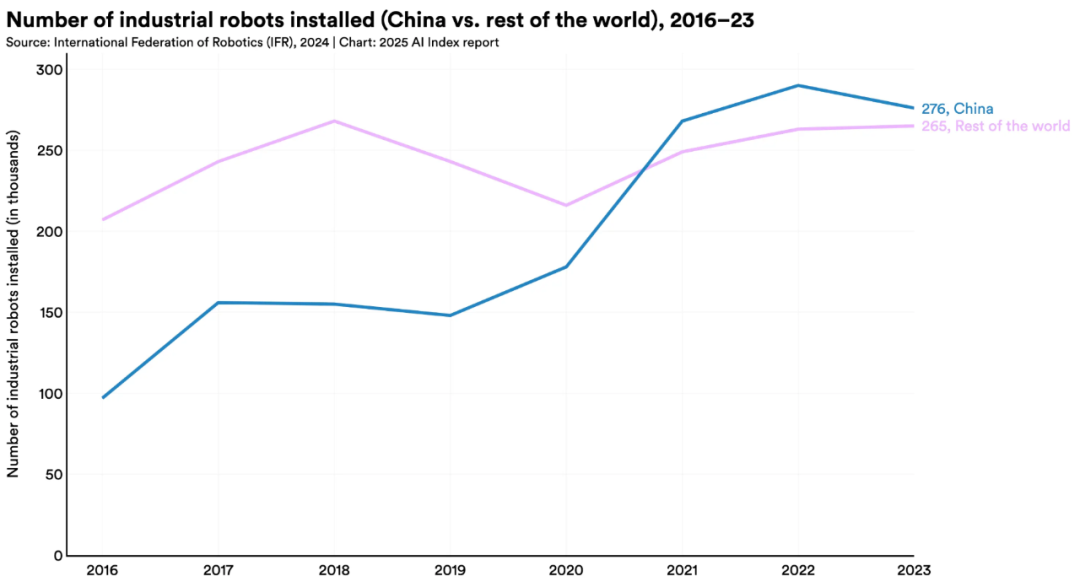

05 机器人领域中国持续领先

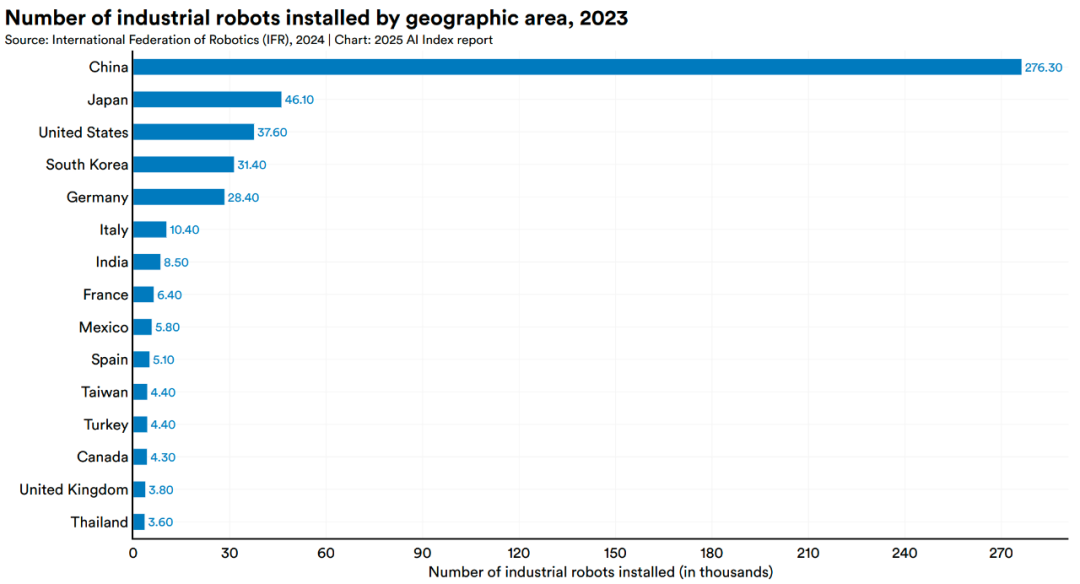

在工业机器人领域,中国继续保持主导地位,2023 年安装量达 27.63 万台,是日本的 6 倍,美国的 7.3 倍,占全球份额的 51.1%。尽管相比 2022 年增速略有放缓,但其领先优势依然巨大。

图: 2023 年各地区安装的工业机器人数量

图:中国在工业机器人领域的主导地位仍保持

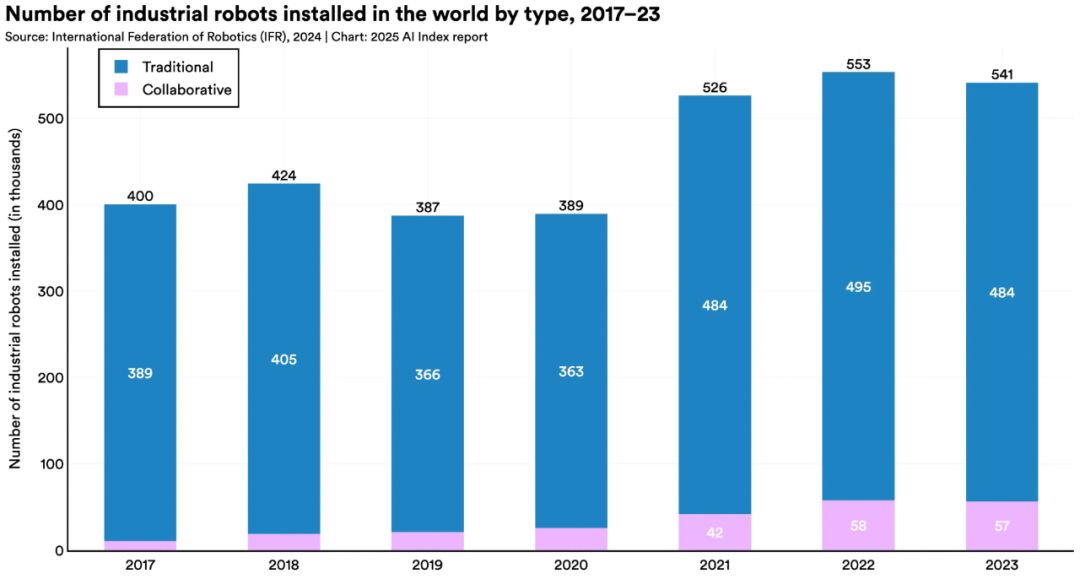

同时,协作机器人和面向人类的服务机器人安装量持续增长,显示出机器人应用场景的扩展。

2017 年,协作机器人仅占所有新工业机器人安装量的 2.8%,到 2023 年,这一数字将攀升至 10.5%。同样,到 2023 年,除医疗机器人外,所有应用类别的服务机器人安装量均将增加。这一趋势不仅表明机器人安装量总体增加,而且还表明人们越来越重视部署机器人来担任面向人类的角色。

图:2017-2023年全世界安装的各类工业机器人数量

三、教育与公众认知

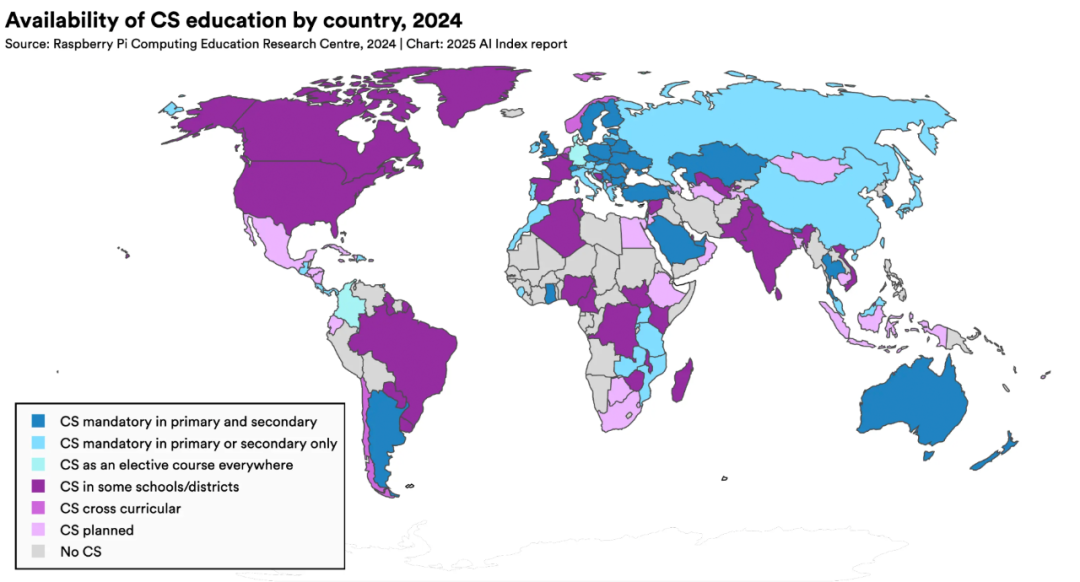

01 CS 与 AI 教育扩大,但普及不够

AI 和计算机科学教育正在扩大,但普及程度仍不够。

如今,已有2/3的国家提供或计划提供 K-12 计算机科学(CS,Computer Science)教育,是 2019 年的两倍,其中非洲和拉丁美洲取得的进展最大。

图:2024 年按国家分布的 CS 教育普及情况

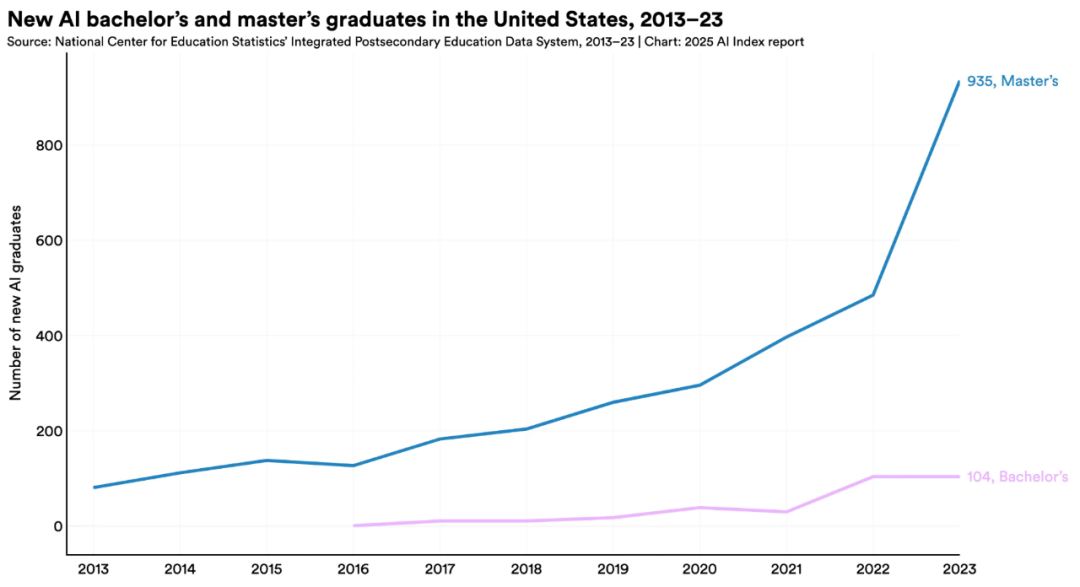

在美国,拥有计算机学士学位的毕业生人数在过去 10 年中增加了 22%。然而,在许多非洲国家,由于电力等基础设施的不足,获得计算机学位的机会仍然有限。

2022 年至 2023 年间,美国获得人工智能硕士学位的毕业生数量几乎翻了一番。

图:2013-2023年美国新的人工智能学士和硕士毕业生数量

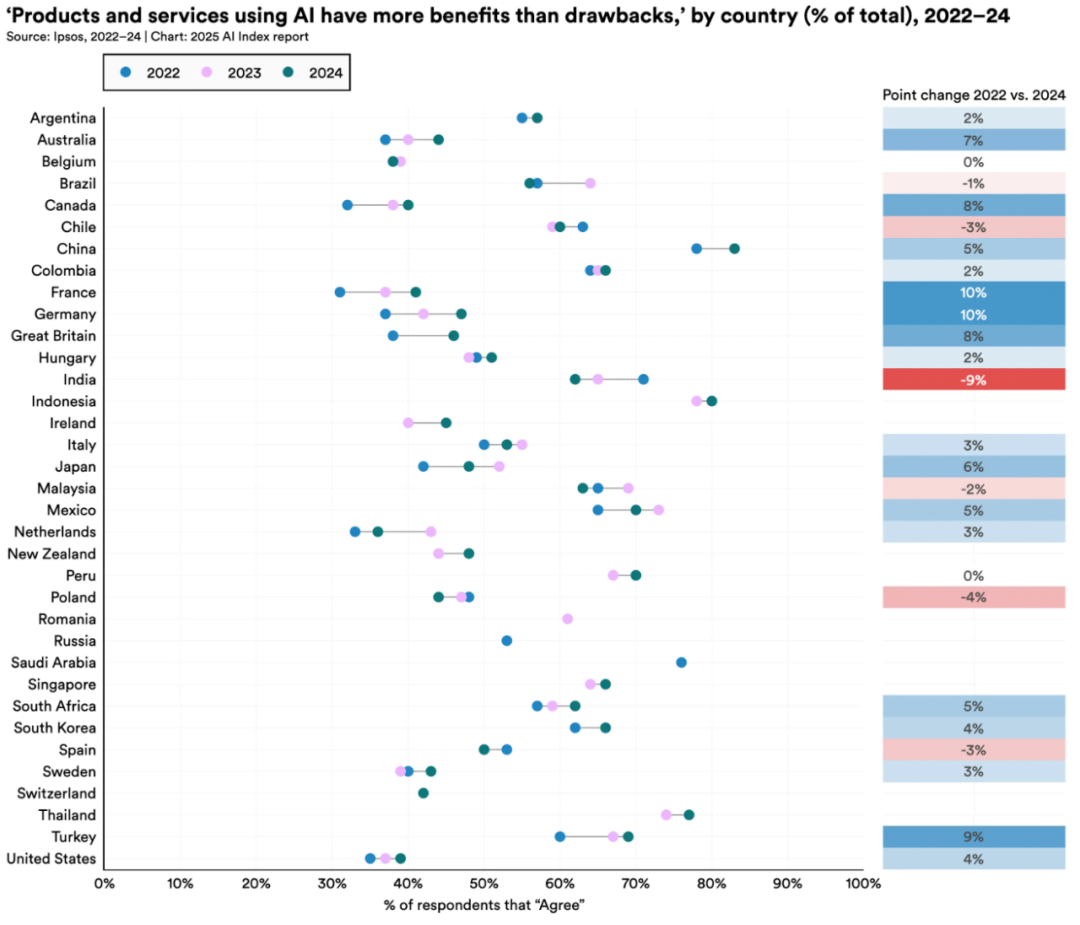

02 全球 AI 乐观情绪上升,地区差异依然显著

全球范围内,人们对人工智能产品和服务的乐观情绪有所提升,此前持怀疑态度最强的国家的乐观情绪增幅最大。2022年,英国(38%)、德国(37%)、美国(35%)、加拿大(32%)和法国(31%)是最不可能认为人工智能利大于弊的国家。自那以后,这些国家的乐观情绪分别增长了 8%、10%、4%、8% 和 10%。

图:2022-2024年,按国家分布(占总数的百分比)的“使用 AI 的产品和服务利大于弊”的支持情况

03 对 AI 影响的认知

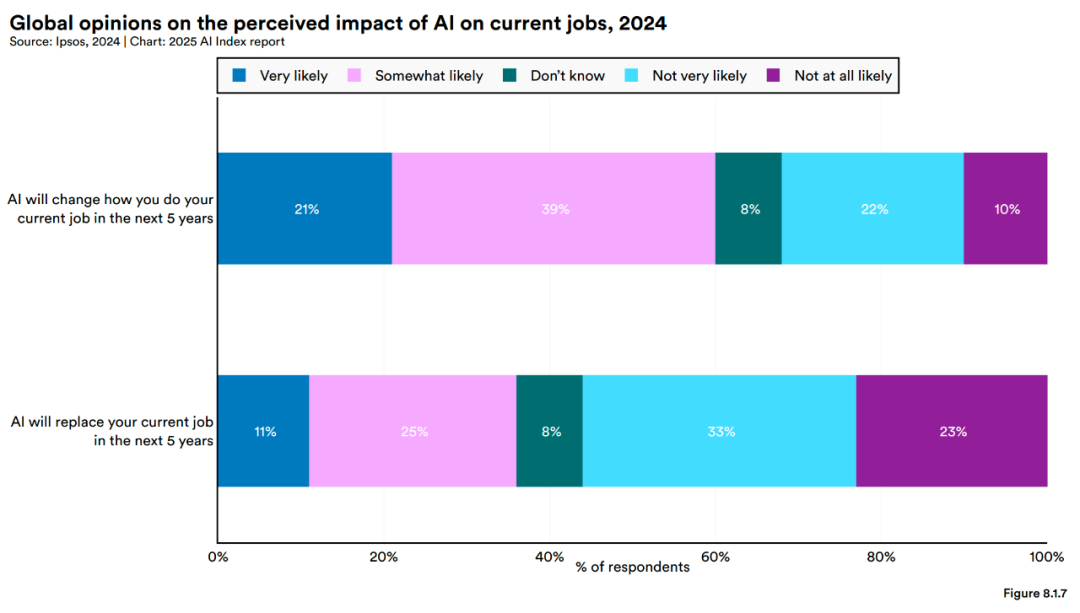

关于 AI 是否以及何时会取代人类的工作,社会上已有广泛讨论。

最近一项关于人工智能态度的全球调查显示,大多数人并不感到受到人工智能的威胁。其中,来自 32 个国家的 60% 受访者认为 AI 将在未来五年改变他们的工作方式,但仅有 36% 的人认为 AI 会取代他们的工作。

人们普遍认为 AI 能节省时间(55%)、提供更好的娱乐(51%),但在经济影响(36% 认为能改善国家经济)和健康改善(38%)方面则信心不足。

图:2024 年全球对「AI对当前工作影响」的看法

四、行业格局与创新生态

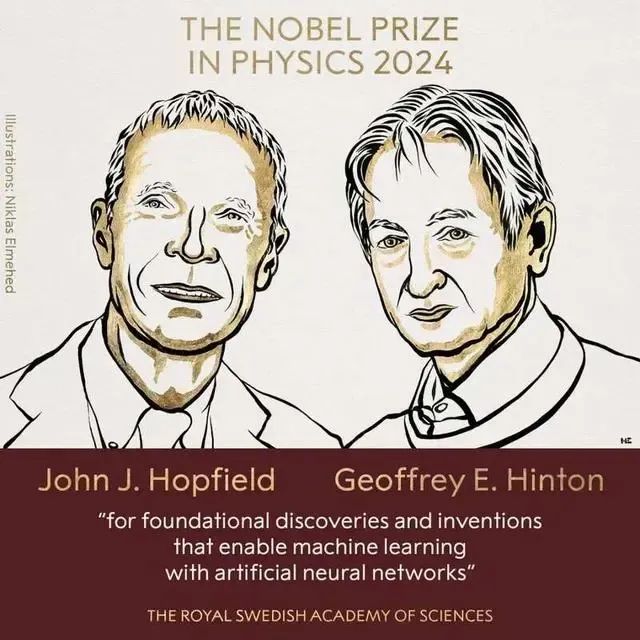

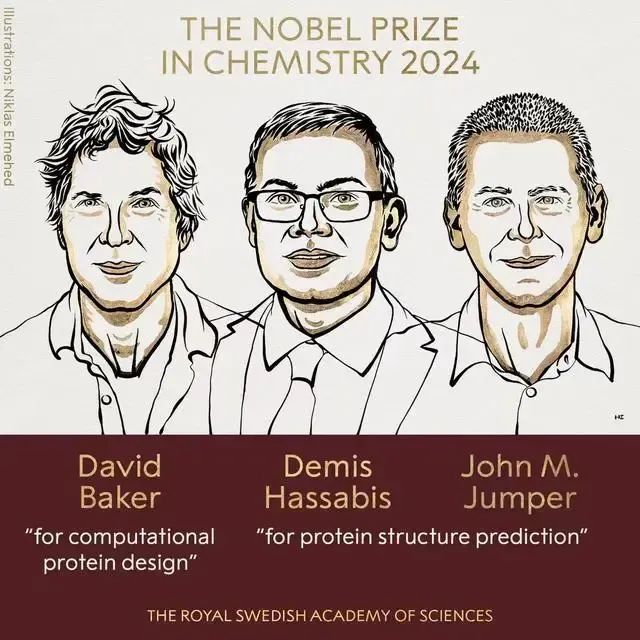

01 科学奖项的认可

2024 年,AI 在科学领域的贡献获得了最高荣誉。

两项诺贝尔奖分别表彰了深度学习的基础工作(物理学奖,John Hopfield 和 Geoffrey Hinton)及其在蛋白质折叠预测中的应用(化学奖,AlphaFold 团队的 Demis Hassabis 和 John Jumper)。

图灵奖则表彰了AI在强化学习方面的开创性贡献。

这标志着 AI 已成为科学研究不可或缺的一部分。

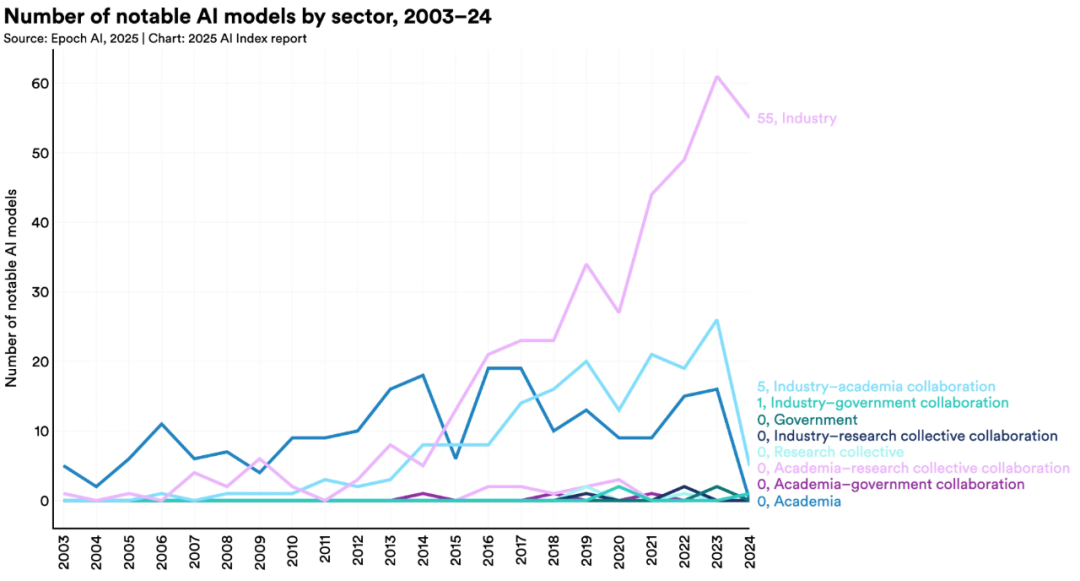

02 工业界依然一路领先

工业界继续对人工智能进行大量投资,并在著名的人工智能模型开发方面处于领先地位,而学术界在高引用率研究方面处于领先地位。

2024年,近 90% 的著名人工智能模型来自工业界,高于 2023 年的 60%,而学术界仍然是高引用率(前100名)研究的首要来源。

图:2003-2024 年按领域划分的著名人工智能模型数量

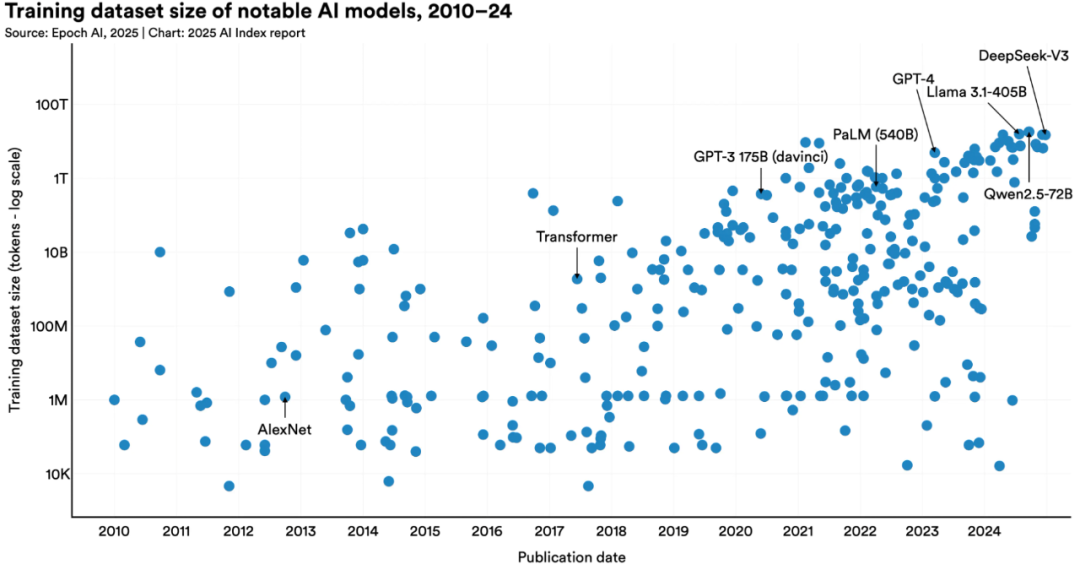

AI 模型变得越来越大,计算要求越来越高,能源消耗也越来越大。最新研究发现,著名人工智能模型的训练计算每 5 个月翻一番,数据集每 8 个月翻一番,耗电量每年翻一番。大规模的行业投资持续推动模型扩展和性能提升。

图:2010-2024 年著名人工智能模型的训练数据集规模

03 AI 与科学、医学:加速发现,改变范式

AI 正在成为推动科学发现和变革医疗实践的关键力量。

1. 基础模型应用于医学。2024 年,一波大型医学基础模型发布,从像 Med-Gemini 这样的通用多模态模型到用于超声心脏病学的 EchoCLIP 和用于放射学的 ChexAgent 等专门模型。

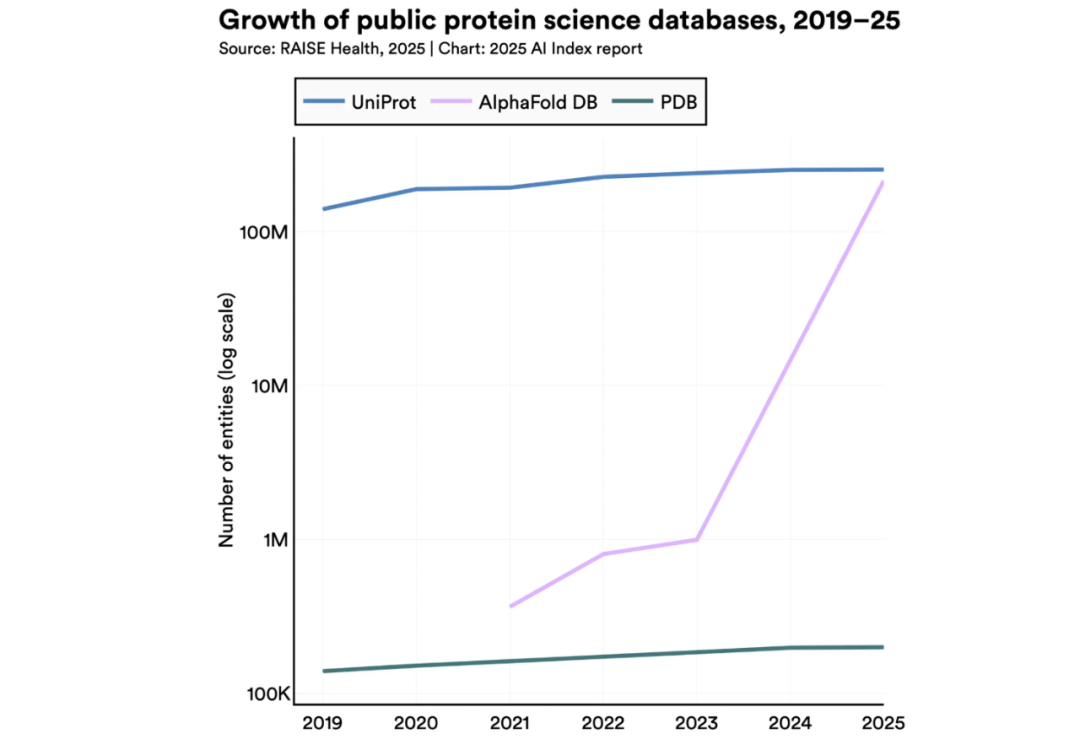

2. 公开的蛋白质数据库的规模不断扩大。自 2021 年以来,主要公共蛋白质科学数据库中的条目数量显著增长,包括 UniProt(31%)、PDB(23%)和 AlphaFold(585%)。这种扩展对于科学发现具有重要意义。

图:2019–2025 年公共蛋白质科学数据库的增长

3. 合成数据在医学领域显示出巨大的前景。2024 年发布的研究表明,人工智能生成的合成数据可以帮助模型更好地识别健康的社会决定因素,增强隐私保护的临床风险预测,并促进新药物化合物的发现。

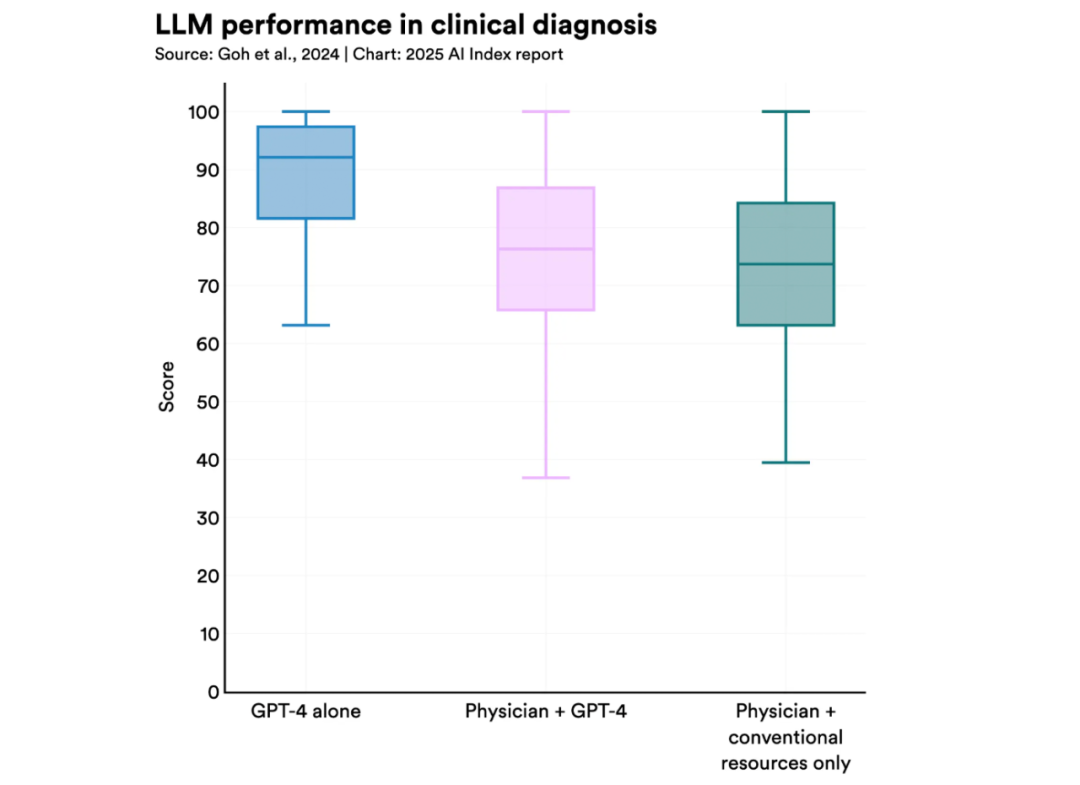

4. 人工智能在关键临床任务上的表现优于医生。一项新研究发现,在某些复杂的临床诊断任务中,GPT-4 表现甚至优于医生(无论医生是否使用 AI 辅助)。其他近期研究表明,AI 在癌症检测、高风险患者识别等方面也显示出超越人类专家的潜力。

04 人工智能的显著碳足迹

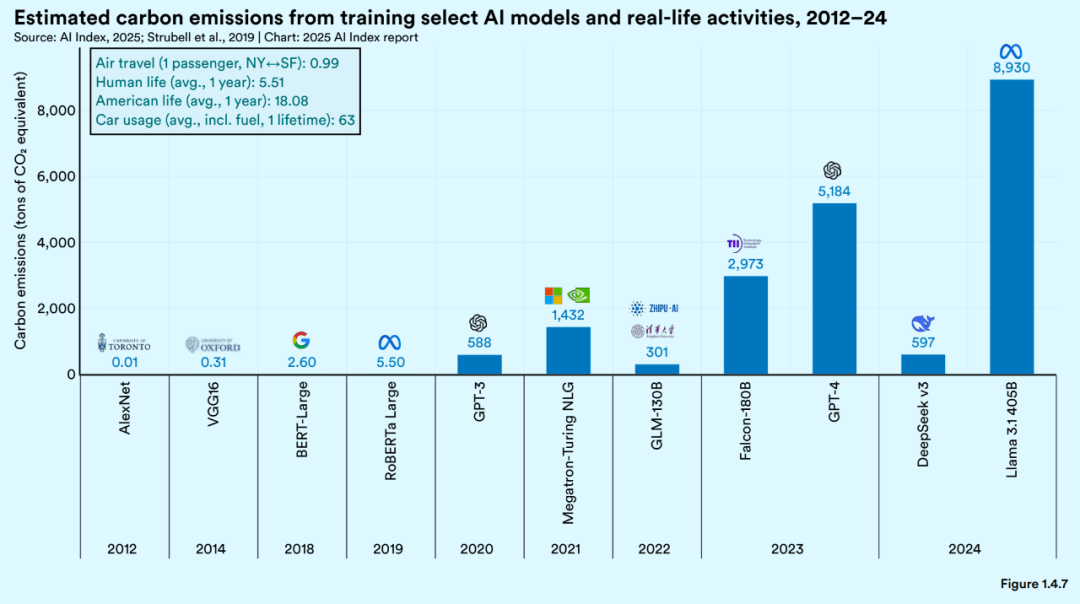

虽然能源效率提高是一个积极的趋势,但存在一个不容忽视的问题:尽管效率有所提升,整体能耗仍在增长,这意味着处于人工智能热潮中心的数据中心留下了巨大的碳足迹。

数据显示,最大的排放源是 Meta 的 Llama 3.1 模型,估计产生了 8930 吨二氧化碳排放,相当于约 496 个美国人一年的生活碳排放量。这一显著的环境影响解释了为何人工智能公司正积极采用核能作为可靠的零碳能源来源。

图:2012-2024 年训练特定人工智能模型和现实活动的碳排放量估算

AI 庞大的算力需求正在推动能源来源的重大变化,吸引了对核能的关注。报告特别提到了微软投资 16 亿美元重启三里岛核反应堆为 AI 数据中心供电,以及谷歌、亚马逊等巨头纷纷签署核能协议,这预示着 AI 发展可能对未来能源结构产生深远影响。

五、AI 伦理与治理

01 AI 相关事件急剧增加

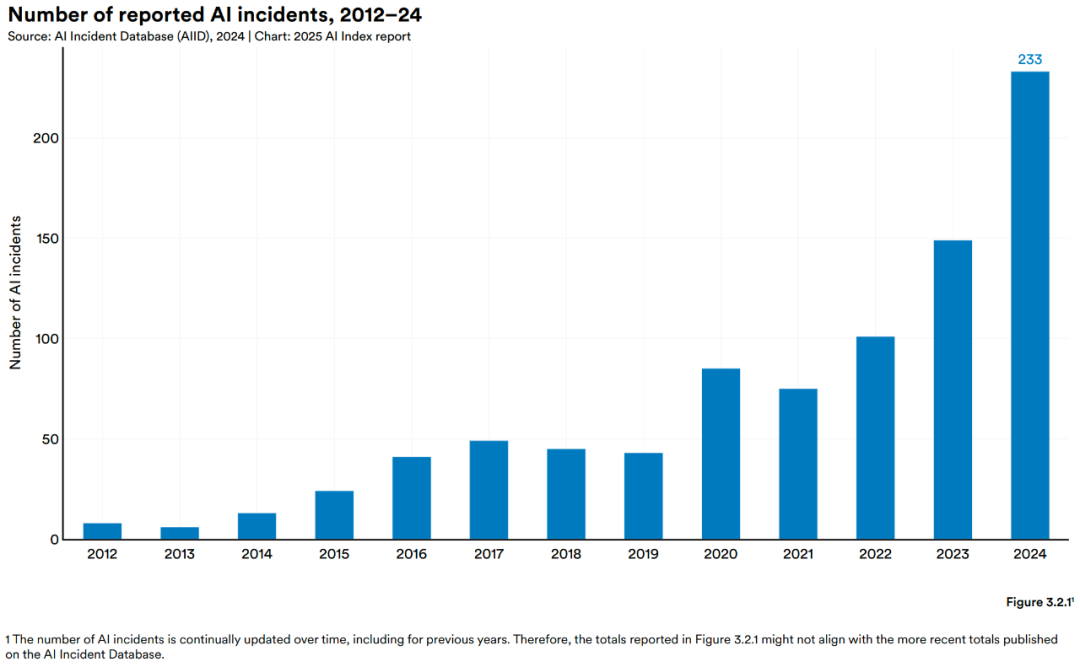

根据 AI 事件数据库的记录,2024 年报告的 AI 相关负面事件达到 233 起,创下历史新高,比 2023 年增长了 56.4%。这既反映了 AI 应用的扩大,也凸显了潜在风险的增加,例如深度伪造、偏见歧视、隐私泄露等。

图:2012 年至 2024 年报告的人工智能事件数量

02 RAI 评估标准仍待统一

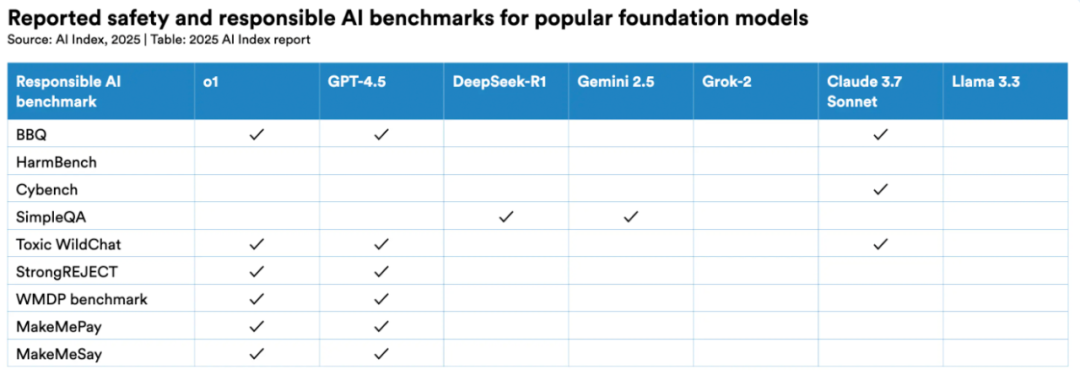

与人工智能相关的事件急剧增加,但主要的工业模型开发商对 RAI 的标准化评估仍然很少见。不过,HELM Safety、AIR-Bench 和 FACTS 等新基准的出现,为评估模型的事实性、安全性和偏见提供了有希望的工具。

图:主要的模型所采用的安全与负责任 AI 基准

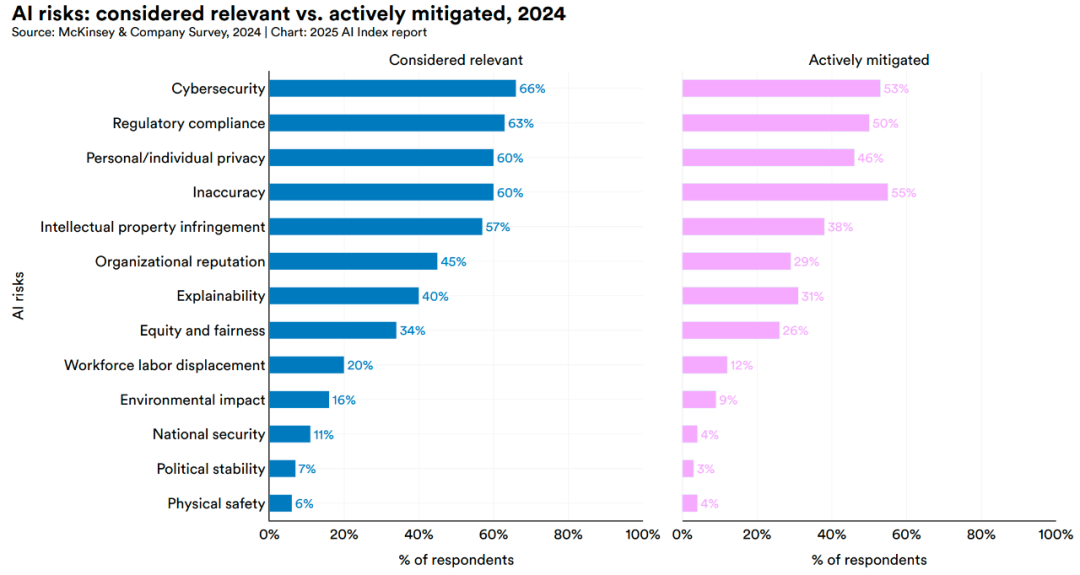

03 企业认知与行动存在差距

在企业中,认识到 RAI 风险与采取有意义的行动之间仍然存在差距。例如,仅有 64% 关注不准确性风险的领导者采取了相应行动。

图:组织认为相关并积极努力减轻的与人工智能相关的 RAI 风险

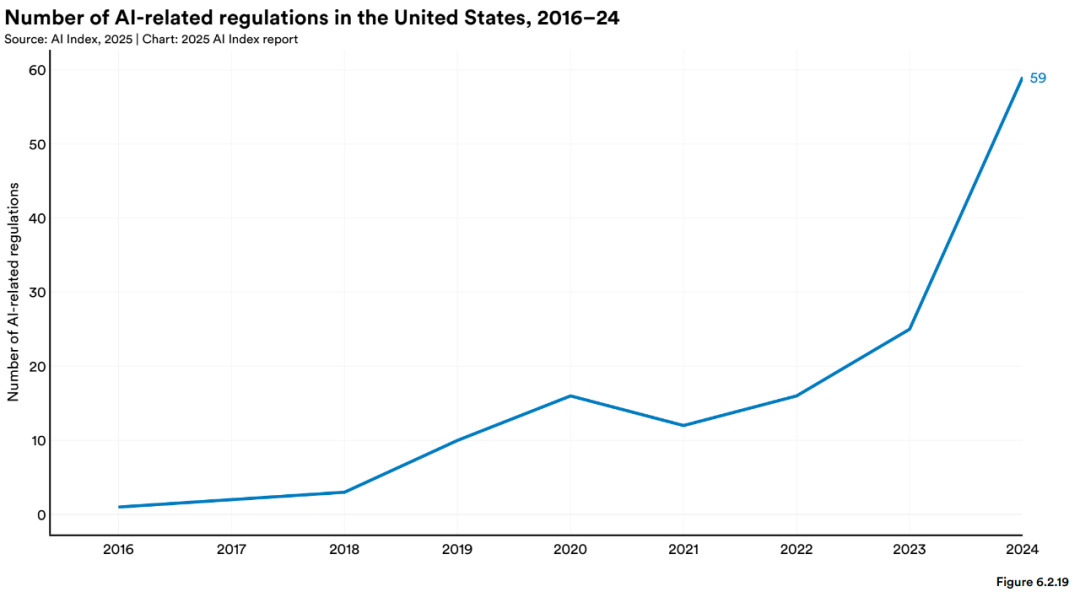

04 各国政府正在加强对AI的监管和投资

相比之下,政府表现出越来越强烈的紧迫感:2024 年,全球人工智能治理合作加强,包括经合组织、欧盟、联合国和非洲联盟在内的组织发布了以透明度、可信度和其他负责任的人工智能核心原则为重点的框架。例如美国联邦机构在 2024 年出台了 59 项 AI 相关法规,是 2023 年的两倍多。

图:2016-2024 年美国人工智能相关法规数量

全球范围内,自 2023 年以来,75 个国家的 AI 立法提及率上升了21.3%,自 2016 年以来增长了 9 倍。各国政府也在进行大规模投资,如加拿大承诺投资 24 亿美元,中国启动了 475 亿美元的半导体基金。

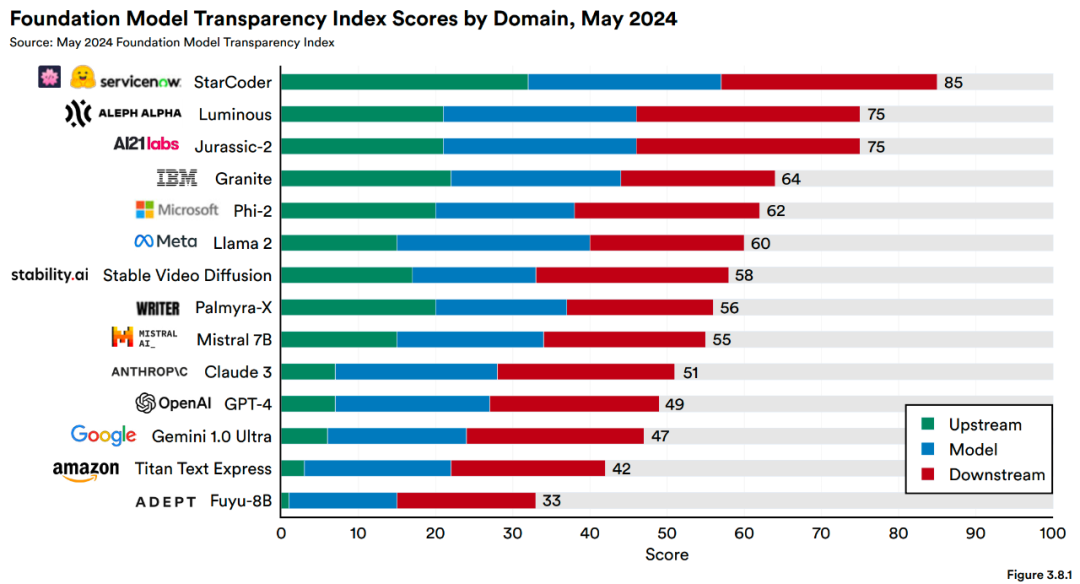

05 模型透明度有所改善,但仍需努力

基础模型透明度指数显示,主流模型开发者的平均透明度得分从 2023 年 10 月的 37% 提高到 2024 年 5 月的 58%。这表明行业在披露模型信息方面有所进步,但距离完全透明仍有很长的路要走。

图:基础模型透明度指数

参考:

https://hai.stanford.edu/ai-index/2025-ai-index-report

欢迎各位关注我的微信公众号:HsuDan,我将分享更多自己的学习心得、避坑总结、面试经验、AI最新技术资讯。

1439

1439

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?