前言

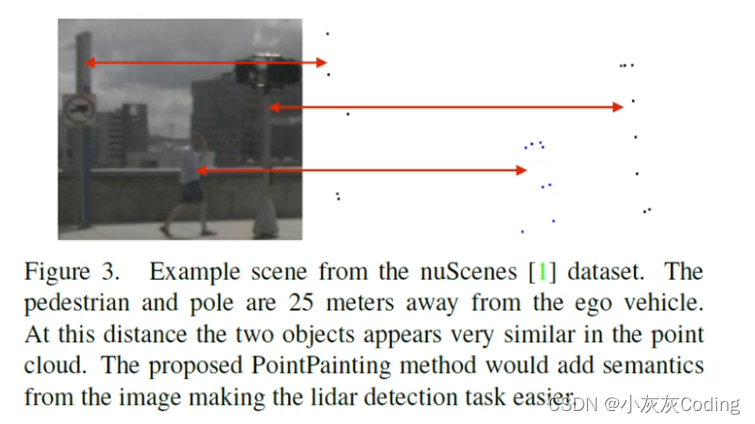

问题:多模态数据提供了互补信息,一般来说要比单模态好。然而,令人惊讶的是,Lidar-only的方法在一些主要的benchmark上甚至超与了多模态融合的方法。这个是不是意味者lidar在3D目标的感知上已经冗余了视觉呢?

作者对比了图像和点云之间的信息差异,还是很明显的看出来,图像要比激光给出了更多的语义信息。作者就怀疑,是不是之前的融合方式存在问题。

一、背景介绍

-

Object-centric fusion

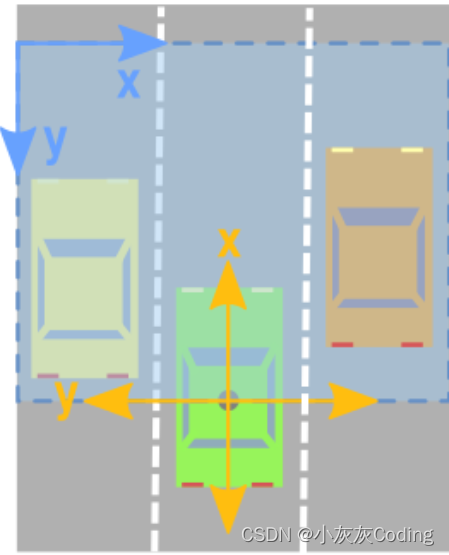

将点云投影到BEV下和图像进行融合,代表作MV3D、AVOD。

点云转BEV的方法 点云转BEV之后,仍然与前视的视角存在差异,可能会存在融合问题

点云转BEV之后,仍然与前视的视角存在差异,可能会存在融合问题 -

Continuous Feature Fusion

连续特征融合,代表工作ContFuse,相比之前的方法,使用了KNN获取特征,增强了BEV的特征。 -

Explicit Transform

使用了变换,将点云进行补全操作,增加了更多深度信息,让点云更加稠密。代表作 Pseudo-lidar point cl

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

920

920

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?