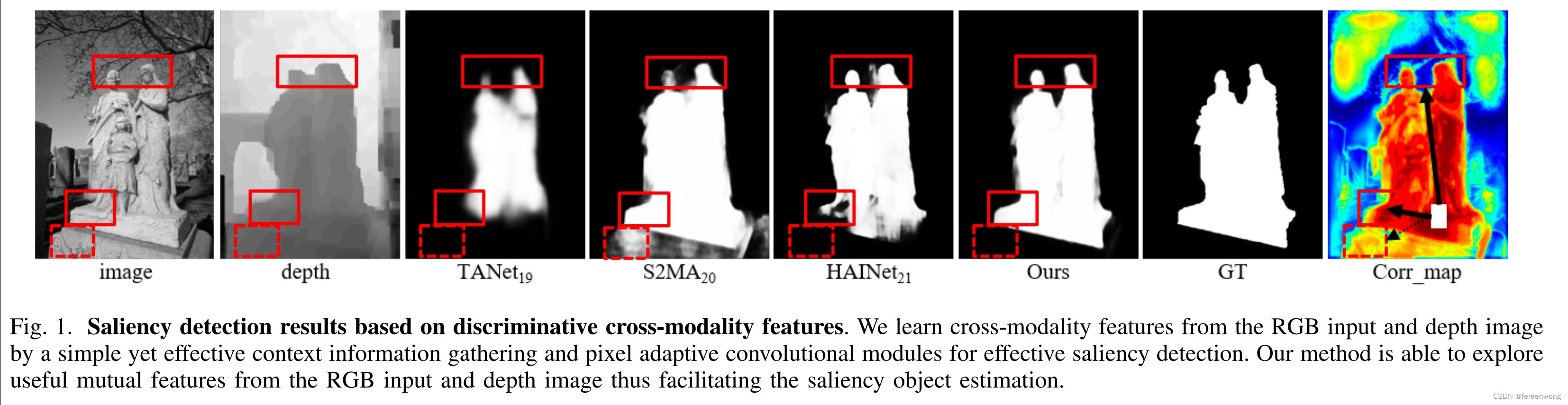

简单介绍一下自己最近发表在TIP上的一个工作: Learning Discriminative Cross-modality Features for RGB-D Saliency Detection (2021)

在这个工作里,我们提出了一种新的跨模态融合策略,关联度融合(correlation fusion),用于解决基于RGB-D(Depth)数据的显著性目标检测任务。

任务介绍

显著性物体检测(salient object detection, SOD)是为了定位并分割一个视觉场景中最显著(具有视觉吸引力)的物体。本工作基于RGB-D图像,深度图像的输入可以弥补RGB图像丢失的空间信息,从而更好的检测复杂场景下的显著性物体。

难点与动机:

- 难点:模态鸿沟(modality gap)。由于RGB-D图像分别表示不同模态的信息(RGB:颜色信息,D:空间结构信息),简单的特征拼接会引入模态不匹配问题。现有的方法关注于如何设计有效的“交互 / 融合”模块,用于桥接两种模态之间的鸿沟。

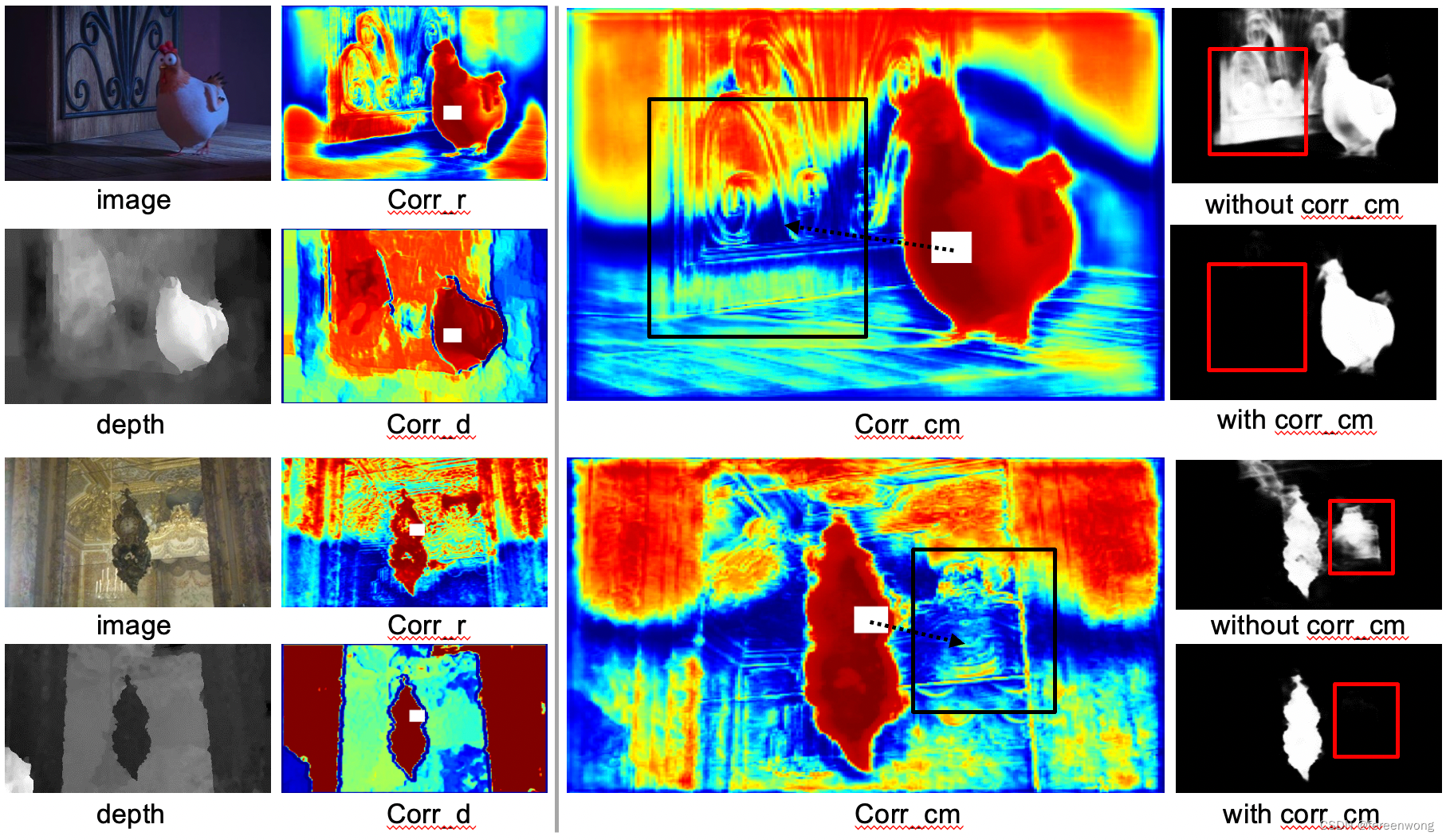

- 动机:寻找两种模态之间的共性:任意像素对,来自于同一类别(前景/背景),其关联度会大于来自不同类别的像素对。这一特性同时适用于RGB和D两种模态,并且关联度的值域分布一致(即[0,1]),因此我们提出一种简单的关联度融合作为一种新的跨模态融合策略。

- 优势:融合RGB,D两种模态之间的关联度,可以很好地互补两种模态的不足。比如,图中(上)背景与前景深度图差异较小,可以借用颜色信息很好地区分开来;图中(下)背景与前景颜色相似,可以用深度差区分开来。

(图中corr_r是基于RGB特征计算的所有像素点与白色方块的关联度,corr_d对应深度特征,corr_cm是融合corr_r与corr_d得到的关联度,最后一列我们对比了加入/移除关联度融合模块的实验结果)

(图中corr_r是基于RGB特征计算的所有像素点与白色方块的关联度,corr_d对应深度特征,corr_cm是融合corr_r与corr_d得到的关联度,最后一列我们对比了加入/移除关联度融合模块的实验结果)

方法概要

长距离关联度融合模块

这一模块是基于RGB与D特征,计算两个模态中像素对之间的关联度。在设计过程中我们考虑两个因素:

1)跨模态一致性,保证在不同模态之间计算的关联度值域范围一致。

我们选用cosine similarity,即对于任一像素点对

, 其特征分别为

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

893

893

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?