- 缓解图神经网络应用于欺诈检测的不一致性问题

- Alleviating the Inconsistency Problem of Applying Graph Neural Network to Fraud Detection

- 作者:Yingtong Dou, Zhiwei Liu, Li Sun, Yutong Deng, Hao Peng, Philip S. Yu

- Department of Computer Science, University of Illinois at Chicago School of Computer Science, Beijing University of Posts and Telecommunications Beijing Advanced Innovation Center for Big Data and Brain Computing, Beihang University

-

Abstract

- 提出一种模型 Graph−ConsisGraph−Consis,用于处理欺骗则引起的不一致问题

- 对于上下文不一致问题:结合上下文节点的特征

- 对于特征不一致问题:设计一个一致性分数来过滤不一致的邻居

- 对于关系不一致问题:学习关系注意力权重

- 创新点/贡献/优势:

- 第一篇去解决在GNN模型中的不一致问题

- 从经验上分析了将GNN模型应用于欺诈检测任务的三个不一致问题

- 提出了Graph-Consis来解决三个不一致的问题,这些问题结合了上下文嵌入,邻域信息度量和关系注意力

-

Introduction

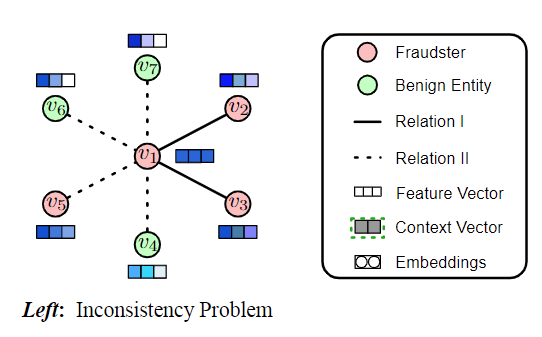

- Context inconsistency

- 聪明的欺诈者可以将自己与伪造的常规实体联系起来, 同时,欺诈者的数量远少于常规实体。

- Feature inconsistency

- 假设有来自同一用户的两条评论,但是关于不同类别的产品,这两条评论具有共同点,因为它们共享同一用户。 但是,由于它们与不同的产品相关联,因此它们的评论内容(功能)彼此相距遥远。

- Relation inconsistency

- 由于实体与多种类型的关系有关,因此平等对待所有关系会导致不一致性问题。 例如,同一用户或同一产品可能同时关联了两个评论,这两个评论分别是共同用户关系和共同产品关系。假设一个评论是可疑的,则另一个评论如果通过“公共用户关联”来关联,则应具有较高的可疑性。

-

-

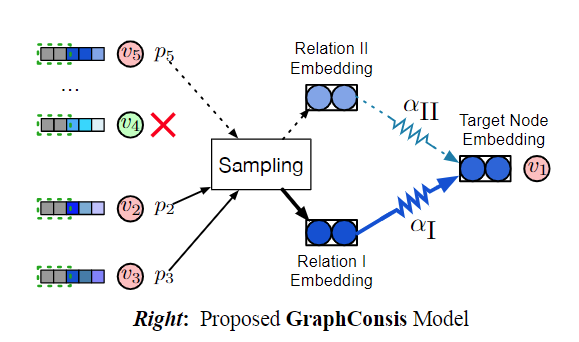

Model

- 1 :Context Embedding:

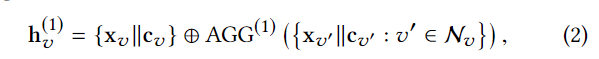

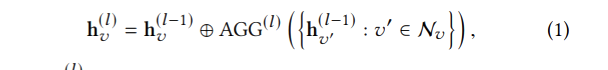

- 其中h为u在第l层的隐嵌入,Nu为节点u的邻域,AGG为将邻域信息映射为矢量的聚合函数。在这里,我们使用+O来表示邻居信息和中心节点信息的组合,它可以是直接相加,也可以是串联,然后传递给神经网络。对于AGG函数,我们首先分配一个采样概率给邻近的节点。然后我们对Q个节点进行抽样,并将它们作为一个向量进行平均。概率的计算稍后在式(4)中介绍。注意GNN的框架为l层结构,其中1 <l< l .在l层,它对I - 1层的信息进行聚合。

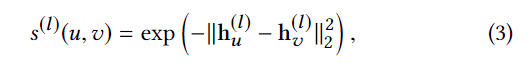

- Neighbor Sampling:

- 拼接上一个可训练的上下文特征 cv

- 其中s(D)(, .)为第l层两个节点的一致性评分,|| - Il2为向量的l2-norm2。

- 以差值的 l2−norm作为一致性分数

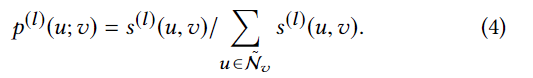

- 我们首先应用一个阈值e来过滤不一致的邻居。然后,通过对节点u的一致性评分进行归一化,将每个节点u以抽样概率分配给过滤后的节点u的邻居Nu,计算出每个点被选取的概率:

- Relation Attention

- 接下来对于每种关系进行计算

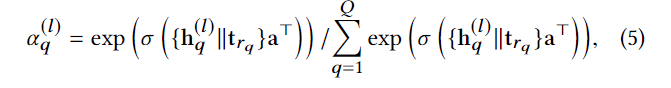

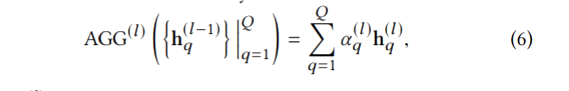

- 图中有R种不同的关系。关系信息也应该包含在聚合过程中,以解决关系不一致的问题。因此,对于每个关系r,我们训练一个关系向量tr,其中r = [1,2, ..], R),表示应合并的关系信息。由于关系信息需要与邻居一起聚合到中心节点u上,我们采用自注意机制对抽样后的Q个邻居节点赋权:

- 最后就是利用上面求出的注意力系数,对于邻居信息进行聚合

- 使用 trq 作为可训练的关系向量,其余部分和GAT相似,其中rq为第q个样本与节点v的关系,o为激活函数,a∈ R4d为所有注意层共享的注意权值。最终的AGG(1)为:

-

-

Conclusion

- 在本文中研究了在欺诈检测问题中应用GNN的三个不一致问题。 为了解决这些问题,分别设计了三个模块并提出了Graph-Consis。实验结果表明了Graph-Consis的有效性。 未来的工作包括为每个关系设计一个自适应采样阈值,以最大程度地提高GNN的接收范围。

- GNN模型:

- 其中h为u在第i层的隐嵌入,Nu为节点u的邻域,AGG为将邻域信息映射为向量的聚合函数。在这里,我们用O来表示邻居信息和中心节点信息的组合,可以直接相加,也可以串联,然后传递给神经网络。对于AGG函数,我们首先分配一个采样概率给邻近的节点。然后我们对Q个节点进行抽样,并将它们作为一个向量进行平均。概率的计算在后面的式(4)中介绍。注意GNN的框架是l层结构,其中1 <l< L .在l层,它从l- 1层汇总信息。

- 另外看的

-

Experiments

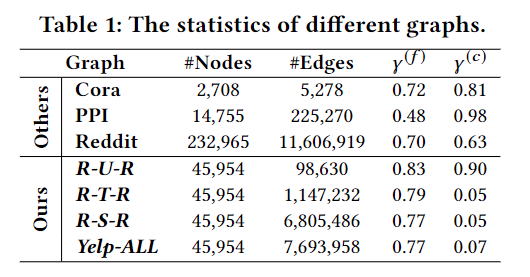

- 数据集

-

- Yelp数据集包含由Yelp过滤和推荐的酒店和餐厅评论。

- R-U-R: it connects reviews posted by the same user

- R-S-R: it connects reviews under the same product with the same star rating (1-5 stars)

- R-T-R: it connects two reviews under the same product posted in the same month

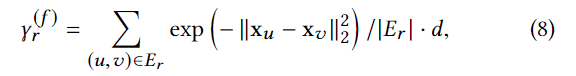

- γ(f) 表示特征不一致的程度:

-

- 我们使用RBF核函数3作为两个连通节点之间的相似性度量。用特征维数和特征维数的乘积归一化特征评分,用特征维对相似性进行归一化是为了比较不同图的特征特征,它们可能具有不同的特征维数。

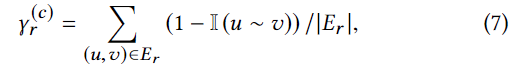

- γ(c) 表示上下文不一致的程度:

- 其中i(-)∈{0,1}是指示函数,指示节点u和节点v是否具有相同的标签。我们把所有的表示和所有的边加起来,用边的总数来归一化。上下文特征度量了上下文不一致。我们基于方程计算上下文特征yr‘。(7)衡量语境的一致性。对于图R-T-R、R-S-R和Yelp-all,只有不到10%的相邻节点具有相似的标签.这表明欺诈者在某些关系下可能隐藏在正规实体之间。用等式计算特征特征。(8)用R-U-R关系构造的图(由同一用户审查)比其他两种关系具有更高的特征。因此,不仅需要根据相邻节点的关系,而且要根据特征相似性对相邻节点进行采样。

- 关系一致性。对于由三种不同关系构造的图,相邻节点也有不同的特征/标签不一致性特征。因此,在聚合过程中需要处理不同的关注权关系。

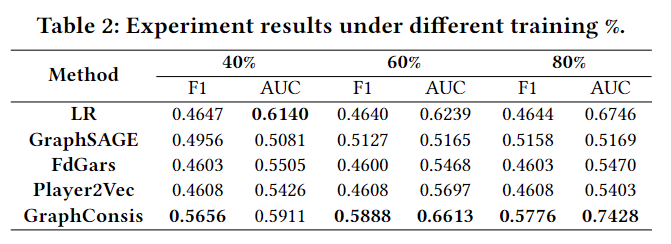

- 可以看到,在这两个指标上,Graph-Consis在训练数据的80%和60%都优于其他模型,这表明我们可以缓解不一致问题。 与其他基于GNN的模型相比,LR在AUC上性能稳定且更好。 它表明节点功能很有用,但是GNN中的聚合器在识别欺诈者时会破坏分类器。 该观察还证明了不一致问题是至关重要的,在将GNN应用于欺诈检测任务时应予以考虑。

- 与也学习关系注意的Player2Vec相比,Graph-Consis表现更好。 这表明仅使用关系注意不能减轻特征不一致。 邻居应该按照我们设计的方法进行过滤和采样。

- FdGars直接聚合邻居的信息,而GraphSAGE以相等的概率抽样邻居。 两者的性能都比Graph-Consis差,这表明我们的邻居采样技术很有用

-

- 数据集

-

总结

- 该文章借助Yelp 评论水军数据集,说明了现有 GNN 欺诈检测模型存在的问题,即忽略了图数据中的不一致性。

- 例如可疑节点的邻居可能大部分是正常节点。该文章设计了一种基于邻居的过滤方式,从而在 GNN 邻居聚合时避免了噪音邻居的加入。

- 该论文通过预先定义的关系建立同质图,在聚合邻居信息时考虑到不同关系的重要程度。

- 作者:Yingtong Dou, Zhiwei Liu, Li Sun, Yutong Deng, Hao Peng, Philip S. Yu

- Alleviating the Inconsistency Problem of Applying Graph Neural Network to Fraud Detection

Alleviating the Inconsistency Problem of Applying Graph Neural Network to Fraud Detection欺诈检测、图神经网络

最新推荐文章于 2024-07-12 23:11:20 发布

593

593

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?