- 作者:An-Chieh Cheng 1 ^{1} 1, Yandong Ji 1 ^{1} 1, Zhaojing Yang 2 ^{2} 2, Xueyan Zou 1 ^{1} 1, Jan Kautz 3 ^{3} 3, Erdem Bıyık 2 ^{2} 2, Hongxu Yin 3 ^{3} 3, Sifei Liu 3 ^{3} 3, Xiaolong Wang 1 , 3 ^{1,3} 1,3

- 单位: 1 ^{1} 1加州大学圣地亚哥分校, 2 ^{2} 2南加利福尼亚大学, 3 ^{3} 3NVIDIA

- 原文链接: NAVILA: LEGGED ROBOT VISION-LANGUAGE ACTION MODEL FOR NAVIGATION(https://arxiv.org/pdf/2412.04453)

- 视频演示:https://navila-bot.github.io/

主要贡献

- 论文提出了NaVILA框架,结合了视觉-语言-动作模型(VLA)与运动技能的两级系统,以提高腿式机器人的导航能力。

- NaVILA通过VLM生成高层次动作指令,增强模型泛化性。

- 引入的VLN-CE-Isaac基准测试,利用Isaac Sim模拟器,提供了更复杂的评估场景。

- NaVILA在VLN基准测试中成功率提升17%,在VLN-CE-Isaac中视觉策略成功率提高14%,验证了其泛化和鲁棒性。

研究背景

研究问题

论文主要解决腿式机器人(如四足或类人机器人)的视觉语言导航(Vision-and-Language Navigation, VLN)。

现有的VLN系统通常依赖于预计算地图或使用深度传感器和单目RGB相机构建几何地图,但这些方法在复杂和杂乱的环境中表现有限。

研究难点

该问题的研究难点包括:

- 如何将人类语言指令转换为低级别的腿部关节动作,

- 在不同机器人之间迁移VLN模型。

- 现有的VLN系统在处理连续环境和低级运动控制方面也存在挑战。

相关工作

早期的VLN研究集中在离散环境中的导航,如MP3D数据集。

随着基础模型的提升,许多VLN系统通过大规模预训练技术取得了显著进展。

最近的研究转向了连续环境,使用模拟器如Habitat进行导航。

然而,这些方法通常依赖于模拟器特定的数据,难以泛化到真实世界。

研究方法

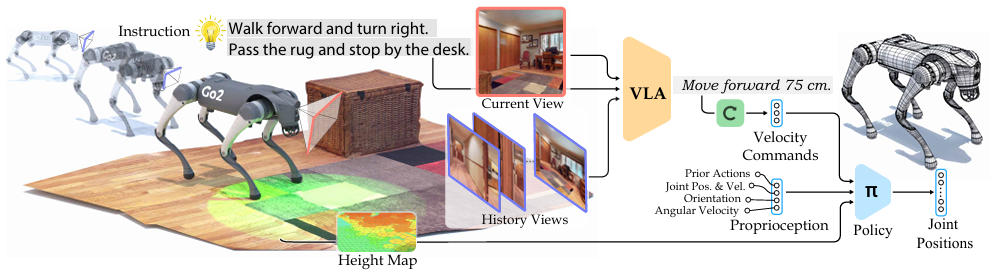

论文提出了NaVILA,一种用于腿式机器人视觉语言导航的两级框架。

基于VLMs的高层级导航规划

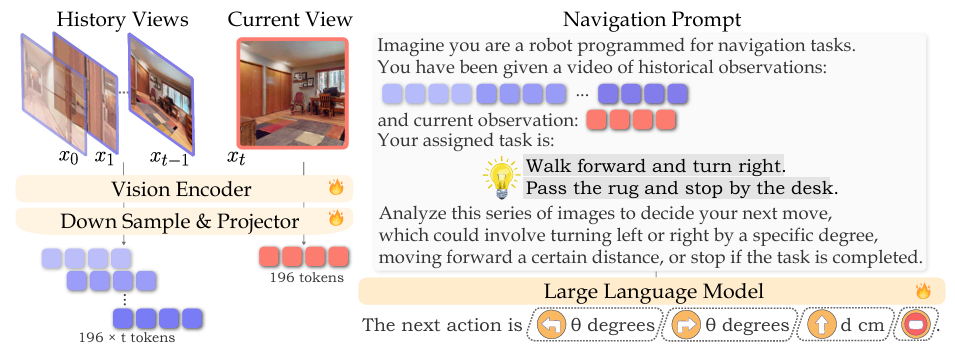

NaVILA使用一个视觉语言模型(VILA)处理单视图图像,生成自然语言形式的中间动作指令,如“向前移动75厘米”。这些指令作为输入传递给视觉运动强化学习(RL)策略以执行。

-

VILA 包括三个主要组件:视觉编码器(Vision Encoder):处理输入图像,将其转换为一系列视觉标记(visual tokens)。投影器(Projector):通过多层感知机(MLP)将视觉标记下采样并映射到语言域。大型语言模型(LLM):接收投影后的标记和文本标记,并进行自回归生成。

-

导航提示:设计特定的导航提示,区分当前观察帧和历史帧,确保模型能够跟踪整体进度并做出即时决策。

-

监督微调数据融合:从四个方面构建微调数据集:真实视频导航数据、模拟导航数据、辅助导航数据和通用问答数据集。

低层级运动控制策略

NaVILA的低级运动控制策略将VLA输出的中间动作指令转换为精确的关节运动,以实现实时机器人控制。该策略从LiDAR点云构建高度图,并通过随机化来弥合模拟与真实世界的差距。该策略在 Isaac Sim 模拟器中训练,然后部署到真实机器人Go2 上。

- Go2 机器人配备激光雷达传感器,提供 18 个自由度,策略仅控制腿部的 12 个关节。

- VLM 输出的命令(如“向前移动”)被转换为速度命令,策略通过 PPO 算法训练,实时调整关节位置。

- 激光雷达生成的高度图用于环境感知,确保安全导航。

- 单阶段训练方法提高了训练效率和策略的鲁棒性。

实验设计

数据收集

论文设计了多种数据源来训练VLA,包括真实视频、模拟数据、辅助导航数据和通用视觉问答(VQA)数据集。

具体来说,使用了YouTube上的2K个第一人称旅游视频,通过熵采样生成20K条轨迹,并使用Mast3R估计相机姿态以提取步骤动作和生成自然语言指令。

实验设置

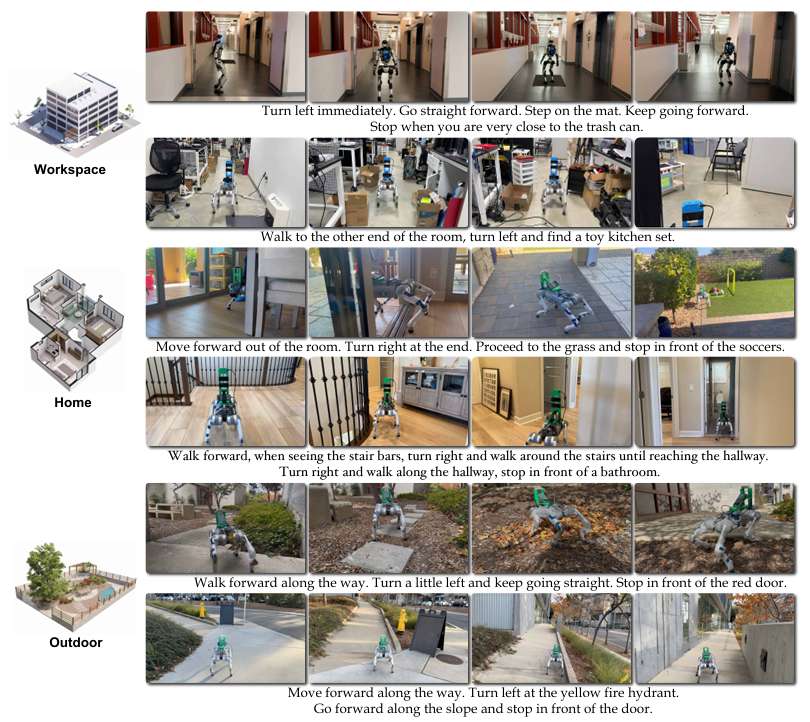

在Isaac Sim模拟器中使用Isaac Lab训练视觉运动策略,并在真实机器人上进行部署。实验在多个环境中进行,包括工作区、家庭和室外开放环境。

参数配置

在训练过程中,使用PPO算法训练运动策略,奖励函数包括线速度和角速度跟踪、线性速度惩罚、关节加速度等。LiDAR和高度图的参数也进行了详细配置。

结果与分析

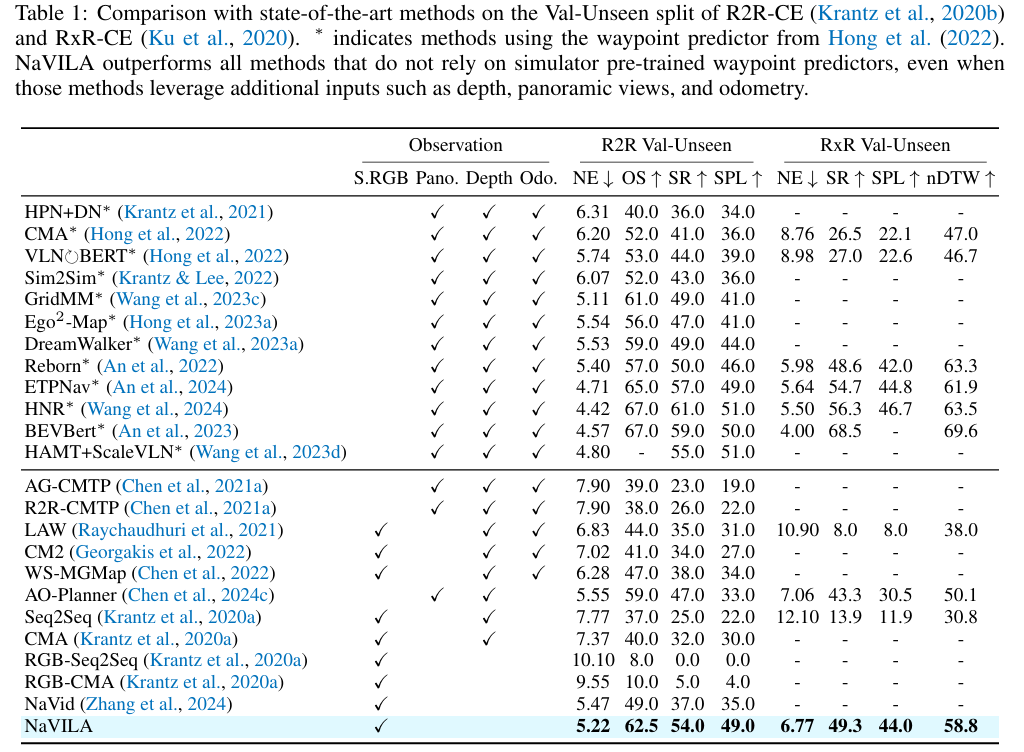

VLN-CE基准测试

在R2R和RxR数据集的Val-Unseen分割上,NaVILA显著优于所有基线方法,成功率达到62.5%,比现有最先进的NaVid方法提高了17%。

空间场景理解

在ScanQA验证集上,NaVILA显著优于现有的NaviLLM模型,CIDEr得分提高了20个百分点。

模拟器中的导航性能

在新的VLN-CE-Isaac基准测试中,NaVILA在Go2和H1机器人上的成功率分别提高了14%和21%。

真实世界评估

在真实世界中,NaVila在25个指令上达到了88%的成功率,其中复杂指令的成功率为75%。

总结

论文提出了NaVILA两级框架,结合了视觉语言模型(VLA)和运动技能,用于通用导航任务。

NaVILA通过生成基于语言的中间动作指令,并使用实时运动策略处理障碍物避让,提高了鲁棒性和灵活性。

实验结果表明,NaVILA在经典VLN基准测试中显著优于现有方法,并在真实世界中展示了强大的性能。

2331

2331

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?